Ogni conversazione tra creator in questo trimestre finisce prima o poi su un solo modello: Wan 2.7. Sviluppata dal Tongyi Lab di Alibaba, questa versione è diventata la recensione più richiesta nello spazio della generazione video AI, non per l'hype del marketing, ma perché affronta la frustrazione più persistente per chi crea contenuti: mantenere personaggi coerenti, un controllo preciso delle scene e output di qualità da produzione su più inquadrature. Dopo test approfonditi su workflow reali, questa recensione completa spiega cosa offre davvero Wan 2.7 Video, dove eccelle e come si confronta con i modelli concorrenti nel 2026.

Cos'è Wan 2.7 e perché conta?

Wan 2.7 è un modello di generazione video AI all'avanguardia basato su un'architettura Mixture-of-Experts (MoE) da 27 miliardi di parametri. A differenza dei predecessori, Wan 2.7 segna un passaggio fondamentale dalla pura generazione text to video verso un toolkit completo per la produzione video con meccanismi di controllo strutturati. Il modello genera video cinematografici in HD 1080P da descrizioni testuali, immagini e persino input audio, combinando fedeltà visiva, sincronizzazione audio e coerenza del movimento in un unico framework unificato.

Ciò che distingue Wan 2.7 dalle versioni precedenti e dai modelli concorrenti non è solo il numero di parametri o la risoluzione. La vera svolta sta nelle capacità di iniezione multimodale e nel set di funzionalità orientato alla produzione. Dove Wan 2.6 richiedeva ai creator di scrivere un prompt testuale e sperare che l'AI ne cogliesse l'intento, spesso con distorsioni visive e output imprevedibili, Wan 2.7 consente di iniettare direttamente immagini, video e audio per decodificare movimento e illuminazione con accuratezza 1:1. Questo traduce l'intento esatto del creator in visual cinematografici iper-realistici con una precisione senza precedenti.

La validità commerciale del modello è altrettanto significativa. Wan 2.7 usa un modello di pricing basato su crediti, senza canoni mensili, senza lock-in di piattaforma e con crediti che non scadono mai. Per le agenzie che producono 50 varianti di annunci a settimana, questo significa automatizzare la generazione grezza con meno di 50 dollari in crediti, liberando tempo umano per strategia e revisione finale: un cambiamento concreto nell'economia della produzione.

Le funzionalità core che ridefiniscono la generazione video AI

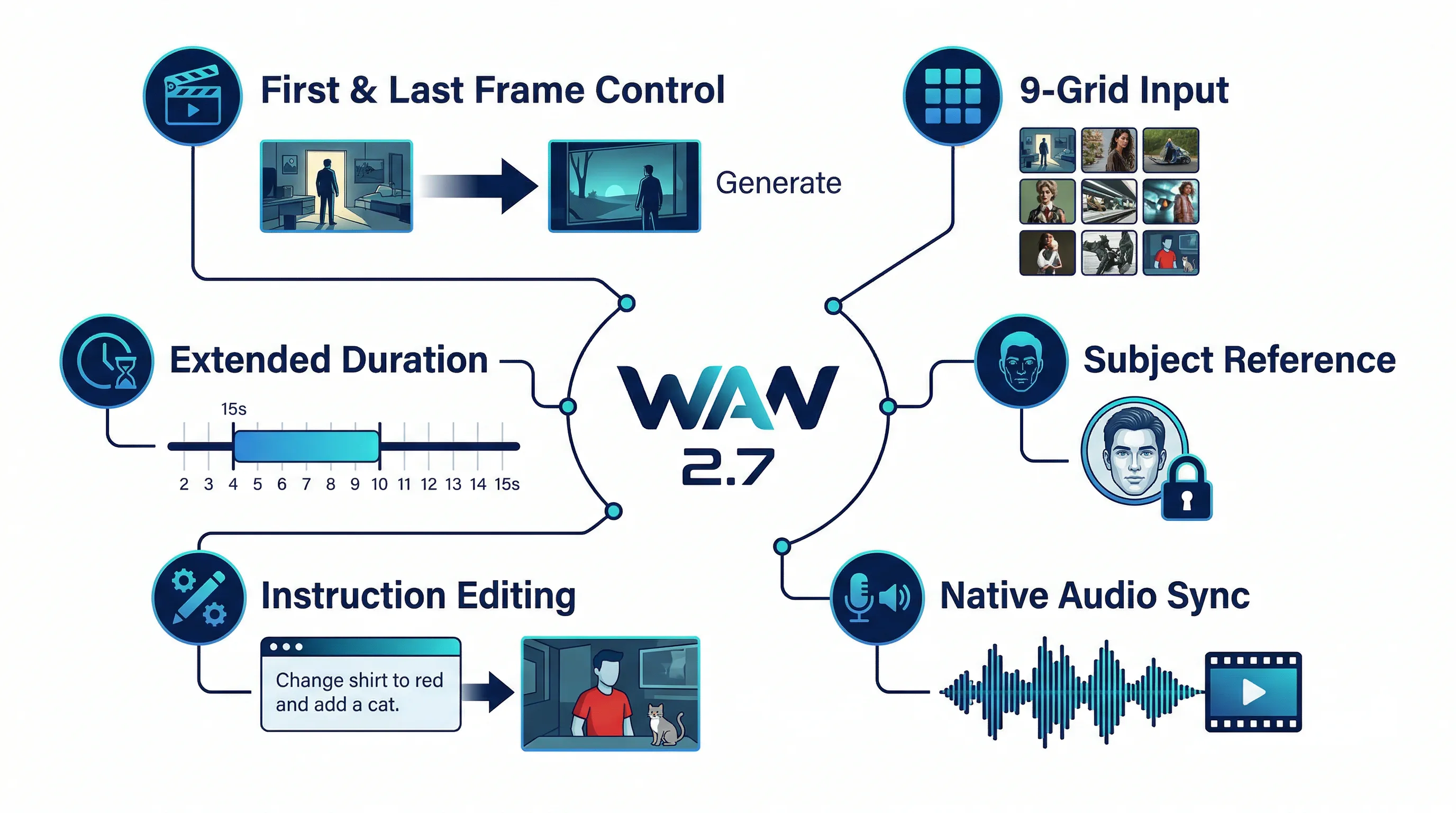

Controllo First-and-Last-Frame: storytelling di precisione

La funzionalità più discussa di Wan 2.7 è la generazione first-and-last-frame, una capacità che cambia in modo fondamentale il modo in cui i creator affrontano la produzione video AI. Invece di generare una clip e sperare che arrivi dove ti serve, fornisci due immagini di riferimento: come il video deve apparire all'inizio e come deve apparire alla fine. Il modello genera quindi il movimento e la transizione tra questi due ancoraggi, offrendo una progressione narrativa prevedibile e controllabile.

Questo risolve una delle frustrazioni più persistenti dei video AI: l'evoluzione imprevedibile della scena. In Wan 2.1, questa capacità esisteva come checkpoint separato del modello (Wan2.1-FLF2V-14B), costringendo i creator a passare da una versione all'altra. In Wan 2.7, il controllo first-and-last-frame è integrato direttamente nel modello principale, eliminando attriti nel workflow e consentendo una produzione multi-shot senza soluzione di continuità. Se il tuo workflow parte da still approvati invece che da prompt puri, questo rende Wan 2.7 anche più naturale per i flussi image to video.

Le applicazioni pratiche sono immediate. Per i filmmaker che storyboardano una sequenza, puoi definire la composizione esatta nei punti di ingresso e uscita della scena. Per i marketer che creano demo di prodotto, controlli il posizionamento preciso del prodotto nei momenti chiave. Per gli educatori che producono contenuti tutorial, garantisci continuità visiva tra i segmenti didattici. Questo livello di controllo porta la generazione video AI da strumento sperimentale ad asset pronto per la produzione.

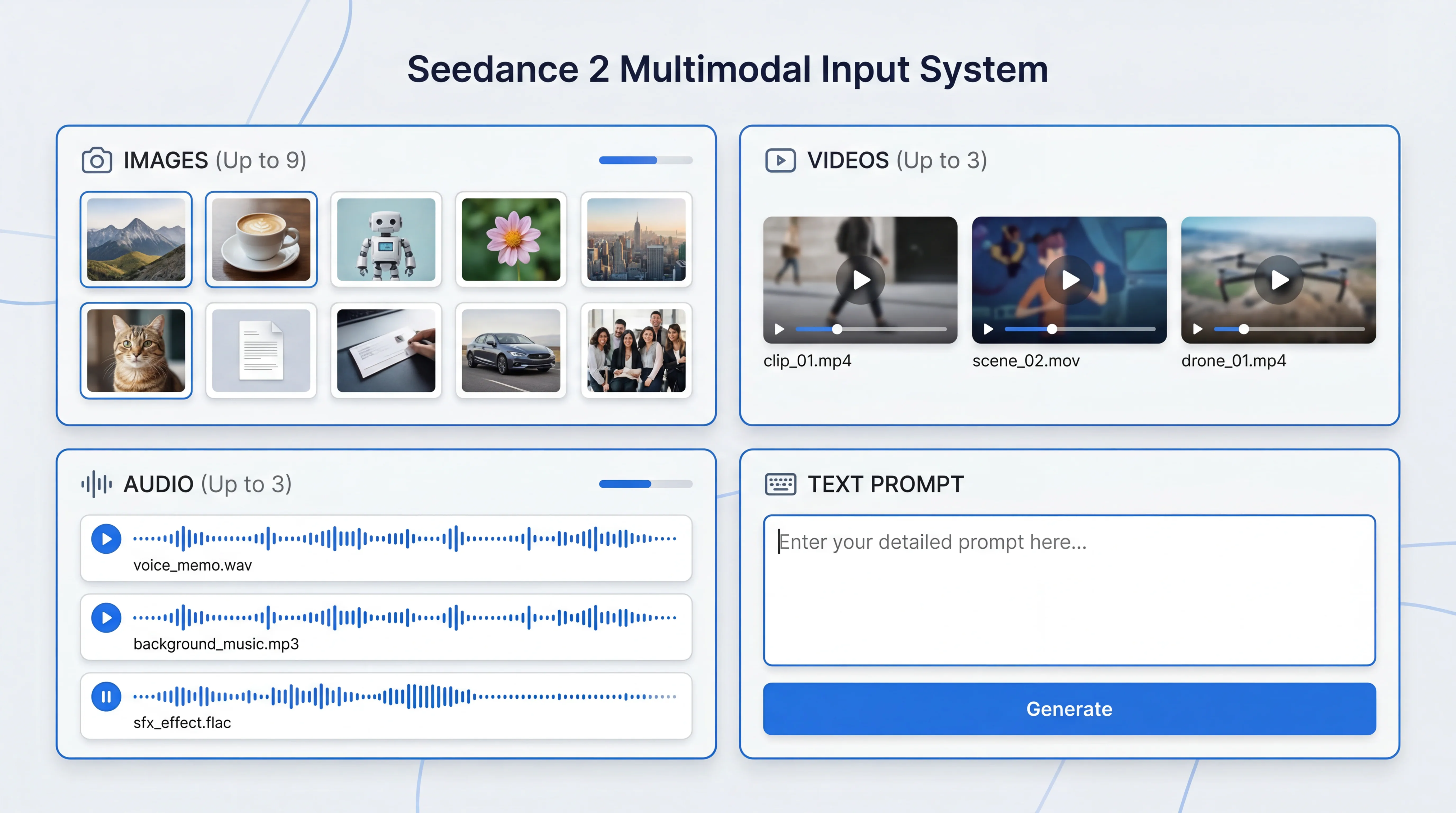

Image-to-Video a griglia 9: storytelling visivo strutturato

Wan 2.7 introduce un rivoluzionario sistema di input immagini a griglia 9 (3x3) per la generazione video. Invece di fornire una sola immagine di riferimento, i creator consegnano una griglia di nove immagini che definiscono composizione della scena, angolazioni dei personaggi, condizioni di luce e contesto visivo in momenti o prospettive diverse. Il modello sintetizza poi questi input in una sequenza animata coerente che mantiene la consistenza strutturale lungo tutto il video.

Questa funzionalità colma il divario tra planning statico da storyboard e output animato in un modo che nessun modello Wan precedente riusciva a raggiungere. Rispetto ai metodi autoregressivi tradizionali per video AI, l'approccio a griglia 9 offre coerenza superiore, maggiore velocità di inferenza e migliore coesione strutturale. Per i team di produzione che lavorano da storyboard dettagliati, questo trasforma gli asset di pianificazione direttamente in movimento, senza il consueto ciclo di tentativi ed errori.

Il sistema a griglia 9 eccelle in particolare negli scenari che richiedono movimenti di camera complessi o interazioni tra personaggi. Fornendo più angolazioni di riferimento, i creator possono guidare la comprensione del modello delle relazioni spaziali, della profondità e delle traiettorie di movimento, ottenendo output che sembrano coreografati con intenzione invece che generati casualmente.

Riferimento di soggetto e voce: coerenza identitaria tra le inquadrature

Mantenere la coerenza dei personaggi è sempre stato notoriamente difficile nella generazione video AI, dove le identità tendevano facilmente a collassare o a derivare tra i frame. Wan 2.7 introduce quello che la documentazione chiama "Absolute Identity Lock", un sistema di riferimento del soggetto che blocca perfettamente tratti del viso (altezza degli occhi, linee del mento), dettagli degli abiti e stile ambientale anche con movimenti di camera complessi.

Forni un'immagine di riferimento di una persona, un oggetto o un personaggio, e il modello mantiene quell'identità visiva lungo tutto il video generato. Questo risponde alla principale critica rivolta a Wan 2.5 e 2.6: personaggi che non sembravano uguali da un frame all'altro. Il miglioramento è subito evidente nei test, con cambi di abiti a metà clip molto meno frequenti, meno morphing del volto e meno drift dell'identità.

Il riferimento vocale estende questa coerenza all'audio. I creator possono fornire un campione vocale e Wan 2.7 manterrà quell'identità sonora nei tracciati audio generati, un aspetto critico per contenuti brandizzati, narrazioni guidate da personaggi o qualsiasi progetto che richieda una voce riconoscibile e coerente. Questo mette Wan 2.7 in competizione diretta con strumenti come Kling e Hailuo, che offrono da tempo generazione coerente con l'identità, ma con una integrazione di funzionalità più ampia nel caso di Wan 2.7.

Sincronizzazione audio nativa: un suono che segue il movimento

A differenza della maggior parte dei modelli video AI che generano clip silenziose e richiedono un montaggio audio manuale, Wan 2.7 include una generazione audio nativa sincronizzata direttamente con il contenuto visivo. Musica di sottofondo, suoni ambientali e voci dei personaggi vengono generati in sync con il movimento della scena fin dall'inizio, non aggiunti in seguito. Per chiunque abbia mai dovuto allineare manualmente audio e video AI frame per frame, questo rappresenta l'upgrade più immediatamente utile dell'intero set di funzionalità.

Il modello supporta un input audio opzionale, permettendo ai creator di fornire un audio di riferimento che influenza sia la generazione visiva sia l'output sincronizzato. Questo approccio multimodale significa che puoi inserire una traccia musicale e far sì che ritmo, tagli e dinamiche di movimento del video reagiscano al ritmo e al tono emotivo dell'audio, creando un livello di coerenza audiovisiva che prima si otteneva solo con un lavoro di post-produzione molto esteso.

Editing video basato su istruzioni: modifiche guidate dal testo

Una delle funzionalità più innovative di Wan 2.7 è l'editing video basato su istruzioni, cioè la possibilità di modificare video esistenti con semplici comandi testuali senza rigenerare tutto da zero. Invece di ricominciare da capo quando serve un aggiustamento, puoi digitare comandi come "replace the background", "shift the lighting to golden hour" o "recolor the outfit to blue" e il modello applica le modifiche preservando tutti gli altri elementi.

Questa capacità di video-to-video riduce la complessità dei dati in input e il carico computazionale, offrendo risultati più rapidi rispetto a una rigenerazione completa. Nei workflow creativi iterativi, questo è trasformativo. Puoi rifinire gli output con regolazioni mirate invece di affidarti al caso su nuove generazioni complete. La funzione è particolarmente utile per le agenzie che applicano trattamenti stagionali a filmati già esistenti o per i brand team che mantengono la coerenza visiva dei prodotti in più scene senza dover girare di nuovo.

Durata estesa e continue filming: oltre il limite del frammento

Uno dei vincoli maggiori dei modelli video di prima generazione era la durata narrativa, tipicamente limitata a segmenti di 3 o 4 secondi per singola ripresa. Wan 2.7 affronta questo limite con la funzione "continue filming", un sistema di estensione intelligente che consente di espandere in modo quasi infinito i materiali video esistenti. Il modello supporta durate di output da 2 a 15 secondi in una singola generazione, rendendolo l'unica opzione tra i principali concorrenti per clip oltre i 10 secondi.

Questa capacità di durata estesa, combinata con il controllo first-and-last-frame, abilita una vera costruzione narrativa multi-shot. I creator possono concatenare sequenze con transizioni prevedibili, costruendo contenuti più lunghi che mantengono coerenza visiva e stilistica dall'inizio alla fine, un requisito critico per i workflow professionali.

Specifiche tecniche e qualità dell'output

Wan 2.7 genera video in HD 1080P nativo, con 720P disponibile per un'elaborazione più rapida. Il modello produce output a 24fps, allineandosi agli standard cinematografici per un movimento professionale. I tempi di generazione variano in base a durata e risoluzione, ma l'architettura del modello privilegia la qualità rispetto alla velocità, una scelta deliberata che lo posiziona come strumento di produzione più che come sistema di prototipazione rapida.

La qualità visiva del modello rappresenta un upgrade significativo rispetto a Wan 2.6 su più dimensioni. La coerenza stilistica è nettamente più forte. Il modello mantiene con maggiore affidabilità realismo cinematografico, estetiche anime e stili illustrati da un frame all'altro, cosa essenziale per contenuti che richiedono un'identità visiva riconoscibile lungo tutto il video. La coerenza temporale è migliorata in modo drastico, con meno volti che sfarfallano, meno cambi di abito a metà clip e meno casi in cui i soggetti mutano leggermente tra un'inquadratura e l'altra.

Le dinamiche di movimento mostrano una rifinitura particolare. Il movimento delle ali in un test con un'aquila in volo ha mostrato una profondità di campo pulita e un movimento naturale, senza gli artefatti nervosi comuni nei modelli precedenti. Le panoramiche paesaggistiche mostrano nuvole in movimento fluido e una profondità atmosferica convincente, con il modello che gestisce bene i negative prompt per sopprimere artefatti come blur, distorsioni e watermark.

Come si confronta Wan 2.7 con i modelli concorrenti

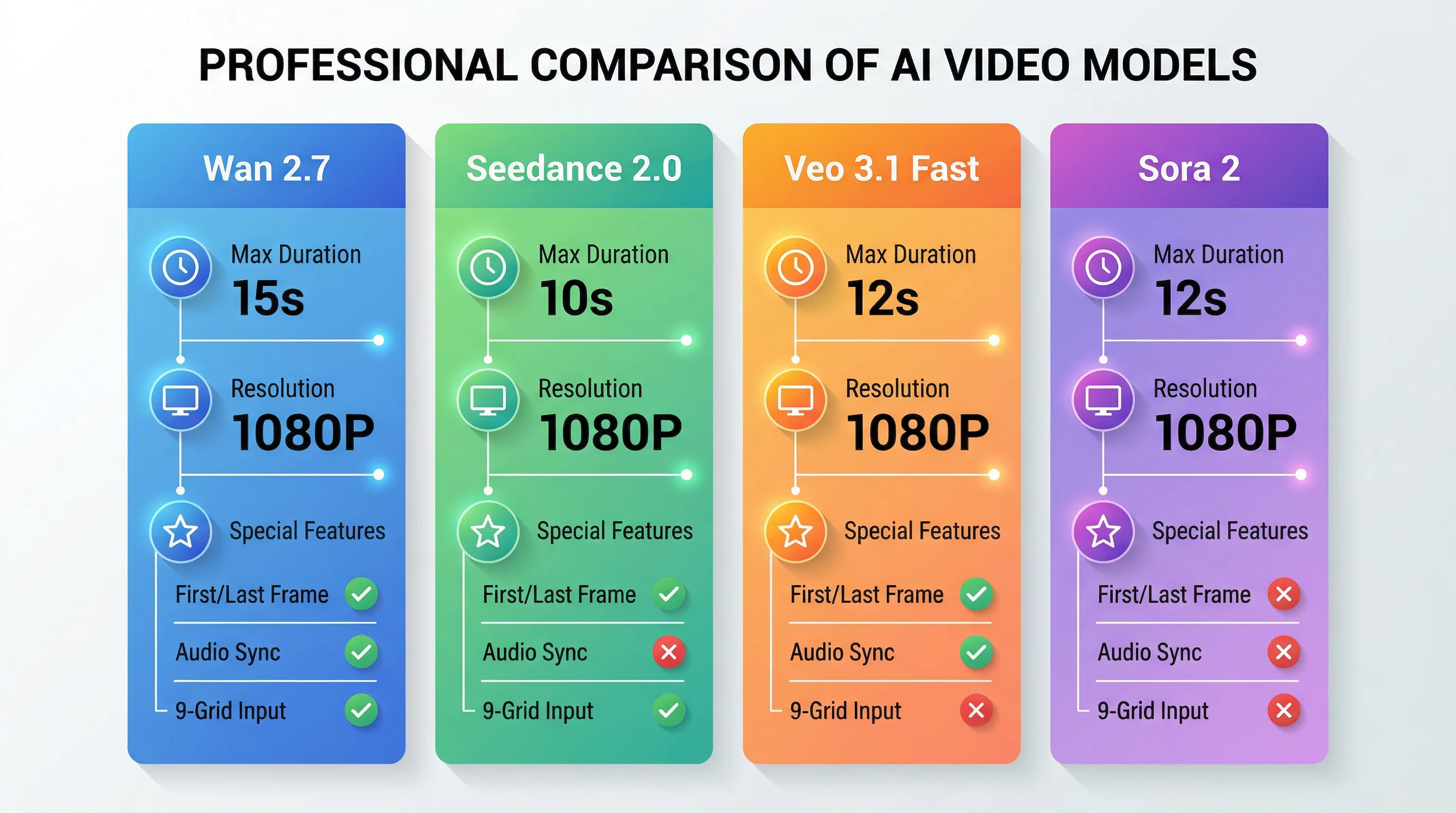

Wan 2.7 vs Seedance 2.0: funzionalità contro valore

Seedance 2.0 di ByteDance offre il miglior rapporto qualità-prezzo per il movimento di alta qualità al costo più basso per secondo oggi sul mercato. Tuttavia, Wan 2.7 è il coltellino svizzero del confronto, offrendo il maggior numero di funzioni, la massima flessibilità e il miglior fit per i workflow che richiedono sincronizzazione dell'input audio o controllo frame-to-frame.

Seedance 2.0 arriva fino a clip di 10 secondi e non offre il controllo first-and-last-frame né le funzioni di input audio. Interpreta i prompt con un po' più di libertà creativa, il che può essere utile o frustrante a seconda delle esigenze del progetto. Seedance è generalmente più veloce nella generazione via API, quindi è ideale per iterazioni rapide e test. L'approccio più intelligente adottato da molti team di produzione è usare Seedance 2.0 per iterare e testare, per poi generare l'output finale con Wan 2.7 quando servono controlli creativi unici. Se vuoi approfondire i trade-off di produzione, leggi la recensione dedicata di Seedance 2 e il più vecchio confronto Seedance 2 vs Wan 2.6.

Wan 2.7 vs Veo 3.1: controllo contro fisica

Veo 3.1 Fast di Google è il leader sul realismo fisico ed è l'unico modello nel confronto a offrire sia audio generato automaticamente sia clip da 12 secondi a 0,10 dollari al secondo. Veo 3.1 produce output di qualità cinematografica a 24fps con generazione audio nativa, inclusi suoni ambientali, dialoghi e musica tutti sincronizzati con il video. Tuttavia, Veo 3.1 Lite arriva solo a 8 secondi e non ha le funzionalità di controllo granulare che definiscono Wan 2.7.

Dove Wan 2.7 eccelle è nel dare ai creator un controllo preciso sulla costruzione della scena attraverso ancoraggi first-and-last-frame, composizione a griglia 9 e editing basato su istruzioni. Veo 3.1 privilegia la simulazione fisica realistica e il movimento naturale, rendendolo ideale nei casi in cui il realismo conta più del controllo. La scelta tra i due dipende dal fatto che il tuo workflow valorizzi la direzionalità (Wan 2.7) o la fisica naturalistica (Veo 3.1). Per un'analisi completa, la recensione di Veo 3.1 copre in modo più approfondito il lato fisico e audio.

Wan 2.7 vs Sora 2: strumento di produzione contro piattaforma sperimentale

Sora 2 di OpenAI è leader sul realismo fisico e offre clip da 12 secondi con audio generato automaticamente. Tuttavia, Sora ha ancora un posizionamento più sperimentale, con minore enfasi sull'integrazione nei workflow di produzione. Il set di funzionalità di Wan 2.7, in particolare il controllo first-and-last-frame, l'input a griglia 9 e l'editing basato su istruzioni, è progettato esplicitamente per rispecchiare il modo in cui funzionano davvero i workflow professionali: hai uno storyboard, hai un personaggio e hai punti di inizio e fine definiti per ogni scena. Wan 2.7 lavora con questa struttura, non contro di essa. Se stai confrontando i modelli frontier nell'intera categoria, il più ampio confronto tra modelli video AI è un compagno utile.

Tabella di confronto dei modelli

| Funzionalità | Wan 2.7 | Seedance 2.0 | Veo 3.1 Fast | Sora 2 |

|---|---|---|---|---|

| Durata massima | 15 secondi | 10 secondi | 12 secondi | 12 secondi |

| Risoluzione massima | 1080P | 1080P | 1080P | 1080P |

| Controllo primo/ultimo frame | ✓ | ✗ | ✗ | ✗ |

| Sincronizzazione input audio | ✓ | ✗ | ✗ | ✗ |

| Generazione audio nativa | ✓ | ✗ | ✓ | ✓ |

| Input immagine a griglia 9 | ✓ | ✗ | ✗ | ✗ |

| Editing basato su istruzioni | ✓ | ✗ | ✗ | ✗ |

| Riferimento soggetto | ✓ | ✓ | ✓ | ✓ |

| Negative prompt | ✓ | Limitato | ✗ | ✗ |

| Modello di pricing | Crediti (senza scadenza) | Per generazione | Per generazione | Abbonamento |

| Uso commerciale | Tutti i piani | Tutti i piani | Tutti i piani | Variabile |

Casi d'uso reali e integrazione nel workflow

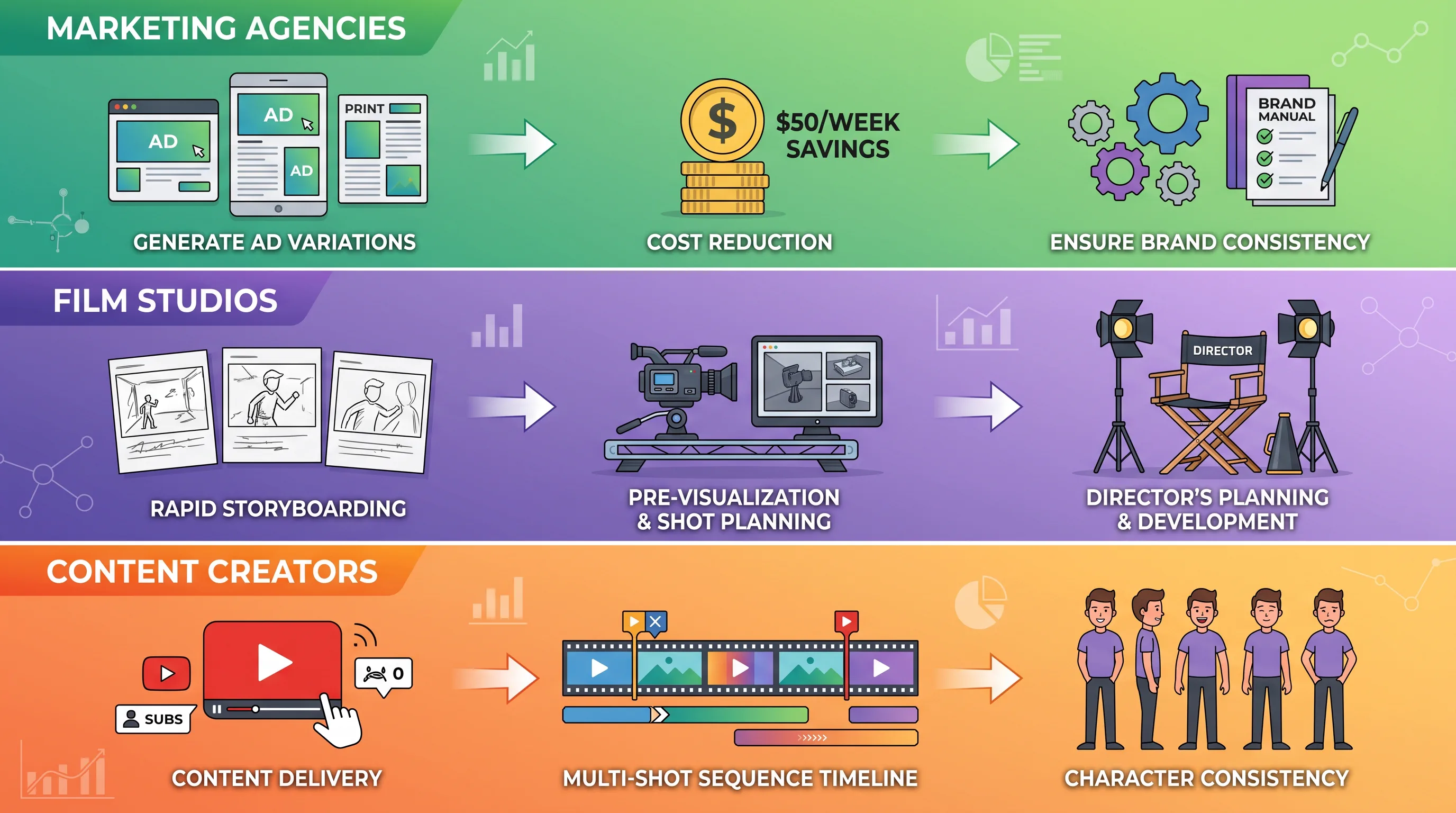

Agenzie marketing: generazione programmatica di varianti pubblicitarie

Un'agenzia che produce 50 varianti di annunci a settimana può automatizzare la generazione grezza con meno di 50 dollari in crediti, lasciando il tempo umano alla strategia e alla revisione finale. Questo rappresenta una riallocazione significativa del budget dalla produzione manuale alla strategia creativa. Il modello senza abbonamento significa che non ci sono fee mensili per postazione, nessun lock-in di piattaforma e nessun minimo di utilizzo. Paghi per generazione, e questo si allinea perfettamente ai workflow del performance marketing. I team che costruiscono sistemi pubblicitari ripetibili di solito affiancano questo approccio a un chiaro riferimento prezzi di Seedance 2 o a un articolo benchmark per i modelli più veloci.

I brand team possono usare il riferimento di soggetto per mantenere coerenti i visual di prodotto su più scene generate. La funzione di editing video-to-video consente di prendere filmati esistenti e applicare nuovi stili o trattamenti stagionali senza dover rigirare, cosa fondamentale per mantenere la coerenza del brand mentre ci si adatta ai cicli di campagna.

Studi cinematografici: pre-visualizzazione e prototipazione rapida

La pre-visualizzazione AI è un tema sempre più ricercato nel mondo della produzione cinematografica, e il set di funzionalità di Wan 2.7 risponde direttamente a questo workflow. I registi possono usare storyboard a griglia 9 per visualizzare sequenze complesse prima di impegnarsi in riprese costose. Il controllo first-and-last-frame consente una pianificazione precisa delle scene, mentre il riferimento del soggetto mantiene la coerenza dei personaggi lungo le sequenze di pre-viz.

La capacità del modello di generare clip fino a 15 secondi con audio nativo lo rende adatto alla pre-visualizzazione di scene complete, non solo a test di singole inquadrature. I team di produzione possono iterare su blocking, movimento camera e ritmo usando movimento e suono reali prima di entrare sul set, riducendo l'esperimento costoso sul set.

Content creator: costruzione narrativa multi-shot

Per YouTuber, educatori e creator narrativi, la funzione continue filming di Wan 2.7 e il supporto alla durata estesa consentono un vero storytelling multi-shot. La combinazione di controllo first-and-last-frame e riferimento del soggetto ti permette di mantenere la coerenza del personaggio lungo un'intera sequenza video, risolvendo un problema che affligge i video AI fin dalla loro nascita.

La capacità di editing basata su istruzioni è particolarmente preziosa per affinare i contenuti in modo iterativo. Invece di rigenerare intere clip quando serve una modifica, puoi applicare cambiamenti mirati con comandi testuali, riducendo in modo drastico tempi di iterazione e costi computazionali.

Integrazione tecnica: accesso API e supporto piattaforme

Wan 2.7 è disponibile tramite più provider API, tra cui Together AI, Segmind e l'accesso diretto attraverso Alibaba Model Studio. L'implementazione su Together AI utilizza l'endpoint Wan-AI/Wan2.7-T2V e supporta chiamate REST standard con payload JSON. L'autenticazione usa header con API key, e il modello gira sull'infrastruttura serverless di Together AI per una distribuzione scalabile.

Le integrazioni di piattaforma stanno crescendo rapidamente. Wan 2.7 è disponibile su Picsart, SeaArt AI, EaseMate AI, WaveSpeedAI e MindStudio, tra gli altri. La libreria modelli di SeaArt AI consente ai creator di accedere a più modelli video AI senza cambiare piattaforma, permettendo confronti diretti tra Wan 2.7, Seedance, Veo e altri modelli all'interno dello stesso workflow.

L'integrazione con MindStudio è particolarmente interessante per l'automazione dei workflow. La piattaforma supporta la creazione di agenti AI che possono monitorare nuove immagini prodotto in una cartella Google Drive, generare video con Wan 2.7, applicare post-produzione (upscaling, face swap, fusione clip, generazione sottotitoli) e consegnare i clip finiti su Slack, tutto senza intervento manuale. Questo livello di integrazione trasforma Wan 2.7 da strumento di generazione a componente della pipeline di produzione.

Pricing e licenze commerciali

Wan 2.7 usa un modello di pricing basato su crediti, senza canoni mensili. I crediti non scadono, un vantaggio significativo rispetto alla maggior parte degli strumenti video AI che azzerano la capacità inutilizzata alla fine di ogni ciclo di fatturazione. L'uso commerciale è incluso in tutti i piani a pagamento, con termini di licenza relativamente permissivi coerenti con l'approccio storico della serie Wan.

Il pricing specifico varia in base al provider della piattaforma, ma la struttura generale favorisce workflow di produzione con pattern di utilizzo variabili. Per chi valuta documentazione ufficiale, API richiamabili e tabelle di prezzo documentate, le offerte video pubblicamente documentate di Alibaba offrono una chiarezza contrattuale in runtime superiore a quella di molti concorrenti.

Configurazione dei parametri e prompt engineering

| Parametro | Intervallo | Raccomandato | Scopo |

|---|---|---|---|

| Durata | 2-15 secondi | 5-8 secondi | Bilancia qualità e tempo di generazione |

| Risoluzione | 720P, 1080P | 1080P per il finale, 720P per i test | Qualità output vs velocità |

| Aspect ratio | 16:9, 4:3, 9:16 | 16:9 per il web, 9:16 per mobile | Ottimizzazione per piattaforma |

| Negative prompt | Stringa di testo | blurry, distorted, watermark | Soppressione artefatti |

| Prompt expansion | Booleano | Abilitato | Interpretazione più ricca dei dettagli |

| Input audio | File opzionale | Usare per sync ritmica | Coerenza audiovisiva |

| Frame anchors | 0-2 immagini | Usare per il controllo scena | Transizioni prevedibili |

Wan 2.7 risponde bene a prompt descrittivi dettagliati, con specifiche su ambientazione, illuminazione, movimento camera e azione. Il modello trae vantaggio da un prompt engineering strutturato che separa descrizione della scena, dettagli dei personaggi, direzione del movimento e preferenze stilistiche in clausole distinte. I negative prompt sopprimono in modo affidabile gli artefatti comuni, anche se non possono salvare immagini di input fondamentalmente scadenti. Se vuoi una struttura di prompt più forte per il lavoro di produzione, la guida ai prompt di Seedance 2 resta utile da cui prendere spunto, perché i principi di linguaggio di camera e blocking della scena si trasferiscono bene.

Limiti e considerazioni

Nonostante il set di funzionalità completo, Wan 2.7 ha alcuni limiti da tenere presenti. Il modello privilegia la qualità rispetto alla velocità, quindi i tempi di generazione sono più lunghi rispetto a concorrenti come Seedance 2.0 o Veo 3.1 Lite. Per workflow di prototipazione rapida che richiedono decine di iterazioni veloci, questo può diventare un collo di bottiglia. L'approccio consigliato è usare modelli più veloci per i test iniziali e riservare Wan 2.7 alle generazioni finali di produzione, dove le sue funzionalità uniche aggiungono valore.

Anche se la coerenza temporale è migliorata moltissimo rispetto a Wan 2.6, non è perfetta. Scene complesse con più elementi in movimento o movimenti rapidi di camera possono ancora mostrare piccoli flicker o problemi di coerenza, anche se molto ridotti rispetto alle versioni precedenti. Il modello rende al meglio con prompt chiari e ben strutturati e con immagini di input di alta qualità. Garbage in, garbage out resta valido.

La funzione a griglia 9, per quanto innovativa, richiede una preparazione attenta delle immagini di input per ottenere risultati ottimali. Input di griglia mal composti o incoerenti possono confondere la comprensione spaziale del modello, portando a output subottimali. Questa funzione funziona meglio quando è integrata in workflow di storyboard strutturati, non in esperimenti estemporanei.

Perché Seedance AI offre il miglior accesso a Wan 2.7

Per creator e team di produzione che vogliono sfruttare le capacità di Wan 2.7, Seedance AI offre il punto di accesso più completo. La piattaforma integra più modelli di generazione video e immagini all'avanguardia in un'unica interfaccia, eliminando la necessità di mantenere account e workflow separati su provider diversi. Questo approccio unificato riduce in modo drastico l'attrito nei workflow multi-modello, un vantaggio critico quando devi confrontare output o usare modelli diversi per fasi diverse della produzione. Se vuoi prima una panoramica diretta del prodotto, puoi anche andare subito alla pagina del modello Wan 2.7 Video.

Seedance AI offre un'esperienza di creazione AI estremamente comoda, tutto in uno. La piattaforma supporta non solo Wan 2.7 ma anche altri modelli frontier come i generatori video proprietari di Seedance, Kling, Veo e i principali sistemi di generazione immagini. Questa ampiezza significa che puoi testare il controllo first-and-last-frame di Wan 2.7 contro la velocità di Seedance 2.0, oppure confrontare la coerenza del riferimento soggetto su più modelli, tutto nello stesso workspace di progetto. Per agenzie e studi che gestiscono esigenze di contenuto diverse, questa flessibilità è preziosa.

L'interfaccia della piattaforma è progettata per workflow di produzione, con funzioni come elaborazione batch, organizzazione dei progetti e strumenti integrati di post-produzione. Puoi generare con Wan 2.7, applicare upscaling o editing ed esportare gli asset finali senza uscire dalla piattaforma. Per i team che valutano se le funzionalità uniche di Wan 2.7 giustifichino l'integrazione nella loro pipeline, Seedance AI offre l'ambiente di test con il minimo attrito disponibile.

Conclusione: il video AI pronto per la produzione è arrivato

Wan 2.7 mantiene la promessa che la categoria text-to-video fa da due anni: qualità vicina alla produzione, accessibile via API e con un pricing che rende la generazione video programmata davvero praticabile per workflow commerciali. Il set completo di funzionalità del modello, controllo first-and-last-frame, composizione a griglia 9, riferimento di soggetto e voce, sincronizzazione audio nativa ed editing basato su istruzioni, rappresenta un cambiamento fondamentale dagli strumenti di generazione sperimentali ai componenti della pipeline di produzione.

Per filmmaker, YouTuber, marketer e creator di agenzia che hanno bisogno di video multi-shot con audio e controllo preciso, il set di funzionalità di Wan 2.7 corrisponde a come funzionano davvero i workflow professionali. Hai uno storyboard, hai un personaggio e hai punti di inizio e fine definiti per ogni scena. Wan 2.7 lavora con questa struttura, non contro di essa. Il modello non è perfetto e non è l'opzione più veloce disponibile, ma è il modello video AI più ricco di funzionalità e più controllabile nel panorama del 2026.

La vera domanda non è se Wan 2.7 sia sopravvalutato. È se il tuo workflow specifico beneficia delle sue funzionalità di controllo uniche. Se produci contenuti che richiedono coerenza dei personaggi tra le inquadrature, transizioni di scena precise, sincronizzazione audiovisiva o editing iterativo senza rigenerazione completa, Wan 2.7 è oggi l'opzione più forte. Per la prototipazione rapida o per scenari in cui la velocità conta più del controllo, alternative come Seedance 2.0 o Veo 3.1 Lite potrebbero essere più adatte. L'approccio intelligente è aggiungere Wan 2.7 al tuo toolkit per i casi in cui le sue capacità portano valore chiaro, mantenendo però accesso a modelli più veloci per l'iterazione.

La generazione video AI è passata da novità sperimentale a strumento di produzione. Wan 2.7 rappresenta lo stato dell'arte attuale nella generazione video controllabile e ricca di funzionalità, e piattaforme come Seedance AI rendono l'accesso e l'integrazione di queste capacità nei workflow reali più pratici che mai.