Chaque conversation de créateurs ce trimestre revient tôt ou tard à un seul modèle : Wan 2.7. Développée par Tongyi Lab d'Alibaba, cette dernière itération est devenue l'article le plus demandé dans l'univers de la génération vidéo IA, non pas à cause du battage médiatique marketing, mais parce qu'elle répond à la frustration la plus persistante des créateurs : maintenir des personnages cohérents, un contrôle précis des scènes et une qualité de production sur plusieurs plans. Après de nombreux tests sur des flux de travail réels, cet avis complet détaille ce que Wan 2.7 Video fournit réellement, là où il excelle et comment il se compare aux modèles concurrents en 2026.

Qu'est-ce que Wan 2.7 et pourquoi est-ce important ?

Wan 2.7 est un modèle de génération vidéo IA de pointe construit sur une architecture Mixture-of-Experts (MoE) de 27 milliards de paramètres. Contrairement à ses prédécesseurs, Wan 2.7 marque un basculement fondamental d'une génération purement texte vers vidéo vers une boîte à outils complète de production vidéo dotée de mécanismes de contrôle structurés. Le modèle génère des vidéos cinématiques HD 1080P à partir de descriptions textuelles, d'images et même d'entrées audio, en combinant fidélité visuelle, synchronisation audio et cohérence des mouvements dans un cadre unifié.

Ce qui distingue Wan 2.7 des versions précédentes et des modèles concurrents n'est pas seulement le nombre de paramètres ou la résolution. La vraie avancée se trouve dans ses capacités d'injection multimodale et dans son ensemble de fonctionnalités orientées production. Là où Wan 2.6 exigeait que les créateurs saisissent un prompt textuel en espérant que l'IA comprenne leur intention, ce qui entraînait souvent des distorsions visuelles et des résultats imprévisibles, Wan 2.7 permet l'injection directe d'images, de vidéos et d'audio pour décoder le mouvement et l'éclairage avec une précision 1:1. L'intention exacte du créateur est ainsi traduite en visuels cinématiques hyperréalistes avec une précision inédite.

La viabilité commerciale du modèle est tout aussi importante. Wan 2.7 fonctionne sur un modèle tarifaire basé sur des crédits, sans abonnement mensuel, sans verrouillage de plateforme, et avec des crédits qui n'expirent jamais. Pour des agences produisant 50 variantes publicitaires par semaine, cela signifie automatiser la génération brute pour moins de 50 $ en crédits tout en réallouant le temps humain à la stratégie et à la validation finale, un changement significatif dans l'économie de production.

Les fonctionnalités clés qui redéfinissent la génération vidéo IA

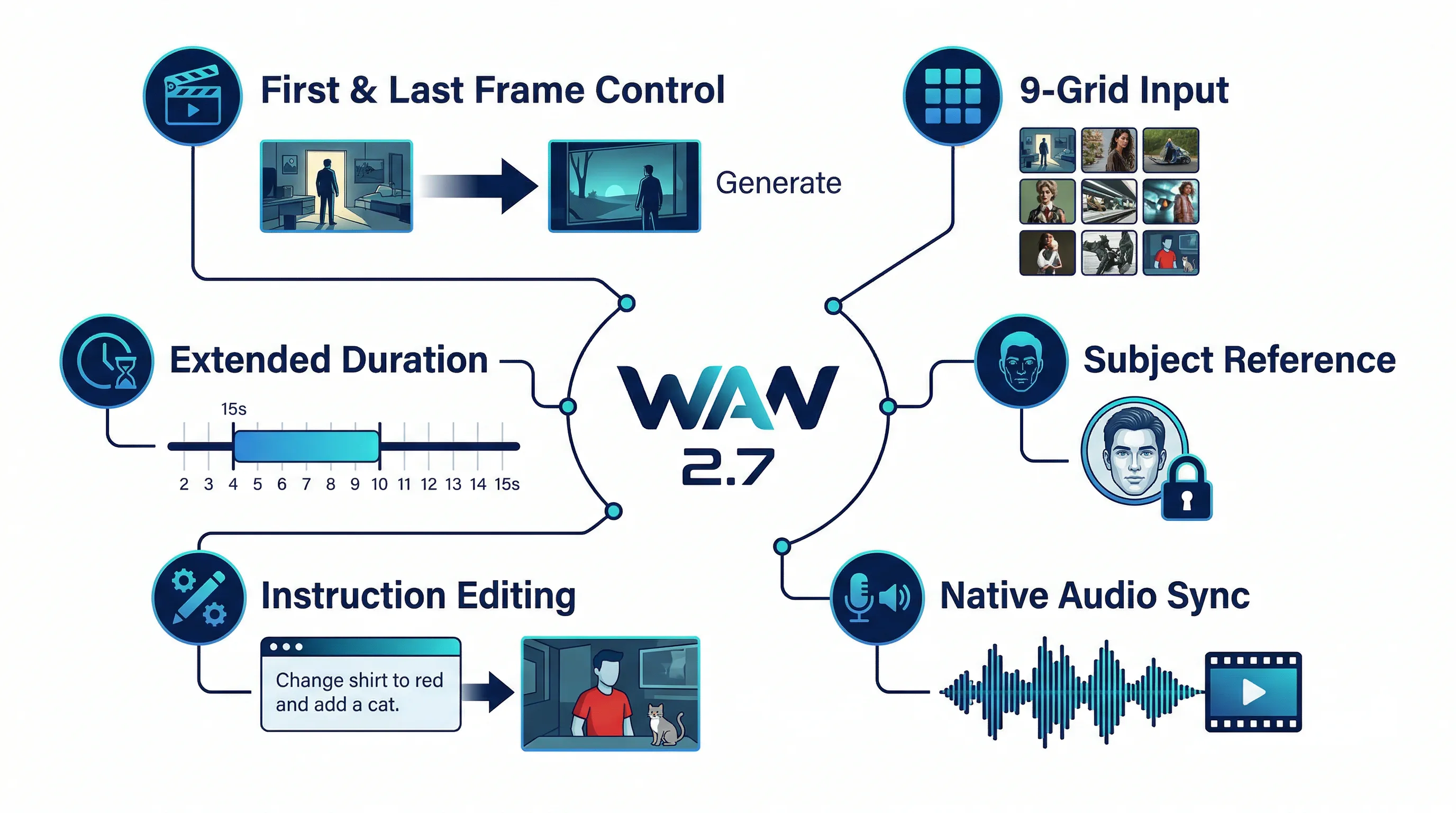

Contrôle de la première et de la dernière image : raconter avec précision

La fonctionnalité la plus commentée de Wan 2.7 est la génération à partir de la première et de la dernière image, une capacité qui change fondamentalement la façon dont les créateurs abordent la production vidéo IA. Au lieu de générer un clip puis d'espérer qu'il se termine là où vous en avez besoin, vous fournissez deux images de référence : ce à quoi la vidéo doit ressembler au début et ce à quoi elle doit ressembler à la fin. Le modèle génère ensuite le mouvement et la transition entre ces deux points d'ancrage, ce qui vous donne une progression narrative prévisible et contrôlable.

Cela résout l'une des frustrations les plus persistantes de la vidéo IA : l'évolution imprévisible d'une scène. Dans Wan 2.1, cette capacité existait comme un checkpoint de modèle séparé (Wan2.1-FLF2V-14B), obligeant les créateurs à basculer entre différentes versions. Dans Wan 2.7, le contrôle de la première et de la dernière image est intégré directement au modèle principal, ce qui supprime les frictions de flux de travail et permet une production multi-plans fluide. Si votre flux de travail commence à partir de plans fixes validés plutôt qu'à partir de simples prompts, cela fait aussi de Wan 2.7 un choix plus naturel pour les pipelines image vers vidéo.

Les applications pratiques sont immédiates. Pour les cinéastes qui élaborent un storyboard, vous pouvez définir la composition exacte aux points d'entrée et de sortie de la scène. Pour les marketeurs qui créent des démonstrations produit, vous contrôlez la position exacte du produit aux moments clés. Pour les enseignants qui produisent du contenu pédagogique, vous garantissez la continuité visuelle entre les séquences d'instruction. Ce niveau de contrôle fait passer la génération vidéo IA d'un outil expérimental à un actif prêt pour la production.

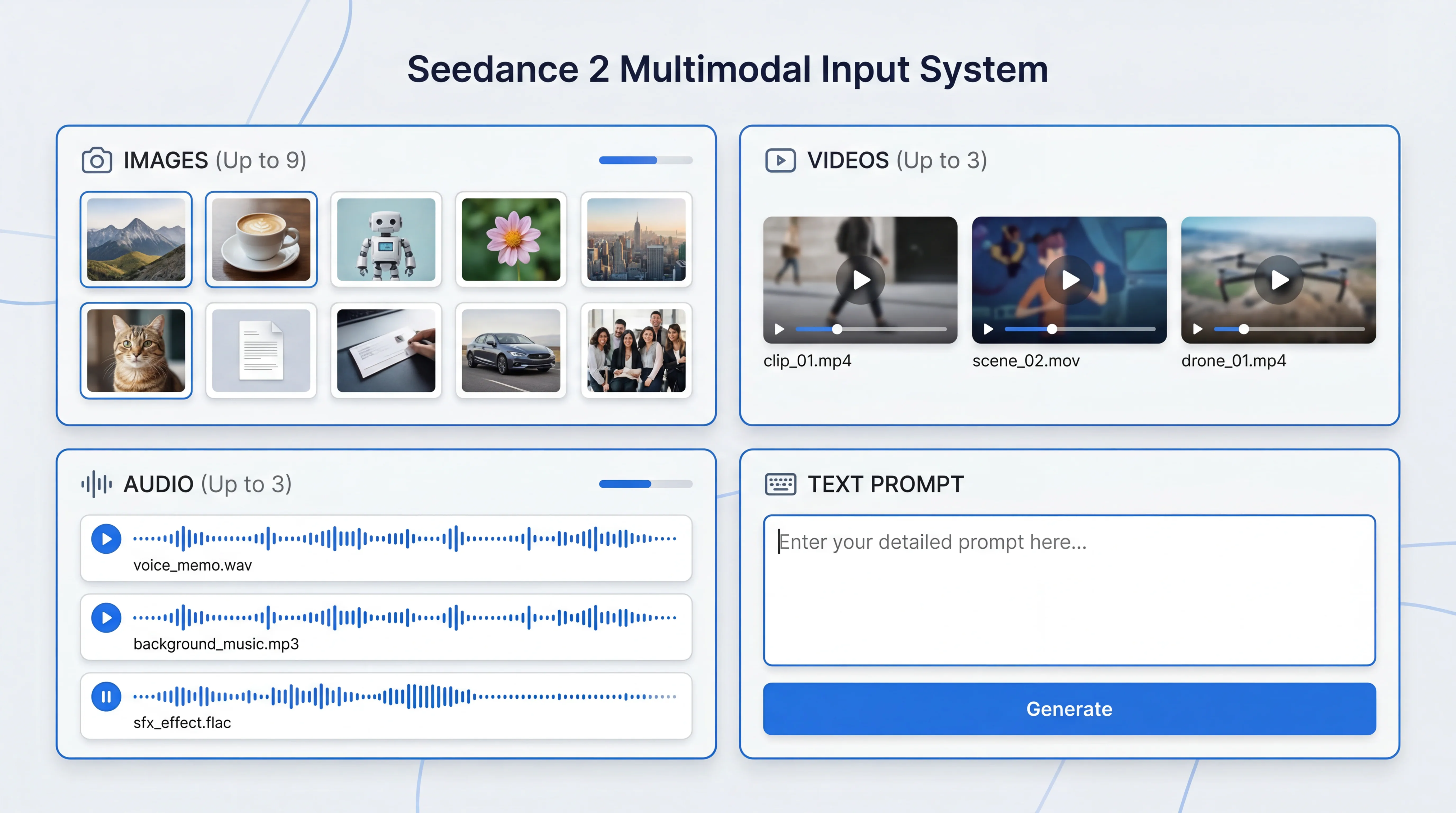

Image vers vidéo en grille 9 : une narration visuelle structurée

Wan 2.7 introduit un système révolutionnaire d'entrée d'images en grille 9 (3x3) pour la génération vidéo. Au lieu d'envoyer une seule image de référence, les créateurs fournissent un panneau de neuf images qui définissent la composition de la scène, les angles des personnages, les conditions d'éclairage et le contexte visuel à travers différents moments ou points de vue. Le modèle synthétise ensuite ces entrées en une séquence animée cohérente qui maintient une cohérence structurelle tout au long du rendu.

Cette fonctionnalité comble l'écart entre la planification statique d'un storyboard et le rendu animé d'une manière qu'aucun modèle Wan précédent n'avait pu atteindre. Par rapport aux méthodes vidéo IA autoregressives traditionnelles, l'approche en grille 9 offre une meilleure cohérence, une vitesse d'inférence plus rapide et une cohérence structurelle supérieure. Pour les équipes de production qui travaillent à partir de storyboards détaillés, cela transforme directement les assets de planification en mouvement, sans le cycle habituel d'itérations par essais et erreurs.

Le système en grille 9 excelle particulièrement dans les scénarios nécessitant des mouvements de caméra complexes ou des interactions entre personnages. En fournissant plusieurs angles de référence, les créateurs peuvent guider la compréhension qu'a le modèle des relations spatiales, de la profondeur et des trajectoires de mouvement, ce qui produit des résultats qui semblent chorégraphiés intentionnellement plutôt que générés au hasard.

Référence du sujet et de la voix : cohérence de l'identité entre les plans

Maintenir la cohérence d'un personnage a longtemps été l'un des défis les plus difficiles de la génération vidéo IA, où les identités avaient tendance à se déformer ou à dériver d'une image à l'autre. Wan 2.7 introduit ce que la documentation appelle « Absolute Identity Lock », un système de référence de sujet qui verrouille parfaitement les traits du visage (niveau des yeux, lignes du menton), les détails vestimentaires et les styles environnementaux à travers des mouvements de caméra complexes.

Vous fournissez une image de référence d'une personne, d'un objet ou d'un personnage, et le modèle maintient cette identité visuelle tout au long des vidéos générées. Cela répond à la principale critique adressée à Wan 2.5 et 2.6 : des personnages qui ne se ressemblaient pas d'une image à l'autre. L'amélioration est immédiatement visible lors des tests, avec nettement moins de changements de garde-robe au milieu d'un clip, de morphing du visage ou de dérive d'identité.

La référence vocale étend cette cohérence à l'audio. Les créateurs peuvent fournir un échantillon de voix, et Wan 2.7 maintiendra cette identité vocale dans les pistes audio générées, ce qui est essentiel pour le contenu de marque, les récits axés sur des personnages ou tout projet nécessitant une cohérence vocale reconnaissable. Wan 2.7 se place ainsi en concurrence directe avec des outils comme Kling et Hailuo, qui proposent depuis un certain temps déjà une génération cohérente de l'identité, mais sans l'intégration fonctionnelle plus large de Wan 2.7.

Synchronisation audio native : un son qui suit le mouvement

Contrairement à la plupart des modèles vidéo IA qui génèrent des clips silencieux nécessitant une couche audio ajoutée manuellement, Wan 2.7 inclut une génération audio native synchronisée directement au contenu visuel. La musique de fond, les sons d'ambiance et les voix des personnages sont générés en synchronisation avec le mouvement de la scène dès le départ, et non ajoutés après coup. Pour quiconque a déjà fait correspondre manuellement de l'audio à une vidéo IA image par image, il s'agit de l'amélioration la plus immédiatement utile de tout l'ensemble de fonctionnalités.

Le modèle prend en charge une entrée audio optionnelle, permettant aux créateurs de fournir un audio de référence qui influence à la fois la génération visuelle et le rendu synchronisé. Cette approche multimodale signifie que vous pouvez envoyer une piste musicale et voir le rythme, les coupes et la dynamique du mouvement de la vidéo répondre au tempo et au ton émotionnel de l'audio, créant ainsi une cohérence audio-visuelle qui n'était auparavant possible qu'avec un lourd travail de post-production.

Montage vidéo basé sur des instructions : des modifications guidées par le texte

L'une des fonctionnalités les plus innovantes de Wan 2.7 est le montage vidéo basé sur des instructions, c'est-à-dire la possibilité de modifier des vidéos existantes à l'aide de simples commandes textuelles, sans régénérer depuis zéro. Au lieu de repartir de zéro lorsque vous avez besoin d'ajustements, vous pouvez taper des commandes comme « remplacer l'arrière-plan », « déplacer l'éclairage vers l'heure dorée » ou « recolorer la tenue en bleu », et demander au modèle d'appliquer ces modifications tout en conservant tous les autres éléments.

Cette capacité de montage vidéo vers vidéo réduit la complexité des données d'entrée et la charge de calcul, tout en offrant des résultats plus rapides qu'une régénération complète. Pour les flux de travail créatifs itératifs, c'est transformateur. Vous pouvez affiner les résultats par des ajustements ciblés plutôt que de tout rejouer à chaque génération. La fonctionnalité est particulièrement précieuse pour les agences qui appliquent des traitements saisonniers à des images existantes ou pour les équipes de marque qui maintiennent la cohérence visuelle d'un produit sur plusieurs scènes sans refaire les prises.

Durée étendue et reprise du tournage : dépasser la limite des fragments

L'une des plus grandes contraintes des modèles vidéo de première génération était la durée narrative, généralement limitée à des segments de plan unique de 3 à 4 secondes. Wan 2.7 y répond grâce à sa fonction de reprise du tournage, un système d'extension intelligent qui permet d'étendre à l'infini des matériaux vidéo existants. Le modèle prend en charge des durées de sortie de 2 à 15 secondes en une seule génération, ce qui en fait la seule option, parmi les principaux concurrents, pour des clips de plus de 10 secondes.

Cette capacité de durée étendue, combinée au contrôle de la première et de la dernière image, permet une véritable construction narrative multi-plans. Les créateurs peuvent enchaîner des séquences avec des transitions prévisibles, en créant des contenus plus longs qui conservent leur cohérence visuelle et stylistique tout au long du rendu, une exigence critique pour les flux de travail de contenu professionnel.

Spécifications techniques et qualité de sortie

Wan 2.7 génère des vidéos en résolution native 1080P HD, avec aussi une option 720P pour un traitement plus rapide. Le modèle sort en 24 images par seconde, ce qui correspond au standard cinéma pour un mouvement de qualité professionnelle. Les temps de génération varient selon la durée et la résolution, mais l'architecture du modèle privilégie la qualité à la vitesse, un arbitrage assumé qui le positionne comme un outil de production plutôt que comme un système de prototypage rapide.

La qualité visuelle du modèle représente une nette amélioration par rapport à Wan 2.6 sur plusieurs dimensions. La cohérence stylistique est sensiblement plus forte. Le modèle maintient plus fiablement le réalisme cinématographique, les esthétiques anime et les styles illustrés d'une image à l'autre, ce qui est essentiel pour le contenu nécessitant une identité visuelle reconnaissable tout au long de la séquence. La cohérence temporelle s'est considérablement améliorée, avec moins de visages qui clignotent, moins de changements de tenue au milieu d'un clip et moins de cas où les sujets se déforment légèrement entre les coupes.

La dynamique du mouvement montre une finesse particulière. Un test de battement d'ailes sur un aigle en vol a donné un rendu propre de la profondeur de champ et un mouvement naturel sans les artefacts saccadés courants dans les modèles antérieurs. Les panoramiques de paysages affichent un mouvement fluide des nuages et une profondeur atmosphérique, le modèle gérant efficacement les prompts négatifs pour supprimer des artefacts comme le flou, la distorsion et les filigranes.

Comment Wan 2.7 se compare aux modèles concurrents

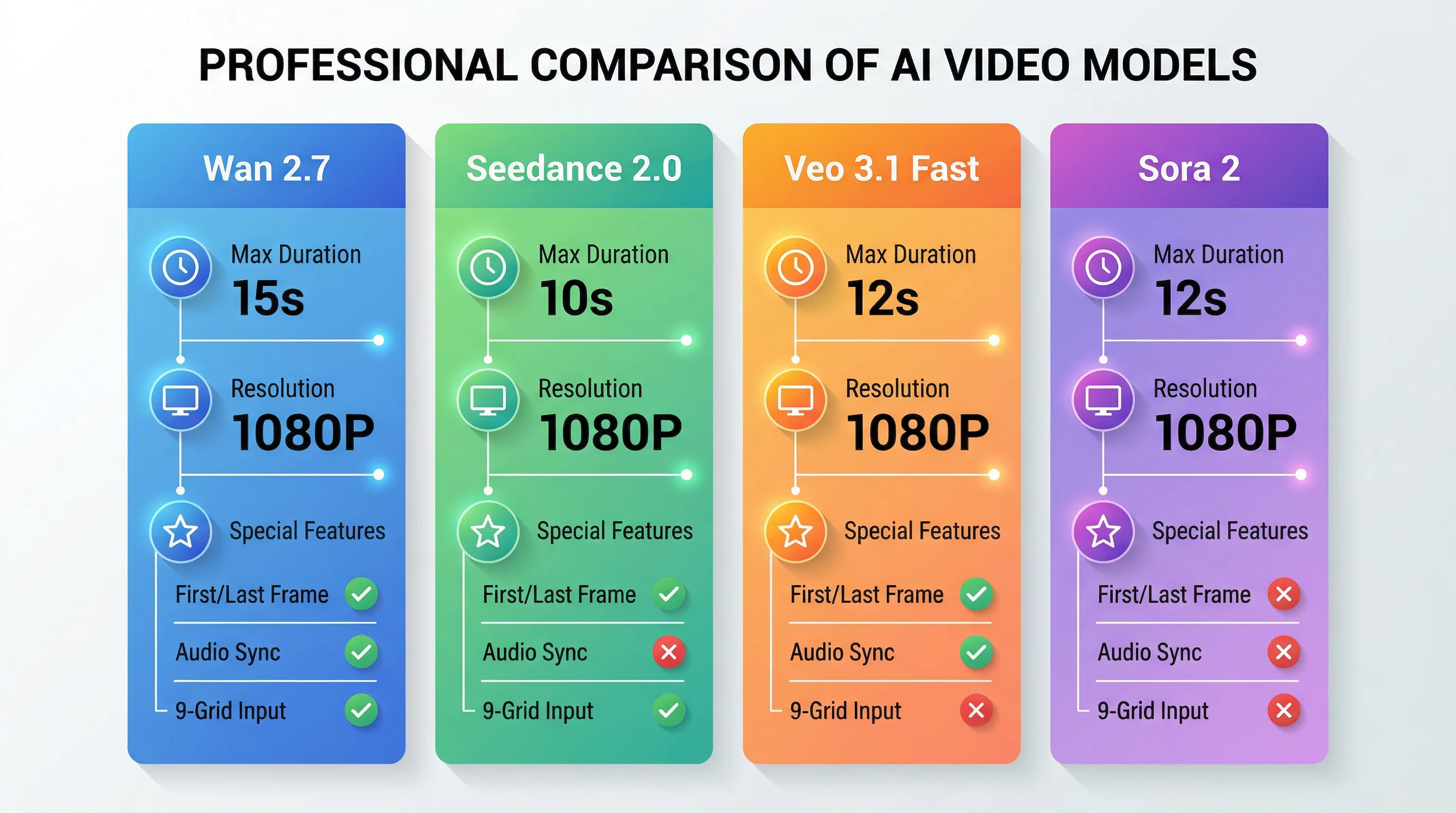

Wan 2.7 vs Seedance 2.0 : fonctionnalités contre valeur

Le Seedance 2.0 de ByteDance offre le meilleur rapport qualité-prix pour un mouvement de haute qualité au coût par seconde le plus faible du marché actuel. Cependant, Wan 2.7 est le couteau suisse de la comparaison, offrant le plus de fonctionnalités, la plus grande flexibilité et la meilleure adéquation aux flux de travail nécessitant une synchronisation d'entrée audio ou un contrôle image par image.

Seedance 2.0 plafonne à des clips de 10 secondes et ne dispose ni du contrôle de la première et de la dernière image ni des fonctions d'entrée audio. Il interprète les prompts avec un peu plus de liberté créative, ce qui peut être un avantage ou une gêne selon les besoins du projet. Seedance est généralement plus rapide pour la génération via API, ce qui en fait un choix idéal pour l'itération rapide et les tests. L'approche intelligente adoptée par de nombreuses équipes de production consiste à utiliser Seedance 2.0 pour l'itération et les tests, puis à générer la sortie finale avec Wan 2.7 lorsque des contrôles créatifs uniques sont nécessaires. Pour approfondir les arbitrages de production, consultez l'avis Seedance 2 dédié ainsi que l'ancienne comparaison Seedance 2 vs Wan 2.6.

Wan 2.7 vs Veo 3.1 : contrôle contre physique

Le Veo 3.1 Fast de Google domine en réalisme physique et est le seul modèle de la comparaison à proposer à la fois un audio généré automatiquement et des clips de 12 secondes pour 0,10 $ par seconde. Veo 3.1 produit des rendus de qualité cinéma à 24fps avec une génération audio native incluant sons ambiants, dialogues et musique, le tout synchronisé avec les visuels. Cependant, Veo 3.1 Lite plafonne à 8 secondes et ne dispose pas des fonctions de contrôle granulaire qui définissent Wan 2.7.

Là où Wan 2.7 excelle, c'est dans le contrôle précis de la construction des scènes grâce aux ancrages de première et dernière image, à la composition en grille 9 et au montage basé sur des instructions. Veo 3.1 privilégie la simulation physique réaliste et le mouvement naturel, ce qui le rend idéal dans les scénarios où le réalisme prime sur le contrôle. Le choix entre les deux dépend donc de savoir si votre flux de travail valorise la directabilité (Wan 2.7) ou la physique naturaliste (Veo 3.1). Pour le détail complet, l'avis indépendant sur Veo 3.1 couvre plus en profondeur l'aspect physique et audio.

Wan 2.7 vs Sora 2 : outil de production contre plateforme expérimentale

Le Sora 2 d'OpenAI domine en réalisme physique et propose des clips de 12 secondes avec audio généré automatiquement. Cependant, Sora reste plus expérimental dans son positionnement, avec moins d'accent sur l'intégration aux workflows de production. L'ensemble de fonctionnalités de Wan 2.7, notamment le contrôle première/dernière image, l'entrée en grille 9 et le montage basé sur des instructions, est explicitement conçu pour correspondre à la façon dont les flux de travail de contenu professionnels fonctionnent réellement : vous avez un storyboard, vous avez un personnage, et vous avez des points de départ et d'arrivée définis pour chaque scène. Wan 2.7 s'adapte à cette structure au lieu de la contrarier. Si vous comparez les modèles de pointe de toute la catégorie, la comparaison plus large des modèles vidéo IA constitue un bon complément.

Tableau comparatif des modèles

| Fonctionnalité | Wan 2.7 | Seedance 2.0 | Veo 3.1 Fast | Sora 2 |

|---|---|---|---|---|

| Durée max | 15 secondes | 10 secondes | 12 secondes | 12 secondes |

| Résolution max | 1080P | 1080P | 1080P | 1080P |

| Contrôle de la première/dernière image | ✓ | ✗ | ✗ | ✗ |

| Synchronisation de l'entrée audio | ✓ | ✗ | ✗ | ✗ |

| Génération audio native | ✓ | ✗ | ✓ | ✓ |

| Entrée image en grille 9 | ✓ | ✗ | ✗ | ✗ |

| Montage basé sur des instructions | ✓ | ✗ | ✗ | ✗ |

| Référence du sujet | ✓ | ✓ | ✓ | ✓ |

| Prompts négatifs | ✓ | Limité | ✗ | ✗ |

| Modèle tarifaire | Crédits (sans expiration) | Par génération | Par génération | Abonnement |

| Utilisation commerciale | Tous les niveaux | Tous les niveaux | Tous les niveaux | Variable |

Cas d'usage réels et intégration dans les workflows

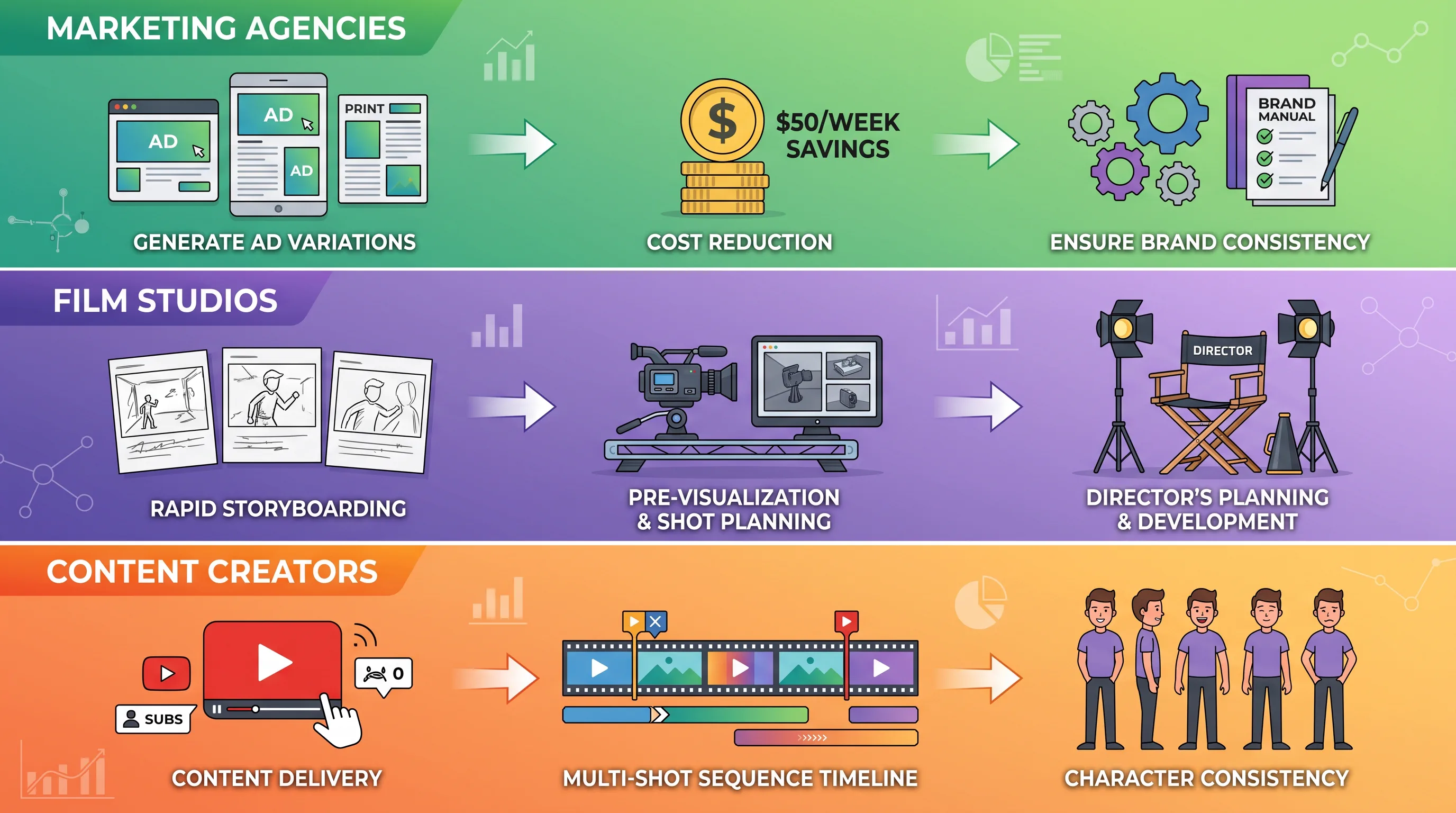

Agences marketing : génération programmatique de variantes publicitaires

Une agence produisant 50 variantes publicitaires par semaine peut automatiser l'étape de génération brute pour moins de 50 $ en crédits, tout en réservant le temps humain à la stratégie et à la validation finale. Cela représente une réallocation significative du budget, de la production manuelle vers la stratégie créative. Le modèle sans abonnement signifie qu'il n'y a ni frais mensuels par siège, ni verrouillage de plateforme, ni minimum d'utilisation. Vous payez par génération, ce qui s'aligne parfaitement avec les workflows de marketing à la performance. Les équipes qui construisent des systèmes publicitaires répétables associent généralement cela à une référence tarifaire Seedance 2 claire ou à un article de benchmark pour accélérer l'itération sur les modèles plus rapides.

Les équipes de marque peuvent utiliser la référence de sujet pour garder des visuels produit cohérents sur plusieurs scènes générées. La fonction de montage vidéo permet de prendre des images existantes et d'appliquer de nouveaux styles ou traitements saisonniers sans refaire les prises, ce qui est essentiel pour maintenir la cohérence de marque tout en s'adaptant aux cycles de campagne.

Studios de cinéma : prévisualisation et prototypage rapide

La prévisualisation assistée par IA est un sujet de recherche croissant dans la production cinématographique, et l'ensemble de fonctionnalités de Wan 2.7 répond directement à ce flux de travail. Les réalisateurs peuvent utiliser des storyboards en grille 9 pour visualiser des séquences complexes avant de s'engager dans des prises coûteuses. Le contrôle de la première et de la dernière image permet une planification précise de la scène, tandis que la référence de sujet maintient la cohérence des personnages sur les séquences de prévisualisation.

La capacité du modèle à générer des clips jusqu'à 15 secondes avec audio natif le rend viable pour une vraie prévisualisation de scène, et pas seulement pour des tests de plans isolés. Les équipes de production peuvent itérer sur le cadrage, les mouvements de caméra et le rythme avec du mouvement et du son réels avant d'entrer sur le plateau, ce qui réduit les expérimentations coûteuses sur place.

Créateurs de contenu : construction narrative multi-plans

Pour les YouTubeurs, les enseignants et les créateurs de contenu narratif, la fonction de reprise du tournage de Wan 2.7 et sa prise en charge de durées étendues permettent une véritable narration multi-plans. La combinaison du contrôle première/dernière image et de la référence de sujet signifie que vous pouvez maintenir la cohérence d'un personnage sur toute une séquence vidéo, ce qui résout un problème qui accompagne la vidéo IA depuis ses débuts.

La capacité de montage basée sur des instructions est particulièrement utile pour affiner le contenu de manière itérative. Au lieu de régénérer des clips entiers lorsque vous devez faire des ajustements, vous pouvez appliquer des modifications ciblées par commandes textuelles, réduisant drastiquement le temps d'itération et les coûts de calcul.

Intégration technique : accès API et support des plateformes

Wan 2.7 est disponible via plusieurs fournisseurs d'API, notamment Together AI, Segmind et l'accès direct via Model Studio d'Alibaba. L'implémentation Together AI utilise le point de terminaison Wan-AI/Wan2.7-T2V et prend en charge des appels API REST standards avec des charges JSON. L'authentification utilise des en-têtes de clé API, et le modèle s'exécute sur l'infrastructure serverless de Together AI pour un déploiement évolutif.

Les intégrations de plateformes se multiplient rapidement. Wan 2.7 est disponible en direct sur Picsart, SeaArt AI, EaseMate AI, WaveSpeedAI et MindStudio, entre autres. La bibliothèque de modèles de SeaArt AI permet aux créateurs d'accéder à plusieurs modèles vidéo IA sans changer de plateforme, ce qui facilite les comparaisons directes entre Wan 2.7, Seedance, Veo et d'autres modèles au sein d'un seul flux de travail.

L'intégration de MindStudio est particulièrement notable pour l'automatisation des workflows. La plateforme permet de créer des agents IA capables de surveiller de nouvelles images produit dans un dossier Google Drive, de générer des vidéos avec Wan 2.7, d'appliquer un post-traitement (upscaling, face swap, fusion de clips, génération de sous-titres) et de livrer les clips finalisés à Slack, le tout sans intervention manuelle. Ce niveau d'intégration transforme Wan 2.7 d'un simple outil de génération en composant d'un pipeline de production.

Tarifs et licences commerciales

Wan 2.7 fonctionne sur un modèle tarifaire basé sur des crédits, sans abonnement mensuel. Les crédits n'expirent pas, ce qui constitue un avantage important par rapport à la plupart des outils vidéo IA qui réinitialisent la capacité inutilisée à la fin de chaque cycle de facturation. L'utilisation commerciale est incluse dans tous les niveaux payants, avec des conditions de licence relativement permissives, cohérentes avec l'approche historique de la série Wan.

Les tarifs précis varient selon le fournisseur de plateforme, mais la structure générale favorise les workflows de production à usage variable. Pour les acheteurs techniques qui évaluent la documentation officielle, les API appelables et les grilles tarifaires documentées, les offres vidéo publiquement documentées d'Alibaba apportent une clarté contractuelle en exécution plus forte que celle de nombreux concurrents.

Configuration des paramètres et ingénierie des prompts

| Paramètre | Plage | Recommandé | Objectif |

|---|---|---|---|

| Durée | 2-15 secondes | 5-8 secondes | Équilibrer qualité et temps de génération |

| Résolution | 720P, 1080P | 1080P pour le final, 720P pour les tests | Qualité de sortie vs vitesse |

| Rapport d'aspect | 16:9, 4:3, 9:16 | 16:9 pour le web, 9:16 pour mobile | Optimisation de plateforme |

| Prompt négatif | Chaîne de texte | blurry, distorted, watermark | Suppression des artefacts |

| Expansion de prompt | Booléen | Activée | Interprétation enrichie des détails |

| Entrée audio | Fichier optionnel | À utiliser pour la synchronisation rythmique | Cohérence audio-visuelle |

| Ancrages d'image | 0-2 images | À utiliser pour le contrôle de scène | Transitions prévisibles |

Wan 2.7 répond bien aux prompts descriptifs détaillés qui précisent le décor, l'éclairage, les mouvements de caméra et l'action. Le modèle bénéficie d'une ingénierie des prompts structurée qui sépare la description de la scène, les détails du personnage, la direction du mouvement et les préférences stylistiques en clauses distinctes. Les prompts négatifs suppriment de manière fiable les artefacts courants, même s'ils ne sauveront pas des images d'entrée fondamentalement mauvaises. Si vous souhaitez une structure de prompt plus robuste pour un travail de production, le guide de prompts Seedance 2 mérite toujours d'être repris, car les principes de langage caméra et de découpage des scènes s'y transfèrent très bien.

Limites et points de vigilance

Malgré son ensemble de fonctionnalités très complet, Wan 2.7 a des limites qu'il faut noter. Le modèle privilégie la qualité à la vitesse, ce qui entraîne des temps de génération plus longs que ceux de concurrents comme Seedance 2.0 ou Veo 3.1 Lite. Pour les workflows de prototypage rapide nécessitant des dizaines d'itérations courtes, cela peut devenir un goulot d'étranglement. L'approche recommandée consiste à utiliser des modèles plus rapides pour les premiers tests et à réserver Wan 2.7 aux générations finales de production, lorsque ses fonctionnalités uniques apportent réellement de la valeur.

Même si la cohérence temporelle s'est nettement améliorée par rapport à Wan 2.6, elle n'est pas parfaite. Les scènes complexes avec plusieurs éléments en mouvement ou des mouvements de caméra rapides peuvent encore présenter de légers scintillements ou des problèmes de cohérence, bien que ceux-ci soient bien réduits par rapport aux versions antérieures. Le modèle fonctionne au mieux avec des prompts clairs, bien structurés, et des images d'entrée de haute qualité. Garbage in, garbage out s'applique toujours.

La fonction grille 9, bien qu'innovante, demande une préparation soigneuse des images d'entrée pour obtenir des résultats optimaux. Des entrées de grille mal composées ou incohérentes peuvent brouiller la compréhension spatiale du modèle et conduire à des résultats sous-optimaux. Cette fonctionnalité fonctionne mieux lorsqu'elle est intégrée à des workflows de storyboard structurés plutôt qu'à des expérimentations ad hoc.

Pourquoi Seedance AI offre le meilleur accès à Wan 2.7

Pour les créateurs et les équipes de production qui souhaitent exploiter les capacités de Wan 2.7, Seedance AI offre le point d'accès le plus complet. La plateforme intègre plusieurs modèles vidéo et image de pointe dans une seule interface, ce qui évite d'avoir à gérer des comptes et des workflows séparés chez différents fournisseurs. Cette approche unifiée réduit considérablement les frictions dans les workflows multi-modèles, un avantage crucial lorsque vous devez comparer des résultats ou utiliser différents modèles à différentes étapes de la production. Si vous voulez d'abord une vue produit directe, vous pouvez aussi aller directement à la page du modèle Wan 2.7 Video.

Seedance AI propose une expérience de création IA tout-en-un particulièrement pratique. La plateforme prend en charge non seulement Wan 2.7, mais aussi d'autres modèles de pointe comme les générateurs vidéo de Seedance, Kling, Veo et des systèmes de génération d'images de premier plan. Cette largeur d'offre signifie que vous pouvez tester le contrôle première/dernière image de Wan 2.7 face à la vitesse de Seedance 2.0, ou comparer la cohérence de la référence de sujet entre plusieurs modèles, le tout dans le même espace de projet. Pour les agences et les studios qui gèrent des besoins de contenu diversifiés, cette flexibilité est inestimable.

L'interface de la plateforme est conçue pour les workflows de production, avec des fonctions comme le traitement par lots, l'organisation des projets et des outils de post-traitement intégrés. Vous pouvez générer avec Wan 2.7, appliquer un upscaling ou des modifications, puis exporter les actifs finaux sans quitter la plateforme. Pour les équipes qui évaluent si les fonctionnalités uniques de Wan 2.7 justifient son intégration dans leur pipeline, Seedance AI fournit l'environnement de test le moins contraignant disponible.

Conclusion : la vidéo IA prête pour la production est arrivée

Wan 2.7 tient ce que la catégorie texte vers vidéo promet depuis deux ans : une qualité proche de la production via des API accessibles, à des tarifs qui rendent la génération vidéo programmatique réellement viable pour des workflows commerciaux. L'ensemble complet de fonctionnalités du modèle, contrôle de la première et de la dernière image, composition en grille 9, référence du sujet et de la voix, synchronisation audio native et montage basé sur des instructions, représente un basculement fondamental d'outils de génération expérimentaux vers des composants de pipeline de production.

Pour les cinéastes, YouTubeurs, marketeurs et créateurs en agence qui ont besoin de vidéos multi-plans avec audio et contrôle précis, l'ensemble de fonctionnalités de Wan 2.7 correspond à la manière dont les workflows de contenu professionnels fonctionnent réellement. Vous avez un storyboard, vous avez un personnage, et vous avez des points de départ et d'arrivée définis pour chaque scène. Wan 2.7 travaille avec cette structure plutôt que contre elle. Le modèle n'est pas parfait, et ce n'est pas l'option la plus rapide disponible, mais c'est le modèle vidéo IA le plus riche en fonctionnalités et le plus contrôlable du paysage 2026.

La vraie question n'est pas de savoir si Wan 2.7 est surestimé. C'est de savoir si votre workflow spécifique profite de ses fonctions de contrôle uniques. Si vous produisez du contenu qui exige une cohérence des personnages entre les plans, des transitions de scène précises, une synchronisation audio-visuelle ou un montage itératif sans régénération complète, Wan 2.7 est l'option la plus solide actuellement disponible. Pour le prototypage rapide ou les scénarios où la vitesse prime sur le contrôle, des alternatives comme Seedance 2.0 ou Veo 3.1 Lite peuvent être plus appropriées. L'approche intelligente consiste à ajouter Wan 2.7 à votre boîte à outils pour les cas d'usage où ses capacités apportent une valeur claire, tout en conservant l'accès à des modèles plus rapides pour l'itération.

La génération vidéo IA est passée de la nouveauté expérimentale à l'outil de production. Wan 2.7 représente l'état de l'art actuel en matière de génération vidéo contrôlable et riche en fonctionnalités, et des plateformes comme Seedance AI rendent l'accès à ces capacités et leur intégration dans de vrais workflows plus pratiques que jamais.