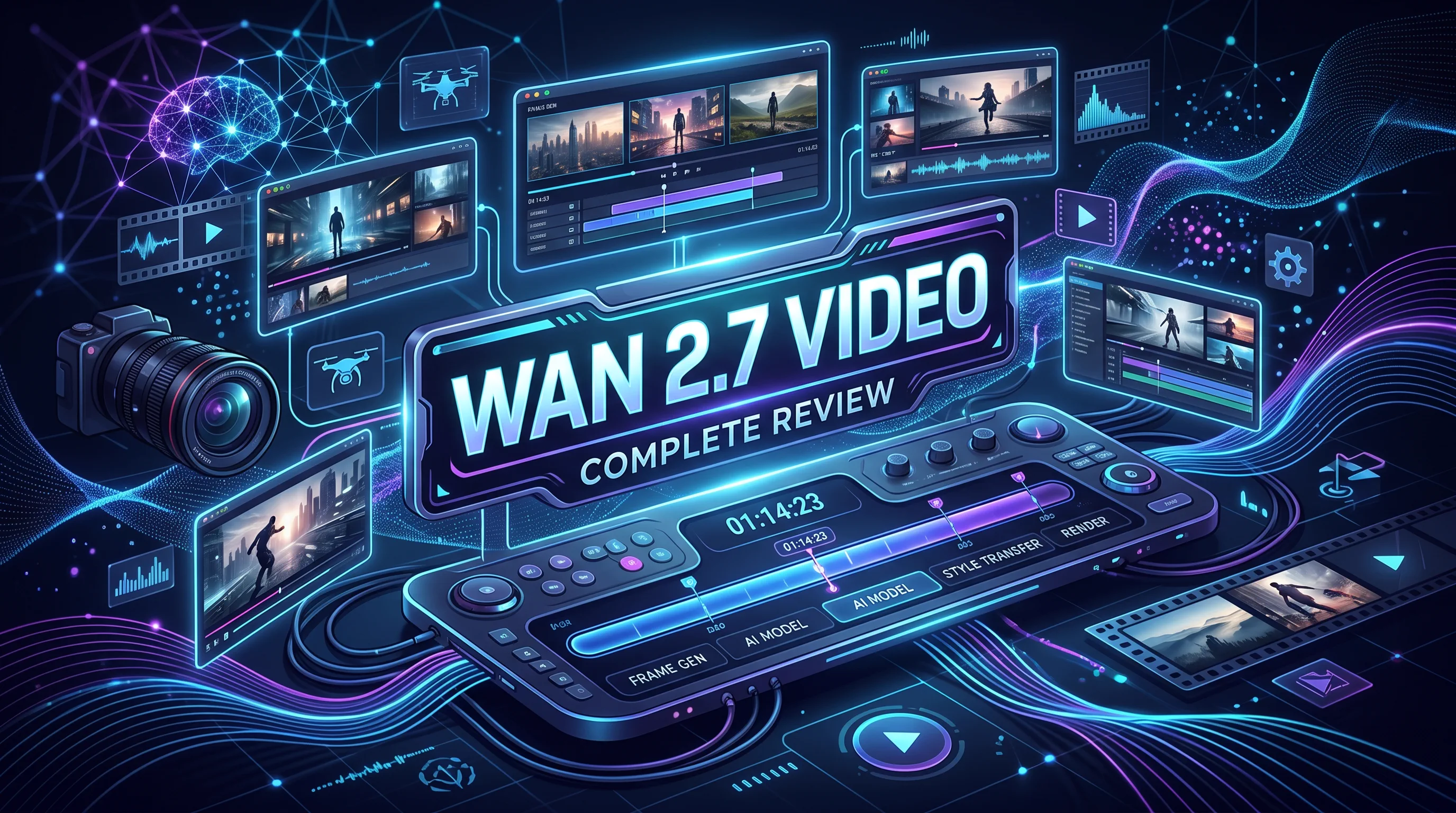

Cada conversación entre creadores de esta temporada acaba volviendo a un modelo: Wan 2.7. Desarrollado por Tongyi Lab de Alibaba, esta última iteración se ha convertido en el análisis más solicitado dentro del espacio de generación de video con IA, no por ruido de marketing, sino porque aborda la frustración más persistente de los creadores: mantener personajes consistentes, controlar con precisión las escenas y obtener resultados de calidad de producción a lo largo de varias tomas. Después de probarlo a fondo en flujos de trabajo reales, esta reseña completa desglosa qué entrega realmente Wan 2.7 Video, en qué destaca y cómo se compara con otros modelos en 2026.

¿Qué es Wan 2.7 y por qué importa?

Wan 2.7 es un modelo de generación de video con IA de última generación, construido sobre una arquitectura Mixture-of-Experts (MoE) de 27 mil millones de parámetros. A diferencia de sus predecesores, Wan 2.7 representa un cambio fundamental: pasa de la generación puramente texto a video a un conjunto de herramientas de producción de video con mecanismos de control estructurados. El modelo genera videos cinematográficos en 1080P HD a partir de descripciones de texto, imágenes e incluso entradas de audio, combinando fidelidad visual, sincronización de audio y consistencia de movimiento en un marco unificado.

Lo que diferencia a Wan 2.7 de versiones anteriores y de los modelos competidores no es solo el número de parámetros o la resolución. El verdadero salto está en sus capacidades de inyección multimodal y en un conjunto de funciones orientadas a producción. Mientras Wan 2.6 obligaba a los creadores a escribir una indicación y esperar que la IA entendiera la intención, con resultados que a menudo acababan en distorsión visual y salidas impredecibles, Wan 2.7 permite inyectar directamente imágenes, videos y audio para decodificar movimiento e iluminación con precisión 1:1. Eso traduce la intención exacta del creador en visuales cinematográficos hiperrealistas con una precisión sin precedentes.

La viabilidad comercial del modelo es igual de importante. Wan 2.7 funciona con un modelo de precios basado en créditos, sin cuotas mensuales, sin dependencia de plataforma y con créditos que no caducan. Para agencias que producen 50 variantes publicitarias por semana, esto significa automatizar la generación base con menos de $50 en créditos mientras se reasigna el tiempo humano a estrategia y revisión final, un cambio significativo en la economía de producción.

Características centrales que redefinen la generación de video con IA

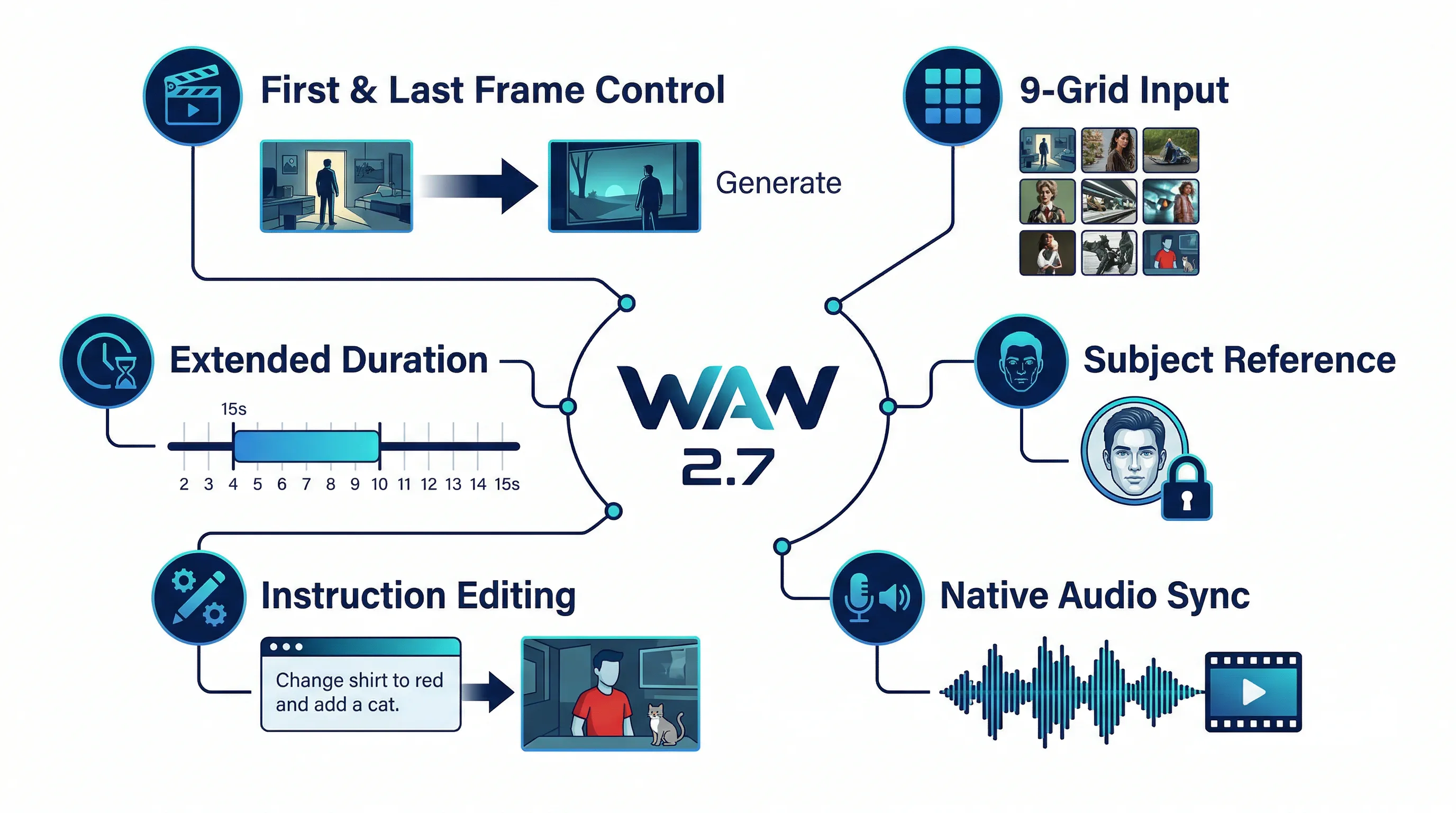

Control de primer y último fotograma: narración precisa

La función más comentada de Wan 2.7 es la generación de primer y último fotograma, una capacidad que cambia de forma radical la manera en que los creadores abordan la producción de video con IA. En lugar de generar un clip y esperar que termine donde lo necesitas, aportas dos imágenes de referencia: cómo debe verse el video al inicio y cómo debe verse al final. El modelo genera entonces el movimiento y la transición entre esos dos anclajes, dándote una progresión narrativa predecible y controlable.

Esto resuelve una de las frustraciones más persistentes del video con IA: la evolución impredecible de la escena. En Wan 2.1, esta capacidad existía como un punto de control separado (Wan2.1-FLF2V-14B), lo que obligaba a los creadores a cambiar entre distintas versiones. En Wan 2.7, el control de primer y último fotograma está integrado directamente en el modelo principal, eliminando fricciones en el flujo de trabajo y permitiendo una producción fluida de varias tomas. Si tu flujo parte de imágenes aprobadas en lugar de indicaciones puras, esto también hace que Wan 2.7 encaje mejor en flujos de imagen a video.

Las aplicaciones prácticas son inmediatas. Para cineastas que planifican una secuencia, puedes definir la composición exacta en los puntos de entrada y salida de la escena. Para equipos de marketing que crean demos de producto, puedes controlar la posición exacta del producto en momentos clave. Para educadores que producen contenido tutorial, puedes asegurar continuidad visual entre segmentos instructivos. Este nivel de control convierte la generación de video con IA de una herramienta experimental en un activo listo para producción.

Imagen a video en 9 cuadrículas: narración visual estructurada

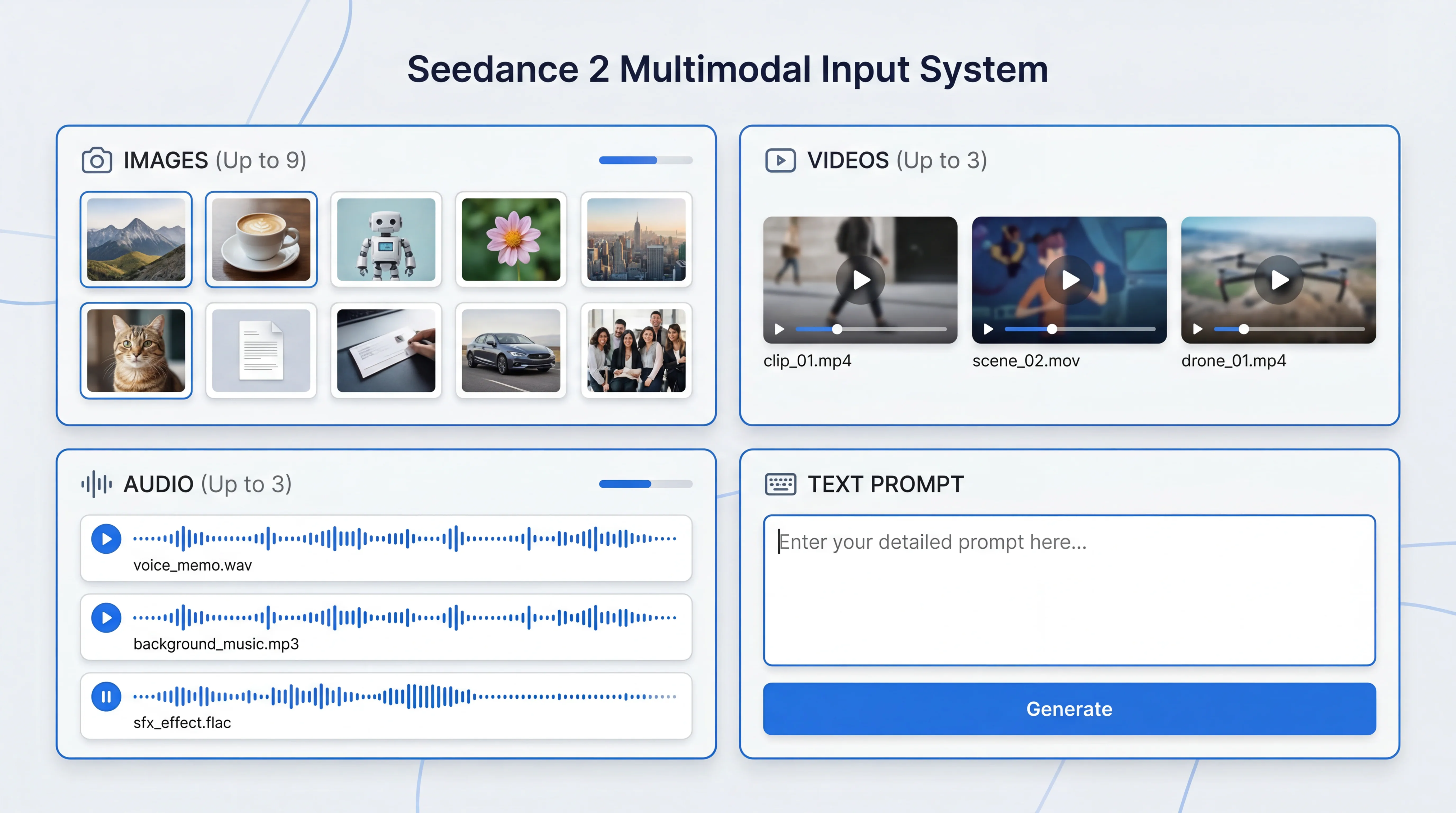

Wan 2.7 introduce un sistema revolucionario de entrada de imágenes en 9 cuadrículas (3x3) para la generación de video. En lugar de alimentar una sola imagen de referencia, los creadores aportan un tablero de nueve imágenes que definen la composición de la escena, los ángulos de los personajes, las condiciones de iluminación y el contexto visual a lo largo de distintos momentos o perspectivas. Después, el modelo sintetiza esas entradas en una secuencia animada cohesiva que mantiene la consistencia estructural en todo momento.

Esta función conecta la planificación estática del guion gráfico con la salida animada de una forma que ningún modelo Wan anterior había conseguido. En comparación con los métodos autoregresivos tradicionales de video con IA, el enfoque de 9 cuadrículas ofrece mayor consistencia, una inferencia más rápida y una mejor coherencia estructural. Para equipos de producción que trabajan con guiones gráficos detallados, esto convierte los recursos de planificación directamente en movimiento, sin el ciclo habitual de prueba y error.

El sistema de 9 cuadrículas destaca especialmente en escenarios que requieren movimientos de cámara complejos o interacciones entre personajes. Al proporcionar múltiples ángulos de referencia, los creadores pueden guiar la comprensión del modelo sobre las relaciones espaciales, la profundidad y las trayectorias de movimiento, logrando resultados que parecen coreografiados intencionalmente en lugar de generados al azar.

Referencia de sujeto y voz: consistencia de identidad entre tomas

Mantener la consistencia de los personajes ha sido históricamente muy difícil en la generación de video con IA, donde las identidades se deformaban o derivaban con facilidad entre fotogramas. Wan 2.7 introduce lo que la documentación denomina "Absolute Identity Lock", un sistema de referencia de sujeto que fija a la perfección los rasgos faciales (altura de ojos, líneas de la mandíbula), los detalles de la ropa y los estilos ambientales a lo largo de movimientos de cámara complejos.

Aportas una imagen de referencia de una persona, un objeto o un personaje, y el modelo mantiene esa identidad visual durante todo el video generado. Esto responde a la principal queja sobre Wan 2.5 y 2.6: personajes que no parecían el mismo de un fotograma a otro. La mejora se nota de inmediato en las pruebas, con muchos menos cambios de vestuario a mitad de clip, deformaciones faciales o deriva de identidad.

La referencia de voz extiende esa consistencia al audio. Los creadores pueden aportar una muestra de voz, y Wan 2.7 mantendrá esa identidad vocal a lo largo de las pistas de audio generadas, algo crítico para contenido de marca, narrativas centradas en personajes o cualquier proyecto que requiera una voz reconocible y consistente. Esto coloca a Wan 2.7 en competencia directa con herramientas como Kling y Hailuo, que llevan tiempo ofreciendo generación con identidad consistente, pero con una integración de funciones más amplia en Wan 2.7.

Sincronización nativa de audio: sonido que acompaña al movimiento

A diferencia de la mayoría de los modelos de video con IA, que generan clips mudos y requieren añadir audio manualmente, Wan 2.7 incluye generación nativa de audio sincronizada directamente con el contenido visual. La música de fondo, el sonido ambiental y las voces de los personajes se generan sincronizados con el movimiento de la escena desde el inicio, no como un añadido posterior. Para cualquiera que haya intentado alinear audio con video de IA fotograma a fotograma, esta es probablemente la mejora más práctica de todo el conjunto de funciones.

El modelo admite una entrada de audio opcional, lo que permite a los creadores aportar una pista de referencia que influye tanto en la generación visual como en la salida sincronizada. Este enfoque multimodal significa que puedes introducir una pista musical y hacer que el ritmo del video, los cortes y la dinámica de movimiento respondan al tempo y al tono emocional del audio, creando una coherencia audiovisual que antes solo era posible con un trabajo de posproducción muy intenso.

Edición de video basada en instrucciones: modificaciones guiadas por texto

Una de las funciones más innovadoras de Wan 2.7 es la edición de video basada en instrucciones, la capacidad de modificar videos existentes mediante simples instrucciones de texto sin regenerarlo todo desde cero. En vez de empezar de nuevo cuando necesitas ajustes, puedes escribir instrucciones como "replace the background", "shift the lighting to golden hour" o "recolor the outfit to blue" y el modelo aplicará esos cambios preservando todos los demás elementos.

Esta capacidad de edición video a video reduce la complejidad de la entrada y la carga computacional, ofreciendo resultados más rápidos que una regeneración completa. Para flujos creativos iterativos, esto es transformador: puedes refinar resultados con ajustes puntuales en lugar de apostar de nuevo por una generación completamente nueva. La función es especialmente valiosa para agencias que aplican tratamientos estacionales sobre material existente o para equipos de marca que mantienen consistencia visual del producto en múltiples escenas sin volver a grabar.

Duración extendida y rodaje continuo: rompiendo el límite del fragmento

Una de las mayores restricciones de los primeros modelos de video fue la duración narrativa, normalmente limitada a fragmentos de una sola toma de 3 a 4 segundos. Wan 2.7 aborda esto con su función de rodaje continuo, un sistema de extensión inteligente que permite ampliar indefinidamente materiales de video existentes. El modelo admite duraciones de salida de 2 a 15 segundos en una sola generación, lo que lo convierte en la única opción entre los principales competidores para clips de más de 10 segundos.

Esta capacidad de duración extendida, combinada con el control de primer y último fotograma, permite una construcción narrativa real de múltiples tomas. Los creadores pueden encadenar secuencias con transiciones predecibles, construyendo contenido de formato más largo que mantiene la coherencia visual y estilística en todo momento, un requisito crítico para flujos de trabajo profesionales.

Especificaciones técnicas y calidad de salida

Wan 2.7 genera video en resolución nativa 1080P HD, con 720P también disponible para procesamientos más rápidos. El modelo entrega a 24 fps, alineándose con el estándar cinematográfico para movimiento de calidad profesional. Los tiempos de generación varían según la duración y la resolución, pero su arquitectura prioriza la calidad sobre la velocidad, un intercambio deliberado que lo posiciona como una herramienta de producción y no como un sistema de prototipado rápido.

La calidad visual del modelo supone una mejora clara sobre Wan 2.6 en varias dimensiones. La consistencia de estilo es notablemente más sólida: mantiene con más fiabilidad el realismo cinematográfico, la estética anime y los estilos ilustrados a lo largo de los fotogramas, algo esencial para contenido que necesita una identidad visual reconocible durante toda la pieza. La consistencia temporal también ha mejorado de forma drástica, con menos parpadeo en rostros, menos cambios de vestuario a mitad de clip y menos casos en los que los sujetos se deforman ligeramente entre cortes.

La dinámica de movimiento muestra un refinamiento especial. En una prueba con un águila en vuelo, el movimiento de las alas mostró una profundidad de campo limpia y un movimiento natural sin los artefactos nerviosos habituales en modelos anteriores. Los barridos de paisaje muestran desplazamiento suave de nubes y profundidad atmosférica, y el modelo maneja las indicaciones negativas de forma efectiva para suprimir artefactos como desenfoque, distorsión y marcas de agua.

Cómo se compara Wan 2.7 con otros modelos

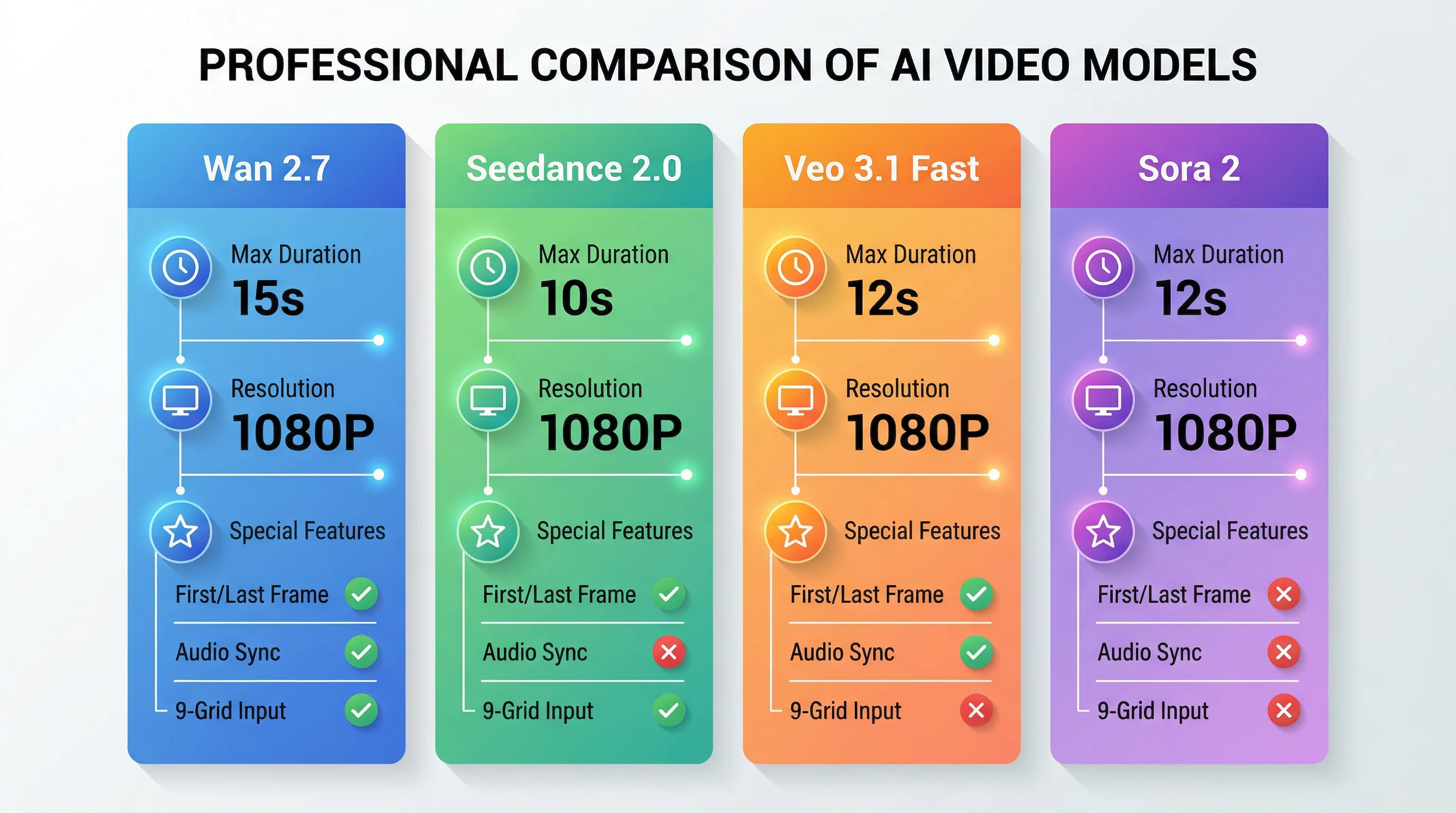

Wan 2.7 frente a Seedance 2.0: funciones y valor

Seedance 2.0 de ByteDance ofrece el mejor valor para movimiento de alta calidad al menor coste por segundo del mercado actual. Sin embargo, Wan 2.7 es la navaja suiza de la comparación: ofrece más funciones, más flexibilidad y encaja mejor en flujos que requieren sincronización de audio o control fotograma a fotograma.

Seedance 2.0 llega como máximo a clips de 10 segundos y carece de control de primer y último fotograma o de entrada de audio. Interpreta las indicaciones con un poco más de libertad creativa, algo que puede ser beneficioso o frustrante según las necesidades del proyecto. Seedance suele ser más rápido para la generación por API, lo que lo hace ideal para iteración rápida y pruebas. La estrategia inteligente que adoptan muchos equipos de producción es usar Seedance 2.0 para iterar y probar, y luego generar la salida final con Wan 2.7 cuando necesitan controles creativos únicos. Si quieres profundizar en las diferencias de producción, merece la pena leer la reseña dedicada de Seedance 2 y la antigua comparación Seedance 2 vs Wan 2.6.

Wan 2.7 frente a Veo 3.1: control y física

Veo 3.1 Fast de Google lidera en realismo físico y es el único modelo de la comparación que ofrece tanto audio generado automáticamente como clips de 12 segundos a $0.10 por segundo. Veo 3.1 produce resultados con calidad cinematográfica a 24 fps con generación de audio nativa, incluyendo sonidos ambientales, diálogos y música sincronizados con lo visual. Sin embargo, Veo 3.1 Lite se queda en 8 segundos y carece de las funciones de control granular que definen a Wan 2.7.

Donde Wan 2.7 brilla es dando al creador un control preciso sobre la construcción de la escena mediante anclajes de primer y último fotograma, composición en 9 cuadrículas y edición basada en instrucciones. Veo 3.1 prioriza la simulación física realista y el movimiento natural, lo que lo hace ideal para escenarios donde el realismo pesa más que el control. La elección entre ambos depende de si tu flujo de trabajo valora más la capacidad de dirección (Wan 2.7) o la física naturalista (Veo 3.1). Para un desglose completo, la reseña independiente de Veo 3.1 cubre con más detalle la parte de física y audio.

Wan 2.7 frente a Sora 2: herramienta de producción y plataforma experimental

Sora 2 de OpenAI lidera en realismo físico y ofrece clips de 12 segundos con audio generado automáticamente. Sin embargo, Sora sigue teniendo una posición más experimental, con menos énfasis en la integración con flujos de trabajo de producción. El conjunto de funciones de Wan 2.7, especialmente el control de primer y último fotograma, la entrada en 9 cuadrículas y la edición basada en instrucciones, está diseñado explícitamente para encajar con la forma en que realmente operan los flujos profesionales: tienes un guion gráfico, tienes un personaje y tienes definidos los puntos de inicio y fin de cada escena. Wan 2.7 trabaja con esa estructura, no en contra de ella. Si estás comparando modelos punteros en toda la categoría, la comparación más amplia de modelos de video con IA es un buen complemento.

Tabla comparativa de modelos

| Función | Wan 2.7 | Seedance 2.0 | Veo 3.1 Fast | Sora 2 |

|---|---|---|---|---|

| Duración máxima | 15 segundos | 10 segundos | 12 segundos | 12 segundos |

| Resolución máxima | 1080P | 1080P | 1080P | 1080P |

| Control de primer/último fotograma | ✓ | ✗ | ✗ | ✗ |

| Sincronización de entrada de audio | ✓ | ✗ | ✗ | ✗ |

| Generación nativa de audio | ✓ | ✗ | ✓ | ✓ |

| Entrada de imagen en 9 cuadrículas | ✓ | ✗ | ✗ | ✗ |

| Edición basada en instrucciones | ✓ | ✗ | ✗ | ✗ |

| Referencia de sujeto | ✓ | ✓ | ✓ | ✓ |

| Indicaciones negativas | ✓ | Limitado | ✗ | ✗ |

| Modelo de precios | Créditos (sin caducidad) | Por generación | Por generación | Suscripción |

| Uso comercial | Todos los planes | Todos los planes | Todos los planes | Variable |

Casos de uso reales e integración en flujos de trabajo

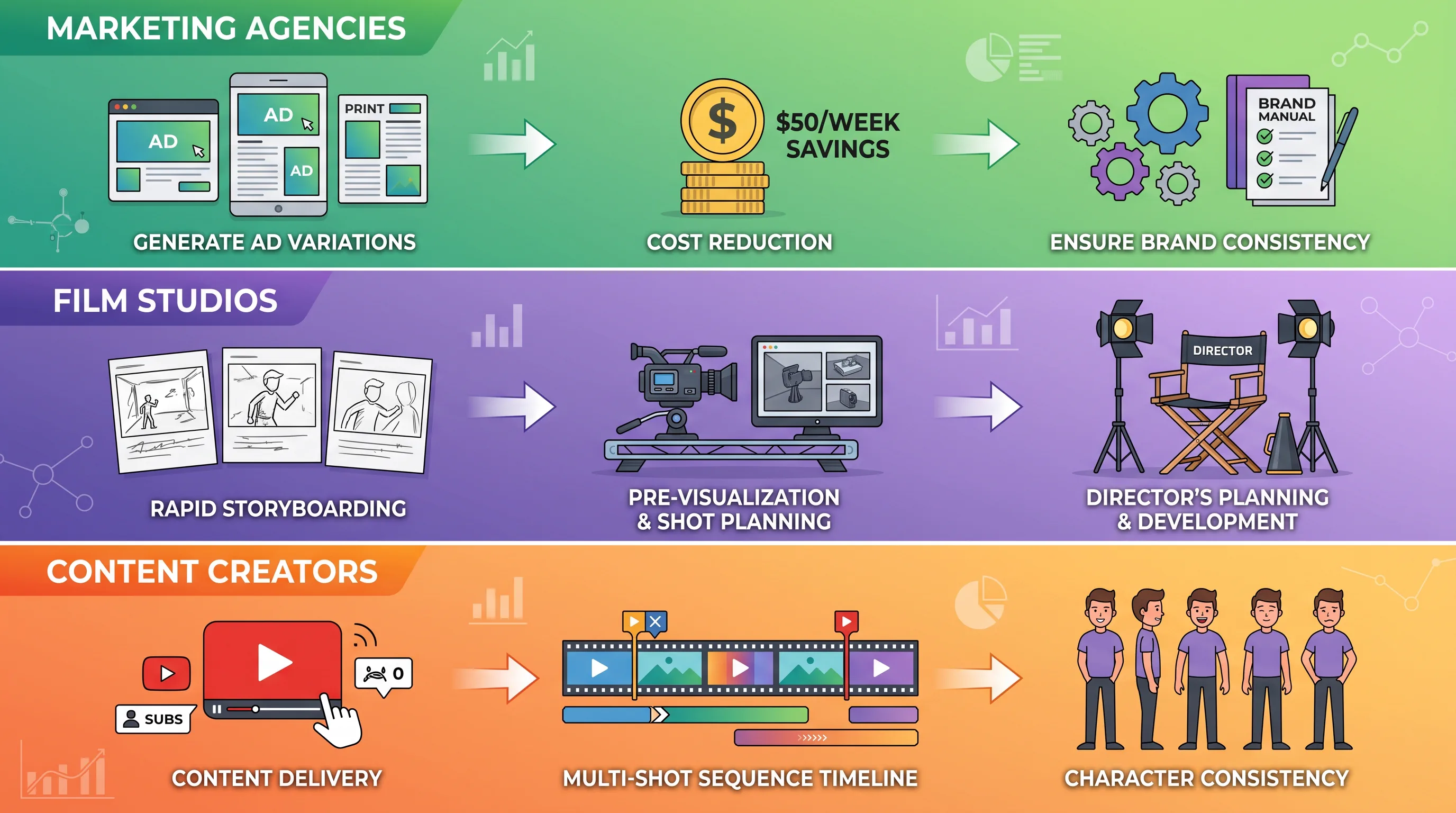

Agencias de marketing: generación programática de variantes publicitarias

Una agencia que produce 50 variantes publicitarias por semana puede automatizar la generación base por menos de $50 en créditos, dejando el tiempo humano para estrategia y revisión final. Esto supone una reasignación real del presupuesto desde la producción manual hacia la estrategia creativa. El modelo sin suscripción implica que no hay cuota mensual por asiento, no hay bloqueo de plataforma y no hay mínimo de uso. Pagas por generación, lo que encaja perfectamente con flujos de marketing de rendimiento. Los equipos que construyen sistemas de anuncios repetibles suelen combinar esto con una referencia clara de precios de Seedance 2 o con un artículo comparativo sobre modelos más rápidos.

Los equipos de marca pueden usar la referencia de sujeto para mantener consistencia visual del producto en múltiples escenas generadas. La función de edición video a video les permite tomar material existente y aplicar nuevos estilos o tratamientos estacionales sin volver a grabar, algo clave para mantener la coherencia de marca mientras se adaptan a los ciclos de campaña.

Estudios de cine: previsualización y prototipado rápido

La previsualización con IA es un tema de búsqueda cada vez más relevante en producción cinematográfica, y el conjunto de funciones de Wan 2.7 aborda directamente ese flujo. Los directores pueden usar guiones gráficos de 9 cuadrículas para visualizar secuencias complejas antes de comprometerse con rodajes costosos. El control de primer y último fotograma permite planificar escenas con precisión, mientras que la referencia de sujeto mantiene la consistencia del personaje en secuencias de previsualización.

La capacidad del modelo para generar clips de hasta 15 segundos con audio nativo lo hace viable para la previsualización completa de escenas y no solo para pruebas de toma única. Los equipos de producción pueden iterar sobre la puesta en escena, el movimiento de cámara y el ritmo con movimiento y sonido reales antes de pisar el set, reduciendo la experimentación costosa durante el rodaje.

Creadores de contenido: construcción narrativa multi-toma

Para creadores de YouTube, educadores y creadores de contenido narrativo, la función de rodaje continuo de Wan 2.7 y su soporte de duración extendida permiten contar historias verdaderamente multi-toma. La combinación de control de primer y último fotograma con referencia de sujeto significa que puedes mantener la consistencia del personaje a lo largo de toda una secuencia de video, resolviendo el problema que ha perseguido al video con IA desde sus inicios.

La capacidad de edición basada en instrucciones es especialmente útil para refinar contenido de forma iterativa. En vez de regenerar clips completos cuando necesitas ajustes, puedes aplicar modificaciones puntuales mediante comandos de texto, reduciendo de forma drástica el tiempo de iteración y los costes computacionales.

Integración técnica: acceso a API y soporte de plataforma

Wan 2.7 está disponible a través de varios proveedores de API, incluidos Together AI, Segmind y acceso directo mediante Alibaba Model Studio. La implementación de Together AI usa el endpoint Wan-AI/Wan2.7-T2V y admite llamadas REST estándar con cargas JSON. La autenticación usa cabeceras de clave de API, y el modelo funciona sobre la infraestructura sin servidor de Together AI para un despliegue escalable.

Las integraciones de plataforma están creciendo con rapidez. Wan 2.7 ya está disponible en Picsart, SeaArt AI, EaseMate AI, WaveSpeedAI y MindStudio, entre otros. La biblioteca de modelos de SeaArt AI permite a los creadores acceder a varios modelos de video con IA sin cambiar de plataforma, lo que facilita comparaciones directas entre Wan 2.7, Seedance, Veo y otros modelos dentro de un mismo flujo.

La integración con MindStudio es especialmente destacable por su automatización de flujos. La plataforma permite construir agentes de IA que observan nuevas imágenes de producto en una carpeta de Google Drive, generan videos usando Wan 2.7, aplican posprocesado (escalado, intercambio de rostros, unión de clips, generación de subtítulos) y entregan los clips finales a Slack, todo sin intervención manual. Este nivel de integración convierte a Wan 2.7 de una herramienta de generación en un componente del flujo de producción.

Precios y licencias comerciales

Wan 2.7 opera con un modelo de precios basado en créditos y sin cuotas mensuales. Los créditos no caducan, una ventaja importante frente a la mayoría de herramientas de video con IA que reinician la capacidad no utilizada al final de cada ciclo de facturación. El uso comercial está incluido en todos los planes de pago, con condiciones de licencia relativamente flexibles y coherentes con el enfoque histórico de la serie Wan.

Los precios concretos varían según el proveedor de la plataforma, pero la estructura general favorece flujos de producción con patrones de uso variables. Para compradores técnicos que evalúan documentación oficial, APIs invocables y tablas de precios documentadas, las ofertas de video publicadas por Alibaba ofrecen una claridad contractual en runtime más sólida que la de muchos competidores.

Configuración de parámetros e ingeniería de indicaciones

| Parámetro | Rango | Recomendado | Propósito |

|---|---|---|---|

| Duración | 2-15 segundos | 5-8 segundos | Equilibrio entre calidad y tiempo de generación |

| Resolución | 720P, 1080P | 1080P para final, 720P para pruebas | Calidad de salida frente a velocidad |

| Relación de aspecto | 16:9, 4:3, 9:16 | 16:9 para web, 9:16 para móvil | Optimización por plataforma |

| Indicación negativa | Cadena de texto | blurry, distorted, watermark | Supresión de artefactos |

| Expansión de la indicación | Sí/No | Activada | Interpretación de detalle mejorada |

| Entrada de audio | Archivo opcional | Usar para sincronización rítmica | Coherencia audiovisual |

| Anclas de fotograma | 0-2 imágenes | Usar para control de escena | Transiciones previsibles |

Wan 2.7 responde bien a indicaciones descriptivas detalladas, con especificaciones sobre escenario, iluminación, movimiento de cámara y acción. El modelo se beneficia de una ingeniería de indicaciones estructurada que separa la descripción de la escena, los detalles del personaje, la dirección del movimiento y las preferencias estilísticas en cláusulas distintas. Las indicaciones negativas suprimen con fiabilidad los artefactos comunes, aunque no van a salvar imágenes de entrada fundamentalmente malas. Si quieres una estructura de indicaciones más sólida para trabajo de producción, la guía de indicaciones de Seedance 2 sigue siendo útil como referencia, porque los principios de lenguaje de cámara y bloqueo de escena se transfieren muy bien.

Limitaciones y consideraciones

A pesar de su conjunto de funciones tan completo, Wan 2.7 tiene limitaciones que conviene señalar. El modelo prioriza calidad sobre velocidad, lo que provoca tiempos de generación más largos que los de competidores como Seedance 2.0 o Veo 3.1 Lite. Para flujos de prototipado rápido que requieren decenas de iteraciones en poco tiempo, esto puede convertirse en un cuello de botella. El enfoque recomendado es usar modelos más rápidos para las pruebas iniciales y reservar Wan 2.7 para las generaciones finales de producción, donde sus funciones únicas aportan valor.

Aunque la consistencia temporal ha mejorado de forma espectacular respecto a Wan 2.6, no es perfecta. Escenas complejas con múltiples elementos en movimiento o movimientos de cámara rápidos todavía pueden mostrar parpadeos menores o pequeños problemas de consistencia, aunque mucho menos que en versiones anteriores. El modelo funciona mejor con indicaciones claras, bien estructuradas y con imágenes de entrada de alta calidad. Lo que entra importa; si la base es mala, el resultado también lo será.

La función de 9 cuadrículas, aunque innovadora, requiere preparar cuidadosamente las imágenes de entrada para conseguir resultados óptimos. Las cuadrículas mal compuestas o incoherentes pueden confundir la comprensión espacial del modelo y producir salidas subóptimas. Esta función funciona mejor cuando se integra en flujos de guion gráfico estructurados, no en experimentación improvisada.

Por qué Seedance AI ofrece el mejor acceso a Wan 2.7

Para creadores y equipos de producción que quieren aprovechar las capacidades de Wan 2.7, Seedance AI ofrece el punto de acceso más completo. La plataforma integra varios modelos de generación de video e imagen de vanguardia en una sola interfaz, eliminando la necesidad de mantener cuentas y flujos separados entre distintos proveedores. Este enfoque unificado reduce drásticamente la fricción en flujos multimodelo, una ventaja crítica cuando necesitas comparar resultados o usar modelos distintos en fases diferentes de producción. Si primero quieres una visión más directa del producto, también puedes ir al modelo Wan 2.7 Video.

Seedance AI ofrece una experiencia de creación con IA excepcionalmente cómoda y todo en uno. La plataforma no solo admite Wan 2.7, sino también otros modelos punteros como los generadores de video propios de Seedance, Kling, Veo y sistemas líderes de generación de imagen. Esa amplitud significa que puedes probar el control de primer y último fotograma de Wan 2.7 frente a la velocidad de Seedance 2.0, o comparar la consistencia de la referencia de sujeto entre varios modelos, todo dentro del mismo espacio de trabajo. Para agencias y estudios que gestionan requisitos de contenido diversos, esta flexibilidad es invaluable.

La interfaz de la plataforma está pensada para flujos de producción, con funciones como procesamiento por lotes, organización de proyectos y herramientas integradas de posprocesado. Puedes generar con Wan 2.7, aplicar escalado o edición y exportar los recursos finales sin salir de la plataforma. Para equipos que evalúan si las funciones únicas de Wan 2.7 justifican integrarlo en su flujo, Seedance AI ofrece el entorno de pruebas con menor fricción disponible.

Conclusión: el video con IA listo para producción ya está aquí

Wan 2.7 cumple lo que la categoría texto a video lleva prometiendo durante dos años: calidad cercana a producción mediante APIs accesibles y precios que realmente hacen viable la generación programática de video para flujos comerciales. El conjunto de funciones del modelo, control de primer y último fotograma, composición de 9 cuadrículas, referencia de sujeto y voz, sincronización nativa de audio y edición basada en instrucciones, representa un cambio fundamental desde herramientas experimentales de generación hacia componentes del flujo de producción.

Para cineastas, YouTubers, marketers y creadores de agencias que necesitan videos multi-toma con audio y control preciso, el conjunto de funciones de Wan 2.7 encaja con la forma en que operan realmente los flujos de contenido profesional. Tienes un guion gráfico, tienes un personaje y tienes definidos los puntos de inicio y fin de cada escena. Wan 2.7 trabaja con esa estructura, no en su contra. El modelo no es perfecto, ni es la opción más rápida disponible, pero sí es el modelo de video con IA más completo y controlable del panorama de 2026.

La verdadera pregunta no es si Wan 2.7 está sobrevalorado. La pregunta es si tu flujo concreto se beneficia de sus capacidades de control únicas. Si produces contenido que requiere consistencia de personaje entre tomas, transiciones precisas de escena, sincronización audiovisual o edición iterativa sin regeneración completa, Wan 2.7 es la opción más sólida disponible actualmente. Para prototipado rápido o escenarios donde la velocidad pese más que el control, alternativas como Seedance 2.0 o Veo 3.1 Lite pueden ser más adecuadas. La estrategia inteligente es sumar Wan 2.7 a tu caja de herramientas para los casos en los que su capacidad aporta valor claro, manteniendo a la vez acceso a modelos más rápidos para iteración.

La generación de video con IA ha pasado de novedad experimental a herramienta de producción. Wan 2.7 representa el estado del arte actual en generación de video controlable y rica en funciones, y plataformas como Seedance AI hacen que acceder e integrar estas capacidades en flujos reales sea más práctico que nunca.