如果你正在搜索 HappyHorse complete guide,真正的难点其实不是看懂它的宣传文案,而是分清哪些信息只是官网可见,哪些信息已经能够被独立验证,然后再决定 HappyHorse 目前更适合关注、试用,还是直接纳入正式生产流程。

截至 2026 年 4 月 8 日,HappyHorse 对外呈现的是一个非常有野心的故事。公开页面把 HappyHorse 1.0 描述为一个开源多模态视频模型,支持音视频同步生成、七种语言口型同步、1080p 输出、商用许可、自托管,以及很强的 benchmark 成绩。这个组合确实很吸引人。但它也立刻带来一个验证问题:公开代码路径目前无法直接检查,而部署示例里提到的模型托管路径,在未登录状态下也无法开放访问。

这并不自动说明 HappyHorse 是假的。但它确实意味着,你需要用更准确的框架去看待它:项目方向很有意思,公开验证链条还不完整,是否已经适合生产环境也不够清晰。下面这篇指南会拆开来说清楚,哪些地方看起来是真实可信的,哪些仍然需要证据,HappyHorse 目前最可能在哪些场景有意义,以及如果你现在就要产出内容,为什么一个更成熟的 text to video 工作流 或 image to video 工作流 往往比继续等待更实际。

简短回答

HappyHorse 看起来像是一个很有潜力的 AI 视频模型项目,公开定位集中在开放权重、音频生成、口型同步和自托管这些卖点上。但就目前公开证据而言,还不足以把它所有 headline claim 都当成已经完全落地、可以零风险采用的基础设施。

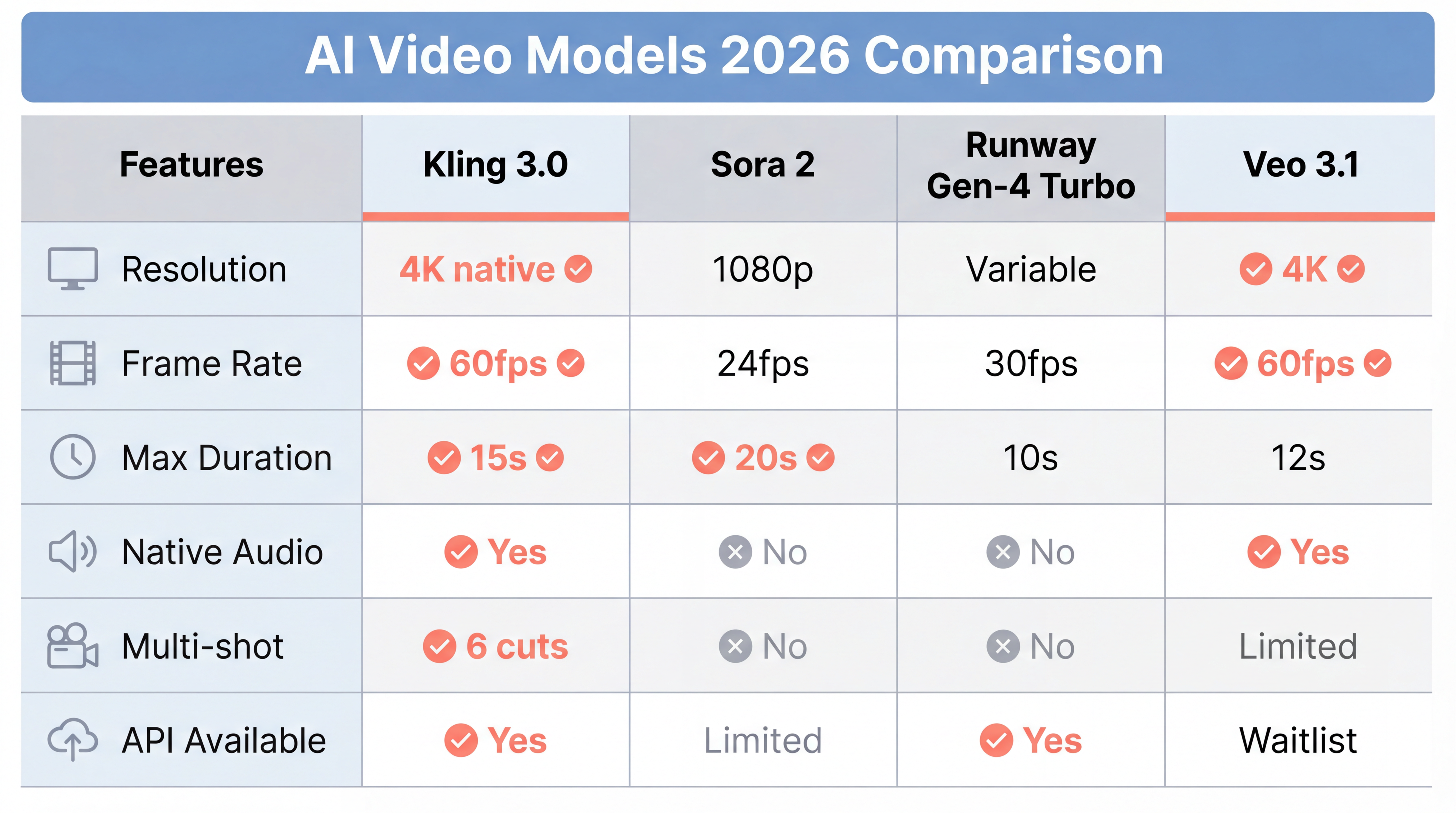

更实用的判断可以压缩成下面这张表:

| 问题 | 实际判断 |

|---|---|

| HappyHorse 值得关注吗? | 值得。对于一个主打开放与自托管的视频模型来说,它公开展示的功能组合确实很激进。 |

| 今天能把它视为一个已经充分验证的公开开源模型吗? | 还不能。公开仓库路径不可用,网站展示的模型路径在未登录检查下也无法开放访问。 |

| 要直接忽略它吗? | 也不必。如果你关心开放式多模态视频生成,它值得持续观察。 |

| 现在就该围绕它搭生产流程吗? | 只有在你能接受验证风险、也能容忍公开产物不完整的前提下才考虑。 |

| 创作者现在最该做什么? | 需要从 prompt 出发时,用成熟的 text to video 工作流;已经有参考图时,用稳定的 image to video 工作流。 |

核心结论就是这句:HappyHorse 现在更像一个高上限、值得跟踪的项目,而不是一个可以直接托管严肃生产排期的稳定底座。

HappyHorse 目前公开宣称了什么

当前可见的 HappyHorse 页面并不是模糊的 teaser,而是一套相对具体的产品叙事。公开可见的宣称包括:

- 150 亿参数模型

- 40 层 Transformer 架构

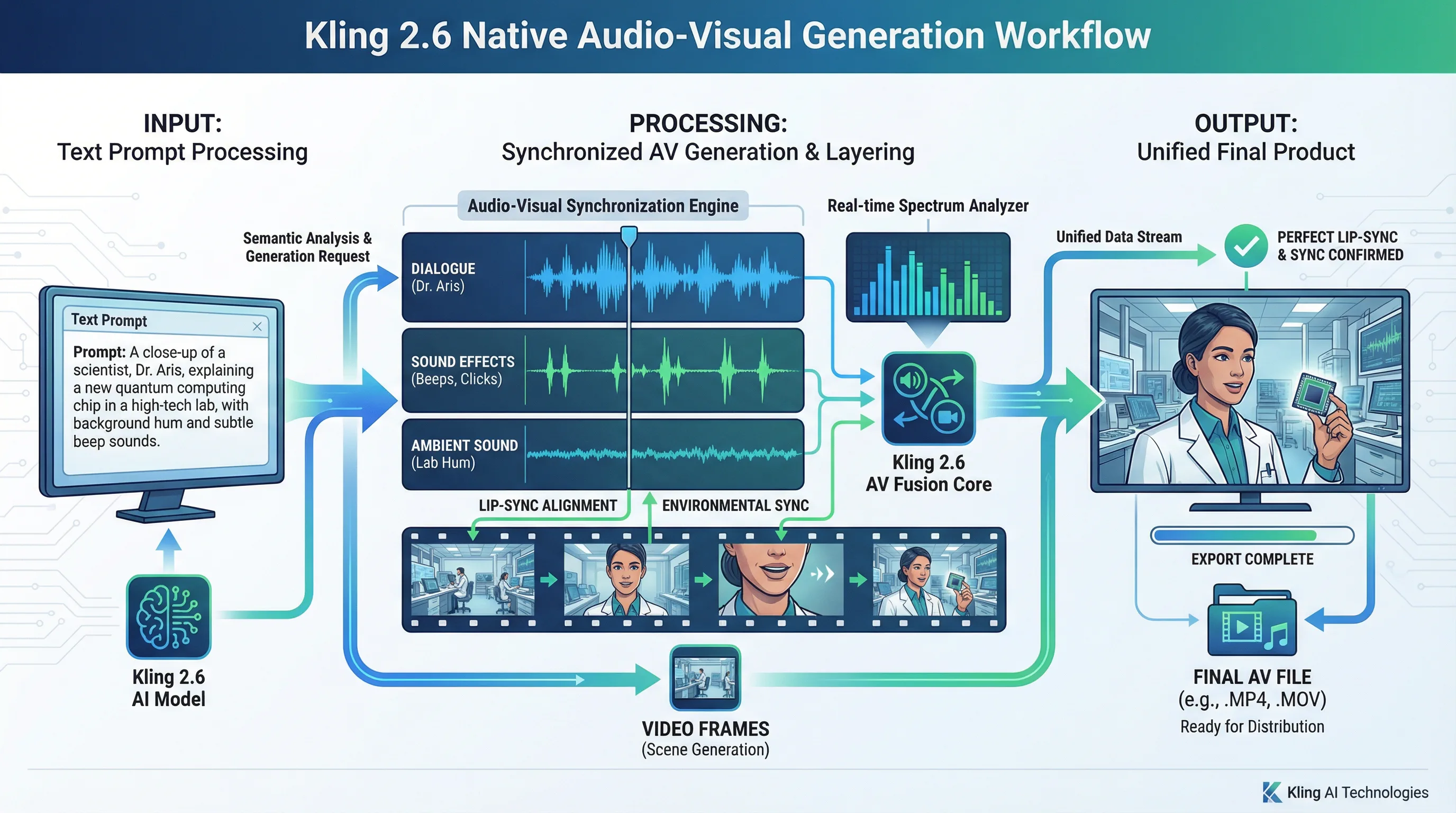

- 视频与音频联合生成

- 同时支持文本输入和图片输入

- 七种语言口型同步

- 1080p 输出

- 5 到 8 秒视频片段

- 支持在 H100 或 A100 级 GPU 上自托管

- 开源发布并允许商业使用

$11.90起的价格

这些都不是那种泛泛的 landing page 词汇,而更像是一页希望同时说服创作者和研究者的技术发布页面。

页面里还出现了更具体的性能式表述,例如:

- 在 H100 上生成 5 秒 1080p 视频约需 38 秒

- 支持英语、普通话、粤语、日语、韩语、德语和法语口型同步

- benchmark 表现优于 OVI 1.1 和 LTX 2.3

- 宣称在某个公开视频模型榜单中排名靠前

如果只看纸面配置,这会让 HappyHorse 处在一个很有吸引力的位置。一个同时具备 text-to-video、image-to-video、同步音频、多语言口型同步以及商业友好开放性的模型,天然会比普通视频模型更显眼。问题不在故事本身写得好不好,而在于这套故事和当前真正可访问的公开产物之间还存在明显落差。

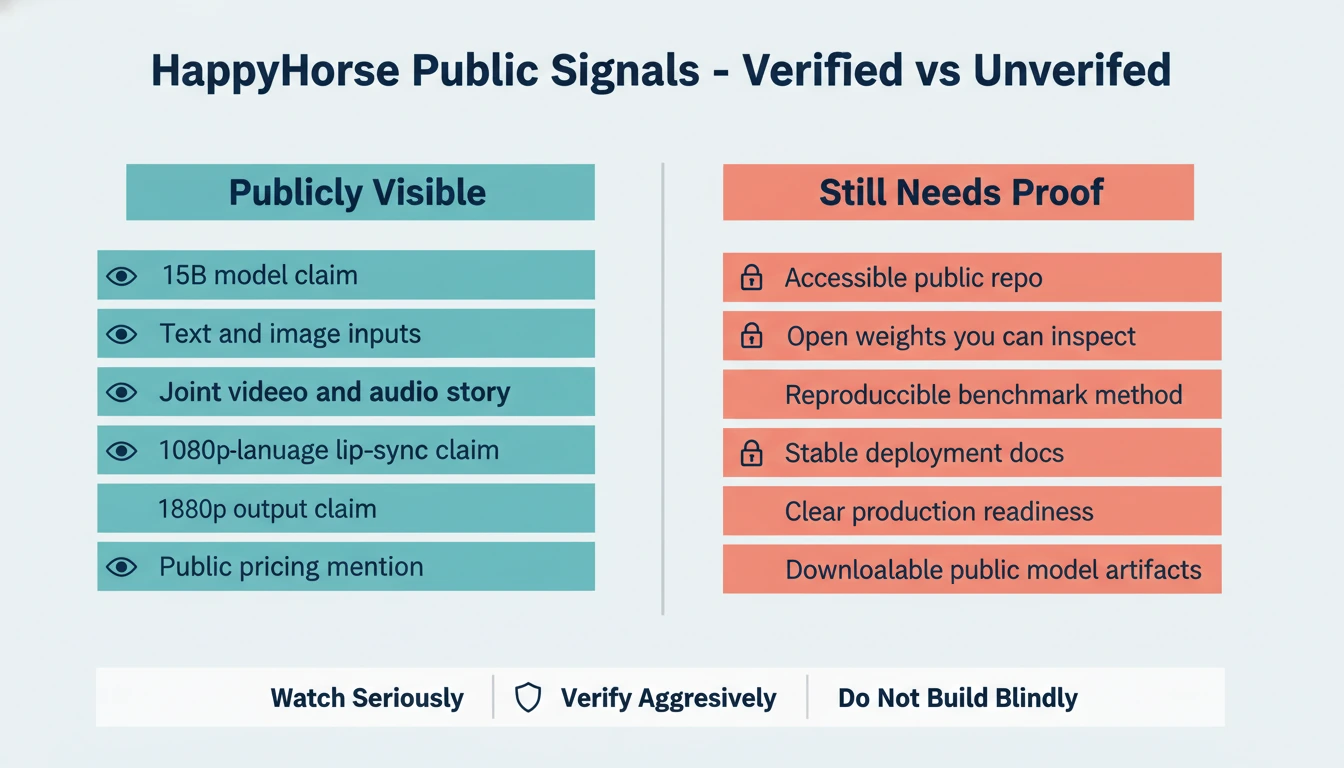

哪些是真正已验证的,哪些仍需要证据

理解 HappyHorse 最有用的方式,是把公开信息拆成两个桶:一类是你今天就能直接看到的内容,另一类是仍需要独立确认的部分。

| 状态 | 包含什么 | 为什么属于这一类 |

|---|---|---|

| 公开可见 | 官网功能描述、价格提法、部署示例、benchmark 表格、示例视频 | 这些内容都能在当前公开页面直接看到,可以确认它们确实被这样公开宣称。 |

| 仍缺独立验证 | 开源仓库可用性、公开权重、自托管代码链路、可复现 benchmark 方法、生产可用性 | 相关仓库路径当前不可访问,引用的模型路径也无法在未认证状态下开放检查。 |

这个区分很重要,因为很多创作者会把两个问题混在一起。

第一个问题是:

- 这个项目讲的是不是一个完整、技术上说得通的产品故事?

第二个问题是:

- 我今天能不能独立验证、下载、复现并稳定运行它?

就目前来看,HappyHorse 在第一个问题上的表现明显好于第二个问题。

这不代表项目就没有价值,只是意味着你的动作应该变。若你是研究者,或者愿意投入注意力提前观察新模型,可以持续跟踪;但如果你是有明确交付期限的创作者,就应该继续使用那些已经可以稳定生成内容的工具。

为什么 HappyHorse 会被关注

HappyHorse 会获得关注,是因为它把创作者真正想要的几件事打包到了一起:

- 开放或至少偏开放的定位

- 不只是静音视频,而是多模态生成

- 多语言口型同步

- 自托管叙事,而不是纯 SaaS 锁定

- benchmark 话术暗示它能和现有开放视频模型竞争

这套组合正好打在了当前市场的矛盾点上。很多创作者想要最新视频系统的质量提升,但又不想被完全锁进封闭工具、受区域开放节奏影响,或者被单一计费界面绑死。HappyHorse 讲的正是这类需求。

它会快速传播,还有第二个原因:它描述的不只是一个模型,而是一条听起来接近完整的工作流。很多视频模型页面仍然要求你自己拼栈:先在一个地方生成视频,再去另一个地方补声音,再去第三个地方修 lip-sync,最后还要手动处理时序和放大。HappyHorse 承诺的是一条更集成的路径。

这就是为什么,即便完整公开验证还没跟上,它依然会让人觉得重要。因为它指向了创作者真正想要的工作方式。

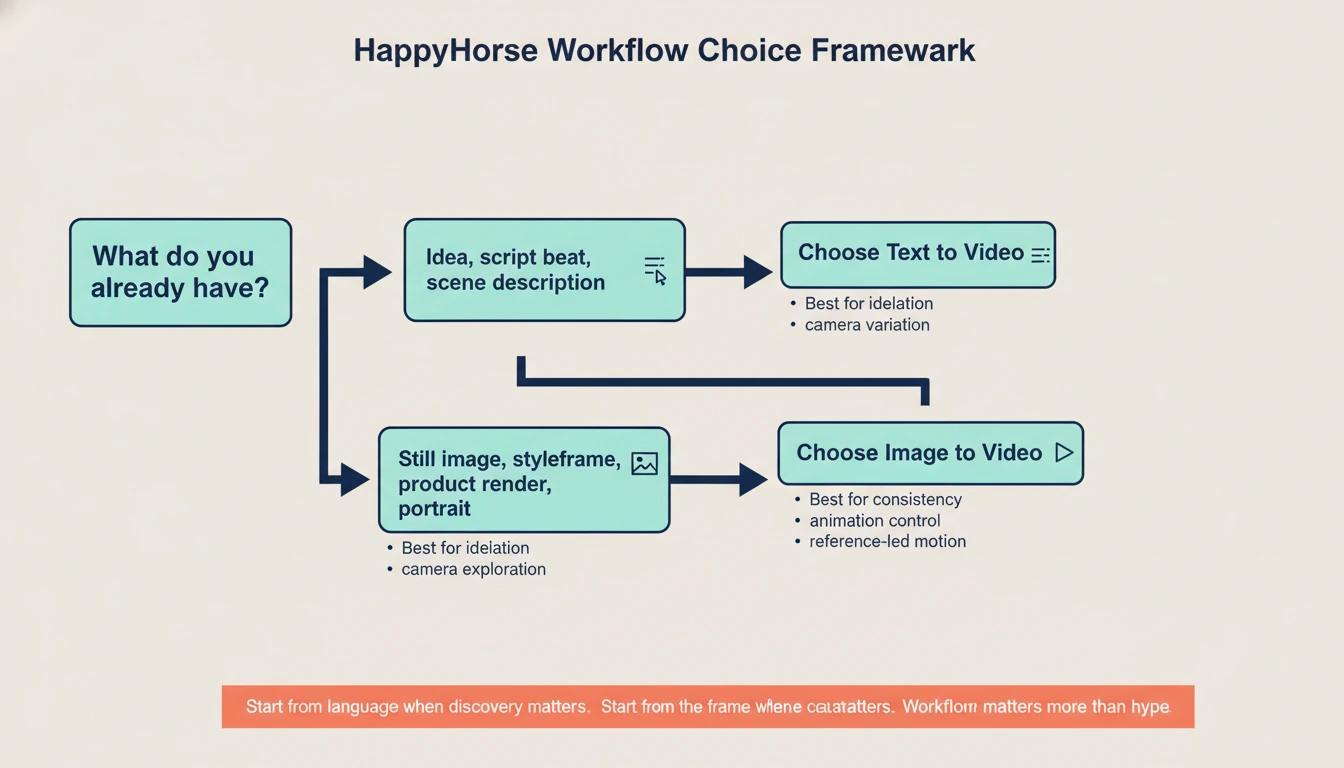

真正该问的问题:Text to Video 还是 Image to Video?

即便 HappyHorse 未来把所有公开宣称都兑现了,大多数创作者今天仍然要面对同一个核心选择:你是从语言出发,还是从一帧画面出发?

这件事比模型名字更重要。

| 工作流 | 最佳起点 | 能带来什么 | 主要短板 |

|---|---|---|---|

| Text to video | 你有想法、分镜描述、场景文字或镜头语言,但还没有固定关键帧 | 更快做概念探索,更容易扩展 prompt 变体,也更适合前期创意发散 | 当你脑中的画面非常具体时,构图更容易飘 |

| Image to video | 你已经有静帧、角色图、产品图、故事板画面或主视觉 | 主体更稳定,艺术方向更可控,也更适合在已批准视觉上做动画 | 如果源图不够强,做大幅场景变化会受限 |

很多人在追逐新模型发布时,真正卡住的就是这里。他们会误以为“新模型本身就是工作流”。其实并不是。工作流的起点,仍然取决于你手里已经拥有的创作资产。

当你符合下面这些情况时,更适合用 text to video:

- 需要快速探索多个场景方向

- 希望从同一个文字概念生成不同镜头方案

- 视觉方向还没有完全定稿

- 想先把情绪、动作或叙事节奏迭代出来,再锁关键画面

当你符合下面这些情况时,更适合用 image to video:

- 已经有一张很强的静态图

- 需要角色、产品或构图尽量贴近参考

- 正在给 key visual、广告图、人像或故事板单帧做动画

- 视觉一致性比开放式探索更重要

HappyHorse 未来也许会把这两条路径整合进同一个生态,但对大多数创作者来说,决策树并不会变。变化的只是由哪个模型来执行它。

从纸面上看,HappyHorse 最强的地方在哪里

如果它目前的公开定位大致属实,HappyHorse 在几个具体场景里会特别有吸引力。

1. 以对白为核心的短视频

联合视频与音频生成,再加上多语言 lip-sync,是这套叙事里最突出的组合。如果这些能力真的达到了官网暗示的水平,那它就不只是一个拿 benchmark 图表说故事的静音视频生成器。

这会直接影响这些场景:

- talking avatar 内容

- 短讲解视频

- 多语言创作者视频

- 带屏幕内说话镜头的产品介绍

- 以对白驱动的社媒短内容

2. 开放式或可自托管实验

很多团队要的不只是输出结果好,还要底层基础设施能被检查、调优、做 benchmark,甚至部署到自己的 GPU 上。这也是为什么开源叙事会这么重要。

如果 HappyHorse 真的能交付可用权重、推理代码和蒸馏版本,它影响的就不只是创作者,还包括:

- 应用型 AI 团队

- 研究团队

- 对隐私有要求的工作室

- 正在测试内部媒体生产流程的公司

3. 更强的 image-to-video 风格控制

项目宣称同时支持文本输入和图像输入。对商业工作流来说,支持图像驱动的模型往往比纯文本系统更有价值,因为 image-first 工作流更容易控制。

也正因如此,即使 HappyHorse 现在还没有完全验证,你依然可以先用自己的流程去做压力测试,看看 image to video 工作流 是否更符合生产逻辑。如果你的工作必须从已批准的静帧、风格帧、产品图或角色参考开始,image-led 动画才是更可迁移的方法。

当前公开叙事里仍然脆弱的地方

这部分是很多首发文章刻意跳过的。这里的问题不一定是模型本身弱,而是它在信任和可操作性层面还比较脆。

公开产物不匹配

当前公开页面的口吻,像是一个已经完整发布的技术产品。但公开仓库路径并没有支撑起这种确定性。如果一个项目要把“开源可信度”作为核心卖点,那么可访问的公开产物就不是可选项,而是基础项。

Benchmark 信心缺口

任何人都可以发布 benchmark 表格,但可复现的评测方法要难得多。在出现可检查的完整报告、稳定代码访问或第三方复现实验之前,这些 benchmark 数字更适合被视作方向性陈述,而不是已经坐实的事实。

生产可用性仍然模糊

一个模型可以是真实的、也可以很强,但仍然没有准备好投入稳定生产。真正有排期压力的团队更关心:

- 访问是否稳定

- 失败模式有没有文档

- 速率是否可预期

- 环境是否可复现

- 更新节奏是否可见

就这些维度来看,HappyHorse 目前公开暴露出来的操作面还不够大,不足以拿到很高分。

创作者现在应该怎么做

如果你对 HappyHorse 感兴趣,最好的动作不是去争论它到底被高估还是低估,而是先把你自己的工作流去风险化。

下面这张表更适合作为行动依据:

| 你的情况 | 当前更好的做法 |

|---|---|

| 主要需要从 prompt 做概念探索 | 围绕稳定的 text to video 工作流 搭建流程,同时把 HappyHorse 放进观察名单 |

| 已经有概念图、产品静帧或人像参考 | 围绕 image to video 搭流程,只在新模型真的带来更高一致性时再测试 |

| 你关心开放基础设施胜过短期出片 | 密切跟踪 HappyHorse,等待可访问权重、代码和可复现文档出现 |

| 你这周就需要可发布资产 | 不要把内容排期压在一个公开验证仍不完整的模型上 |

很多发布解读缺少的,恰恰是这种实用视角。你不需要现在就判断 HappyHorse 是不是未来,只需要判断,今天什么选择最能帮助你继续稳定出片,同时又不给明天更好的工具关上门。

在哪里跟踪 HappyHorse 的公开信息

如果你想继续观察这个项目在公开目录、聚合页和发布型页面里是如何被呈现的,可以先关注两个关键词入口:HappyHorse AI 和 HappyHorse 视频模型。把它们当作发现线索即可,不要把它们视作可检查代码、稳定权重和可复现部署文档的替代品。

一旦有更多公开产物,该如何更好地评估 HappyHorse

当 HappyHorse 释放出更多公开基础设施后,最值得看的会是这几项:

- 未登录用户能否顺利访问真实仓库、文档和模型页面,而不是遇到死链?

- 权重、推理脚本和部署说明,是否在所有公开入口之间保持一致?

- 它的 text-to-video 路径,是否真的能稳定执行具有镜头语言的 prompt?

- 它的 image-to-video 路径,在加入运动后是否仍能保住主体与构图?

- 所谓同步音频是否真的可用,还是仍然需要大量后期修补?

- 多语言 lip-sync 的能力,是否能在公开 demo 中持续看到,而不只是精选片段?

- 公开页面提到的性能数据,创作者或工程师能否在披露硬件条件下自行复现?

在这些问题被回答之前,最合理的姿态是“有根据地关注”,而不是“先盲信再说”。

FAQ

HappyHorse 现在真的是开源吗?

HappyHorse 的公开表述确实把它定位为可商用的开源项目,但当前公开仓库路径无法直接访问。开源宣称是可见的,完整公开产物链还没有闭合。

HappyHorse 属于 text-to-video 还是 image-to-video?

当前公开页面把它描述为两者都支持,这也是它会被关注的重要原因。但更实用的问题是:你今天的输入更适合哪条路?如果是 prompt 驱动的概念探索,就用 text to video;如果是基于参考图的动画生成,就用 image to video。

HappyHorse 现在适合正式生产吗?

它未来可能会具备生产相关性,但就目前公开验证程度而言,还不足以建议把它放到对交付时间敏感的生产流程中心。

为什么那么多人在意 HappyHorse?

因为它把开放模型叙事、同步音频、多语言 lip-sync,以及文本与图像双输入放在了一起。相比又一个只有 benchmark 截图的静音视频模型,这套工作流故事显然更有吸引力。

在 HappyHorse 成熟之前,我该先用什么?

先用工作流视角来判断。场景仍然以 prompt 为主时,用 text to video;你已经有想要动起来的画面时,用 image to video。

最终结论

HappyHorse 值得关注,但不值得盲信。它的公开项目叙事已经足够强,值得认真跟踪;同时它的公开验证链又足够弱,值得你保持高标准去交叉核验。

如果它未来真的能用稳定公开产物兑现当前的所有宣称,它可能会成为开放视频模型里非常有意思的一支力量。在那之前,创作者最稳妥的做法仍然是:不要把发布页上的兴奋感直接当成生产依赖,先围绕那些今天已经能帮助你稳定交付的工作流继续出片,同时持续观察 HappyHorse 何时补齐证据链。