Разговоры создателей контента в этом квартале неизбежно возвращаются к одной модели: Wan 2.7. Разработанная Tongyi Lab компании Alibaba, эта версия стала самым востребованным обзором в мире генерации видео с помощью ИИ не из-за маркетингового шума, а потому что она решает самые болезненные проблемы авторов: согласованность персонажей, точный контроль сцен и качество уровня продакшена в нескольких кадрах подряд. После тщательного тестирования на реальных рабочих процессах этот подробный обзор разбирает, что именно дает Wan 2.7 Video, где она сильна и как она сравнивается с конкурентами в 2026 году.

Что такое Wan 2.7 и почему это важно?

Wan 2.7 — это современная ИИ-модель генерации видео, построенная на архитектуре Mixture-of-Experts (MoE) с 27 миллиардами параметров. В отличие от предшественников, Wan 2.7 означает фундаментальный сдвиг от чистой генерации видео по тексту к полноценному набору инструментов для видеопроизводства со структурированными механизмами управления. Модель создает кинематографичные ролики в 1080P HD из текстовых описаний, изображений и даже аудиовходов, объединяя визуальную точность, синхронизацию звука и согласованность движения в единую систему.

Главное отличие Wan 2.7 от ранних версий и конкурирующих моделей — не только в количестве параметров или разрешении. Настоящий прорыв заключается в мультимодальном вводе и ориентированном на продакшен наборе функций. Если Wan 2.6 требовала от автора просто написать промпт и надеяться, что ИИ поймет замысел, часто выдавая искаженную картинку и непредсказуемый результат, то Wan 2.7 позволяет напрямую подавать изображения, видео и звук, чтобы с точностью 1:1 декодировать движение и освещение. Так точный замысел автора превращается в гиперреалистичную кинематографичную картинку с беспрецедентной точностью.

Коммерческая жизнеспособность модели не менее важна. Wan 2.7 работает по кредитной модели без ежемесячной подписки, без привязки к платформе, а кредиты не сгорают. Для агентств, выпускающих 50 рекламных вариантов в неделю, это означает автоматизацию сырой генерации менее чем за $50 в кредитах и перенос человеческого времени на стратегию и финальную проверку, что заметно меняет экономику производства.

Ключевые возможности, которые переопределяют генерацию видео с помощью ИИ

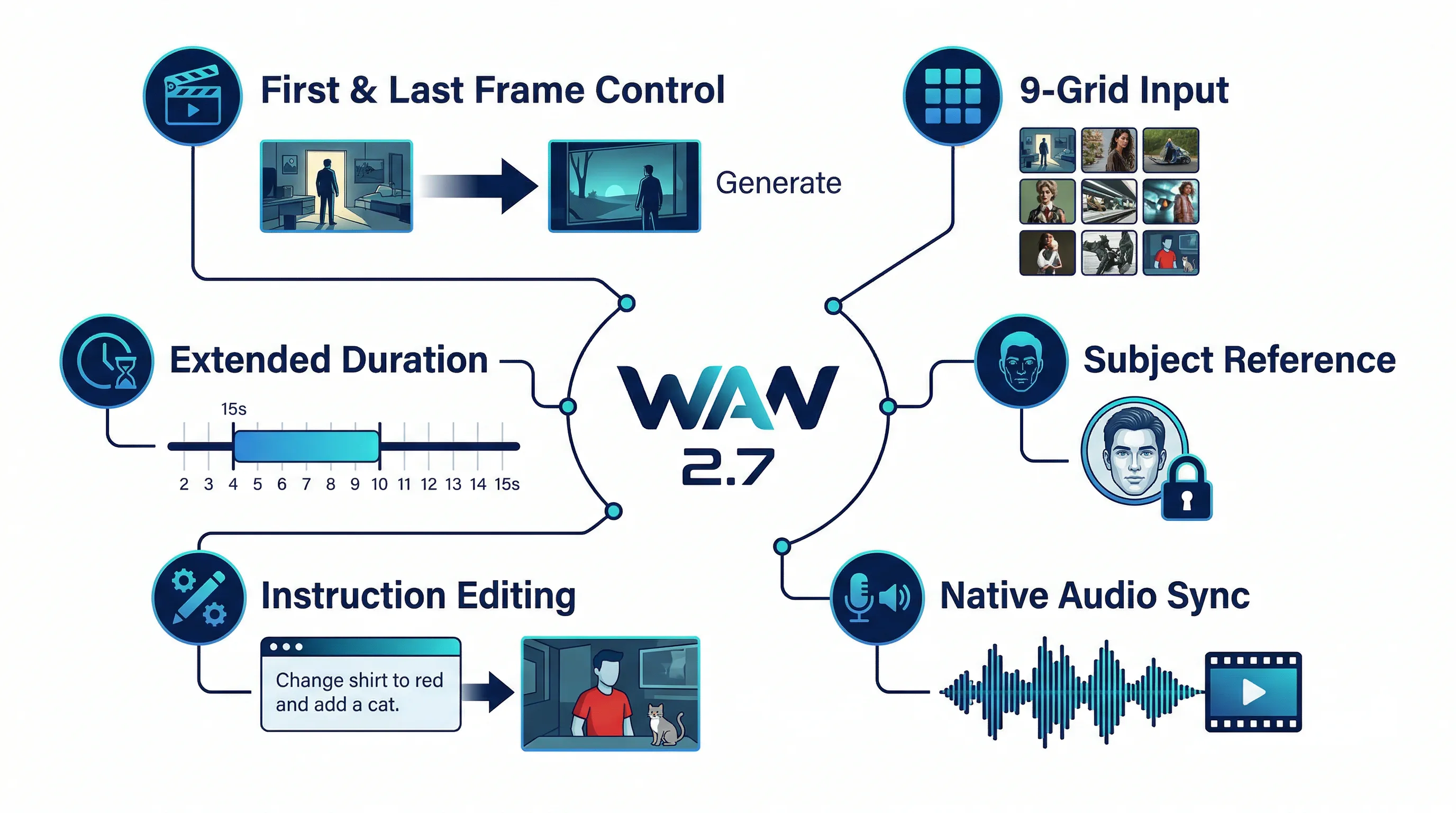

Контроль первого и последнего кадра: точный сторителлинг

Самая обсуждаемая функция Wan 2.7 — генерация по первому и последнему кадру, которая фундаментально меняет подход к созданию видео с помощью ИИ. Вместо того чтобы сгенерировать клип и надеяться, что он закончится там, где вам нужно, вы задаете два референсных изображения: как видео должно выглядеть в начале и как оно должно выглядеть в конце. Затем модель генерирует движение и переход между этими двумя опорами, обеспечивая предсказуемое и управляемое развитие истории.

Это решает одну из самых раздражающих проблем ИИ-видео: непредсказуемую эволюцию сцены. В Wan 2.1 эта возможность существовала как отдельный контрольный чекпойнт (Wan2.1-FLF2V-14B), и авторам приходилось переключаться между версиями. В Wan 2.7 контроль первого и последнего кадра встроен прямо в основную модель, что убирает трение в рабочем процессе и делает многошотовое производство гораздо плавнее. Если ваш процесс начинается не с чистого промпта, а с утвержденных кадров, Wan 2.7 также естественнее подходит для пайплайнов генерации видео по изображениям.

Практическая польза очевидна сразу. Режиссеры-постановщики могут задать точную композицию в начале и конце сцены. Маркетологи могут контролировать точное положение продукта в ключевые моменты. Преподаватели могут обеспечить визуальную непрерывность между учебными фрагментами. Такой уровень контроля переводит генерацию ИИ-видео из экспериментального инструмента в актив, готовый к продакшену.

Генерация видео по изображениям с 9-кадровой сеткой: структурированный визуальный сторителлинг

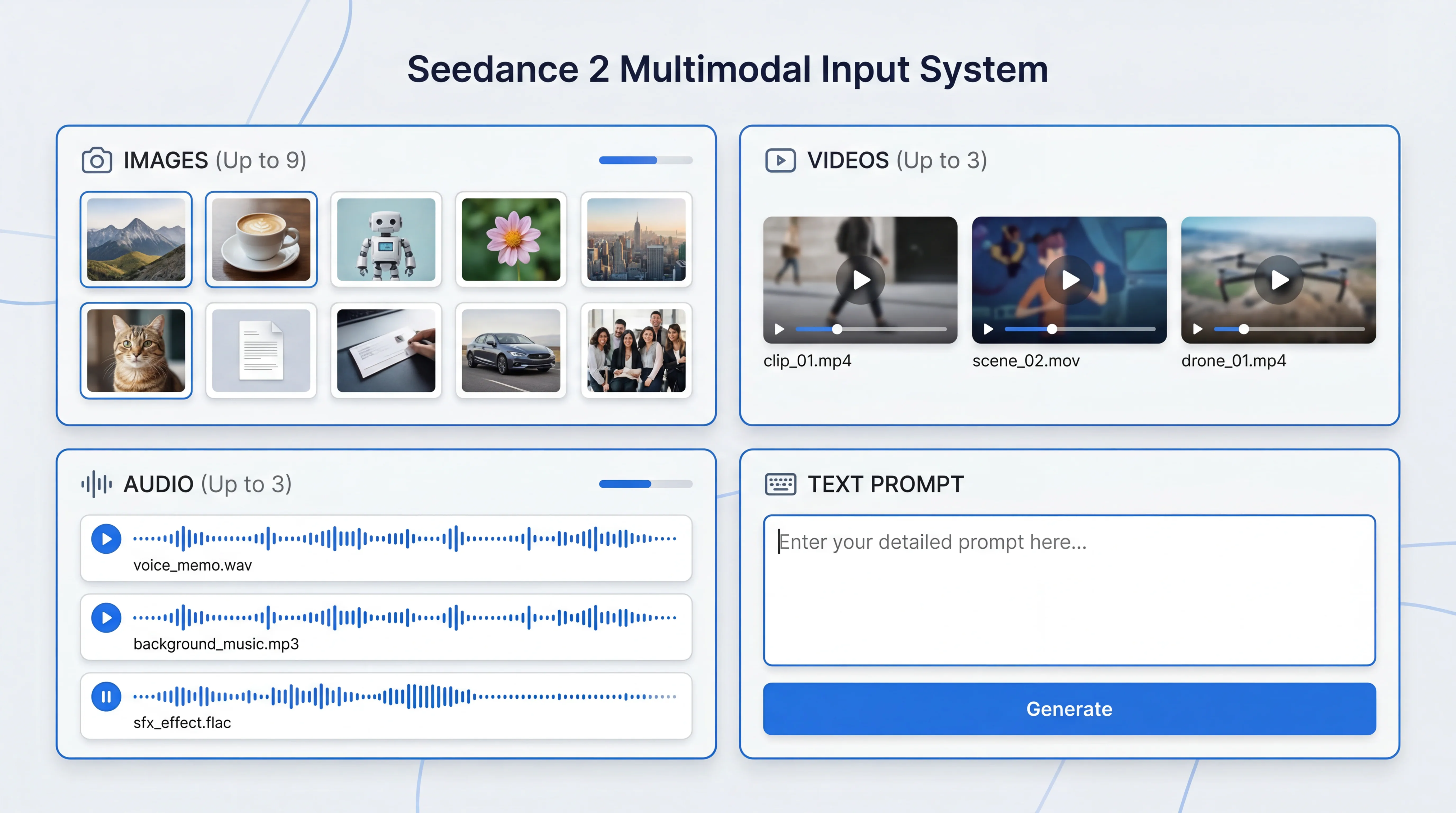

Wan 2.7 представляет революционную систему ввода изображений 9-кадровой сетки (3x3) для генерации видео. Вместо одного референсного изображения авторы подают доску из девяти изображений, которые задают композицию сцены, ракурсы персонажа, условия освещения и визуальный контекст в разных моментах или перспективах. Затем модель синтезирует эти входные данные в цельную анимированную последовательность, сохраняя структурную согласованность на всем протяжении.

Эта функция заполняет разрыв между статическим сторибордом и анимированным результатом так, как не удавалось ни одной предыдущей версии Wan. По сравнению с традиционными авторегрессивными методами генерации видео подход 9-кадровой сетки дает лучшую согласованность, более высокую скорость инференса и лучшую структурную связность. Для продакшен-команд, работающих с детальными раскадровками, это превращает планировочные материалы напрямую в движение без обычного цикла проб и ошибок.

Система 9-кадровой сетки особенно сильна в сценариях со сложными движениями камеры или взаимодействием персонажей. Используя несколько ракурсов, авторы могут направить понимание модели пространственных отношений, глубины и траектории движения, добиваясь результата, который выглядит именно поставленным, а не случайным.

Референсы персонажа и голоса: согласованность идентичности в разных кадрах

Сохранение согласованности персонажа долго было одной из самых сложных задач в генерации ИИ-видео: идентичности легко распадались или «плыли» между кадрами. Wan 2.7 вводит то, что в документации называется "Absolute Identity Lock", систему референса субъекта, которая надежно фиксирует черты лица (уровень глаз, линии подбородка), детали одежды и стили окружения даже при сложных движениях камеры.

Вы загружаете референсное изображение человека, объекта или персонажа, а модель сохраняет эту визуальную идентичность на протяжении всего видео. Это отвечает на главный упрек к Wan 2.5 и 2.6: персонажи не выглядели одинаково от кадра к кадру. Улучшение видно сразу в тестах: заметно меньше смен одежды посреди клипа, морфинга лица и дрейфа идентичности.

Референс голоса расширяет эту согласованность и на звук. Авторы могут подать голосовой образец, а Wan 2.7 будет сохранять эту вокальную идентичность в сгенерированных аудиодорожках, что особенно важно для брендированного контента, нарративов с постоянным персонажем и любых проектов, где нужна узнаваемость голоса. Это ставит Wan 2.7 в прямую конкуренцию с инструментами вроде Kling и Hailuo, которые уже давно предлагают согласованную генерацию идентичности, но у Wan 2.7 этот набор возможностей встроен шире.

Нативная синхронизация звука: звук, который совпадает с движением

В отличие от большинства ИИ-видеомоделей, которые создают немые клипы и требуют ручного наложения звука, Wan 2.7 умеет нативно генерировать звук, синхронизированный напрямую с визуальным рядом. Фоновая музыка, окружающий шум и голос персонажей создаются в унисон с движением сцены сразу, а не добавляются постфактум. Для любого, кто вручную подгонял аудио к ИИ-видео покадрово, это самое практичное улучшение во всем наборе.

Модель поддерживает опциональный аудиовход, так что вы можете подать референсный звук, который повлияет и на визуальную генерацию, и на синхронизированный результат. Такой мультимодальный подход позволяет дать музыкальный трек модели и заставить ритм, монтаж и динамику движения подстраиваться под темп и настроение звука, создавая уровень аудиовизуальной связности, которого раньше можно было добиться только через серьезную постобработку.

Редактирование видео по инструкции: изменения на основе текста

Одна из самых интересных функций Wan 2.7 — редактирование видео по инструкции, то есть возможность менять уже существующее видео простыми текстовыми командами без полной регенерации. Вместо того чтобы начинать заново, когда нужны правки, можно написать "замени фон", "сдвинь освещение в золотой час" или "перекрась одежду в синий", и модель применит изменения, сохранив все остальное.

Такая схема редактирования видео на основе исходного видео снижает сложность входных данных и вычислительную нагрузку, а значит, дает более быстрый результат, чем полная перегенерация. Для итеративных творческих процессов это очень важно: можно дорабатывать результат точечно, а не каждый раз бросать кости в новой генерации. Функция особенно полезна для агентств, которые адаптируют существующие материалы под сезонные кампании, и для бренд-команд, которым нужно сохранять визуальную консистентность продукта в нескольких сценах без пересъемки.

Увеличенная длительность и режим продолжения съемки: выход за пределы фрагмента

Одно из главных ограничений ранних видеомоделей — длина повествования, обычно ограниченная короткими 3-4-секундными фрагментами. Wan 2.7 решает это через режим продолжения съемки, интеллектуальную систему расширения, которая позволяет бесконечно наращивать существующий видеоматериал. Модель поддерживает длительность от 2 до 15 секунд за одну генерацию, что делает ее одной из немногих крупных моделей, способных уверенно работать с клипами длиннее 10 секунд.

Эта увеличенная длительность вместе с контролем первого и последнего кадра дает возможность строить по-настоящему многошотовые истории. Авторы могут связывать сцены друг с другом предсказуемыми переходами, создавая более длинный контент, который сохраняет визуальную и стилевую цельность на протяжении всего ролика. Для профессионального видеопайплайна это критически важно.

Технические характеристики и качество результата

Wan 2.7 генерирует видео в нативном разрешении 1080P HD, а для более быстрого рендера доступен и 720P. Модель выдает 24 кадра в секунду, что соответствует кинематографическому стандарту. Время генерации зависит от длительности и разрешения, но архитектура модели явно ставит качество выше скорости, то есть это инструмент для продакшена, а не для быстрого прототипирования.

Визуальное качество модели заметно выросло по сравнению с Wan 2.6 сразу в нескольких измерениях. Согласованность стиля стала значительно лучше: модель надежнее удерживает кинематографичный реализм, аниме-эстетику и иллюстративные стили от кадра к кадру, а это важно для контента, в котором визуальная идентичность должна читаться на протяжении всего ролика. Временная согласованность тоже сильно улучшилась: стало меньше мерцающих лиц, смен одежды посреди клипа и ситуаций, когда персонажи слегка «плывут» между переходами.

Динамика движения тоже стала заметно лучше. На тесте с летящим орлом движение крыльев выглядело чисто, с аккуратной глубиной резкости и естественной пластикой, без дерганых артефактов, типичных для более ранних моделей. Панорамы пейзажей показывают плавное движение облаков и объем атмосферы, а модель уверенно работает с негативными промптами, подавляя такие артефакты, как размытие, искажения и водяные знаки.

Как Wan 2.7 выглядит на фоне конкурентов

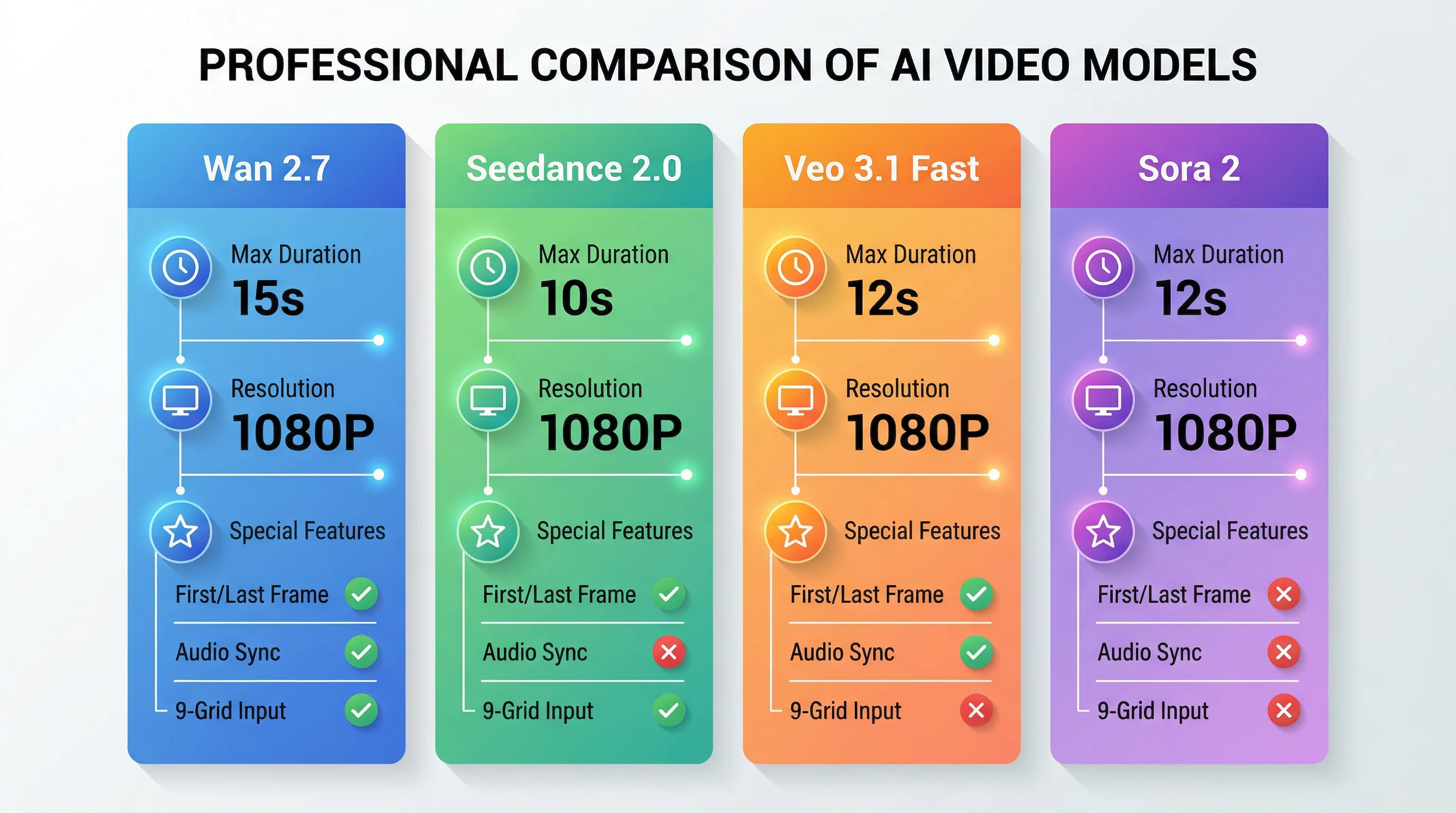

Wan 2.7 vs Seedance 2.0: функции против цены

Seedance 2.0 от ByteDance дает лучшее соотношение цены и качества для высококлассного движения при самой низкой стоимости за секунду на рынке. Но Wan 2.7 — это швейцарский нож сравнения: больше всего функций, больше всего гибкости и лучшая совместимость с рабочими процессами, где важна синхронизация аудиовхода или контроль кадр к кадру.

Seedance 2.0 ограничивается клипами до 10 секунд и не предлагает ни контроля первого и последнего кадра, ни аудиовхода. Зато она интерпретирует промпты с чуть большей творческой свободой, что может быть как плюсом, так и минусом в зависимости от задачи. Seedance обычно быстрее при API-генерации, так что она идеально подходит для быстрой итерации и тестов. Многие продакшен-команды используют Seedance 2.0 для проверки идей, а финальный результат генерируют в Wan 2.7, когда нужны уникальные творческие контролы. Если вам интересны более глубокие компромиссы продакшена, посмотрите отдельный обзор Seedance 2 и старое сравнение Seedance 2 и Wan 2.6.

Wan 2.7 vs Veo 3.1: контроль против физики

Google Veo 3.1 Fast лидирует по физической реалистичности и является единственной моделью в сравнении, которая предлагает и авто-генерируемый звук, и клипы до 12 секунд по цене $0.10 за секунду. Veo 3.1 выдает кинематографичное качество при 24 fps с нативной генерацией звука, включая фоновые шумы, диалоги и музыку, полностью синхронизированные с картинкой. Однако Veo 3.1 Lite ограничена 8 секундами и не дает той степени детального контроля, которую задает Wan 2.7.

Сильная сторона Wan 2.7 — точное управление сценой через опоры первого и последнего кадра, композицию 9-кадровой сетки и редактирование по инструкции. Veo 3.1 делает ставку на реалистичную физику и естественность движения, поэтому она лучше подходит для сценариев, где реализм важнее управляемости. Выбор между ними зависит от того, что для вашего процесса важнее: управляемость (Wan 2.7) или физическая натуральность (Veo 3.1). Более полный разбор физики и звука можно найти в отдельном обзоре Veo 3.1.

Wan 2.7 vs Sora 2: производственный инструмент против экспериментальной платформы

OpenAI Sora 2 лидирует по физической реалистичности и предлагает 12-секундные клипы с авто-генерируемым звуком. Но Sora по-прежнему позиционируется как более экспериментальная система с меньшим акцентом на интеграцию в продакшен-процессы. Набор возможностей Wan 2.7, особенно контроль первого и последнего кадра, вход 9-кадровой сетки и редактирование по инструкции, явно спроектирован под то, как реально работают профессиональные контент-процессы: у вас есть раскадровка, персонаж и четко заданные старт и финиш каждой сцены. Wan 2.7 подстраивается под эту структуру, а не идет ей наперекор. Если вы сравниваете флагманские модели по всей категории, полезным дополнением будет более широкое сравнение ИИ-моделей видео.

Таблица сравнения моделей

| Функция | Wan 2.7 | Seedance 2.0 | Veo 3.1 Fast | Sora 2 |

|---|---|---|---|---|

| Макс. длительность | 15 секунд | 10 секунд | 12 секунд | 12 секунд |

| Макс. разрешение | 1080P | 1080P | 1080P | 1080P |

| Контроль первого/последнего кадра | ✓ | ✗ | ✗ | ✗ |

| Синхронизация аудиовхода | ✓ | ✗ | ✗ | ✗ |

| Нативная генерация звука | ✓ | ✗ | ✓ | ✓ |

| Вход 9-кадровой сетки | ✓ | ✗ | ✗ | ✗ |

| Редактирование по инструкции | ✓ | ✗ | ✗ | ✗ |

| Референс субъекта | ✓ | ✓ | ✓ | ✓ |

| Негативные промпты | ✓ | Ограничено | ✗ | ✗ |

| Модель оплаты | Кредиты (не сгорают) | За генерацию | За генерацию | Подписка |

| Коммерческое использование | Все тарифы | Все тарифы | Все тарифы | Зависит |

Реальные сценарии и интеграция в рабочие процессы

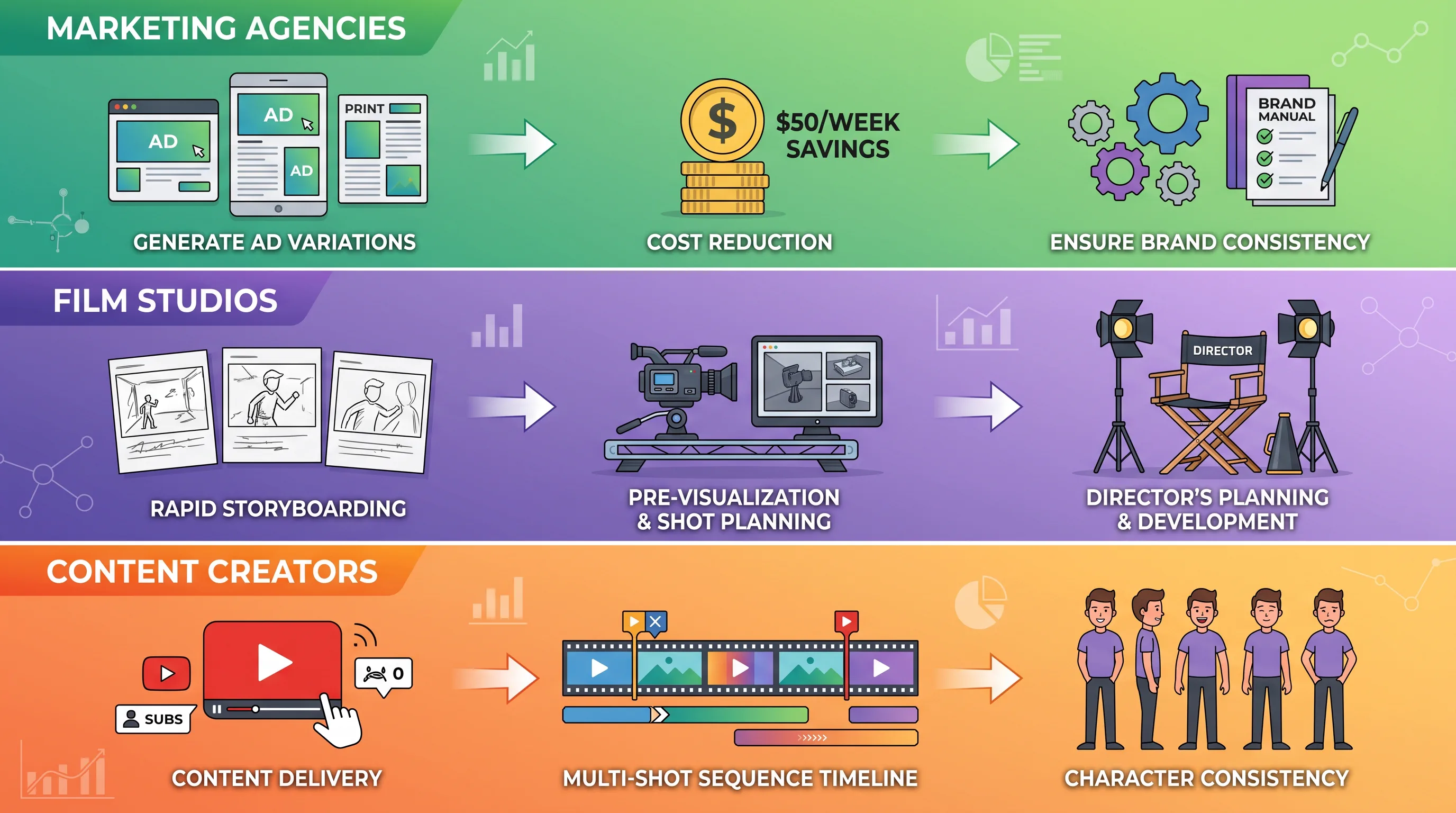

Маркетинговые агентства: программная генерация рекламных вариантов

Агентство, которое выпускает 50 рекламных вариантов в неделю, может автоматизировать сырой этап генерации менее чем за $50 в кредитах, оставляя человеку стратегию и финальную проверку. Это позволяет перераспределить бюджет с ручного производства на творческую стратегию. Отсутствие подписки означает, что нет ежемесячной платы за место, нет привязки к платформе и нет минимального порога использования. Вы платите за каждую генерацию, что отлично ложится на performance-маркетинг. Команды, выстраивающие повторяемые рекламные системы, обычно дополняют это четким референсом цен Seedance 2 или сравнительной статьей для более быстрых итераций.

Бренд-команды могут использовать референс субъекта, чтобы сохранять визуальную консистентность продукта в разных сгенерированных сценах. Функция редактирования видео на основе исходного материала позволяет брать существующий материал и применять новые стили или сезонные адаптации без пересъемки, что критично для поддержания брендовой целостности при смене кампаний.

Киноиндустрия: превизуализация и быстрое прототипирование

ИИ-превизуализация становится все более популярной темой в производстве видео, и набор возможностей Wan 2.7 напрямую решает эту задачу. Режиссеры могут использовать 9-кадровые раскадровки, чтобы визуализировать сложные сцены до того, как тратить деньги на съемку. Контроль первого и последнего кадра помогает точно планировать сцену, а референс субъекта сохраняет согласованность персонажа на этапе превиза.

Возможность генерировать клипы до 15 секунд с нативным звуком делает модель пригодной не только для коротких тестов, но и для полноценной превизуализации сцен. Производственные команды могут отрабатывать блокинг, движение камеры и темп с реальным движением и звуком еще до выхода на площадку, сокращая дорогие эксперименты на съемке.

Создатели контента: многошотовое повествование

Для YouTube-авторов, преподавателей и нарративных контент-креаторов режим продолжения съемки и увеличенная длительность Wan 2.7 позволяют строить настоящие многошотовые истории. Комбинация контроля первого и последнего кадра с референсом субъекта дает возможность сохранять одинакового персонажа во всей видеопоследовательности, решая проблему, которая преследует ИИ-видео с самого начала.

Редактирование по инструкции особенно полезно для итеративной доработки контента. Вместо того чтобы пересоздавать целые клипы при каждой правке, можно вносить точечные изменения текстовыми командами, радикально сокращая время итераций и вычислительные затраты.

Техническая интеграция: API и поддержка платформ

Wan 2.7 доступна через несколько API-провайдеров, включая Together AI, Segmind и прямой доступ через Alibaba Model Studio. В реализации Together AI используется конечная точка Wan-AI/Wan2.7-T2V, поддерживаются стандартные REST-запросы с JSON-полезной нагрузкой. Аутентификация идет через заголовки с API-ключом, а модель работает на serverless-инфраструктуре Together AI для масштабируемого развертывания.

Интеграции на платформах быстро расширяются. Wan 2.7 уже доступна на Picsart, SeaArt AI, EaseMate AI, WaveSpeedAI и MindStudio, среди прочих. Библиотека моделей SeaArt AI позволяет авторам работать сразу с несколькими ИИ-видеомоделями без переключения платформ, что дает прямое сравнение Wan 2.7, Seedance, Veo и других моделей в одном рабочем процессе.

Интеграция MindStudio особенно интересна для автоматизации. Платформа позволяет строить ИИ-агентов, которые отслеживают новые изображения продуктов в папке Google Drive, генерируют видео через Wan 2.7, выполняют постобработку (увеличение разрешения, замена лица, слияние клипов, генерация субтитров) и отправляют готовые ролики в Slack без участия человека. Такой уровень интеграции превращает Wan 2.7 из инструмента генерации в элемент производственного пайплайна.

Цены и коммерческое лицензирование

Wan 2.7 использует кредитную модель без ежемесячной абонплаты. Кредиты не сгорают, что является серьезным преимуществом перед большинством ИИ-видеосервисов, которые сбрасывают неиспользованный лимит в конце расчетного периода. Коммерческое использование включено во все платные тарифы, а лицензия достаточно мягкая и соответствует историческому подходу серии Wan.

Точная цена зависит от провайдера платформы, но общая структура явно выгодна для рабочих процессов с переменной нагрузкой. Для технических покупателей, которые смотрят официальную документацию, вызываемые API и опубликованные прайс-таблицы, публично задокументированные видеопредложения Alibaba дают более ясное понимание условий выполнения, чем у многих конкурентов.

Настройка параметров и проработка промптов

| Параметр | Диапазон | Рекомендация | Назначение |

|---|---|---|---|

| Длительность | 2-15 секунд | 5-8 секунд | Баланс качества и времени генерации |

| Разрешение | 720P, 1080P | 1080P для финала, 720P для тестов | Качество результата и скорость |

| Соотношение сторон | 16:9, 4:3, 9:16 | 16:9 для веба, 9:16 для мобильных | Оптимизация под платформу |

| Негативный промпт | Текстовая строка | blurry, distorted, watermark | Подавление артефактов |

| Расширение промпта | Логический флаг | Включено | Улучшенная интерпретация деталей |

| Аудиовход | Необязательный файл | Использовать для синхронизации ритма | Аудиовизуальная связность |

| Опорные кадры | 0-2 изображения | Использовать для управления сценой | Предсказуемые переходы |

Wan 2.7 хорошо реагирует на подробные описательные промпты с уточнениями по сцене, свету, движению камеры и действию. Модель выигрывает от структурированной проработки промптов, где описание сцены, детали персонажа, направление движения и стилистические предпочтения разделены на отдельные блоки. Негативные промпты надежно подавляют распространенные артефакты, но не спасут откровенно слабые входные изображения. Если вам нужен более сильный шаблон промптов для продакшена, все еще стоит подсмотреть руководство по промптам Seedance 2 — принципы работы с камерой и блокингом сцены там хорошо переносятся.

Ограничения и важные замечания

Несмотря на богатый набор функций, у Wan 2.7 есть ограничения, о которых стоит помнить. Модель делает ставку на качество, а не на скорость, поэтому генерирует медленнее, чем конкуренты вроде Seedance 2.0 или Veo 3.1 Lite. Для быстрого прототипирования, где нужны десятки быстрых итераций, это может стать узким местом. Обычно разумный подход — использовать более быстрые модели для первичного тестирования и оставлять Wan 2.7 для финальных продакшен-генераций, где ее уникальные возможности приносят пользу.

Хотя временная согласованность сильно улучшилась по сравнению с Wan 2.6, она все еще не идеальна. Сложные сцены с несколькими движущимися объектами или резкими движениями камеры могут по-прежнему давать легкое мерцание или небольшие проблемы с консистентностью, хотя и заметно реже, чем в ранних версиях. Модель лучше всего работает с четкими, хорошо структурированными промптами и качественными входными изображениями. Принцип «что подали, то и получили» по-прежнему действует.

Функция 9-кадровой сетки, несмотря на новизну, требует аккуратной подготовки входных изображений, чтобы показать себя наилучшим образом. Плохо скомпонованные или несогласованные элементы сетки могут запутать пространственное понимание модели и ухудшить результат. Эта возможность особенно хороша, когда она встроена в структурированные рабочие процессы раскадровки, а не используется для случайных экспериментов.

Почему Seedance AI дает лучший доступ к Wan 2.7

Для авторов и продакшен-команд, которые хотят использовать возможности Wan 2.7, Seedance AI предоставляет самый полный доступ. Платформа объединяет несколько передовых моделей генерации видео и изображений в одном интерфейсе, избавляя от необходимости вести отдельные аккаунты и рабочие процессы у разных провайдеров. Такой подход заметно снижает трение в мульти-модельных сценариях, что особенно важно, когда нужно сравнивать результаты или использовать разные модели на разных этапах производства. Если нужен сначала прямой обзор продукта, можно сразу перейти на страницу модели Wan 2.7 Video.

Seedance AI предлагает особенно удобный формат единой платформы для создания контента с ИИ. Она поддерживает не только Wan 2.7, но и другие флагманские модели, такие как собственные видеогенераторы Seedance, Kling, Veo и ведущие системы генерации изображений. Благодаря этому вы можете проверить контроль первого и последнего кадра Wan 2.7 против скорости Seedance 2.0 или сравнить согласованность референса субъекта на нескольких моделях, не выходя из одного рабочего пространства. Для агентств и студий, работающих с разными типами контента, такая гибкость особенно ценна.

Интерфейс платформы заточен под продакшен-процессы: пакетная генерация, организация проектов и встроенные инструменты постобработки. Вы можете генерировать в Wan 2.7, применять увеличение разрешения или редактирование и экспортировать готовые материалы, не покидая платформу. Для команд, которые оценивают, стоит ли уникальный набор функций Wan 2.7 встраивать в их пайплайн, Seedance AI дает самый низкий порог входа.

Итог: ИИ-видео готово к продакшену

Wan 2.7 действительно выполняет то, что категория генерации видео по тексту обещала уже два года: качество на уровне продакшена через доступные API и такую цену, при которой программная генерация видео становится реальной для коммерческих процессов. Комплексный набор возможностей модели — контроль первого и последнего кадра, композиция 9-кадровой сетки, референсы субъекта и голоса, нативная синхронизация звука и редактирование по инструкции — означает фундаментальный переход от экспериментальных генераторов к компонентам производственного пайплайна.

Для режиссеров, YouTube-авторов, маркетологов и агентских команд, которым нужны многошотовые видео со звуком и точным управлением, набор функций Wan 2.7 соответствует тому, как на самом деле работают профессиональные контент-процессы. У вас есть раскадровка, у вас есть персонаж, у вас есть четко заданные начало и конец каждой сцены. Wan 2.7 работает вместе с этой структурой, а не против нее. Модель не идеальна и не самая быстрая на рынке, но это самая функциональная и управляемая ИИ-модель для видео в ландшафте 2026 года.

Настоящий вопрос не в том, переоценена ли Wan 2.7. Вопрос в том, приносит ли ее уникальный контроль реальную пользу именно вашему рабочему процессу. Если вы создаете контент, которому нужна согласованность персонажей между кадрами, точные переходы между сценами, синхронизация аудио и видео или итеративное редактирование без полной перегенерации, Wan 2.7 — один из сильнейших доступных вариантов. Для быстрого прототипирования или сценариев, где скорость важнее контроля, могут лучше подойти Seedance 2.0 или Veo 3.1 Lite. Разумная стратегия — добавить Wan 2.7 в арсенал там, где ее возможности дают явную ценность, и при этом оставить в доступе более быстрые модели для итераций.

Генерация ИИ-видео прошла путь от экспериментальной новинки до полноценного производственного инструмента. Wan 2.7 — это текущее состояние искусства в области управляемой и функционально богатой генерации видео, а такие платформы, как Seedance AI, делают доступ и интеграцию этих возможностей в реальные рабочие процессы практичнее, чем когда-либо.