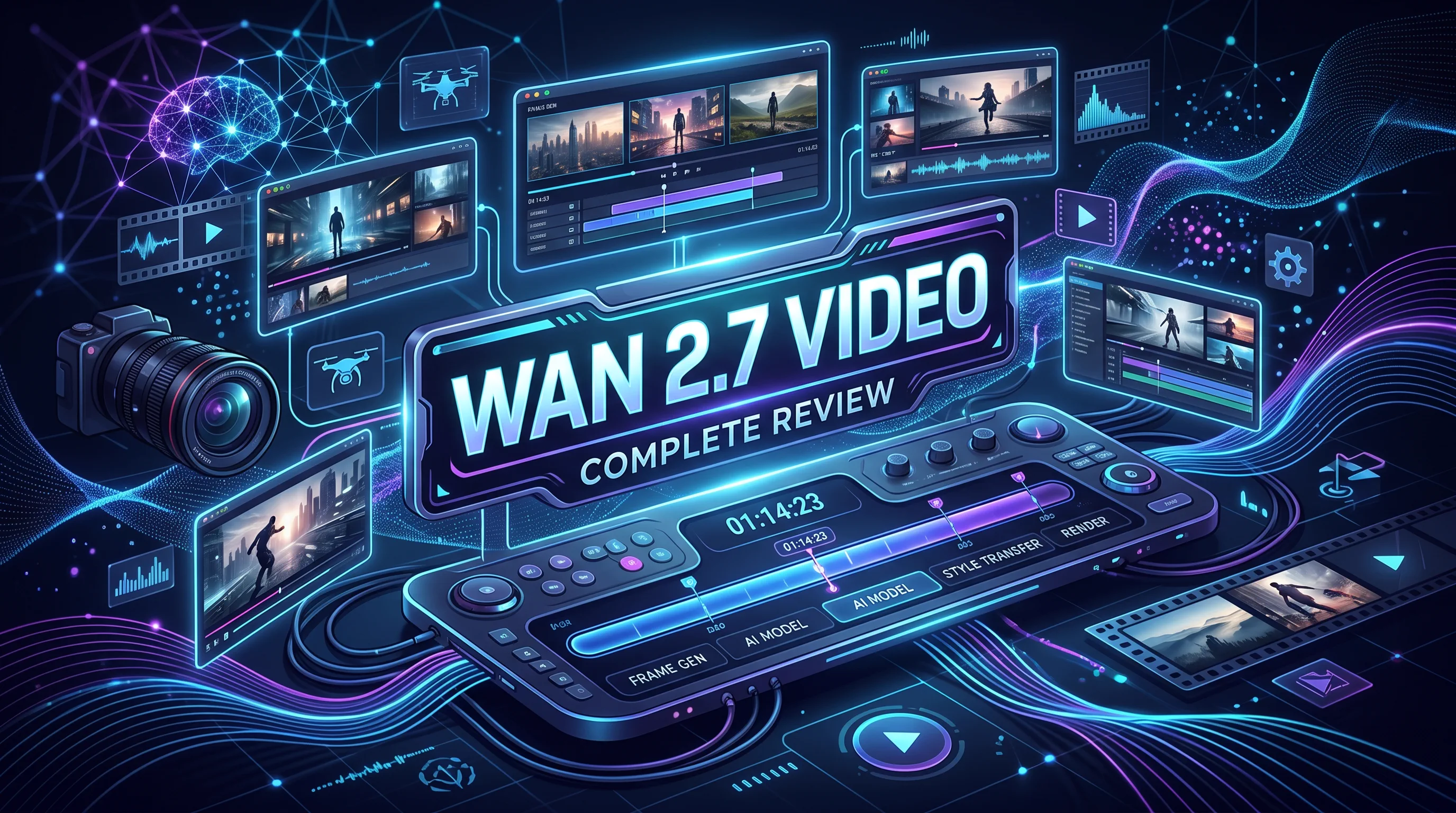

Toda conversa com criadores neste trimestre acaba voltando para um modelo: Wan 2.7. Desenvolvido pelo Tongyi Lab da Alibaba, esta iteração mais recente se tornou a análise mais procurada no espaço de geração de vídeo por IA, não por hype de marketing, mas porque ataca a frustração mais persistente que os criadores enfrentam: manter personagens consistentes, controle preciso de cena e saída com qualidade de produção em várias tomadas. Depois de testes extensivos em fluxos reais de produção, esta análise completa detalha o que Wan 2.7 Video realmente entrega, onde ele se destaca e como se compara com modelos concorrentes em 2026.

O Que é o Wan 2.7 e Por Que Ele Importa?

Wan 2.7 é um modelo de geração de vídeo por IA de última geração, construído sobre uma arquitetura Mixture-of-Experts (MoE) de 27 bilhões de parâmetros. Diferentemente de seus antecessores, o Wan 2.7 representa uma mudança fundamental da geração pura de texto para vídeo para um kit abrangente de produção de vídeo com mecanismos estruturados de controle. O modelo gera vídeos cinematográficos em HD 1080P a partir de descrições em texto, imagens e até entradas de áudio, combinando fidelidade visual, sincronização de áudio e consistência de movimento em uma única estrutura unificada.

O que diferencia o Wan 2.7 das versões anteriores e de modelos concorrentes não é apenas o número de parâmetros ou a resolução. O verdadeiro avanço está nas capacidades de injeção multimodal e no conjunto de recursos orientado à produção. Enquanto o Wan 2.6 exigia que os criadores escrevessem uma instrução e esperassem que a IA entendesse a intenção, muitas vezes resultando em distorções visuais e saídas imprevisíveis, o Wan 2.7 permite a injeção direta de imagens, vídeos e áudio para interpretar movimento e iluminação com precisão 1:1. Isso traduz a intenção exata do criador em visuais cinematográficos hiper-realistas com uma precisão inédita.

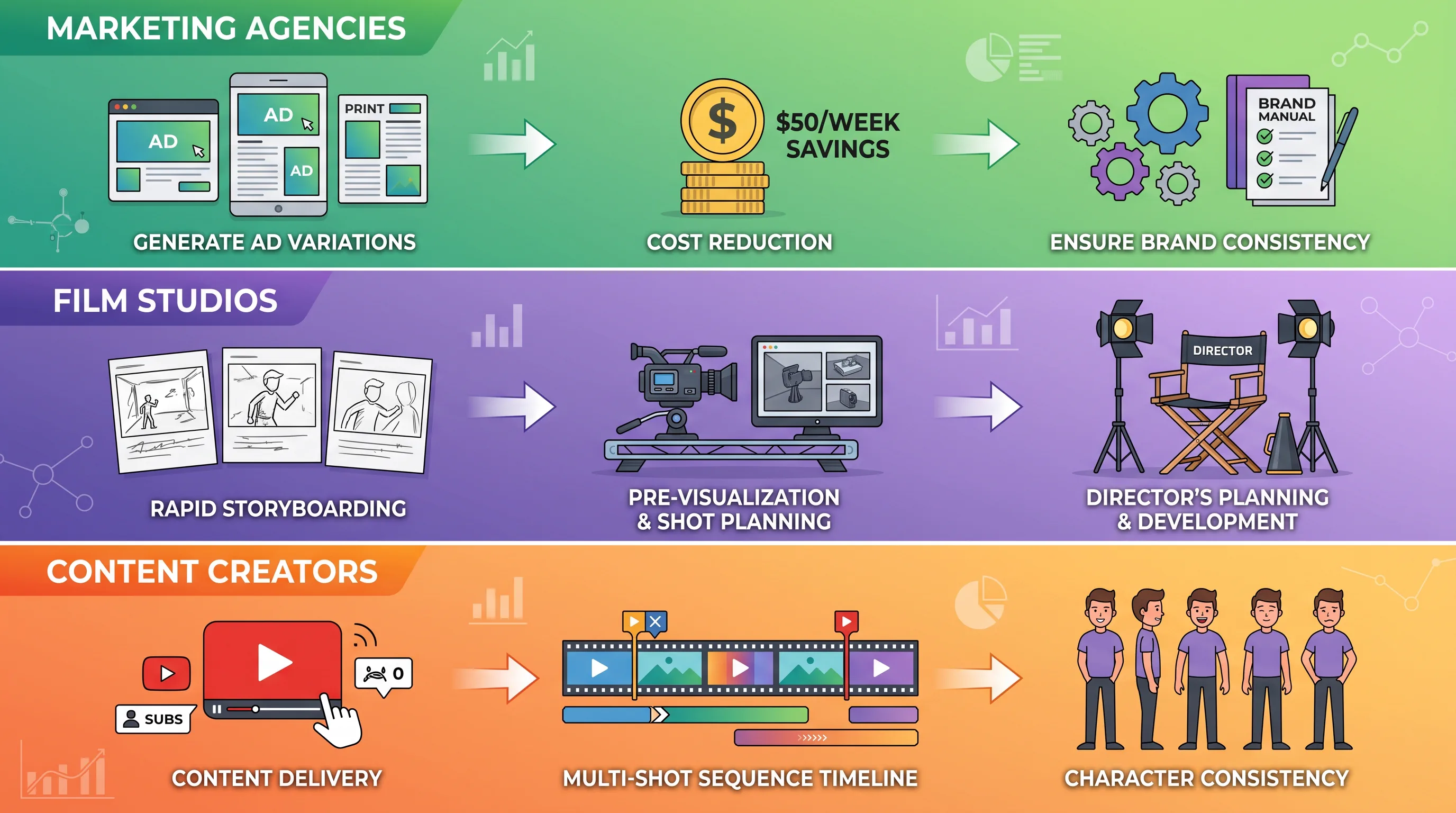

A viabilidade comercial do modelo é igualmente importante. O Wan 2.7 opera com um modelo de preços baseado em créditos, sem mensalidade, sem bloqueio de plataforma e com créditos que nunca expiram. Para agências que produzem 50 variações de anúncios por semana, isso significa automatizar a geração bruta com menos de US$ 50 em créditos, enquanto realocam o tempo humano para estratégia e revisão final, uma mudança significativa na economia de produção.

Recursos centrais que redefinem a geração de vídeo com IA

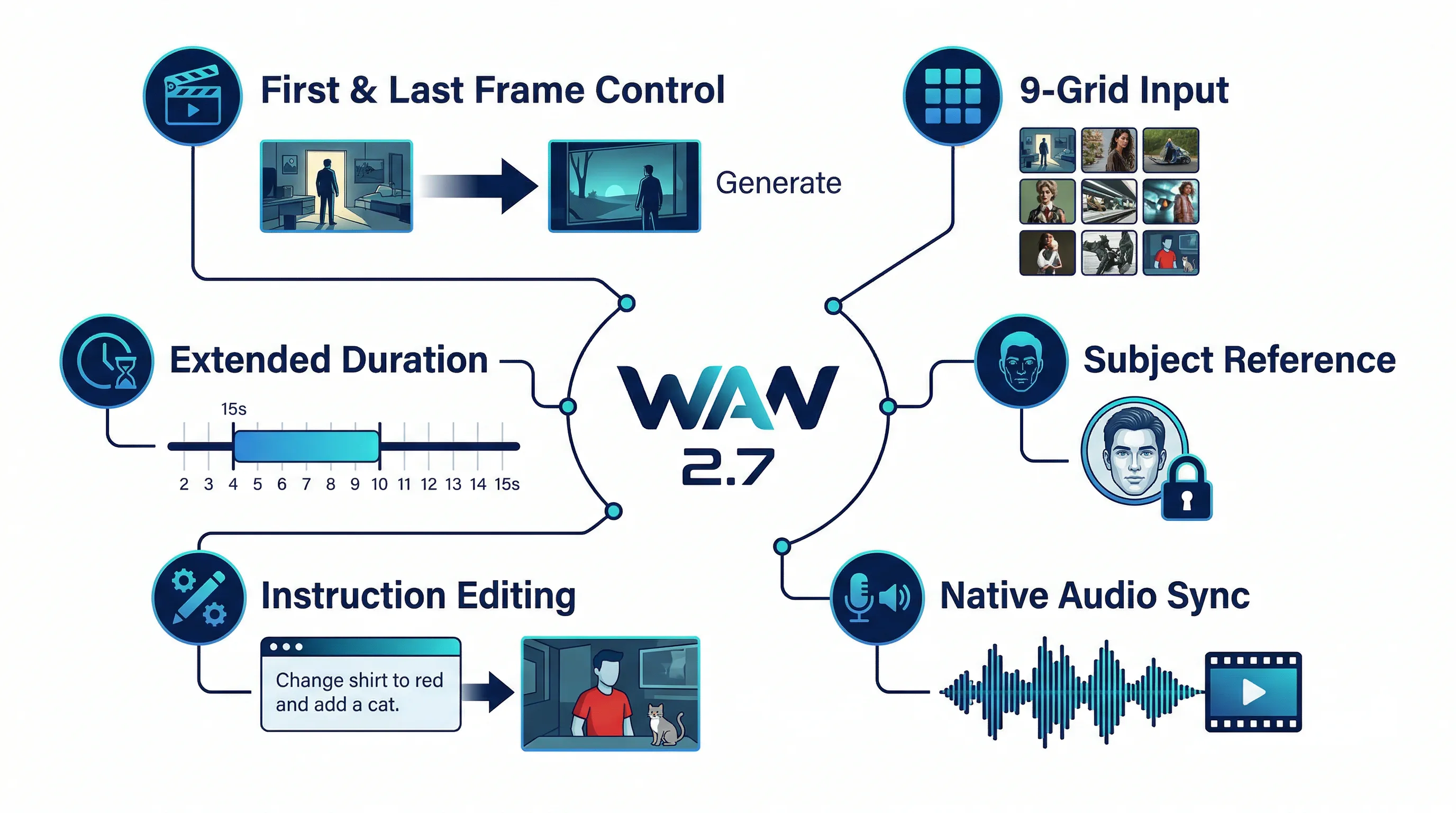

Controle de primeiro e último frame: narrativa precisa

O recurso mais comentado do Wan 2.7 é a geração com primeiro e último frame, uma capacidade que muda de forma fundamental a maneira como os criadores abordam a produção de vídeo com IA. Em vez de gerar um clipe e torcer para que ele chegue onde você precisa, você fornece duas imagens de referência: como o vídeo deve parecer no início e como deve parecer no final. O modelo então gera o movimento e a transição entre esses dois pontos de ancoragem, oferecendo uma progressão narrativa previsível e controlável.

Isso resolve uma das frustrações mais persistentes com vídeo por IA: a evolução imprevisível da cena. No Wan 2.1, essa capacidade existia como um checkpoint separado de modelo (Wan2.1-FLF2V-14B), exigindo que os criadores alternassem entre versões diferentes. No Wan 2.7, o controle de primeiro e último frame está integrado diretamente ao modelo principal, eliminando atrito no fluxo e permitindo produção fluida em múltiplas tomadas. Se o seu fluxo começa com imagens aprovadas em vez de instruções brutas, isso também torna o Wan 2.7 uma opção mais natural para pipelines de imagem para vídeo.

As aplicações práticas são imediatas. Para cineastas que fazem storyboard de uma sequência, é possível definir a composição exata nos pontos de entrada e saída da cena. Para profissionais de marketing que criam demos de produto, você controla a posição exata do produto em momentos-chave. Para educadores que produzem conteúdo tutorial, você garante continuidade visual entre segmentos instrucionais. Esse nível de controle leva a geração de vídeo por IA de ferramenta experimental a ativo pronto para produção.

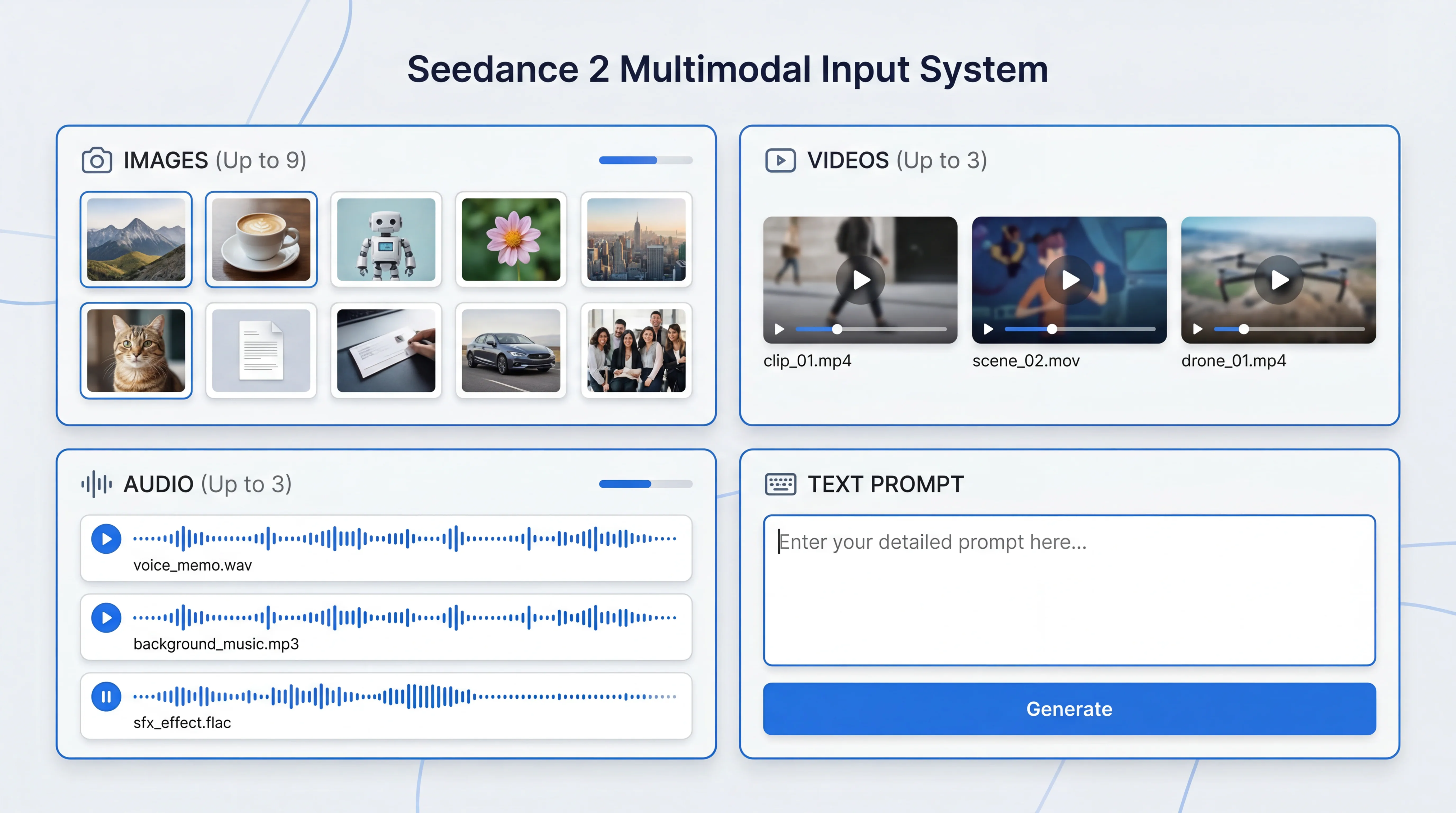

Imagem para vídeo em grade 9x9: narrativa visual estruturada

O Wan 2.7 introduz um sistema revolucionário de entrada de imagem em grade 9x9 para geração de vídeo. Em vez de fornecer uma única imagem de referência, os criadores entregam uma matriz de nove imagens que definem composição da cena, ângulos do personagem, condições de iluminação e contexto visual em diferentes momentos ou perspectivas. O modelo então sintetiza essas entradas em uma sequência animada coesa que mantém consistência estrutural do começo ao fim.

Esse recurso faz a ponte entre o planejamento estático de storyboard e a saída animada de uma forma que nenhum modelo Wan anterior conseguia alcançar. Em comparação com métodos tradicionais autoregressivos de vídeo por IA, a abordagem em grade 9x9 oferece consistência superior, velocidade de inferência mais rápida e melhor coerência estrutural. Para equipes de produção que trabalham a partir de storyboards detalhados, isso transforma os ativos de planejamento diretamente em movimento, sem o ciclo usual de tentativa e erro.

O sistema 9x9 se destaca especialmente em cenários que exigem movimentos complexos de câmera ou interações entre personagens. Ao fornecer vários ângulos de referência, os criadores podem orientar o entendimento do modelo sobre relações espaciais, profundidade e trajetórias de movimento, resultando em saídas que parecem coreografadas intencionalmente, e não geradas aleatoriamente.

Referência de personagem e voz: consistência de identidade entre tomadas

Manter a consistência de personagem sempre foi notoriamente difícil na geração de vídeo por IA, onde identidades facilmente se desfazem ou derivam entre quadros. O Wan 2.7 introduz o que a documentação chama de "Absolute Identity Lock", um sistema de referência de personagem que fixa perfeitamente traços faciais (altura dos olhos, linhas do queixo), detalhes de roupas e estilos ambientais ao longo de movimentos de câmera complexos.

Você fornece uma imagem de referência de uma pessoa, objeto ou personagem, e o modelo mantém essa identidade visual durante todo o vídeo gerado. Isso resolve a principal reclamação sobre Wan 2.5 e 2.6: personagens que não pareciam os mesmos de um quadro para outro. A melhoria é imediatamente perceptível nos testes, com muito menos trocas de figurino no meio do clipe, deformação facial ou desvio de identidade.

A referência de voz estende essa consistência ao áudio. Os criadores podem fornecer uma amostra de voz, e o Wan 2.7 mantém essa identidade vocal ao longo das trilhas de áudio geradas, o que é crucial para conteúdo de marca, narrativas centradas em personagem ou qualquer projeto que exija consistência vocal reconhecível. Isso coloca o Wan 2.7 em competição direta com ferramentas como Kling e Hailuo, que já ofereciam geração consistente de identidade há algum tempo, mas agora com uma integração mais ampla de recursos.

Sincronização nativa de áudio: som que combina com o movimento

Diferentemente da maioria dos modelos de vídeo por IA, que geram clipes sem som e exigem camada de áudio manual, o Wan 2.7 inclui geração nativa de áudio sincronizada diretamente ao conteúdo visual. Música de fundo, som ambiente e vocais dos personagens são gerados em sincronia com o movimento da cena desde o início, e não adicionados depois. Para quem já precisou alinhar áudio e vídeo quadro a quadro, isso representa a melhoria mais imediatamente prática de todo o conjunto de recursos.

O modelo suporta entrada opcional de áudio, permitindo que os criadores forneçam um áudio de referência que influencia tanto a geração visual quanto a saída sincronizada. Essa abordagem multimodal significa que você pode inserir uma faixa musical e fazer com que o ritmo, os cortes e a dinâmica de movimento do vídeo respondam ao ritmo e ao tom emocional do áudio, criando um nível de coerência audiovisual que antes só era possível com um trabalho extenso de pós-produção.

Edição de vídeo guiada por instruções: modificações por texto

Um dos recursos mais inovadores do Wan 2.7 é a edição de vídeo guiada por instruções, a capacidade de modificar vídeos existentes por meio de comandos de texto simples sem regenerar tudo do zero. Em vez de começar do início quando precisar de ajustes, você pode digitar comandos como "substitua o fundo", "mude a iluminação para hora dourada" ou "pinte a roupa de azul" e fazer com que o modelo aplique essas edições preservando todos os outros elementos.

Essa capacidade de edição vídeo para vídeo reduz a complexidade dos dados de entrada e a carga computacional, entregando resultados mais rápidos do que uma regeneração completa. Para fluxos criativos iterativos, isso é transformador. Você pode refinar saídas com ajustes direcionados em vez de apostar tudo em novas gerações. O recurso é especialmente valioso para agências que aplicam tratamentos sazonais a filmagens existentes ou para equipes de marca que precisam manter consistência visual de produto em várias cenas sem refilmar.

Duração estendida e filmagem contínua: quebrando o limite dos fragmentos

Uma das maiores restrições dos modelos de vídeo de primeira geração era o comprimento narrativo, normalmente limitado a segmentos de 3 a 4 segundos em uma única tomada. O Wan 2.7 resolve isso com o recurso de filmagem contínua, um sistema inteligente de extensão que permite expansão infinita de materiais de vídeo existentes. O modelo suporta durações de saída de 2 a 15 segundos em uma única geração, tornando-o a única opção entre os principais concorrentes para clipes com mais de 10 segundos.

Essa capacidade de duração estendida, combinada com o controle de primeiro e último frame, permite uma construção narrativa real em múltiplas tomadas. Os criadores podem encadear sequências com transições previsíveis, construindo conteúdos mais longos que mantêm consistência visual e estilística ao longo de todo o percurso, um requisito crítico para fluxos de conteúdo profissionais.

Especificações Técnicas e Qualidade de Saída

O Wan 2.7 gera vídeo em resolução nativa HD 1080P, com 720P também disponível para processamento mais rápido. O modelo entrega em 24 fps, alinhando-se às taxas de quadros padrão de cinema para movimentos com qualidade profissional. Os tempos de geração variam conforme duração e resolução, mas a arquitetura prioriza qualidade em vez de velocidade, um compromisso deliberado que o posiciona como ferramenta de produção, não como sistema de prototipagem rápida.

A qualidade visual do modelo representa uma melhoria significativa em relação ao Wan 2.6 em várias dimensões. A consistência de estilo está visivelmente mais forte. O modelo mantém realismo cinematográfico, estética anime e estilos ilustrados de forma mais confiável entre quadros, o que é essencial para conteúdos que exigem identidade visual reconhecível ao longo de toda a peça. A consistência temporal melhorou drasticamente, com menos piscadas em rostos, menos trocas de figurino no meio do clipe e menos casos em que os personagens sofrem pequenas metamorfoses entre cortes.

A dinâmica de movimento mostra refinamento particular. Um teste com uma águia em voo apresentou renderização limpa de profundidade de campo e movimento natural, sem os artefatos trêmulos comuns em modelos anteriores. Os panoramas de paisagem demonstram movimento suave das nuvens e profundidade atmosférica, com o modelo lidando bem com instruções negativas para suprimir artefatos como blur, distorção e marcas d'água.

Como o Wan 2.7 se Compara com Modelos Concorrentes

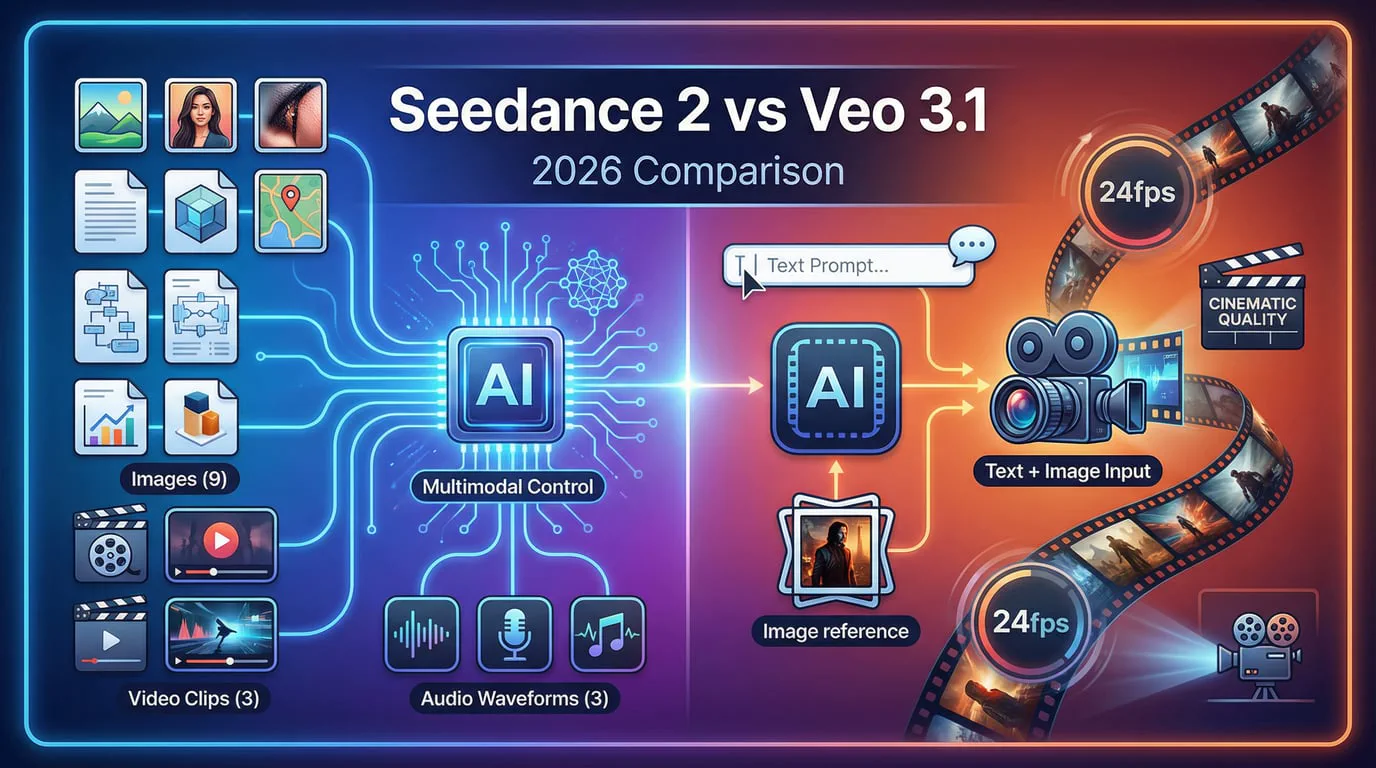

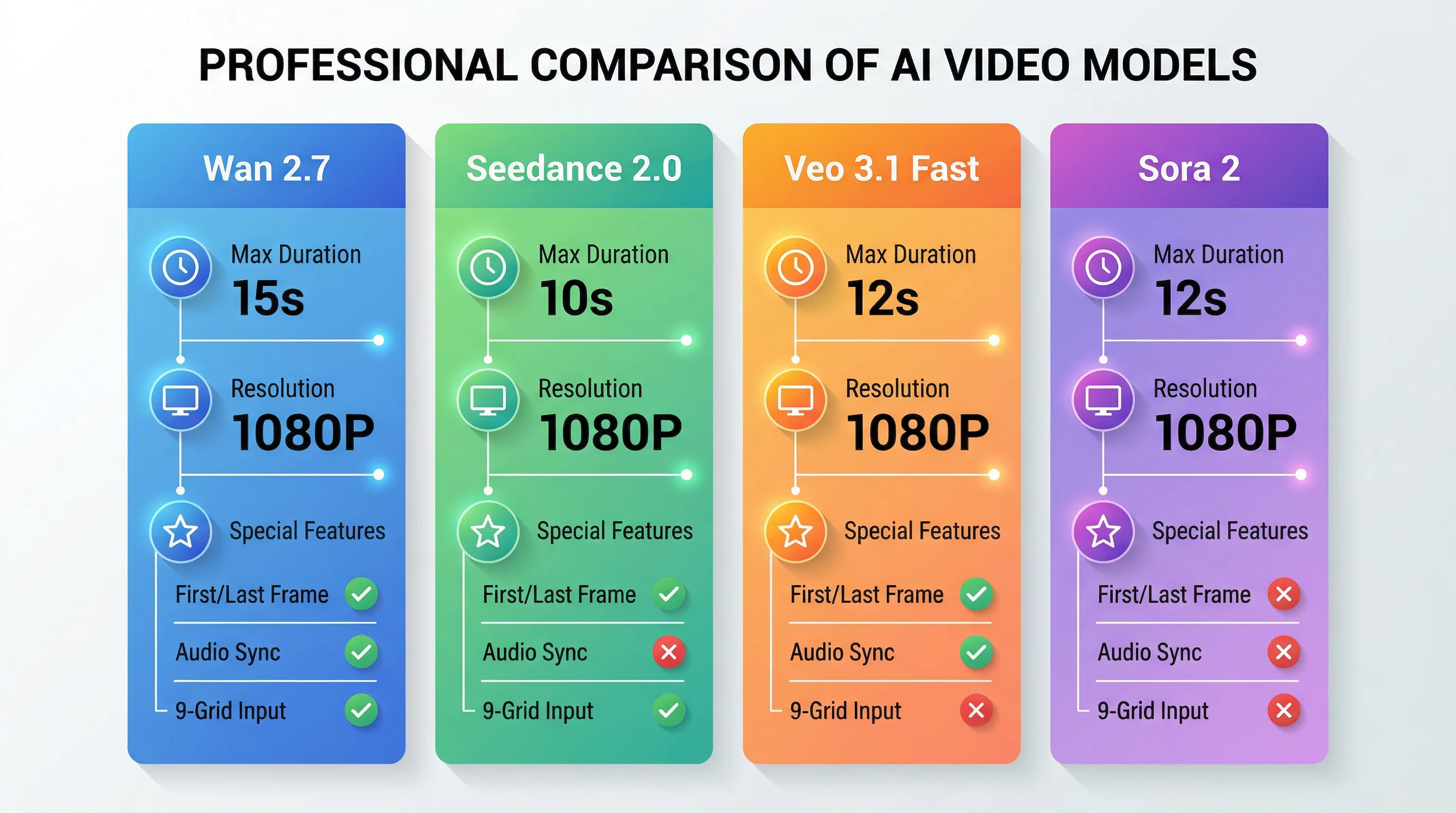

Wan 2.7 vs Seedance 2.0: Recursos vs Valor

O Seedance 2.0 da ByteDance oferece o melhor valor para movimento de alta qualidade com o menor custo por segundo no mercado atual. No entanto, o Wan 2.7 é o canivete suíço da comparação, oferecendo o maior número de recursos, mais flexibilidade e a melhor adequação para fluxos que exigem sincronização de áudio na entrada ou controle quadro a quadro.

O Seedance 2.0 chega a clipes de 10 segundos e não oferece controle de primeiro e último frame nem recursos de entrada de áudio. Ele interpreta instruções com um pouco mais de liberdade criativa, o que pode ser benéfico ou frustrante dependendo das necessidades do projeto. O Seedance costuma ser mais rápido para geração via API, tornando-o ideal para iteração e testes rápidos. A abordagem inteligente que muitas equipes de produção adotam é usar o Seedance 2.0 para iteração e testes e, em seguida, gerar o resultado final com o Wan 2.7 quando controles criativos exclusivos forem necessários. Se você quiser entender melhor as compensações de produção, leia a análise dedicada do Seedance 2 e a antiga comparação Seedance 2 vs Wan 2.6.

Wan 2.7 vs Veo 3.1: Controle vs Física

O Veo 3.1 Fast do Google lidera em realismo físico e é o único modelo da comparação que oferece áudio gerado automaticamente e clipes de 12 segundos a US$ 0,10 por segundo. O Veo 3.1 produz saída em qualidade de cinema a 24 fps com geração nativa de áudio, incluindo sons ambiente, diálogos e música, tudo sincronizado aos visuais. No entanto, o Veo 3.1 Lite chega a no máximo 8 segundos e não possui os recursos de controle granular que definem o Wan 2.7.

Onde o Wan 2.7 se destaca é em oferecer aos criadores controle preciso sobre a construção da cena por meio de âncoras de primeiro e último frame, composição em grade 9x9 e edição guiada por instruções. O Veo 3.1 prioriza simulação física realista e movimento natural, tornando-o ideal para cenários em que realismo importa mais do que controle. A escolha entre os dois depende de o seu fluxo valorizar capacidade de direção (Wan 2.7) ou física naturalista (Veo 3.1). Para a análise completa, a análise independente do Veo 3.1 cobre o lado de física e áudio com mais detalhes.

Wan 2.7 vs Sora 2: Ferramenta de Produção vs Plataforma Experimental

O Sora 2 da OpenAI lidera em realismo físico e oferece clipes de 12 segundos com áudio gerado automaticamente. No entanto, o Sora continua mais experimental em posicionamento, com menos ênfase na integração ao fluxo de produção. O conjunto de recursos do Wan 2.7, especialmente controle de primeiro e último frame, entrada em grade 9x9 e edição guiada por instruções, foi criado explicitamente para corresponder à forma como fluxos de conteúdo profissionais realmente operam: você tem um storyboard, você tem um personagem e você tem pontos de início e fim definidos para cada cena. O Wan 2.7 trabalha com essa estrutura, em vez de lutar contra ela. Se você está comparando modelos de ponta em toda a categoria, a mais ampla comparação de modelos de vídeo por IA é um bom complemento.

Tabela de Comparação dos Modelos

| Recurso | Wan 2.7 | Seedance 2.0 | Veo 3.1 Fast | Sora 2 |

|---|---|---|---|---|

| Duração Máxima | 15 segundos | 10 segundos | 12 segundos | 12 segundos |

| Resolução Máxima | 1080P | 1080P | 1080P | 1080P |

| Controle de Primeiro/Último Frame | ✓ | ✗ | ✗ | ✗ |

| Sincronização de Entrada de Áudio | ✓ | ✗ | ✗ | ✗ |

| Geração Nativa de Áudio | ✓ | ✗ | ✓ | ✓ |

| Entrada de Imagem em Grade 9x9 | ✓ | ✗ | ✗ | ✗ |

| Edição Baseada em Instruções | ✓ | ✗ | ✗ | ✗ |

| Referência de personagem | ✓ | ✓ | ✓ | ✓ |

| Instruções negativas | ✓ | Limitado | ✗ | ✗ |

| Modelo de preços | Créditos (sem expiração) | Por geração | Por geração | Assinatura |

| Uso Comercial | Todos os planos | Todos os planos | Todos os planos | Varia |

Casos de Uso Reais e Integração ao Fluxo de Trabalho

Agências de Marketing: Geração Programática de Variações de Anúncios

Uma agência que produz 50 variações de anúncios por semana pode automatizar a etapa de geração bruta com menos de US$ 50 em créditos, deixando o tempo humano para estratégia e revisão final. Isso representa uma realocação significativa de orçamento da produção manual para a estratégia criativa. O modelo sem assinatura significa que não há mensalidade por assento, nem dependência de plataforma, nem mínimo de uso. Você paga por geração, o que se alinha perfeitamente a fluxos de marketing de performance. Equipes que constroem sistemas replicáveis de anúncios geralmente combinam isso com uma clara referência de preços do Seedance 2 ou com um benchmark de modelos mais rápidos para iteração.

Equipes de marca podem usar a referência de personagem para manter os visuais do produto consistentes em várias cenas geradas. O recurso de edição vídeo a vídeo permite pegar filmagens existentes e aplicar novos estilos ou tratamentos sazonais sem refilmar, algo crítico para manter a consistência da marca enquanto se adapta aos ciclos de campanha.

Estúdios de Cinema: Pré-visualização e Protótipo Rápido

A pré-visualização com IA é um tema de busca crescente no espaço de produção cinematográfica, e o conjunto de recursos do Wan 2.7 atende diretamente a esse fluxo. Diretores podem usar storyboards em grade 9x9 para visualizar sequências complexas antes de comprometer orçamentos de filmagem. O controle de primeiro e último frame permite planejar cenas com precisão, enquanto a referência de personagem mantém a consistência do personagem ao longo das sequências de pré-visualização.

A capacidade do modelo de gerar clipes de até 15 segundos com áudio nativo o torna viável para pré-visualização de cenas completas, e não apenas testes de tomada única. Equipes de produção podem iterar sobre posicionamento em cena, movimento de câmera e ritmo com movimento e som reais antes de entrar em cena, reduzindo experimentação cara no set.

Criadores de Conteúdo: Construção Narrativa em Múltiplas Tomadas

Para YouTubers, educadores e criadores de conteúdo narrativo, o recurso de filmagem contínua e o suporte à duração estendida do Wan 2.7 permitem uma narrativa real em múltiplas tomadas. A combinação de controle de primeiro e último frame com referência de personagem significa que você pode manter a consistência do personagem ao longo de uma sequência inteira de vídeo, resolvendo o problema que assombra o vídeo por IA desde o início.

A capacidade de edição guiada por instruções é particularmente valiosa para refinamento iterativo de conteúdo. Em vez de regenerar clipes inteiros quando você precisa de ajustes, é possível aplicar modificações pontuais por texto, reduzindo drasticamente o tempo de iteração e os custos computacionais.

Integração Técnica: Acesso via API e Suporte de Plataforma

O Wan 2.7 está disponível por meio de vários provedores de API, incluindo Together AI, Segmind e acesso direto pelo Model Studio da Alibaba. A implementação via Together AI usa o endpoint Wan-AI/Wan2.7-T2V e suporta chamadas REST padrão com payloads JSON. A autenticação usa cabeçalhos de chave de API, e o modelo roda na infraestrutura serverless da Together AI para implantação escalável.

As integrações em plataformas estão se expandindo rapidamente. O Wan 2.7 já está ao vivo no Picsart, SeaArt AI, EaseMate AI, WaveSpeedAI e MindStudio, entre outros. A biblioteca de modelos da SeaArt AI permite que os criadores acessem vários modelos de vídeo por IA sem trocar de plataforma, possibilitando comparações diretas entre Wan 2.7, Seedance, Veo e outros modelos dentro de um único fluxo.

A integração do MindStudio é especialmente notável por automação de fluxo de trabalho. A plataforma permite criar agentes de IA que monitoram novas imagens de produto em uma pasta do Google Drive, geram vídeos usando Wan 2.7, aplicam pós-processamento (ampliação, troca de rosto, mesclagem de clipes, geração de legendas) e entregam os clipes finalizados ao Slack, tudo sem intervenção manual. Esse nível de integração transforma o Wan 2.7 de ferramenta de geração em componente de pipeline de produção.

Preços e Licenciamento Comercial

O Wan 2.7 opera com um modelo de preços baseado em créditos, sem mensalidades. Os créditos não expiram, o que é uma vantagem importante sobre a maioria das ferramentas de vídeo por IA, que redefinem a capacidade não utilizada ao fim de cada ciclo de cobrança. O uso comercial está incluído em todos os planos pagos, com termos de licenciamento relativamente permissivos, consistentes com a abordagem histórica da série Wan.

Os preços específicos variam conforme o provedor da plataforma, mas a estrutura geral favorece fluxos de produção com padrões variáveis de uso. Para compradores técnicos que avaliam documentação oficial, APIs que podem ser chamadas e tabelas de preço documentadas, as ofertas de vídeo publicamente documentadas da Alibaba trazem mais clareza de contrato em tempo de execução do que muitos concorrentes.

Configuração de parâmetros e engenharia de instruções

| Parâmetro | Faixa | Recomendado | Finalidade |

|---|---|---|---|

| Duração | 2-15 segundos | 5-8 segundos | Equilibrar qualidade e tempo de geração |

| Resolução | 720P, 1080P | 1080P para final, 720P para testes | Qualidade da saída vs velocidade |

| Proporção | 16:9, 4:3, 9:16 | 16:9 para web, 9:16 para mobile | Otimização por plataforma |

| Instrução negativa | String de texto | blurry, distorted, watermark | Supressão de artefatos |

| Expansão de instrução | Booleano | Ativada | Interpretação enriquecida de detalhes |

| Entrada de Áudio | Arquivo opcional | Use para sincronizar ritmo | Coerência audiovisual |

| Âncoras de Frame | 0-2 imagens | Use para controle de cena | Transições previsíveis |

O Wan 2.7 responde bem a instruções descritivas detalhadas com especificações sobre cenário, iluminação, movimento de câmera e ação. O modelo se beneficia de uma engenharia de instruções estruturada que separa descrição da cena, detalhes do personagem, direção do movimento e preferências estilísticas em cláusulas distintas. Instruções negativas suprimem de forma confiável artefatos comuns, embora não salvem imagens de entrada fundamentalmente ruins. Se você quiser uma estrutura de instruções mais forte para trabalho de produção, o guia de instruções do Seedance 2 ainda vale ser usado como referência, porque os princípios de linguagem de câmera e composição de cena se transferem bem.

Limitações e Considerações

Apesar do conjunto abrangente de recursos, o Wan 2.7 tem limitações que merecem ser observadas. O modelo prioriza qualidade em vez de velocidade, resultando em tempos de geração mais longos do que concorrentes como Seedance 2.0 ou Veo 3.1 Lite. Para fluxos de prototipagem rápida que exigem dezenas de iterações curtas, isso pode virar um gargalo. A abordagem recomendada é usar modelos mais rápidos para testes iniciais e reservar o Wan 2.7 para gerações finais de produção, onde seus recursos exclusivos agregam valor.

Embora a consistência temporal tenha melhorado drasticamente em relação ao Wan 2.6, ela não é perfeita. Cenas complexas com vários elementos em movimento ou movimentos de câmera rápidos ainda podem apresentar pequenas oscilações ou problemas de consistência, embora isso tenha sido significativamente reduzido em comparação com versões anteriores. O modelo funciona melhor com instruções claras, bem estruturadas e imagens de entrada de alta qualidade. Lixo entra, lixo sai continua valendo.

O recurso 9x9, embora inovador, exige preparação cuidadosa das imagens de entrada para alcançar resultados ideais. Entradas em grade mal compostas ou inconsistentes podem confundir o entendimento espacial do modelo, levando a saídas abaixo do ideal. Esse recurso funciona melhor quando integrado a fluxos de storyboard estruturados, e não a experimentações ad hoc.

Por Que o Seedance AI Oferece o Melhor Acesso ao Wan 2.7

Para criadores e equipes de produção que desejam aproveitar as capacidades do Wan 2.7, o Seedance AI oferece o ponto de acesso mais completo. A plataforma integra vários modelos de geração de vídeo e imagem de ponta em uma única interface, eliminando a necessidade de manter contas e fluxos separados entre provedores diferentes. Essa abordagem unificada reduz drasticamente o atrito em fluxos multimodelo, uma vantagem crítica quando você precisa comparar saídas ou usar modelos diferentes em etapas diferentes da produção. Se quiser primeiro a visão direta do produto, também pode ir direto para a página do modelo Wan 2.7 Video.

O Seedance AI oferece uma experiência de criação de IA excepcionalmente conveniente, em um único lugar. A plataforma não suporta apenas o Wan 2.7, mas também outros modelos de ponta, como os próprios geradores de vídeo do Seedance, Kling, Veo e sistemas líderes de geração de imagem. Essa amplitude significa que você pode testar o controle de primeiro e último frame do Wan 2.7 contra a velocidade do Seedance 2.0, ou comparar a consistência da referência de personagem em vários modelos, tudo no mesmo espaço de trabalho do projeto. Para agências e estúdios que gerenciam requisitos de conteúdo diversos, essa flexibilidade é inestimável.

A interface da plataforma é projetada para fluxos de produção, com recursos como processamento em lote, organização de projetos e ferramentas integradas de pós-processamento. Você pode gerar com o Wan 2.7, aplicar ampliação ou edição e exportar os ativos finais sem sair da plataforma. Para equipes que estão avaliando se os recursos exclusivos do Wan 2.7 justificam a integração ao pipeline, o Seedance AI oferece o ambiente de teste com menor atrito disponível.

Conclusão: A IA de Vídeo Pronta para Produção Chegou

O Wan 2.7 entrega aquilo que a categoria de texto para vídeo por IA vem prometendo há dois anos: qualidade próxima de produção por meio de APIs acessíveis, com preços que tornam a geração programática de vídeo realmente viável para fluxos comerciais. O conjunto abrangente de recursos do modelo, controle de primeiro e último frame, composição em grade 9x9, referência de personagem e voz, sincronização nativa de áudio e edição guiada por instruções, representa uma mudança fundamental de ferramentas experimentais de geração para componentes de pipeline de produção.

Para cineastas, YouTubers, profissionais de marketing e criadores de agência que precisam de vídeos em múltiplas tomadas com áudio e controle preciso, o conjunto de recursos do Wan 2.7 combina com a forma como fluxos profissionais realmente operam. Você tem um storyboard, você tem um personagem e você tem pontos de início e fim definidos para cada cena. O Wan 2.7 trabalha com essa estrutura, em vez de lutar contra ela. O modelo não é perfeito, e também não é a opção mais rápida disponível, mas é o modelo de vídeo por IA mais rico em recursos e mais controlável no panorama de 2026.

A verdadeira questão não é se o Wan 2.7 está superestimado. É se o seu fluxo específico se beneficia dos recursos de controle exclusivos dele. Se você produz conteúdo que exige consistência de personagem entre tomadas, transições precisas de cena, sincronização audiovisual ou edição iterativa sem regeneração completa, o Wan 2.7 é a opção mais forte atualmente disponível. Para prototipagem rápida ou cenários em que velocidade importa mais do que controle, alternativas como Seedance 2.0 ou Veo 3.1 Lite podem ser mais adequadas. A abordagem inteligente é adicionar o Wan 2.7 ao seu kit para cenários em que suas capacidades trazem valor claro, enquanto mantém acesso a modelos mais rápidos para iteração.

A geração de vídeo por IA passou de novidade experimental a ferramenta de produção. O Wan 2.7 representa o estado da arte atual em geração de vídeo controlável e rica em recursos, e plataformas como o Seedance AI tornam o acesso e a integração dessas capacidades em fluxos reais mais práticos do que nunca.