Elke discussie onder creators komt dit kwartaal uiteindelijk uit bij één model: Wan 2.7. Ontwikkeld door Alibaba's Tongyi Lab is deze nieuwste iteratie uitgegroeid tot de meest gevraagde review in de AI-videogeneratiewereld, niet vanwege marketinghype, maar omdat het een van de hardnekkigste frustraties van creators aanpakt: consistente personages, precieze scènecontrole en output van productiekwaliteit over meerdere shots. Na uitgebreide tests in echte workflows zet deze review uiteen wat Wan 2.7 Video werkelijk levert, waar het uitblinkt en hoe het zich in 2026 verhoudt tot concurrerende modellen.

Wat is Wan 2.7 en waarom is het belangrijk?

Wan 2.7 is een toonaangevend AI-videogeneratiemodel op basis van een Mixture-of-Experts (MoE)-architectuur met 27 miljard parameters. In tegenstelling tot zijn voorgangers vertegenwoordigt Wan 2.7 een fundamentele verschuiving van pure tekst-naar-video-generatie naar een compleet videoproductiepakket met gestructureerde controlemechanismen. Het model genereert filmische 1080P HD-video's op basis van tekstbeschrijvingen, afbeeldingen en zelfs audio-invoer, en combineert visuele kwaliteit, audiosynchronisatie en bewegingsconsistentie in één uniforme productieketen.

Wat Wan 2.7 onderscheidt van eerdere versies en concurrerende modellen is niet alleen het aantal parameters of de resolutie. De echte doorbraak zit in de multimodale invoermogelijkheden en het productiegerichte functiepakket. Waar Wan 2.6 creators nog liet typen en hopen dat de AI de intentie goed begreep, wat vaak leidde tot visuele vervorming en onvoorspelbare output, laat Wan 2.7 directe invoer van afbeeldingen, video's en audio toe om beweging en belichting met 1-op-1 nauwkeurigheid te interpreteren. Daarmee wordt de exacte bedoeling van de creator vertaald naar hyperrealistische filmische beelden met ongekende precisie.

De commerciële haalbaarheid van het model is net zo belangrijk. Wan 2.7 werkt met een creditsgebaseerd prijsmodel zonder maandelijkse abonnementskosten, zonder platform lock-in en met credits die nooit verlopen. Voor bureaus die 50 advertentievarianten per week produceren, betekent dit dat ruwe generatie geautomatiseerd kan worden voor minder dan $50 aan credits, terwijl menselijke tijd verschuift naar strategie en eindcontrole. Dat is een betekenisvolle verschuiving in de productiekosten.

Kernfuncties die AI-videogeneratie opnieuw definiëren

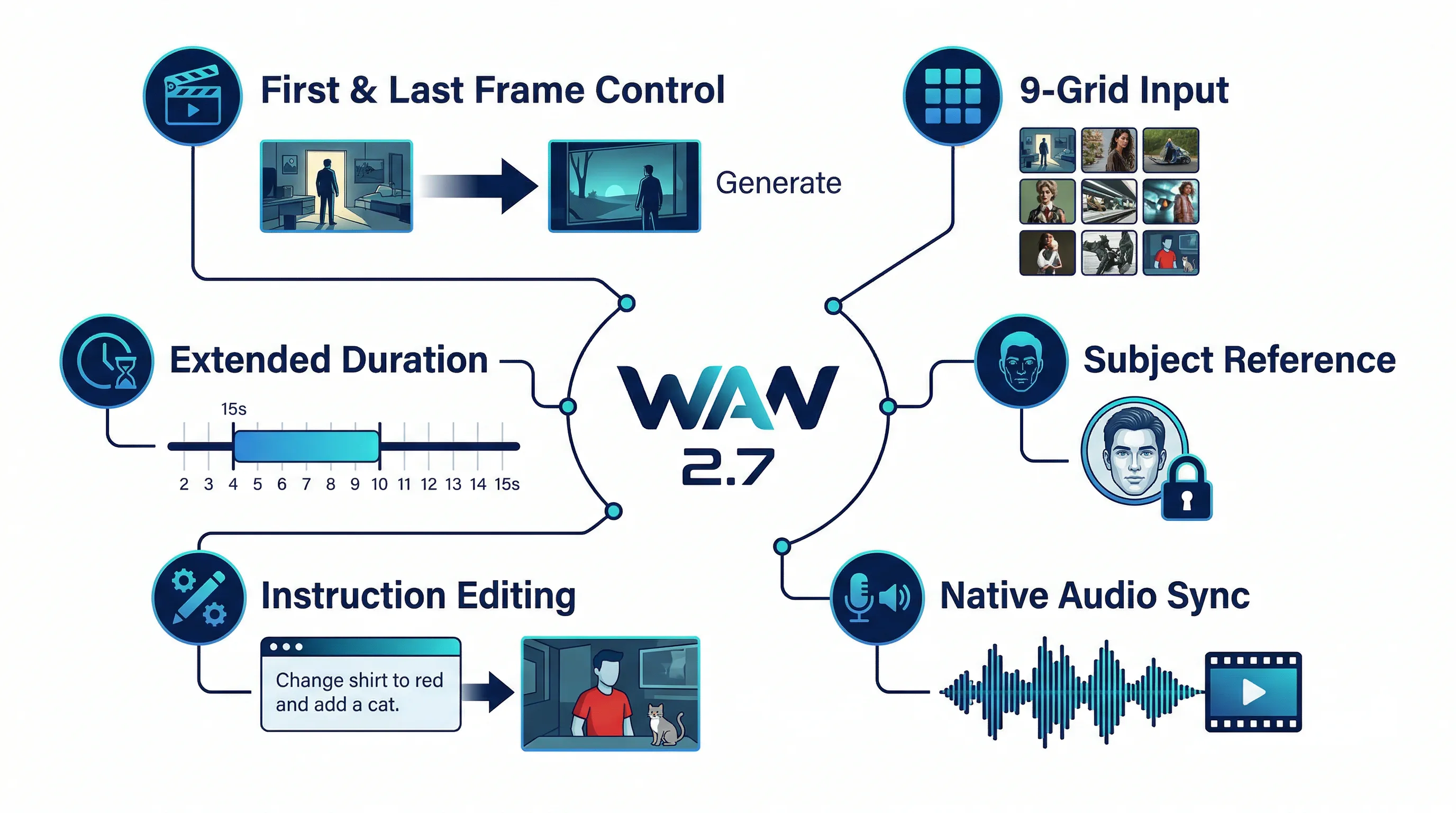

Eerste-en-laatste-framecontrole: nauwkeurig verhalen vertellen

De meest besproken functie in Wan 2.7 is eerste-en-laatste-framegeneratie, een mogelijkheid die fundamenteel verandert hoe creators naar AI-videoproductie kijken. In plaats van een clip te genereren en te hopen dat die eindigt waar je hem nodig hebt, geef je twee referentiebeelden op: hoe de video er aan het begin uit moet zien en hoe hij er aan het einde uit moet zien. Het model genereert vervolgens de beweging en overgang tussen deze twee ankerpunten, waardoor je voorspelbare en controleerbare narratieve progressie krijgt.

Dit lost een van de grootste frustraties van AI-video op: onvoorspelbare scèneontwikkeling. In Wan 2.1 bestond deze mogelijkheid als een apart modelcheckpoint (Wan2.1-FLF2V-14B), waardoor creators tussen verschillende versies moesten schakelen. In Wan 2.7 is eerste-en-laatste-framecontrole direct in het hoofdmodel geïntegreerd, wat de workflow frictieloos maakt en multi-shot productie soepel laat verlopen. Als je workflow start vanuit goedgekeurde stilstaande beelden in plaats van pure prompts, past Wan 2.7 ook natuurlijker in beeld-naar-video-workflows.

De praktische toepassingen liggen voor de hand. Voor filmmakers die een sequence storyboarden, kun je de exacte compositie bij het begin- en eindpunt van een scène vastleggen. Voor marketeers die productdemo's maken, bepaal je de exacte productpositionering op cruciale momenten. Voor docenten die tutorialcontent produceren, zorg je voor visuele continuïteit tussen instructiesegmenten. Dit niveau van controle tilt AI-videogeneratie van experimenteel gereedschap naar een productieklare asset.

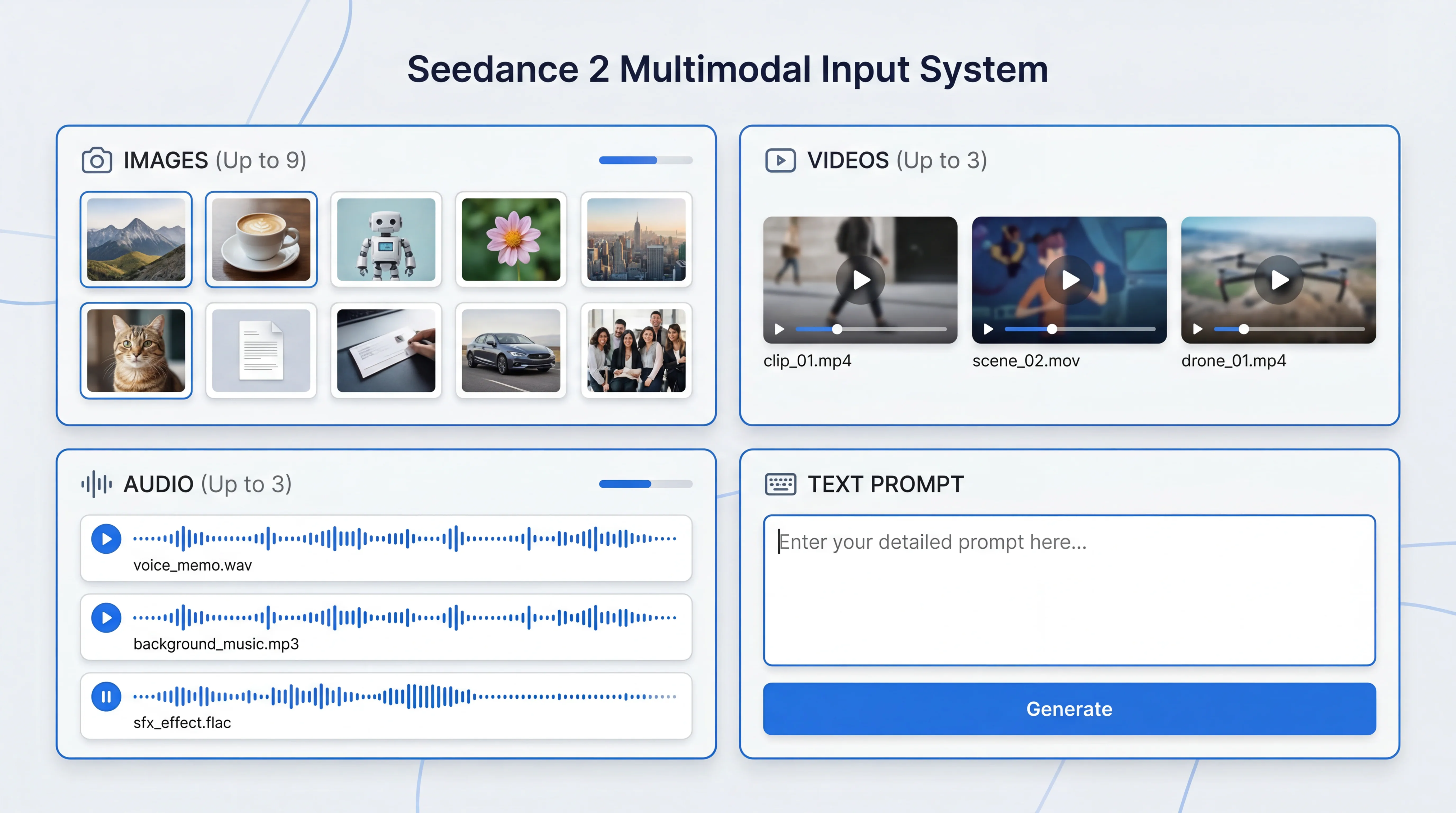

9-grid beeld-naar-video: gestructureerd visueel vertellen

Wan 2.7 introduceert een revolutionair 9-grid (3x3) beeldinvoersysteem voor videogeneratie. In plaats van één enkel referentiebeeld te gebruiken, leveren creators een raster met negen afbeeldingen aan die samen scènecompositie, camerastandpunten, belichtingscondities en visuele context over verschillende momenten of perspectieven definiëren. Het model syntheseert deze invoer tot een samenhangende geanimeerde sequentie die de structurele consistentie bewaart.

Deze functie overbrugt de kloof tussen statische storyboardplanning en geanimeerde output op een manier die geen eerder Wan-model kon bereiken. Vergeleken met traditionele autoregressieve AI-videomethoden levert de 9-grid-aanpak betere consistentie, snellere inferentiesnelheid en sterkere structurele samenhang. Voor productieteams die met gedetailleerde storyboards werken, verandert dit planningsmateriaal direct in beweging zonder de gebruikelijke trial-and-errorcyclus.

Het 9-grid-systeem blinkt vooral uit in scenario's met complexe camerabewegingen of interacties tussen personages. Door meerdere referentiehoeken aan te leveren, kunnen creators het model helpen ruimtelijke relaties, diepte en bewegingsbanen beter te begrijpen, wat resulteert in output die doelbewust gechoreografeerd aanvoelt in plaats van willekeurig gegenereerd.

Subject- en stemreferentie: identiteit consistent houden over shots heen

Het consistent houden van personages is berucht lastig in AI-videogeneratie, waar identiteiten gemakkelijk vervagen of verschuiven tussen frames. Wan 2.7 introduceert wat de documentatie "Absolute Identity Lock" noemt, een subject-referencesysteem dat gelaatstrekken (ooghoogte, kaaklijnen), kledingdetails en omgevingsstijlen perfect vastzet over complexe camerabewegingen heen.

Je levert een referentiebeeld aan van een persoon, object of personage, en het model behoudt die visuele identiteit gedurende de hele video. Daarmee wordt de grootste klacht over Wan 2.5 en 2.6 aangepakt: personages zagen er niet in elk frame hetzelfde uit. In tests is de verbetering meteen zichtbaar, met aanzienlijk minder kledingwissels halverwege een clip, minder gezichtsvervorming en minder identiteitsdrift.

Stemreferentie breidt deze consistentie uit naar audio. Creators kunnen een stemvoorbeeld aanleveren en Wan 2.7 behoudt die vocale identiteit in de gegenereerde audiotrack, wat cruciaal is voor branded content, karaktergedreven verhalen of elk project dat herkenbare stemconsistentie vereist. Daarmee concurreert Wan 2.7 direct met tools als Kling en Hailuo, die deze identiteitssamenhang al langer bieden, maar dan met Wan 2.7's bredere functieset.

Native audiosynchronisatie: geluid dat met beweging meeloopt

In tegenstelling tot de meeste AI-videomodellen die stille clips genereren waarvoor je handmatig audio moet toevoegen, bevat Wan 2.7 native audiogeneratie die direct met de visuele content wordt gesynchroniseerd. Achtergrondmuziek, omgevingsgeluid en stemgeluiden worden vanaf het begin gesynchroniseerd met de scènebeweging gegenereerd, niet achteraf toegevoegd. Voor iedereen die ooit handmatig audio op AI-video frame voor frame heeft moeten afstemmen, is dit waarschijnlijk de meest direct bruikbare upgrade in de hele set.

Het model ondersteunt optionele audio-invoer, waardoor creators referentie-audio kunnen aanleveren die zowel de visuele generatie als de gesynchroniseerde output beïnvloedt. Deze multimodale aanpak betekent dat je een muziektrack kunt invoeren en dat het tempo, de cuts en de bewegingen van de video reageren op het ritme en de emotionele toon van de audio, wat een niveau van audiovisuele coherentie oplevert dat voorheen alleen via uitgebreide postproductie haalbaar was.

Bewerken op basis van instructies: tekstgestuurde aanpassingen

Een van de meest innovatieve functies van Wan 2.7 is bewerken op basis van instructies, het vermogen om bestaande video's aan te passen via simpele tekstcommando's zonder alles opnieuw te genereren. In plaats van opnieuw te beginnen wanneer je aanpassingen nodig hebt, kun je commando's typen zoals "replace the background", "shift the lighting to golden hour" of "recolor the outfit to blue" en laat je het model die edits toepassen terwijl de rest intact blijft.

Deze video-naar-video-bewerkingsmogelijkheid verlaagt de complexiteit van de input en de rekenlast, en levert sneller resultaat dan volledige regeneratie. Voor iteratieve creatieve workflows is dit een gamechanger. Je kunt output verfijnen via gerichte aanpassingen in plaats van telkens volledig nieuwe generaties te gokken. De functie is vooral waardevol voor bureaus die seizoensvarianten toepassen op bestaande footage of merkteams die productconsistentie over meerdere scènes willen behouden zonder opnieuw te filmen.

Verlengde duur en doorfilmen: de fragmentlimiet doorbreken

Een van de grootste beperkingen van eerste-generatie videomodellen was de narratieve lengte, meestal beperkt tot single-shot segmenten van 3 tot 4 seconden. Wan 2.7 pakt dit aan met de doorfilmfunctie, een intelligent uitbreidingssysteem dat bestaande videomaterialen oneindig kan doorrekken. Het model ondersteunt outputduren van 2 tot 15 seconden per generatie, waarmee het in de praktijk de enige optie onder de grote concurrenten is voor clips langer dan 10 seconden.

Deze langere duur, gecombineerd met eerste-en-laatste-framecontrole, maakt echte multi-shot narratieve opbouw mogelijk. Creators kunnen sequenties aan elkaar koppelen met voorspelbare overgangen en zo langere content bouwen die visuele en stilistische consistentie behoudt. Dat is een cruciale eis voor professionele contentworkflows.

Technische specificaties en outputkwaliteit

Wan 2.7 genereert video in native 1080P HD-resolutie, met ook 720P beschikbaar voor snellere verwerking. Het model levert uitvoer op 24fps, wat aansluit bij bioscoopstandaard-framerates voor professionele beweging. De generatie tijd verschilt per duur en resolutie, maar de architectuur zet kwaliteit boven snelheid, een bewuste afweging die het model positioneert als productietool in plaats van snelle prototypemachine.

De visuele kwaliteit van het model is op meerdere vlakken een flinke stap vooruit ten opzichte van Wan 2.6. De stijlconsistentie is merkbaar sterker. Het model houdt cinematisch realisme, anime-esthetiek en geïllustreerde stijlen stabieler vast over frames, wat essentieel is voor content die overal een herkenbare visuele identiteit moet behouden. De temporele consistentie is sterk verbeterd, met minder flikkerende gezichten, minder kledingwissels halverwege clips en minder gevallen waarin onderwerpen subtiel vervormen tussen cuts.

De bewegingsdynamiek is bijzonder verfijnd. De vleugelbeweging in een test met een vliegende adelaar liet strakke scherptediepterendering en natuurlijke beweging zien zonder de schokkerige artefacten die in eerdere modellen vaak voorkwamen. Landschapspans laten vloeiende wolkenbeweging en atmosfeerdiepte zien, terwijl het model negatieve prompts effectief gebruikt om artefacten zoals onscherpte, vervorming en watermerken te onderdrukken.

Hoe Wan 2.7 zich verhoudt tot concurrerende modellen

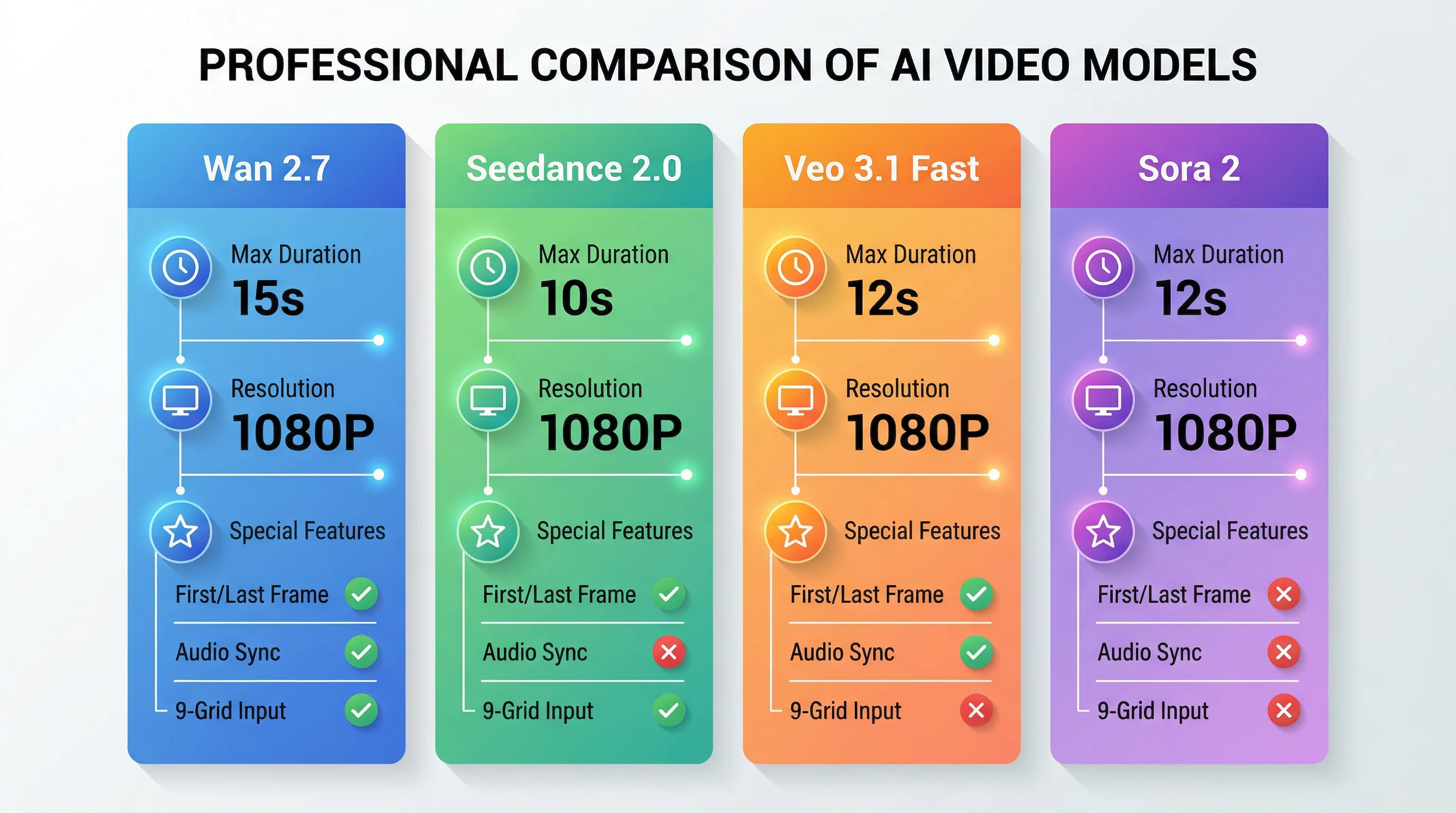

Wan 2.7 vs Seedance 2.0: functies versus waarde

ByteDance's Seedance 2.0 biedt de beste waarde voor hoogwaardige beweging tegen de laagste kost per seconde in de huidige markt. Wan 2.7 is daarentegen het Zwitserse zakmes van de vergelijking: het biedt de meeste functies, de meeste flexibiliteit en past het best bij workflows die audiosynchronisatie of frame-tot-framecontrole nodig hebben.

Seedance 2.0 gaat tot clips van 10 seconden en mist eerste-en-laatste-framecontrole of audio-invoerfuncties. De prompts worden met iets meer creatieve vrijheid geïnterpreteerd, wat afhankelijk van het project zowel voordeel als nadeel kan zijn. Seedance is meestal sneller voor API-gebaseerde generatie, wat het ideaal maakt voor snelle iteratie en tests. De slimme aanpak die veel productieteams hanteren is Seedance 2.0 gebruiken voor iteratie en testen, en vervolgens het eindresultaat met Wan 2.7 genereren wanneer unieke creatieve controle nodig is. Als je de diepere productie-afwegingen wilt zien, lees dan ook de aparte Seedance 2-review en de oudere Seedance 2 vs Wan 2.6-vergelijking.

Wan 2.7 vs Veo 3.1: controle versus fysica

Google's Veo 3.1 Fast loopt voorop in realistische fysica en is in deze vergelijking het enige model dat zowel automatisch gegenereerde audio als clips van 12 seconden biedt voor $0,10 per seconde. Veo 3.1 produceert cinema-kwaliteit output op 24fps met native audiogeneratie, inclusief omgevingsgeluid, dialoog en muziek die allemaal synchroon lopen met de beelden. Veo 3.1 Lite komt echter maar tot 8 seconden en mist de granulaire controlefuncties die Wan 2.7 definiëren.

Waar Wan 2.7 uitblinkt, is in het geven van precieze controle over scèneopbouw via eerste-en-laatste-frameankers, 9-grid-compositie en bewerken op basis van instructies. Veo 3.1 prioriteert realistische fysicasimulatie en natuurlijke beweging, waardoor het ideaal is voor situaties waarin realisme belangrijker is dan controle. De keuze tussen beide hangt af van wat je workflow belangrijker vindt: stuurbaarheid (Wan 2.7) of naturalistische fysica (Veo 3.1). Voor de volledige uitsplitsing behandelt de aparte Veo 3.1-review de fysica- en audiokant uitgebreider.

Wan 2.7 vs Sora 2: productietool versus experimenteel platform

OpenAI's Sora 2 loopt voorop in realistische fysica en biedt clips van 12 seconden met automatisch gegenereerde audio. Toch blijft Sora qua positionering meer experimenteel, met minder nadruk op integratie in productieworkflows. Wan 2.7's functieset, vooral eerste-en-laatste-framecontrole, 9-grid-invoer en bewerken op basis van instructies, is expliciet ontworpen rond hoe professionele contentworkflows in de praktijk werken: je hebt een storyboard, een personage en duidelijke begin- en eindpunten per scène. Wan 2.7 werkt met die structuur in plaats van ertegenin. Als je de categorie breder wilt vergelijken, is de algemene AI-videomodelvergelijking een nuttige aanvulling.

Modelvergelijkingstabel

| Kenmerk | Wan 2.7 | Seedance 2.0 | Veo 3.1 Fast | Sora 2 |

|---|---|---|---|---|

| Maximale duur | 15 seconden | 10 seconden | 12 seconden | 12 seconden |

| Maximale resolutie | 1080P | 1080P | 1080P | 1080P |

| First/Last Frame Control | ✓ | ✗ | ✗ | ✗ |

| Audio Input Sync | ✓ | ✗ | ✗ | ✗ |

| Native audiogeneratie | ✓ | ✗ | ✓ | ✓ |

| 9-grid beeldinvoer | ✓ | ✗ | ✗ | ✗ |

| Bewerken op basis van instructies | ✓ | ✗ | ✗ | ✗ |

| Subjectreferentie | ✓ | ✓ | ✓ | ✓ |

| Negatieve prompts | ✓ | Beperkt | ✗ | ✗ |

| Prijsmodel | Credits (vervallen niet) | Per generatie | Per generatie | Abonnement |

| Commercieel gebruik | Alle tiers | Alle tiers | Alle tiers | Varieert |

Praktijkcases en workflow-integratie

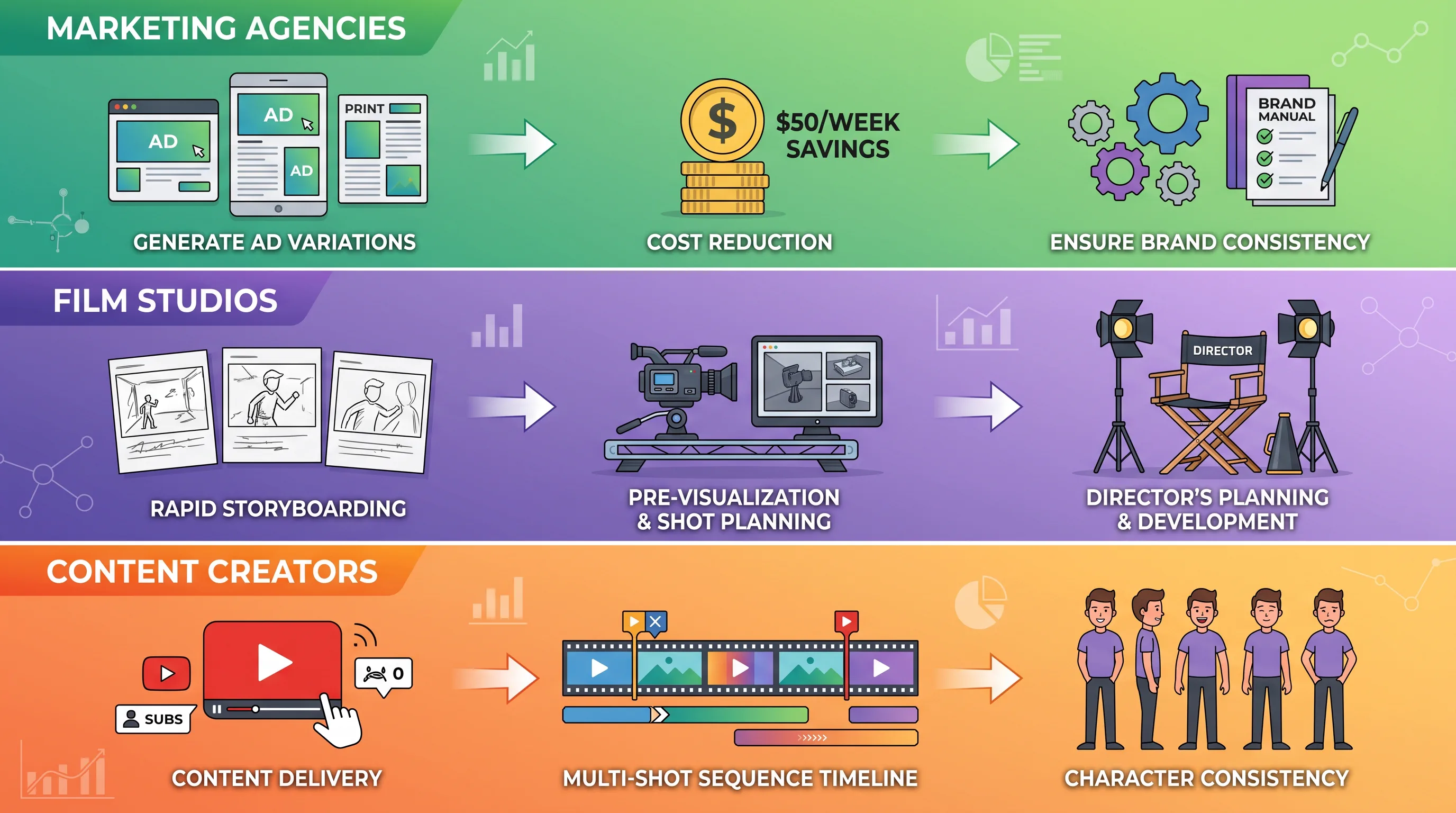

Marketingbureaus: geautomatiseerde generatie van advertentievarianten

Een bureau dat 50 advertentievarianten per week produceert, kan de ruwe generatie automatiseren voor minder dan $50 aan credits, waardoor menselijke tijd vrijkomt voor strategie en eindcontrole. Dit is een betekenisvolle verschuiving van handmatige productie naar creatieve strategie. Het abonnementsvrije model betekent geen maandelijkse licentiekosten per gebruiker, geen vastzitten aan één platform en geen minimale afname. Je betaalt per generatie, wat perfect aansluit op workflows voor performance-marketing. Teams die herhaalbare advertentieworkflows bouwen, combineren dat meestal met een duidelijke Seedance 2-prijsreferentie of een benchmarkartikel voor snellere iteratie.

Brandteams kunnen subjectreferentie gebruiken om productvisuals consistent te houden over meerdere gegenereerde scènes. De video-naar-video-bewerkingsfunctie maakt het mogelijk om bestaande footage nieuwe stijlen of seizoensvarianten te geven zonder opnieuw te filmen, wat cruciaal is voor merkconsistentie tijdens campagnes.

Filmstudio's: previsualisatie en snelle prototyping

AI-previsualisatie is een groeiend zoekonderwerp in filmproductie, en de functieset van Wan 2.7 sluit hier direct op aan. Regisseurs kunnen 9-grid-storyboards gebruiken om complexe sequenties te visualiseren voordat ze dure shoots vastleggen. Eerste-en-laatste-framecontrole maakt precieze scèneplanning mogelijk, terwijl subjectreferentie de personageconsistentie in previsualisatiesequenties bewaakt.

Het vermogen van het model om clips tot 15 seconden met native audiosynchronisatie te genereren maakt het geschikt voor volledige scèneprevisualisatie, niet alleen voor losse shots. Productieteams kunnen blokking, camerabeweging en timing iteratief uitwerken met echte beweging en geluid vóór de draaidag, waardoor kostbare experimenten op de set worden verminderd.

Content creators: multi-shot narratieve opbouw

Voor YouTubers, docenten en verhalende makers maken de doorfilmfunctie en de verlengde duur van Wan 2.7 echte multi-shot storytelling mogelijk. De combinatie van eerste-en-laatste-framecontrole en subjectreferentie betekent dat je personageconsistentie over een hele videoscène kunt vasthouden, waarmee je een probleem oplost dat AI-video al sinds het begin achtervolgt.

De functie voor bewerken op basis van instructies is vooral waardevol voor iteratieve contentverfijning. In plaats van complete clips opnieuw te genereren wanneer je iets wilt aanpassen, kun je gerichte wijzigingen via tekstcommando's toepassen, wat iteratietijd en rekenkosten drastisch verlaagt.

Technische integratie: API-toegang en platformondersteuning

Wan 2.7 is beschikbaar via meerdere API-providers, waaronder Together AI, Segmind en directe toegang via Alibaba's Model Studio. De implementatie via Together AI gebruikt het endpoint Wan-AI/Wan2.7-T2V en ondersteunt standaard REST API-aanroepen met JSON-payloads. Authenticatie loopt via API-sleutels in de headers en het model draait op de serverless infrastructuur van Together AI voor schaalbare uitrol.

Platformintegraties groeien snel. Wan 2.7 staat live op onder meer Picsart, SeaArt AI, EaseMate AI, WaveSpeedAI en MindStudio. De modellenbibliotheek van SeaArt AI laat creators meerdere AI-videomodellen gebruiken zonder van platform te wisselen, waardoor directe vergelijkingen naast elkaar mogelijk zijn tussen Wan 2.7, Seedance, Veo en andere modellen binnen één workflow.

De integratie met MindStudio is vooral interessant voor workflowautomatisering. Het platform ondersteunt AI-agents die nieuwe productafbeeldingen in een Google Drive-map kunnen volgen, video's genereren met Wan 2.7, nabewerking toepassen zoals upscaling, gezichtsswap, clip samenvoegen en ondertitelgeneratie, en de afgewerkte clips naar Slack leveren, allemaal zonder handmatige tussenkomst. Dit niveau van workflow-integratie transformeert Wan 2.7 van een generatietool naar een onderdeel van de productieketen.

Prijs en commerciële licentie

Wan 2.7 werkt met een creditsgebaseerd prijsmodel zonder maandelijkse abonnementskosten. Credits verlopen niet, een belangrijk voordeel ten opzichte van veel AI-videotools waarbij ongebruikte capaciteit aan het einde van een factureringscyclus vervalt. Commercieel gebruik is inbegrepen in alle betaalde pakketten, met relatief soepele licentievoorwaarden die passen bij de historische aanpak van de Wan-serie.

De exacte prijs verschilt per platformprovider, maar de algemene structuur is gunstig voor productieworkflows met variabele gebruikspatronen. Voor technische kopers die officiële documentatie, aanroepbare API's en gedocumenteerde prijstabellen beoordelen, bieden Alibaba's publiek gedocumenteerde video-aanbiedingen duidelijkere runtime-contracten dan veel concurrenten.

Parameterconfiguratie en promptuitwerking

| Parameter | Bereik | Aanbevolen | Doel |

|---|---|---|---|

| Duur | 2-15 seconden | 5-8 seconden | Balans tussen kwaliteit en generatietijd |

| Resolutie | 720P, 1080P | 1080P voor eindoutput, 720P voor testen | Outputkwaliteit versus snelheid |

| Aspect ratio | 16:9, 4:3, 9:16 | 16:9 voor web, 9:16 voor mobiel | Platformoptimalisatie |

| Negatieve prompt | Tekstreeks | blurry, distorted, watermark | Onderdrukken van artefacten |

| Promptverrijking | ja/nee | Ingeschakeld | Betere interpretatie van details |

| Audio-invoer | Optioneel bestand | Gebruik voor ritmesync | Audiovisuele coherentie |

| Frame-ankers | 0-2 afbeeldingen | Gebruik voor scènecontrole | Voorspelbare overgangen |

Wan 2.7 reageert goed op gedetailleerde prompts met specifieke informatie over setting, belichting, camerabeweging en actie. Het model profiteert van gestructureerde promptuitwerking waarbij scènebeschrijving, personagedetails, bewegingsrichting en stilistische voorkeuren als aparte zinnen worden geformuleerd. Negatieve prompts onderdrukken veelvoorkomende artefacten betrouwbaar, al redden ze geen fundamenteel slechte inputbeelden. Als je een sterkere promptstructuur voor productie wilt, is de Seedance 2-promptgids nog steeds nuttig als referentie, omdat camerataal en scèneblokkeringsprincipes goed overdraagbaar zijn.

Beperkingen en aandachtspunten

Ondanks de uitgebreide functieset heeft Wan 2.7 ook beperkingen. Het model zet kwaliteit boven snelheid, waardoor de generatietijden langer zijn dan bij concurrenten zoals Seedance 2.0 of Veo 3.1 Lite. Voor snelle prototypingworkflows met tientallen korte iteraties kan dat een knelpunt zijn. De aanbevolen aanpak is snellere modellen te gebruiken voor eerste tests en Wan 2.7 te reserveren voor eindproducties waar de unieke functies echt waarde toevoegen.

Hoewel de temporele consistentie sterk is verbeterd ten opzichte van Wan 2.6, is die nog niet perfect. Complexe scènes met meerdere bewegende elementen of snelle camerabewegingen kunnen nog steeds lichte flikkering of consistentieproblemen tonen, al zijn die aanzienlijk minder dan in eerdere versies. Het model werkt het best met duidelijke, goed gestructureerde prompts en hoogwaardige inputbeelden. Rommel erin, rommel eruit blijft gelden.

De 9-grid-functie is innovatief, maar vereist zorgvuldige voorbereiding van de inputbeelden om optimale resultaten te krijgen. Slecht gecomponeerde of inconsistente rasterinvoer kan het ruimtelijke begrip van het model verwarren, wat tot suboptimale output leidt. Deze functie werkt het best wanneer ze is ingebed in een gestructureerde storyboardworkflow in plaats van ad-hoc experimenten.

Waarom Seedance AI de beste toegang tot Wan 2.7 biedt

Voor creators en productieteams die Wan 2.7 willen gebruiken, biedt Seedance AI het meest complete toegangspunt. Het platform integreert meerdere geavanceerde video- en beeldgeneratiemodellen in één interface, waardoor je geen losse accounts en workflows meer hoeft te beheren bij verschillende providers. Deze uniforme aanpak verlaagt de frictie in multi-model workflows aanzienlijk, een cruciaal voordeel wanneer je output wilt vergelijken of verschillende modellen wilt inzetten in verschillende productiefasen. Als je liever eerst de directe productpagina bekijkt, kun je ook meteen naar de Wan 2.7 Video-modelpagina.

Seedance AI biedt een bijzonder handige alles-in-één AI-ervaring. Het platform ondersteunt niet alleen Wan 2.7, maar ook andere voorhoedemodellen zoals de eigen videomodellen van Seedance, Kling, Veo en toonaangevende beeldgeneratiesystemen. Dankzij die breedte kun je de eerste-en-laatste-framecontrole van Wan 2.7 testen tegenover de snelheid van Seedance 2.0, of subjectreferentieconsistentie vergelijken tussen meerdere modellen, allemaal binnen dezelfde projectwerkruimte. Voor bureaus en studio's met uiteenlopende contentbehoeften is die flexibiliteit van grote waarde.

De interface van het platform is ontworpen voor productieworkflows, met functies zoals batchverwerking, projectorganisatie en geïntegreerde nabewerkingstools. Je kunt met Wan 2.7 genereren, upscaling of bewerking toepassen en eindassets exporteren zonder het platform te verlaten. Voor teams die willen bepalen of Wan 2.7's unieke functies de integratie in hun productieketen rechtvaardigen, biedt Seedance AI de minst frictievolle testomgeving die beschikbaar is.

Conclusie: AI-video klaar voor productie is er nu

Wan 2.7 levert wat de tekst-naar-video-categorie al twee jaar belooft: kwaliteit die dicht bij productie zit via toegankelijke API's tegen een prijs die geautomatiseerde videogeneratie daadwerkelijk haalbaar maakt voor commerciële workflows. De complete functieset van het model, eerste-en-laatste-framecontrole, 9-grid-compositie, subject- en stemreferentie, native audiosynchronisatie en bewerken op basis van instructies, vertegenwoordigt een fundamentele verschuiving van experimentele generatietools naar onderdelen van de productieketen.

Voor filmmakers, YouTubers, marketeers en makers bij bureaus die multi-shot video's met audio en precieze controle nodig hebben, sluit Wan 2.7's functieset aan op hoe professionele contentworkflows in de praktijk werken. Je hebt een storyboard, je hebt een personage en je hebt duidelijke begin- en eindpunten per scène. Wan 2.7 werkt mee met die structuur in plaats van ertegenin. Het model is niet perfect en niet de snelste optie die beschikbaar is, maar het is wel het meest functierijke en controleerbare AI-videomodel in het landschap van 2026.

De echte vraag is niet of Wan 2.7 overdreven gehypet is. De vraag is of jouw specifieke workflow baat heeft bij de unieke controlefuncties. Als je content maakt die personageconsistentie over shots heen, precieze scènewissels, audiovisuele synchronisatie of iteratieve bewerking zonder volledige regeneratie vereist, dan is Wan 2.7 momenteel de sterkste optie. Voor snelle prototyping of situaties waarin snelheid belangrijker is dan controle, zijn alternatieven zoals Seedance 2.0 of Veo 3.1 Lite vaak passender. De slimme strategie is Wan 2.7 toevoegen aan je gereedschapskist voor situaties waarin de mogelijkheden duidelijk waarde bieden, terwijl je snellere modellen behoudt voor iteratie.

AI-videogeneratie is geëvolueerd van experimentele noviteit naar productietool. Wan 2.7 staat voor de huidige topstandaard in controleerbare, functierijke videogeneratie, en platforms zoals Seedance AI maken het praktischer dan ooit om deze mogelijkheden in echte workflows in te bouwen.