HappyHorse complete guide を探しているなら、本当の問題はマーケティング文言を理解することではありません。重要なのは、公開されている情報と独立して検証できる情報を切り分け、そのうえで HappyHorse を今は「注目対象」と見るべきなのか、「試す対象」と見るべきなのか、それとも「依存してよい基盤」と見るべきなのかを判断することです。

2026 年 4 月 8 日時点で、HappyHorse の公開資料はかなり野心的なストーリーを描いています。HappyHorse 1.0 は、同期音声、7 言語の lip-sync、1080p 出力、商用利用許可、self-hosting 対応、強力な benchmark 結果を備えた open-source のマルチモーダル動画モデルとして紹介されています。魅力的な内容です。ただし同時に検証上の問題もあります。公開コードへの導線は直接確認できず、デプロイ例で示されているモデルホスティングの経路も、未ログイン状態では開かれていません。

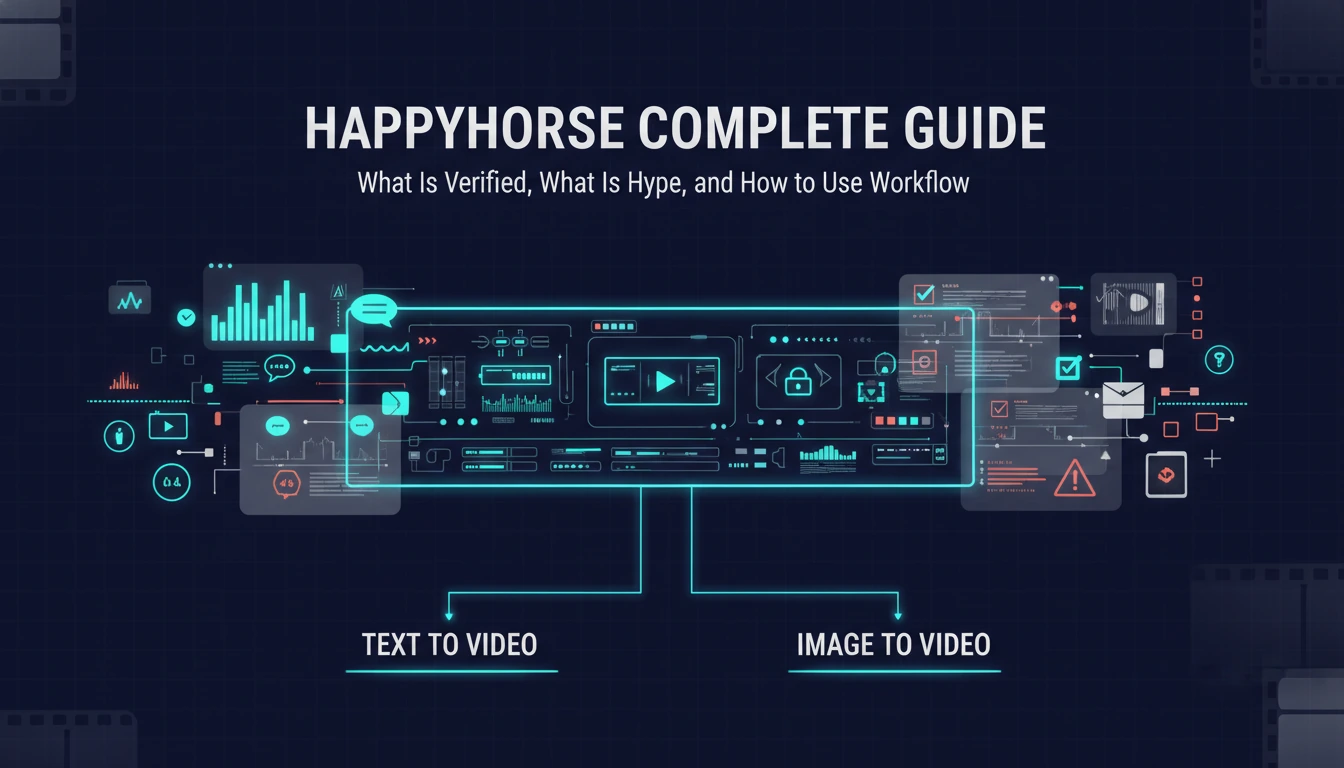

だからといって、HappyHorse が偽物だと断定する理由にはなりません。ただし、見方を間違えないことは大切です。つまり「面白いプロジェクトではあるが、公開検証は未完成で、本番導入の準備状況もまだ不透明」という前提で読むべきです。このガイドでは、どこが本物らしく見えるのか、どこにまだ証拠が必要なのか、HappyHorse がどの場面で意味を持ちそうなのか、そして今すぐ成果物が必要なら、なぜ text to video ワークフロー や image to video ワークフロー のほうが現実的なのかを整理します。

短い答え

HappyHorse は、open weights、音声生成、lip-sync、self-hosting という軸で強い公開ポジショニングを持つ、有望な AI 動画モデル構想に見えます。ただし、現在の公開証拠だけでは、すべての大きな claim を「すでに確認済みで、低リスクで採用できる基盤」と見なすには足りません。

実務的には次のように整理できます。

| 質問 | 実務的な答え |

|---|---|

| HappyHorse は興味深いか? | はい。オープンかつ self-hostable を掲げる動画モデルとしては、機能セットがかなり野心的です。 |

| すでに完全に検証済みの公開 open model か? | まだです。公開リポジトリは利用できず、サイト上のモデル経路も未ログインでは確認できません。 |

| 無視すべきか? | いいえ。オープンなマルチモーダル動画生成に関心があるなら追う価値があります。 |

| 今すぐ制作パイプラインの中心に置くべきか? | 検証リスクを受け入れ、不完全な公開アーティファクトも許容できる場合に限られます。 |

| いまクリエイターが取るべき行動は? | prompt 主導なら text to video、参照画像主導なら image to video を使い、HappyHorse は成熟を待ちながら観察するのが無難です。 |

要するに、現時点の HappyHorse は「すぐ本番導入する土台」よりも、「高い上振れがありそうな観測対象」として見るほうが自然です。

HappyHorse が現在公開している主張

いま見えている HappyHorse の資料は、曖昧な teaser ではなく、かなり具体的なプロダクトストーリーになっています。公開主張には次のようなものがあります。

- 150 億パラメータモデル

- 40 層 Transformer アーキテクチャ

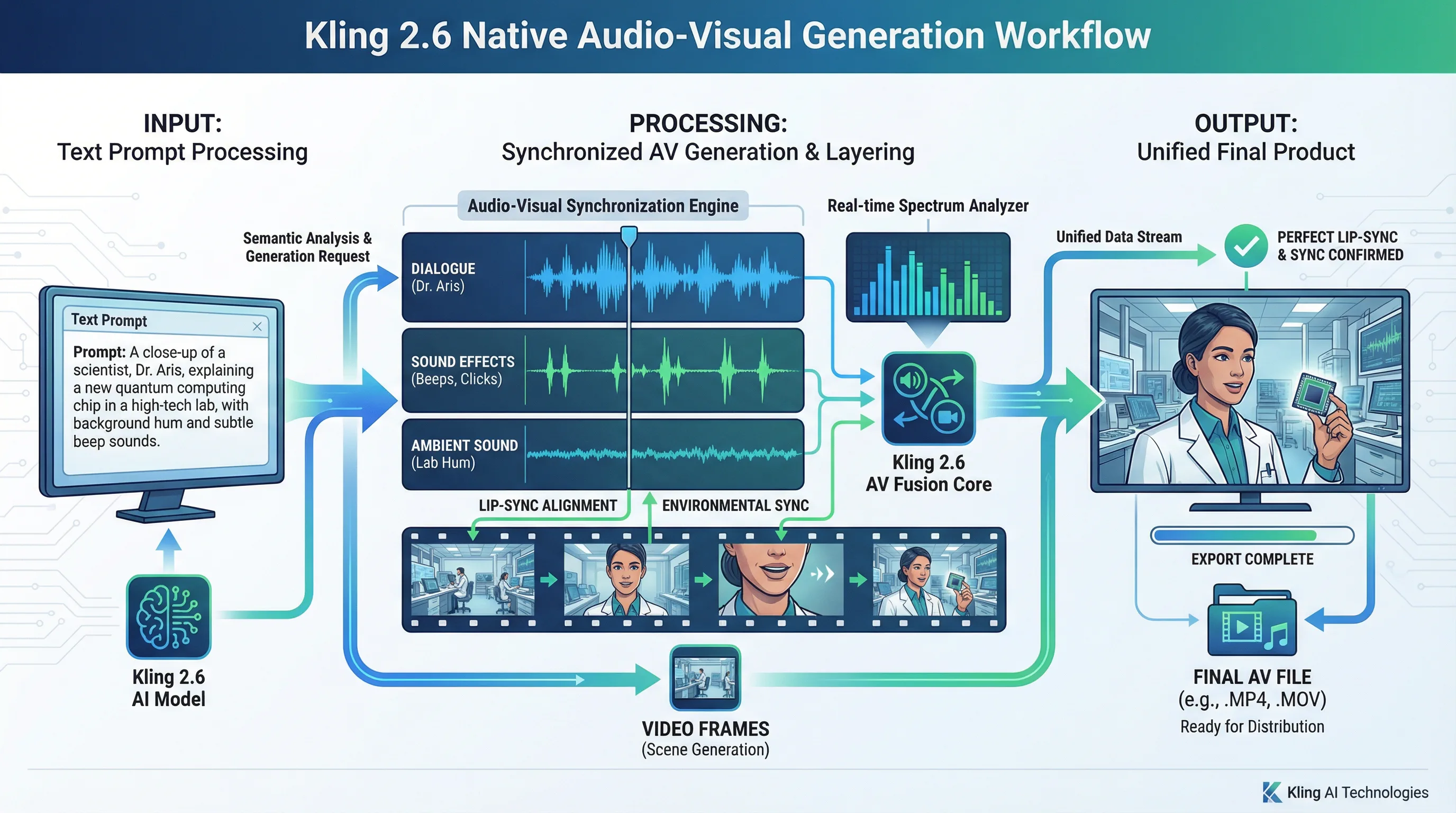

- 動画と音声の同時生成

- テキスト入力と画像入力の両対応

- 7 言語 lip-sync

- 1080p 出力

- 5〜8 秒クリップ

- H100 / A100 クラス GPU での self-hosting

- 商用利用可の open-source リリース

$11.90からの価格

これは単なる landing page 向けの一般論ではなく、研究者にもクリエイターにも本気で見てもらいたい技術ローンチページの語り口です。

さらにサイトには、次のようなパフォーマンス系の主張もあります。

- H100 で 5 秒 / 1080p クリップ生成に約 38 秒

- 英語、中国語標準語、広東語、日本語、韓国語、ドイツ語、フランス語の lip-sync 対応

- OVI 1.1 や LTX 2.3 より良い benchmark

- 公開動画モデル leaderboard で上位という主張

紙の上では、とても魅力的です。text-to-video、image-to-video、同期音声、多言語 lip-sync、商用フレンドリーな openness を同時に持つモデルなら、当然目立ちます。問題はストーリーのうまさではなく、そのストーリーと、今アクセスできる公開アーティファクトの間にあるギャップです。

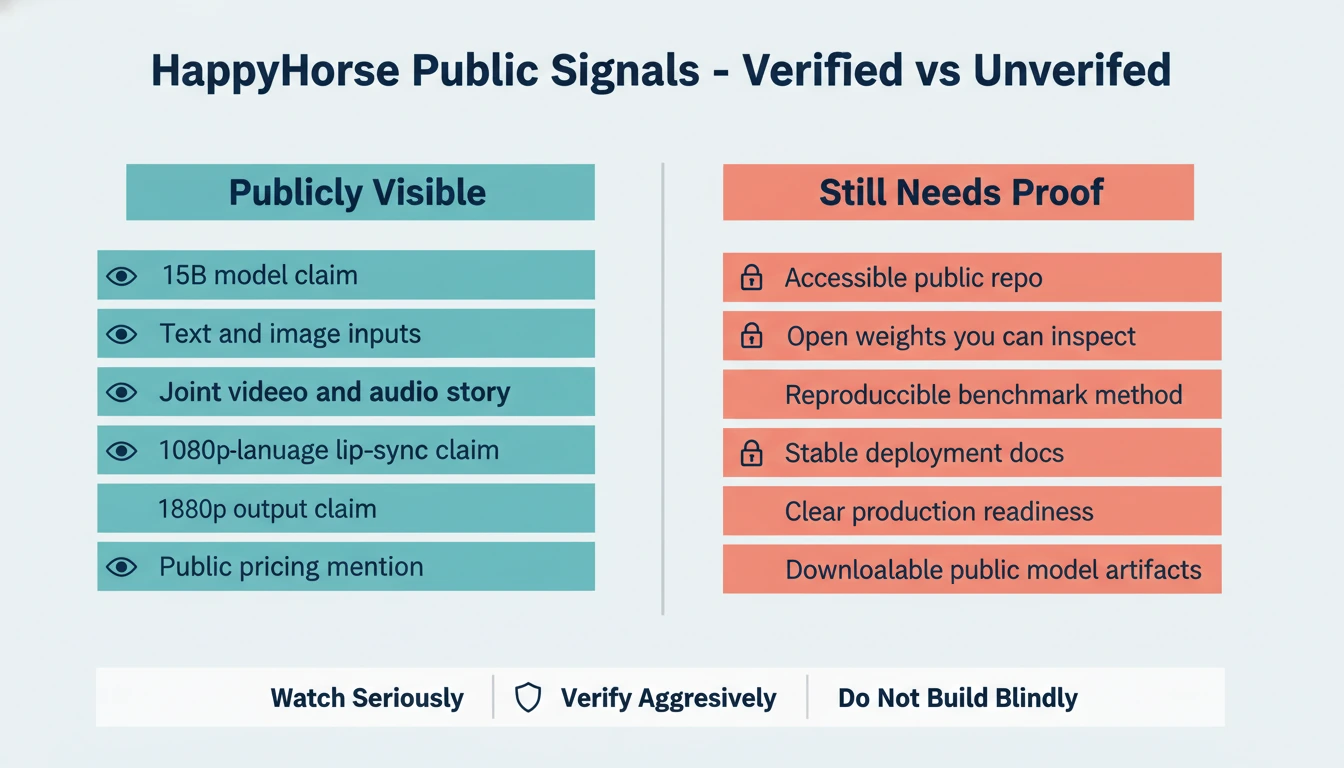

本当に検証できていることと、まだ証拠が必要なこと

いまの HappyHorse を読むうえで最も役立つのは、公開情報を二つの箱に分けることです。直接観察できるものと、独立確認がまだ必要なものです。

| ステータス | 該当するもの | そう分類する理由 |

|---|---|---|

| 公開確認可能 | サイト上の機能主張、価格表現、デプロイ例、benchmark 表、サンプル動画 | これらは現行サイト上で直接見える公開主張です。 |

| まだ独立検証不足 | open-source の実在性、公開 weights、self-hostable codebase、再現可能な benchmark 手法、本番運用の readiness | 参照される公開リポジトリが使えず、モデル経路も認証なしでは確認できません。 |

ここが重要なのは、多くのクリエイターが次の二つの問いを混ぜてしまうからです。

一つ目は、

- このプロジェクトは、首尾一貫した技術的にもっともらしいストーリーを提示しているか?

二つ目は、

- 今日の時点で、自分で検証し、ダウンロードし、再現し、運用できるか?

現状の HappyHorse は、二つ目より一つ目の問いに強く答えている状態です。

それはプロジェクトの価値を消すわけではありません。ただ、取るべき行動を変えます。研究者や新しいインフラを追う立場なら観察する価値があります。一方で締め切りを持つクリエイターなら、すでに安定運用できるツールで作り続けるほうが合理的です。

なぜ HappyHorse は注目されているのか

HappyHorse が注目されるのは、クリエイターが同時に欲しいものをまとめて語っているからです。

- オープン、あるいはそれに近いポジショニング

- 無音動画ではなくマルチモーダル生成

- 複数言語での lip-sync

- 純 SaaS 依存ではない self-hosting の語り

- 既存の open video 系と戦えそうに見える benchmark framing

この組み合わせは、今の市場の緊張点にちょうど刺さります。多くのクリエイターは新しい動画システムの品質向上を欲していますが、閉じたツール、地域ごとに不安定なロールアウト、単一価格面に縛られたくはありません。HappyHorse はその欲求に直接語りかけています。

もう一つ理由があります。HappyHorse は、単なるモデルではなく、運用として完結していそうな workflow を語っていることです。多くの動画モデルページでは、動画生成はここ、音声追加は別、lip-sync 修正はさらに別、upscale は後回し、タイミング調整は手作業、という分断が残っています。HappyHorse はもっと統合された道筋を約束しています。

だからこそ、公開検証が追いついていなくても重要に見えるのです。クリエイターが本当に欲しい workflow を指しているからです。

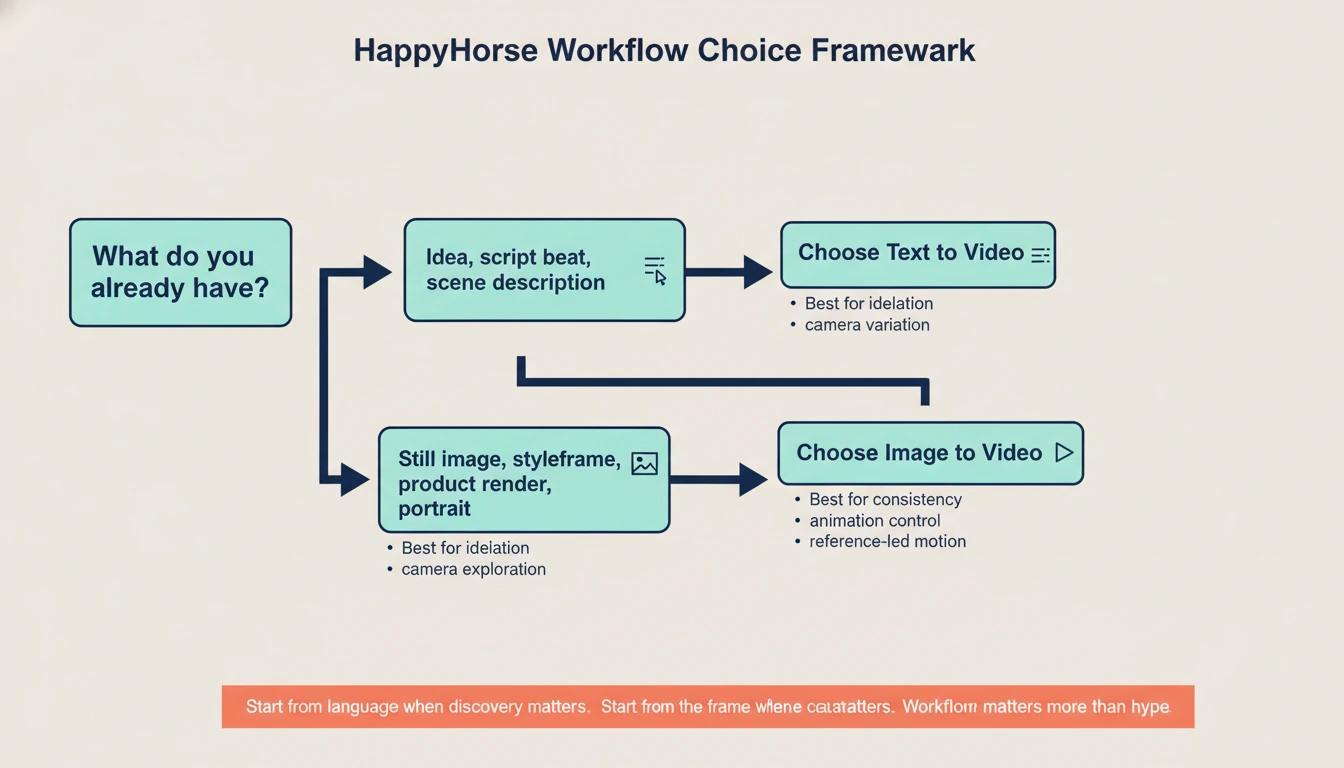

本当に問うべきこと: Text to Video か、Image to Video か

たとえ HappyHorse が将来すべての公開主張を実現しても、多くのクリエイターは今と同じ核心的な選択を迫られます。出発点が「言葉」なのか「1 枚の絵」なのか、ということです。

この選択は、モデル名より重要です。

| ワークフロー | 最適な出発点 | 得られるもの | 主な弱点 |

|---|---|---|---|

| Text to video | アイデア、脚本の一拍、シーン説明、カメラ指示はあるが、まだ固定 keyframe はない | アイデア探索が速く、概念展開がしやすく、prompt 主導のバリエーションも出しやすい | 頭の中の絵が具体的すぎると構図がぶれやすい |

| Image to video | すでに静止画、キャラフレーム、商品レンダー、storyboard frame、hero shot がある | 被写体の一貫性が高く、アートディレクションを締めやすく、承認済み visual のアニメ化に向く | 元フレームが弱いと大きなシーン変化には不利 |

新モデルのローンチを追いかけると、多くの人がここでつまずきます。新しいモデルそのものが workflow だと思い始めるのです。しかしそうではありません。workflow は、あくまで自分がすでに持っている creative asset から始まります。

text to video が向いているのは次のような場合です。

- 複数のシーン案を素早く探したい

- 一つの文章コンセプトから複数のカメラ案を見たい

- まだビジュアル方向を固めていない

- frame を固定する前に mood、action、narrative beat を回したい

image to video が向いているのは次のような場合です。

- すでに強い静止画を持っている

- キャラクター、商品、構図を reference に寄せたい

- key visual、広告素材、portrait、storyboard panel を動かしたい

- オープンな発散より visual consistency が重要

HappyHorse は将来的に両方の経路を一つの ecosystem で扱えるかもしれません。ただ、ほとんどのクリエイターにとって変わるのは実行モデルだけで、判断の木そのものは変わりません。

紙の上で HappyHorse が強く見える場所

公開ポジショニングが大筋で正しいなら、HappyHorse はいくつかの具体的な場面で特に魅力的です。

1. 対話中心の短尺動画

動画と音声の同時生成、さらに多言語 lip-sync は、このパッケージでもっとも目立つ組み合わせです。もしサイトが示唆する水準で本当に動くなら、ただの無音クリップ生成器とはまったく違う価値があります。

たとえば次の用途です。

- talking avatar コンテンツ

- 短い explainer

- 多言語 creator 動画

- 画面内で話す product intro

- dialogue first の SNS 動画

2. オープン、または self-hosted な実験

多くのチームは、良い output だけを求めているわけではありません。自分たちで inspect、tune、benchmark、場合によっては自社 GPU へ deploy できる infrastructure を求めています。だから open-source の角度が重要なのです。

もし HappyHorse が本当に使える weights、inference code、distillation option を出してくるなら、クリエイターだけでなく次の層にも関係してきます。

- applied AI チーム

- 研究グループ

- privacy 制約の強いスタジオ

- 社内 media pipeline を試す企業

3. image-to-video での強いスタイル制御

プロジェクトは text と image の両入力を主張しています。実務では、image 主導の生成に対応するモデルは、純 text 系より商用ワークに向くことが少なくありません。image-first workflow のほうが制御しやすいからです。

その意味で、HappyHorse が完全検証される前でも、自分の工程を image to video ワークフロー で試しておく価値があります。承認済み still、styleframe、商品画像、キャラクター reference から始まる production logic を持つなら、image-led animation のほうが転用しやすい workflow です。

公開ストーリーがまだ脆いと感じる点

ここは多くのローンチ記事が飛ばす部分です。弱さは必ずしもモデルそのものの弱さではなく、信頼性と運用性の弱さです。

公開アーティファクトの不一致

現在の公開資料は、完成済みの技術プロダクトのような自信で語っています。しかし公開リポジトリの経路はその自信を支えていません。open-source credibility を前面に出すなら、アクセス可能な artifact は必須です。

benchmark に対する信頼ギャップ

benchmark 表は簡単に出せます。再現可能な評価詳細はずっと難しいです。明確に点検できる report、安定した code access、第三者再現の経路が出てくるまでは、benchmark 数字は「方向性の主張」として読むべきで、「確定済みの事実」として読むべきではありません。

本番 readiness の曖昧さ

モデルは real で impressive でも、まだ dependable production use に耐えないことがあります。期限のあるチームが見るのは、次のような点です。

- 安定したアクセス

- failure mode の文書化

- rate の予測可能性

- 再現可能な環境

- 目に見える更新 cadence

HappyHorse は、これらを評価するための公開された運用面がまだ足りません。

いまクリエイターがすべきこと

HappyHorse が気になるとしても、やるべきことは過大評価か過小評価かを議論することではありません。まず自分のワークフローのリスクを下げることです。

次の表を実務判断に使ってください。

| あなたの状況 | いま取るべき行動 |

|---|---|

| 主に prompt からの概念探索が必要 | 信頼できる text to video ワークフロー を土台にし、HappyHorse は watchlist に入れる |

| すでに concept frame、product still、portrait がある | image to video 中心で組み、新モデルは一貫性が明確に良くなるときだけ試す |

| 短期の公開よりオープンな基盤が重要 | HappyHorse を注意深く追い、アクセス可能な重み、コード、再現可能なドキュメントの公開を待つ |

| 今週中に publishable asset が必要 | まだ公開検証が不完全なモデルを content calendar の中心に置かない |

多くの launch 記事に欠けているのは、まさにこの practical lens です。HappyHorse が未来かどうかを今決める必要はありません。今日の自分にとって、何が最も現実的に出力を出せるかを決めればいいのです。

HappyHorse の公開露出を追う場所

このプロジェクトが公開ディレクトリや紹介ページでどう扱われているかを追いたいなら、日本語での紹介例として HappyHorse AI動画ジェネレーターとは を見ておく価値があります。あくまで発見の手がかりとして役立つのであって、検証可能なコード、安定した重み、再現可能なデプロイ成果物の代わりにはなりません。

さらに公開資料が増えたときの評価ポイント

HappyHorse がより多くの公開インフラを出してきたら、本当に見るべきテストは次の通りです。

- 未ログインのユーザーが行き止まりなく本物のリポジトリ、ドキュメント、モデルページに到達できるか?

- 重み、推論スクリプト、デプロイ手順は公開面ごとに一貫しているか?

- text-to-video 経路はシネマティックなプロンプトに対して実用的な一貫性で応答するか?

- image-to-video 経路は motion を加えても subject と composition を保てるか?

- 同期 audio は本当に usable か、それとも重い cleanup がまだ必要か?

- 多言語 lip-sync の主張は、選ばれた短いデモ以上に公開で見えるか?

- 開示された hardware 条件で、公開 performance を creator や engineer が再現できるか?

これらが答えられるまでは、正しい姿勢は informed interest であって blind adoption ではありません。

FAQ

HappyHorse は今 open source ですか?

HappyHorse は商用利用可の open source として公開上は提示されていますが、現時点で公開リポジトリの経路は直接確認できません。open-source claim 自体は見えていますが、公開 artifact chain はまだ閉じていません。

HappyHorse は text-to-video ですか、それとも image-to-video ですか?

現在の公開サイトでは両方として提示されています。それが注目を集める理由の一つでもあります。ただ、より実用的な問いは、いまの入力にどちらが合うかです。prompt 主導の ideation なら text to video、reference 主導の animation なら image to video です。

HappyHorse は本番利用に向いていますか?

将来的に production relevant になる可能性はありますが、現状の公開検証レベルでは、締め切りに敏感な pipeline の中心として勧めるにはまだ弱いです。

なぜこんなに注目されるのですか?

open model 的な位置づけに、同期音声、多言語 lip-sync、text と image の両入力を組み合わせているからです。単なる無音動画モデルの benchmark スクリーンショットより、workflow としての魅力がずっと強いからです。

HappyHorse が成熟するまで何を使うべきですか?

workflow-first で考えてください。scene がまだ prompt 主導なら text to video、動かしたい frame がすでにあるなら image to video を使うのが自然です。

最終結論

HappyHorse は注目に値しますが、盲信には値しません。公開ストーリーは真剣に追うだけの強さがあり、同時に厳しく検証すべきだけの弱さもあります。

もし将来、いまの公開主張を安定した artifact とともに実現できるなら、HappyHorse は市場で最も面白い open video project の一つになるかもしれません。それまでは、launch page の高揚感を production dependency に変えないことです。今日すでに成果を出せる workflow に乗りながら、評価基準は高く保ち、HappyHorse は「証拠のギャップをまだ埋めている途中の有望株」として扱うのが最も健全です。