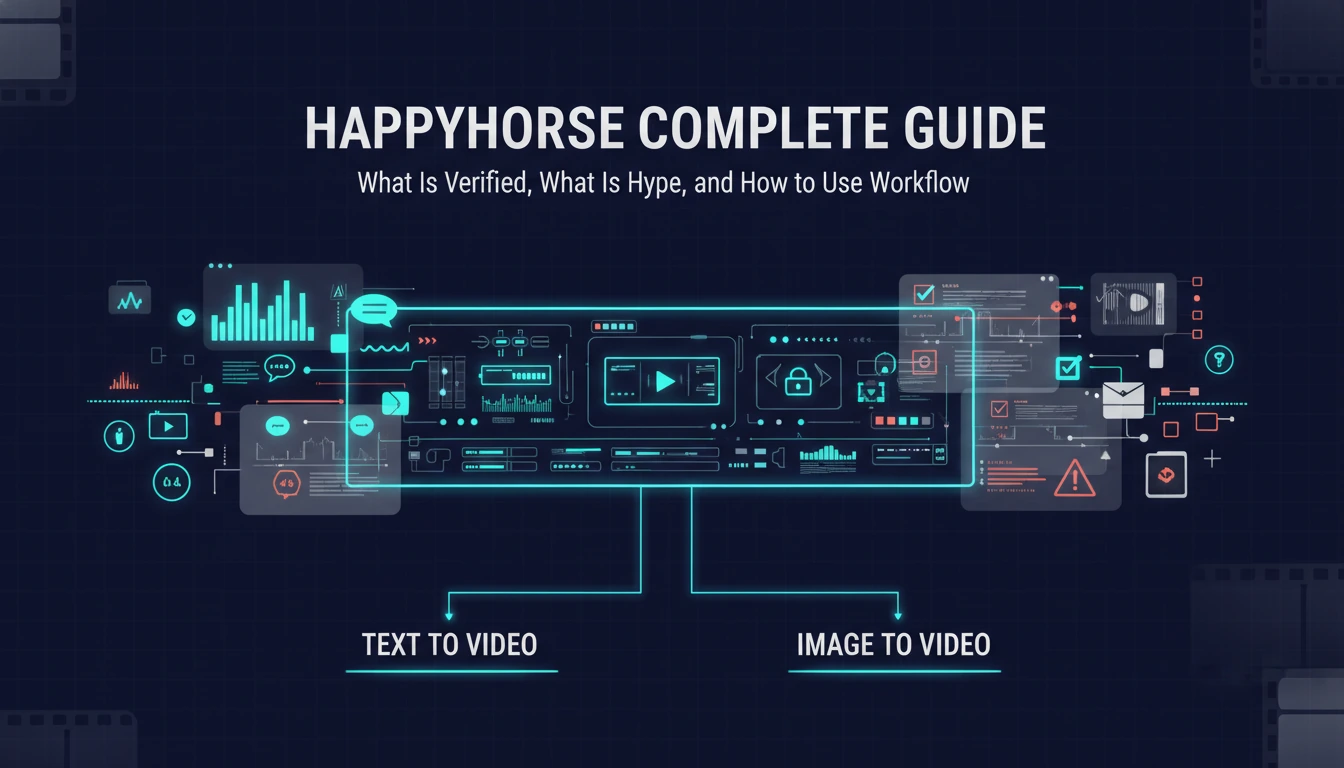

Se stai cercando una guida completa a HappyHorse, il vero problema non è capire il pitch di marketing. Il vero problema è separare ciò che oggi è pubblicamente visibile da ciò che può essere verificato in modo indipendente, e poi decidere se HappyHorse sia qualcosa da osservare, da provare o da usare davvero in modo affidabile.

All’8 aprile 2026, i materiali pubblici di HappyHorse raccontano una storia molto ambiziosa. Presentano HappyHorse 1.0 come un modello video multimodale open source con audio sincronizzato, lip-sync in sette lingue, output a 1080p, permesso per uso commerciale, supporto al self-hosting e benchmark molto forti. È una proposta convincente. Ma apre anche subito un problema di verifica, perché il percorso pubblico verso il codice non è accessibile con un controllo diretto, mentre il percorso di hosting del modello mostrato negli esempi di deployment non è liberamente accessibile da utente non autenticato.

Questo non significa automaticamente che HappyHorse sia finto. Significa però che ogni affermazione va letta con il frame giusto: progetto interessante, verifica pubblica incompleta e prontezza per la produzione ancora poco chiara. In questa guida vediamo cosa sembra reale, cosa richiede ancora prove, dove HappyHorse appare più rilevante e perché, se ti serve output subito, un workflow text to video o un workflow image to video è spesso una scelta più pratica dell’attesa.

Risposta breve

HappyHorse sembra un progetto promettente nel video AI, con una narrativa pubblica forte attorno a pesi aperti, generazione audio, lip-sync e self-hosting. Però le prove pubbliche oggi disponibili non bastano per trattare ogni headline claim come infrastruttura già pienamente confermata e pronta per l’adozione senza rischi.

Ecco il riassunto pratico:

| Domanda | Risposta pratica |

|---|---|

| HappyHorse è interessante? | Sì. Il set di funzioni pubbliche è insolitamente ambizioso per un modello video presentato come aperto e self-hostable. |

| È già pienamente verificato come modello open pubblico? | Non ancora. Il repository pubblico non è disponibile e il percorso del modello mostrato sul sito non è accessibile senza login. |

| Va ignorato? | No. Vale la pena seguirlo se ti interessa la generazione video multimodale aperta. |

| Ha senso costruirci oggi la pipeline di contenuti? | Solo se accetti il rischio di verifica e puoi tollerare artefatti pubblici incompleti. |

| Cosa dovrebbero fare ora i creator? | Usare un workflow text to video già affidabile per la generazione guidata da prompt oppure un workflow image to video per animazioni guidate da reference mentre HappyHorse matura. |

Il punto centrale è questo: oggi HappyHorse è più credibile come progetto ad alto potenziale da monitorare che come fondazione pronta all’uso per una produzione seria.

Cosa dichiara pubblicamente HappyHorse in questo momento

I materiali pubblici attuali di HappyHorse raccontano una storia di prodotto abbastanza precisa, non una semplice teaser page vaga. Tra le affermazioni visibili troviamo:

- un modello da 15B parametri

- un’architettura Transformer a 40 layer

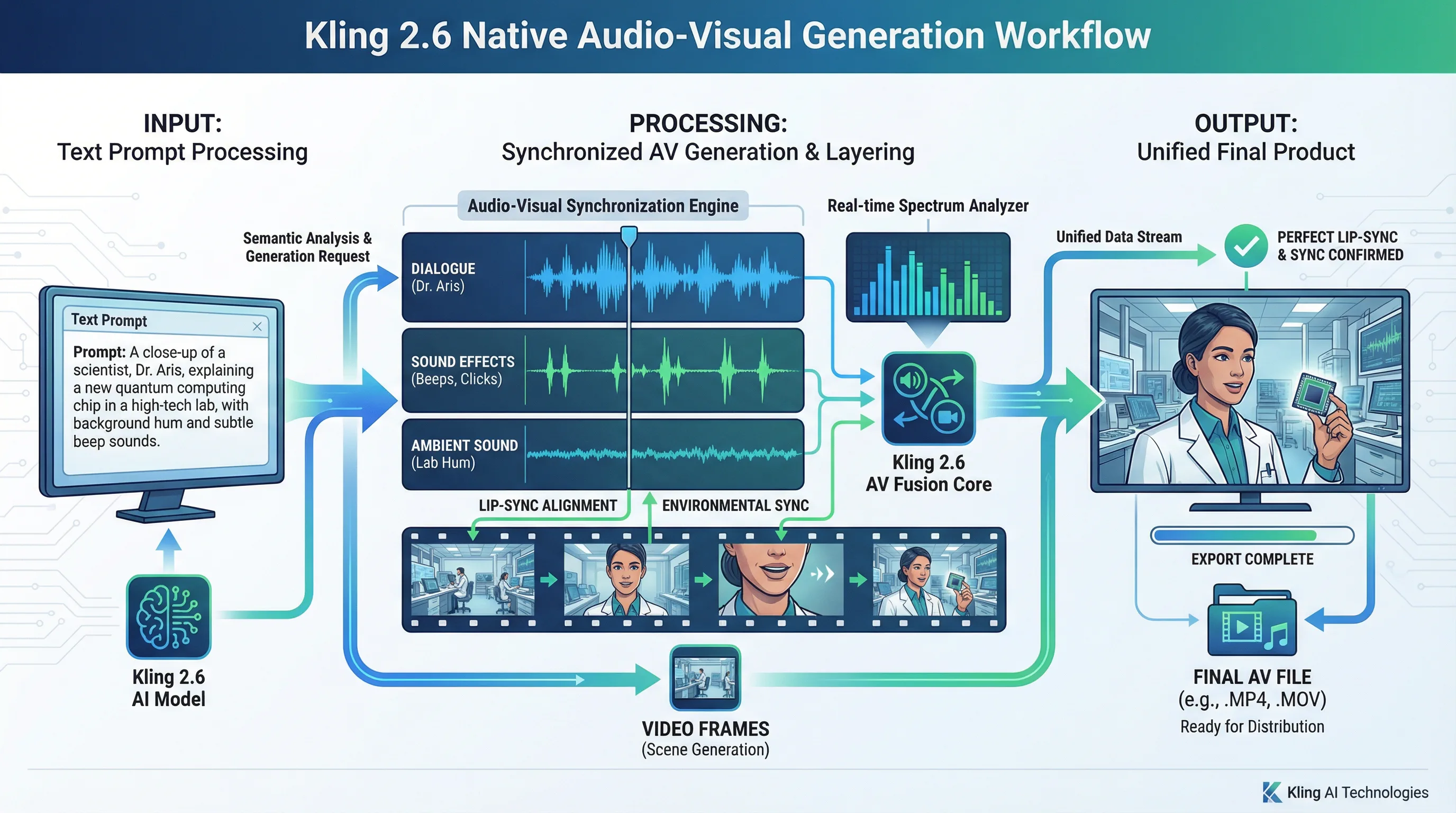

- generazione congiunta di video e audio

- supporto per prompt di testo e immagine

- lip-sync in sette lingue

- output a 1080p

- clip da 5 a 8 secondi

- self-hosting su GPU di classe H100 o A100

- release open source con permesso d’uso commerciale

- prezzo di partenza da

$11.90

Non sono formule generiche da landing page. Sembrano piuttosto il linguaggio di un lancio tecnico che vuole essere preso sul serio sia dai creator sia dai ricercatori.

Il sito riporta anche claim più concreti di tipo prestazionale, tra cui:

- circa 38 secondi per un clip da 5 secondi in 1080p su H100

- supporto al lip-sync in inglese, mandarino, cantonese, giapponese, coreano, tedesco e francese

- benchmark superiori a OVI 1.1 e LTX 2.3

- un presunto posizionamento alto in una leaderboard pubblica di modelli video

Sulla carta, questo pacchetto sarebbe molto attraente. Un modello che unisce text-to-video, image-to-video, audio sincronizzato, lip-sync multilingue e apertura compatibile con uso commerciale si distinguerebbe subito. Il problema non è la qualità della storia. Il problema è il divario tra la storia e gli artefatti pubblici realmente accessibili oggi.

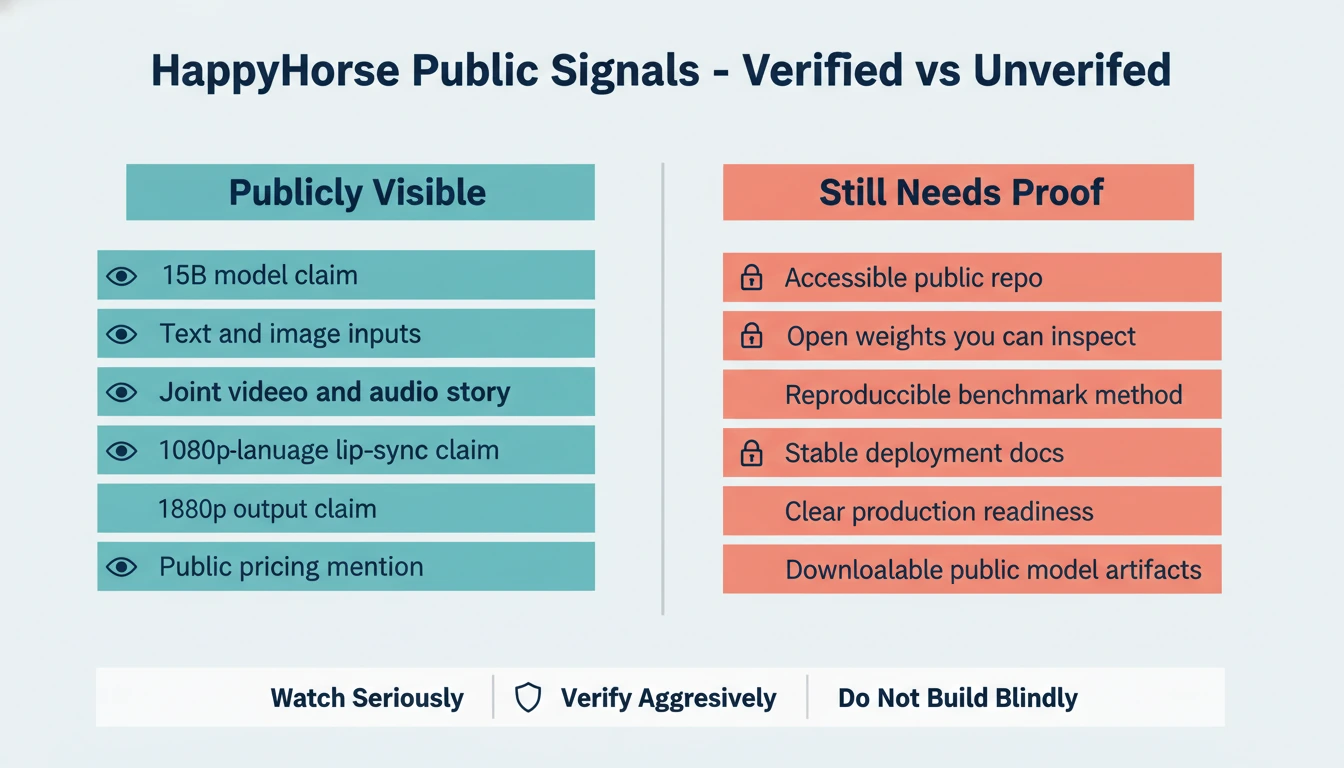

Cosa è davvero verificato e cosa richiede ancora prove

Il modo più utile per leggere HappyHorse oggi è dividere le informazioni pubbliche in due gruppi: claim osservabili direttamente e claim che hanno ancora bisogno di conferma indipendente.

| Stato | Cosa rientra qui | Perché rientra qui |

|---|---|---|

| Visibile pubblicamente | Claim di funzionalità sul sito, menzione del prezzo, esempi di deployment, tabelle benchmark, sample video | Questi elementi sono direttamente visibili sul sito attuale e possono essere ispezionati come claim pubblicati. |

| Non ancora confermato a sufficienza | Disponibilità open source, pesi pubblici, codebase self-hostable, metodologia benchmark riproducibile, readiness per la produzione | Il percorso del repository linkato non è disponibile e il percorso del modello referenziato non è accessibile senza autenticazione. |

Questa distinzione conta perché i creator spesso comprimono due domande separate in una sola.

La prima domanda è:

- Il progetto presenta una storia coerente e tecnicamente plausibile?

La seconda domanda è:

- Posso validarlo, scaricarlo, riprodurlo e farlo girare oggi in modo indipendente?

Al momento, HappyHorse risponde meglio alla prima domanda che alla seconda.

Questo non boccia il progetto. Cambia solo l’azione corretta. Se sei un ricercatore o investi attenzione su progetti emergenti, vale la pena seguirlo. Se sei un creator con scadenze reali, conviene continuare a pubblicare con strumenti che già oggi generano in modo affidabile.

Perché HappyHorse sta attirando attenzione

HappyHorse sta attirando attenzione perché mette insieme più cose che i creator vogliono contemporaneamente:

- un posizionamento aperto o almeno open-leaning

- generazione multimodale invece di video muti

- supporto al lip-sync in più lingue

- linguaggio da self-hosting invece di pura dipendenza SaaS

- benchmark impostati in modo da suggerire competitività rispetto ai modelli video open più noti

Questo mix intercetta in pieno la tensione attuale del mercato. Molti creator vogliono i miglioramenti qualitativi dei sistemi video più recenti, ma non vogliono rimanere bloccati in tool chiusi, rollout regionali instabili o modelli di prezzo legati a una sola interfaccia. HappyHorse parla esattamente a questo desiderio.

C’è anche una seconda ragione per cui se ne parla: il progetto descrive un workflow che suona operativo e completo. Molte pagine di modelli video ti costringono ancora a montare lo stack da solo. Generi il video in un posto. Aggiungi la voce in un altro. Correggi il lip-sync altrove. Fai upscale dopo. Sistemi il timing a mano. HappyHorse promette un percorso più integrato.

Ecco perché il progetto sembra importante anche prima che la verifica pubblica sia completa. Sta puntando al workflow che i creator vogliono davvero.

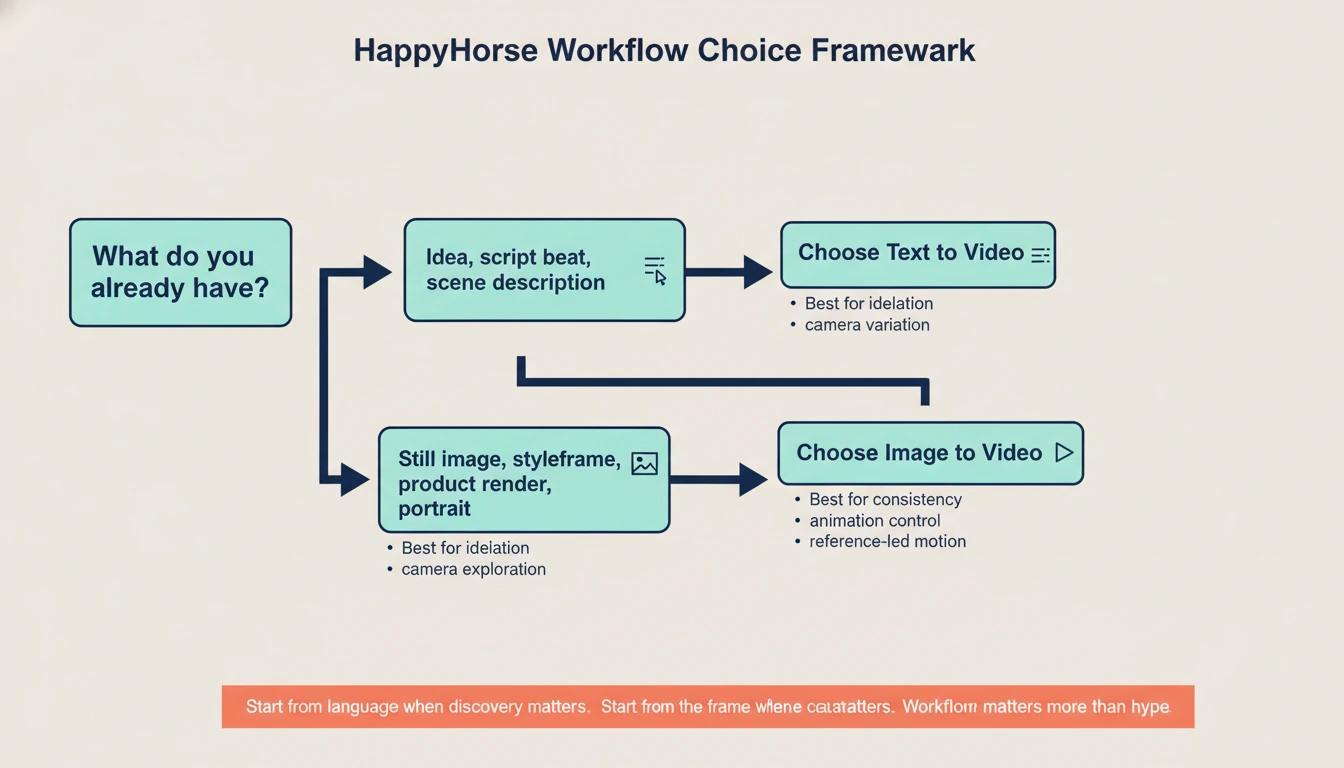

La vera domanda di workflow: Text to Video o Image to Video?

Anche se HappyHorse finisse per mantenere tutte le promesse pubbliche, la maggior parte dei creator dovrebbe comunque fare la stessa scelta chiave di oggi: partire dal linguaggio o da un frame?

Questa scelta conta più del nome del modello.

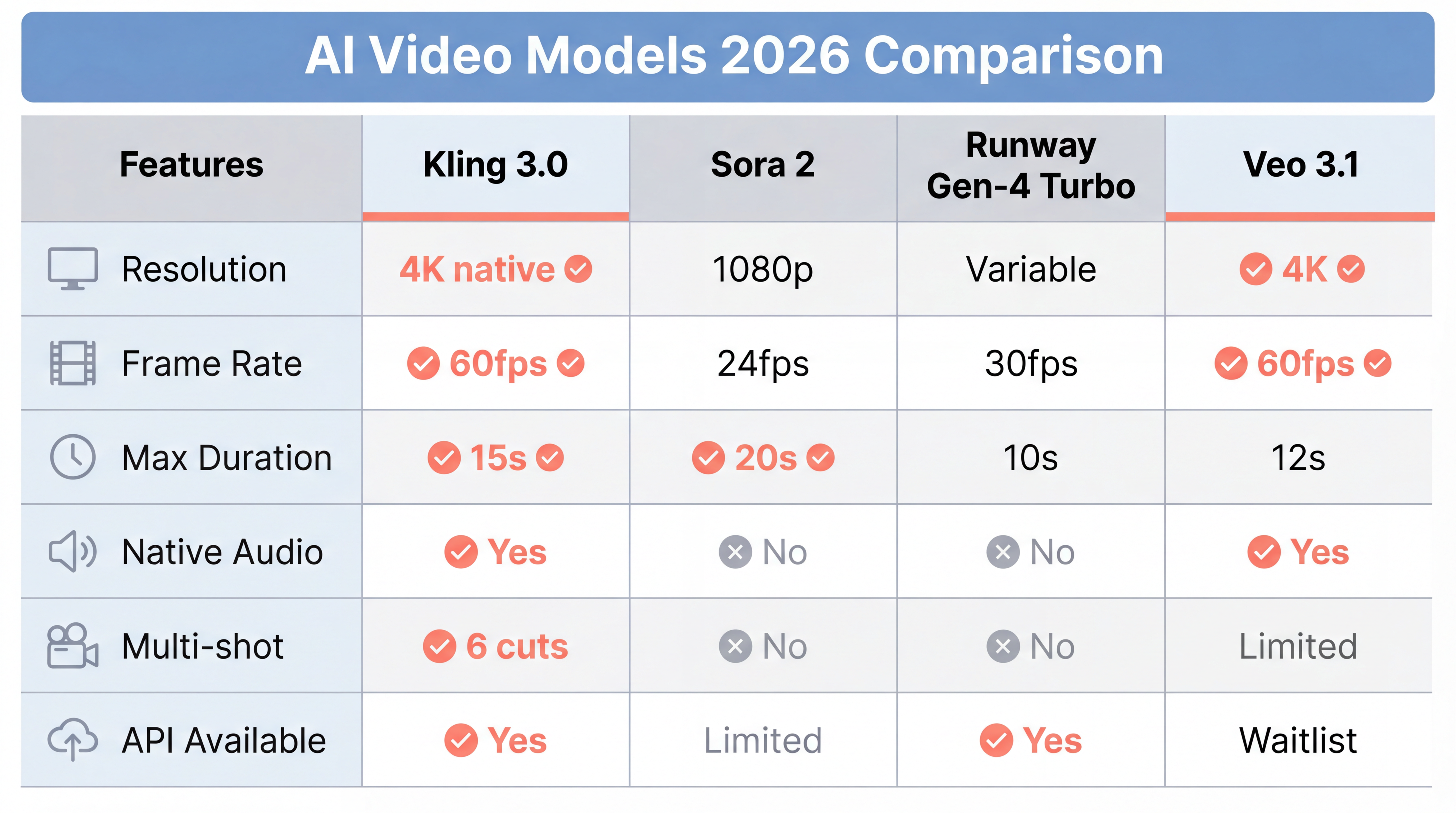

| Workflow | Miglior punto di partenza | Cosa offre | Debolezza principale |

|---|---|---|---|

| Text to video | Hai un’idea, un beat di script, una descrizione di scena o una direzione di camera, ma non ancora un keyframe fisso | Ideazione più rapida, esplorazione concettuale più facile, maggiore varietà guidata da prompt | La composizione può deragliare quando l’immagine mentale è molto precisa |

| Image to video | Hai già un’immagine fissa, un frame personaggio, un render prodotto, un frame storyboard o una hero shot | Migliore coerenza del soggetto, art direction più stretta, animazione più controllata di visual già approvati | Meno libertà nei grandi cambi di scena se il frame sorgente non è abbastanza forte |

È proprio qui che molte persone si bloccano quando inseguono il lancio di un nuovo modello. Iniziano a pensare che il nuovo modello sia il workflow stesso. Non è così. Il workflow continua a partire dall’asset creativo che hai già.

Usa text to video quando:

- stai esplorando rapidamente più idee di scena

- ti servono setup camera alternativi a partire da un solo concetto scritto

- stai ancora definendo la direzione visiva

- vuoi iterare su mood, azione o battute narrative prima di bloccare un frame

Usa image to video quando:

- hai già una still forte

- ti serve che personaggio, prodotto o composizione restino vicini a una reference

- stai animando un key visual, un visual pubblicitario, un ritratto o un pannello storyboard

- la coerenza visiva conta più dell’esplorazione aperta

HappyHorse potrebbe un giorno supportare entrambi i percorsi nello stesso ecosistema. Per la maggior parte dei creator, però, questo non cambia l’albero decisionale: cambia solo il modello che lo esegue.

Dove HappyHorse sembra più forte sulla carta

Se il posizionamento pubblico è almeno direzionalmente corretto, HappyHorse risulterebbe particolarmente convincente in alcuni scenari specifici.

1. Video brevi guidati dal dialogo

La combinazione tra generazione congiunta di video e audio e lip-sync multilingue è l’elemento più interessante del pacchetto. Se queste funzioni lavorano davvero al livello suggerito dal sito, HappyHorse sarebbe molto più interessante di un altro generatore di clip muti con benchmark eleganti.

Questo sarebbe importante per:

- contenuti con avatar parlanti

- brevi video esplicativi

- video creator multilingue

- intro prodotto con parlato in scena

- contenuti social centrati sul dialogo

2. Sperimentazione open o self-hosted

Molti team non vogliono solo un output buono. Vogliono un’infrastruttura che possano ispezionare, ottimizzare, benchmarkare e magari distribuire sulle proprie GPU. Per questo l’angolo open source conta così tanto.

Se HappyHorse rilascerà davvero pesi utilizzabili, codice di inferenza e opzioni di distillazione, diventerà rilevante non solo per i creator ma anche per:

- team di AI applicata

- gruppi di ricerca

- studi con vincoli di privacy

- aziende che stanno testando pipeline media interne

3. Maggiore controllo stilistico in image-to-video

Il progetto dichiara supporto per input testuale e visivo. In pratica, i modelli che supportano generazione guidata da immagine diventano spesso molto più utili nel lavoro commerciale dei sistemi solo testuali, perché i workflow image-first sono più controllabili.

Per questo, anche prima che HappyHorse sia pienamente verificabile, ha senso mettere sotto stress il proprio processo con un workflow image to video. Se la tua logica produttiva dipende da still approvate, styleframe, visual di prodotto o reference di personaggio, l’animazione guidata da immagine è il workflow più trasferibile.

Dove la narrativa pubblica resta fragile

Questa è la parte che molti articoli di lancio saltano. Le debolezze non sono necessariamente debolezze del modello. Sono debolezze di fiducia e operatività.

Disallineamento degli artefatti pubblici

I materiali pubblici attuali parlano con la sicurezza di un prodotto tecnico già completamente lanciato. Il percorso pubblico del repository non sostiene questa sicurezza. Se un progetto vuole guidare con credibilità open source, artefatti accessibili non sono opzionali.

Gap di fiducia nei benchmark

Le tabelle benchmark sono facili da pubblicare. I dettagli di valutazione riproducibili sono molto più difficili. Finché non esisteranno report chiaramente ispezionabili, accesso stabile al codice o percorsi di riproduzione di terze parti, questi numeri andrebbero letti come claim direzionali, non come fatti consolidati.

Prontezza produttiva ancora ambigua

Un modello può essere reale, impressionante e comunque non pronto per un uso di produzione affidabile. I team con deadline guardano soprattutto a:

- accesso stabile

- failure mode documentati

- prevedibilità del rate

- ambienti riproducibili

- cadence di aggiornamento visibile

Su questi punti HappyHorse oggi espone ancora troppo poca superficie operativa pubblica per ottenere un punteggio alto.

Cosa dovrebbero fare adesso i creator

Se sei curioso di HappyHorse, la mossa migliore non è discutere se sia sopravvalutato o sottovalutato. La mossa migliore è ridurre il rischio del tuo workflow da subito.

Usa questa tabella come guida:

| La tua situazione | Mossa migliore ora |

|---|---|

| Ti serve soprattutto esplorazione concettuale a partire da prompt | Costruisci attorno a un workflow text to video affidabile e tieni HappyHorse nella watchlist |

| Hai già frame concettuali, still di prodotto o ritratti | Costruisci attorno a image to video e testa nuovi modelli solo quando offrono migliore coerenza |

| Ti interessa più l’infrastruttura aperta che pubblicare nell’immediato | Segui da vicino HappyHorse e aspetta pesi accessibili, codice e documentazione riproducibile |

| Ti servono asset pubblicabili questa settimana | Non basare il tuo calendario contenuti su un modello con verifica pubblica ancora incompleta |

È questa la lente pratica che manca in gran parte della copertura dei lanci. Non devi decidere oggi se HappyHorse sia il futuro. Devi solo capire cosa ti aiuta a pubblicare adesso senza chiuderti alle tecnologie migliori di domani.

Dove seguire la copertura pubblica di HappyHorse

Se vuoi seguire come il progetto appare nelle directory pubbliche e nelle pagine in stile lancio, HappyHorse AI e il modello video HappyHorse sono due riferimenti utili. Considerali punti di scoperta, non sostituti di codice ispezionabile, pesi stabili e artefatti di deployment riproducibili.

Come valutare meglio HappyHorse quando arriveranno più artefatti pubblici

Quando HappyHorse esporrà più infrastruttura pubblica, i test davvero importanti saranno questi:

- Un utente non autenticato riesce a raggiungere il repository reale, la documentazione e la pagina del modello senza vicoli ciechi?

- Pesi, script di inferenza e istruzioni di deployment sono coerenti su tutte le superfici pubbliche?

- Il percorso text-to-video segue davvero prompt cinematografici con una coerenza utile?

- Il percorso image-to-video preserva soggetto e composizione quando introduce movimento?

- L’audio sincronizzato è davvero usabile o richiede ancora troppo cleanup?

- I claim sul lip-sync multilingue sono visibili in demo pubbliche oltre a pochi snippet curati?

- Un creator o un engineer può riprodurre le performance pubblicate sull’hardware dichiarato?

Finché queste domande restano aperte, la postura corretta è interesse informato, non adozione cieca.

FAQ

HappyHorse è open source in questo momento?

HappyHorse è presentato pubblicamente come open source con permesso di uso commerciale, ma il percorso pubblico del repository non è accessibile con un controllo diretto. Il claim open source è visibile. La catena pubblica degli artefatti resta incompleta.

HappyHorse è text-to-video o image-to-video?

Il sito pubblico attuale lo presenta come entrambe le cose. Ed è parte del motivo per cui sta attirando attenzione. La domanda più utile è quale workflow corrisponda ai tuoi input di oggi: text to video per ideazione guidata da prompt oppure image to video per animazione guidata da reference.

HappyHorse è pronto per la produzione?

Potrebbe diventare rilevante in produzione, ma il livello attuale di verifica pubblica non è ancora sufficiente per consigliarlo come centro di una pipeline sensibile alle scadenze.

Qual è il motivo principale per cui così tante persone guardano HappyHorse?

Perché combina posizionamento da modello aperto con audio sincronizzato, lip-sync multilingue e input sia testuale sia visivo. È una storia di workflow molto più attraente di un altro modello video muto con uno screenshot benchmark.

Cosa dovrei usare mentre HappyHorse matura?

Adotta un approccio workflow-first. Inizia con text to video quando la scena è ancora guidata dal prompt, e usa image to video quando hai già il frame che vuoi animare.

Verdetto finale

HappyHorse merita attenzione, ma non fiducia cieca. La sua storia pubblica è abbastanza forte da giustificare un monitoraggio serio e abbastanza fragile da richiedere una verifica aggressiva.

Se il modello arriverà davvero a mantenere gli attuali claim pubblici con artefatti stabili, potrebbe diventare uno dei progetti video open più interessanti sul mercato. Fino ad allora, i creator dovrebbero evitare di trasformare l’entusiasmo da launch page in dipendenza produttiva. Costruisci su workflow che ti aiutano già a pubblicare oggi, mantieni alti i tuoi standard di valutazione e considera HappyHorse un progetto promettente che deve ancora chiudere il suo gap di prova.