Si vous cherchez un guide complet sur HappyHorse, le vrai sujet n’est pas de comprendre le discours marketing. Le vrai sujet consiste à séparer ce qui est publiquement visible de ce qui est indépendamment vérifiable, puis à décider si HappyHorse est aujourd’hui quelque chose à surveiller, à tester ou à utiliser comme base fiable.

Au 8 avril 2026, les éléments publics autour de HappyHorse racontent une histoire très ambitieuse. HappyHorse 1.0 y est présenté comme un modèle vidéo multimodal open source avec audio synchronisé, lip-sync en sept langues, sortie 1080p, autorisation d’usage commercial, support du self-hosting et solides résultats de benchmark. L’ensemble est séduisant. Mais il pose aussi immédiatement un problème de vérification, car le chemin public vers le code n’est pas accessible dans un contrôle direct, et la route d’hébergement du modèle montrée dans les exemples de déploiement n’est pas ouverte non plus pour un utilisateur non connecté.

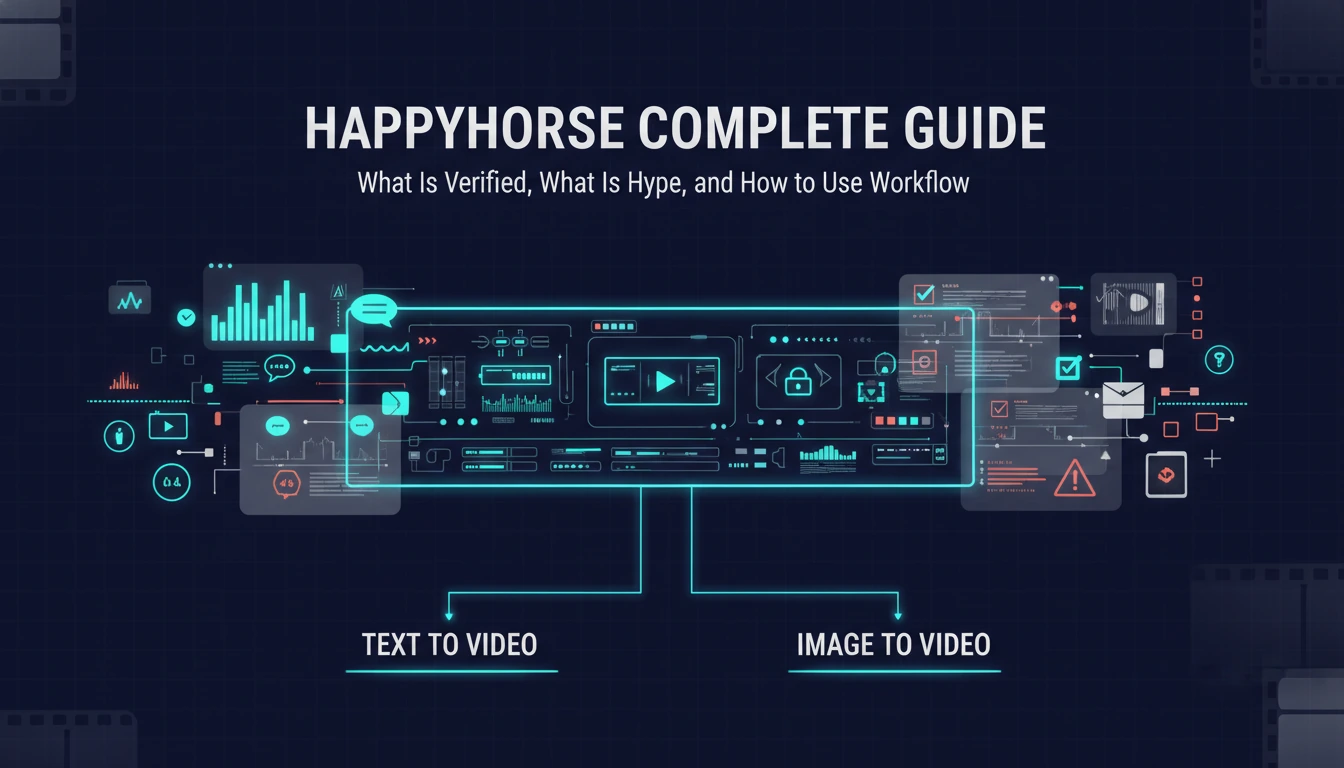

Cela ne veut pas automatiquement dire que HappyHorse est faux. Cela veut dire qu’il faut lire chaque promesse avec le bon cadre : projet excitant, vérification publique incomplète et niveau de préparation pour la production encore flou. Ce guide explique ce qui semble réel, ce qui demande encore des preuves, là où HappyHorse paraît le plus pertinent et pourquoi, si vous avez besoin de résultats maintenant, un workflow text to video ou un workflow image to video est souvent un meilleur choix qu’attendre.

Réponse courte

HappyHorse ressemble à un concept de modèle vidéo IA prometteur, avec un positionnement public fort autour des poids ouverts, de la génération audio, du lip-sync et du self-hosting. En revanche, les preuves publiques actuellement disponibles ne suffisent pas à considérer tous les grands claims comme une infrastructure déjà confirmée et prête à l’emploi sans risque.

Voici le résumé pratique :

| Question | Réponse pratique |

|---|---|

| HappyHorse est-il intéressant ? | Oui. Le set de fonctionnalités publiques est inhabituellement ambitieux pour un modèle vidéo présenté comme ouvert et auto-hébergeable. |

| Est-il déjà pleinement vérifié comme modèle ouvert public ? | Pas encore. Le dépôt public n’est pas accessible, et la route du modèle affichée sur le site ne l’est pas non plus sans connexion. |

| Faut-il l’ignorer ? | Non. Il mérite d’être surveillé si vous vous intéressez à la génération vidéo multimodale ouverte. |

| Faut-il bâtir sa pipeline de contenu autour de lui dès aujourd’hui ? | Seulement si vous acceptez le risque de vérification et des artefacts publics encore incomplets. |

| Que devraient faire les créateurs maintenant ? | Utiliser un workflow text to video éprouvé pour la génération guidée par prompt ou un workflow image to video pour l’animation pilotée par référence en attendant que HappyHorse mûrisse. |

L’idée centrale est simple : HappyHorse paraît aujourd’hui plus crédible comme projet à fort potentiel à suivre que comme fondation plug-and-play pour une production sérieuse.

Ce que HappyHorse affirme publiquement pour l’instant

Les matériaux publics visibles de HappyHorse racontent une histoire produit assez précise, et non une simple page teaser vague. Parmi les promesses visibles, on trouve :

- un modèle de 15B paramètres

- une architecture Transformer de 40 couches

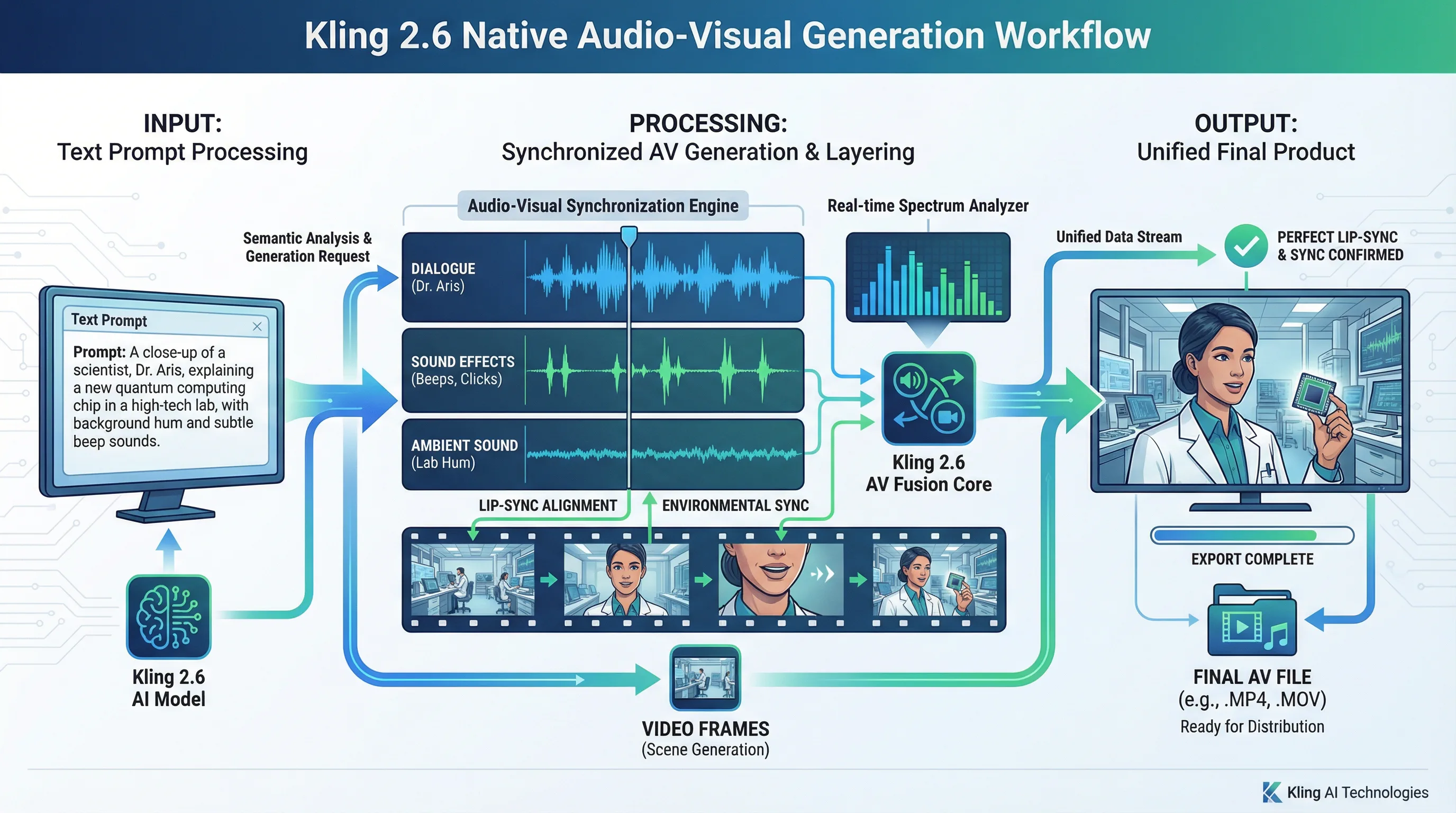

- une génération conjointe vidéo et audio

- le support des prompts texte et image

- un lip-sync en sept langues

- une sortie en 1080p

- des clips de 5 à 8 secondes

- le self-hosting sur GPU de classe H100 ou A100

- une sortie open source avec autorisation d’usage commercial

- un prix de départ à

$11.90

Ce ne sont pas des formulations génériques de landing page. Cela ressemble à une page de lancement technique conçue pour être prise au sérieux à la fois par les créateurs et par les chercheurs.

Le site fournit aussi des affirmations de type performance, notamment :

- environ 38 secondes pour produire un clip 1080p de 5 secondes sur H100

- un support du lip-sync en anglais, mandarin, cantonais, japonais, coréen, allemand et français

- des benchmarks meilleurs que OVI 1.1 et LTX 2.3

- une revendication de très bon classement sur un leaderboard public de modèles vidéo

Sur le papier, ce package placerait HappyHorse dans une position très attractive. Un modèle qui combine text-to-video, image-to-video, audio synchronisé, lip-sync multilingue et ouverture commercialement exploitable se démarquerait immédiatement. Le problème n’est pas la qualité du récit. Le problème est l’écart entre ce récit et les artefacts publics réellement accessibles aujourd’hui.

Ce qui est réellement vérifié et ce qui demande encore des preuves

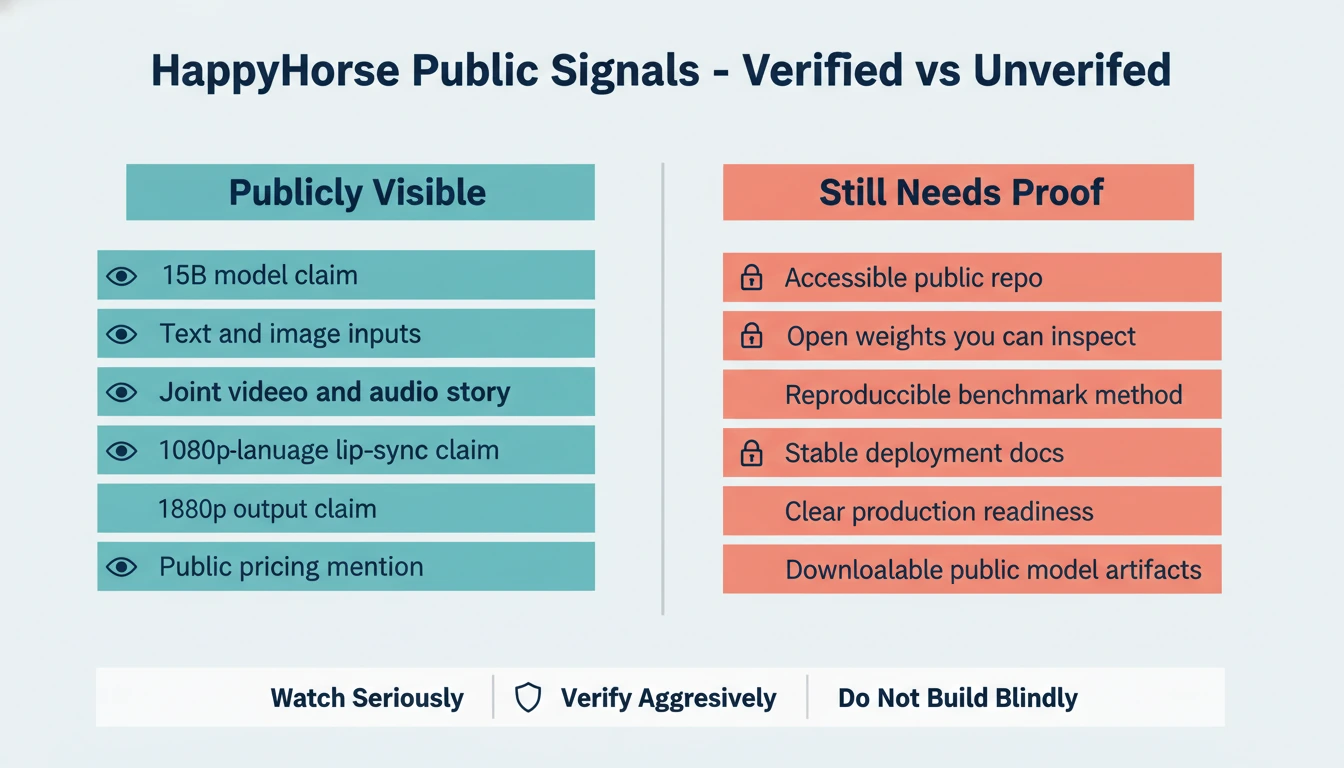

La manière la plus utile de lire HappyHorse actuellement est de diviser l’information publique en deux catégories : ce qui est directement observable et ce qui demande encore une confirmation indépendante.

| Statut | Ce qu’on y met | Pourquoi cela y appartient |

|---|---|---|

| Publiquement visible | Claims de fonctionnalités sur le site, mention du prix, exemples de déploiement, tableaux de benchmark, vidéos de démonstration | Ces éléments sont directement visibles sur le site actuel et peuvent être inspectés comme affirmations publiées. |

| Pas encore assez confirmé de façon indépendante | Disponibilité open source, poids publics, codebase self-hostable, méthodologie reproductible des benchmarks, readiness pour la production | Le dépôt public lié n’est pas accessible et le chemin du modèle référencé n’est pas publiquement ouvert sans authentification. |

Cette distinction compte, parce que beaucoup de créateurs mélangent deux questions séparées.

La première question est :

- Le projet raconte-t-il une histoire produit cohérente et techniquement plausible ?

La seconde question est :

- Puis-je le valider, le télécharger, le reproduire et l’exploiter de manière indépendante aujourd’hui ?

À ce stade, HappyHorse répond mieux à la première qu’à la seconde.

Cela ne condamne pas le projet. Cela change simplement l’action pertinente. Si vous êtes chercheur ou que vous suivez de près l’infrastructure open, il mérite d’être observé. Si vous êtes créateur avec des délais, mieux vaut continuer à livrer avec des outils déjà fiables.

Pourquoi HappyHorse attire l’attention

HappyHorse attire l’attention parce qu’il réunit plusieurs choses que les créateurs veulent simultanément :

- un positionnement ouvert ou au moins orienté ouverture

- une génération multimodale plutôt qu’une vidéo muette

- du lip-sync sur plusieurs langues

- un discours self-hosting plutôt qu’une dépendance totale au SaaS

- une mise en scène benchmark laissant penser qu’il peut rivaliser avec des efforts vidéo open connus

Ce mélange touche directement la tension actuelle du marché. Beaucoup de créateurs veulent les gains de qualité des derniers systèmes vidéo, sans être enfermés dans des outils fermés, des déploiements régionaux instables ou un modèle de prix dépendant d’une seule interface. HappyHorse parle exactement à ce besoin.

Il y a aussi une deuxième raison à sa diffusion : le projet décrit un workflow qui semble complet sur le plan opérationnel. Beaucoup de pages de modèles vidéo obligent encore à assembler soi-même la stack. Générer la vidéo d’un côté. Ajouter la voix ailleurs. Corriger le lip-sync dans un troisième outil. Upscaler plus tard. Nettoyer le timing à la main. HappyHorse promet une chaîne plus intégrée.

C’est pourquoi le projet paraît important avant même que la vérification publique complète ne le rattrape. Il pointe vers le workflow que les créateurs veulent vraiment.

La vraie question de workflow : Text to Video ou Image to Video ?

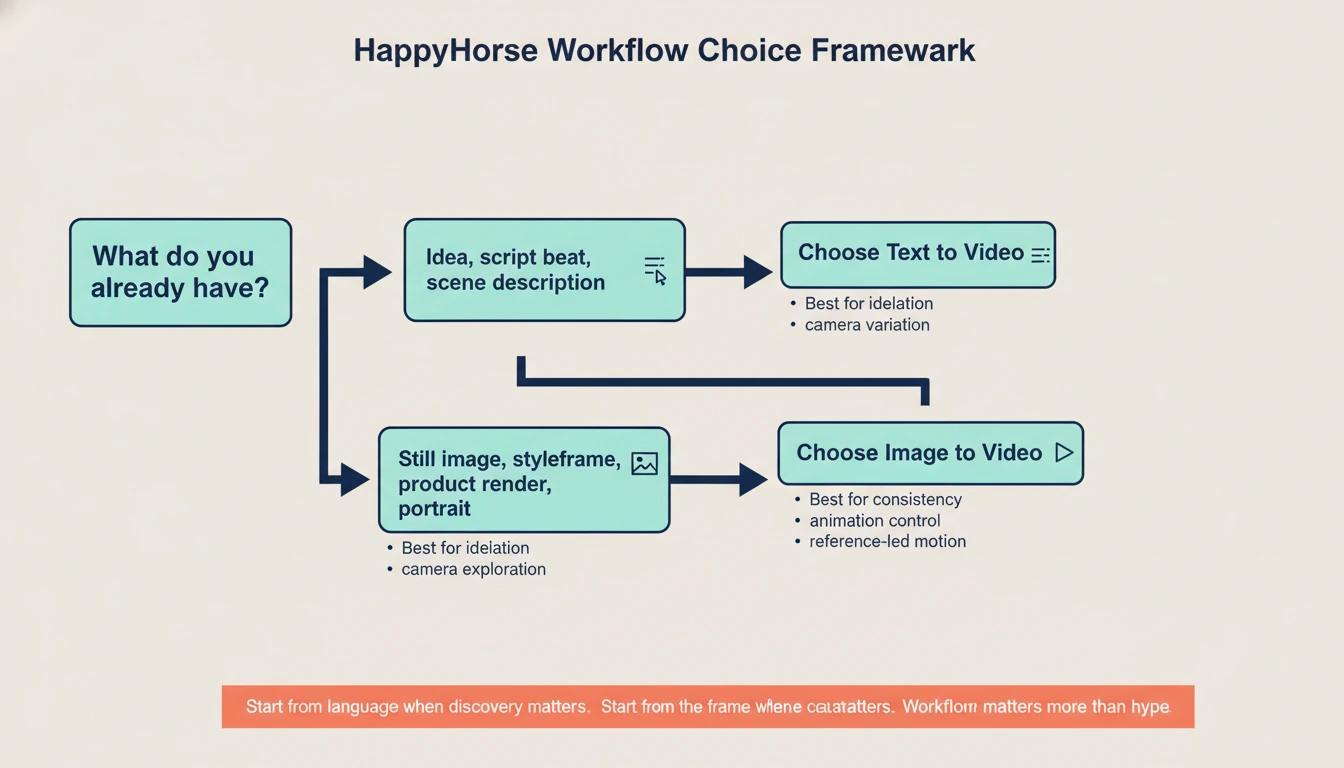

Même si HappyHorse finissait par tenir chaque promesse publique, la plupart des créateurs devraient toujours faire le même choix fondamental qu’aujourd’hui : démarrer depuis le langage ou depuis une image ?

Ce choix est plus important que le nom du modèle.

| Workflow | Meilleur point de départ | Ce qu’il apporte | Limite principale |

|---|---|---|---|

| Text to video | Vous avez une idée, un beat de script, une description de scène ou une direction caméra, mais pas encore de keyframe fixe | Idéation plus rapide, exploration conceptuelle plus facile, variations mieux pilotées par prompt | La composition peut dériver quand votre image mentale est très précise |

| Image to video | Vous avez déjà une image fixe, un frame de personnage, un rendu produit, un frame de storyboard ou un hero shot | Meilleure cohérence du sujet, direction artistique plus serrée, animation plus simple de visuels déjà validés | Moins de liberté pour de grands changements de scène si le frame source n’est pas solide |

C’est précisément là que beaucoup de gens se bloquent lorsqu’ils courent après une nouvelle sortie de modèle. Ils commencent à penser que le nouveau modèle est le workflow lui-même. Ce n’est pas le cas. Le workflow commence toujours par l’asset créatif que vous possédez déjà.

Utilisez text to video quand :

- vous explorez rapidement plusieurs idées de scène

- vous avez besoin de variantes de cadrage à partir d’un même concept écrit

- vous êtes encore en train de trouver la direction visuelle

- vous voulez itérer sur l’ambiance, l’action ou les beats narratifs avant de verrouiller un frame

Utilisez image to video quand :

- vous avez déjà une image fixe forte

- vous avez besoin que le personnage, le produit ou la composition restent proches d’une référence

- vous animez un key art, un visuel publicitaire, un portrait ou une case de storyboard

- la cohérence visuelle compte davantage que l’exploration ouverte

HappyHorse finira peut-être par supporter les deux voies dans un même écosystème. Pour la plupart des créateurs, cela ne change pas l’arbre de décision, seulement le modèle qui l’exécute.

Là où HappyHorse paraît le plus fort sur le papier

Si son positionnement public est globalement exact, HappyHorse serait surtout convaincant dans quelques scénarios précis.

1. La vidéo courte centrée sur le dialogue

La génération conjointe vidéo et audio, plus le lip-sync multilingue, est la combinaison la plus marquante du package. Si ces fonctionnalités fonctionnent réellement au niveau suggéré par le site, HappyHorse serait beaucoup plus intéressant qu’un simple générateur de clips muets avec de beaux graphiques de benchmark.

Cela compterait pour :

- les contenus d’avatars parlants

- les explainers courts

- les vidéos de créateurs multilingues

- les intros produit avec parole à l’écran

- les contenus sociaux centrés sur le dialogue

2. L’expérimentation ouverte ou auto-hébergée

Beaucoup d’équipes ne veulent pas seulement un bon résultat. Elles veulent une infrastructure qu’elles peuvent inspecter, ajuster, benchmarker et éventuellement déployer sur leurs propres GPU. C’est la raison pour laquelle l’angle open source est si important.

Si HappyHorse livre réellement des poids exploitables, du code d’inférence et des options de distillation, il deviendra pertinent non seulement pour les créateurs, mais aussi pour :

- les équipes d’IA appliquée

- les groupes de recherche

- les studios avec contraintes de confidentialité

- les entreprises qui testent des pipelines médias internes

3. Un meilleur contrôle de style en image-to-video

Le projet affirme supporter l’entrée texte et image. En pratique, les modèles qui savent faire de la génération pilotée par image deviennent souvent bien plus utiles pour le travail commercial que les systèmes uniquement textuels, parce qu’un workflow image-first est plus facile à contrôler.

C’est pourquoi, avant même que HappyHorse ne soit complètement vérifiable, il est utile de tester votre propre process avec un workflow image to video. Si votre logique de production dépend d’images fixes validées, de styleframes, de visuels produit ou de références de personnage, l’animation guidée par image est le workflow le plus transférable.

Là où le récit public reste fragile

Cette partie est celle que beaucoup d’articles de lancement évitent. Les faiblesses ne sont pas forcément des faiblesses du modèle. Ce sont des faiblesses de confiance et d’opérabilité.

Décalage entre récit et artefacts publics

Les matériaux publics actuels parlent avec l’assurance d’un produit technique totalement lancé. Le chemin public du dépôt ne soutient pas cette assurance. Si un projet veut se vendre sur sa crédibilité open source, des artefacts accessibles ne sont pas facultatifs.

Manque de confiance dans les benchmarks

Les tableaux de benchmark sont faciles à publier. Les détails d’évaluation reproductibles le sont beaucoup moins. Tant qu’il n’existe pas de rapport clairement inspectable, d’accès stable au code ou de voie de reproduction tierce, ces chiffres doivent être lus comme des indications de direction, pas comme des faits établis.

Niveau de préparation production encore ambigu

Un modèle peut être réel, impressionnant et malgré tout pas prêt pour un usage de production fiable. Les équipes avec deadlines regardent des points comme :

- la stabilité d’accès

- la documentation des modes d’échec

- la prévisibilité du débit

- la reproductibilité des environnements

- une cadence de mise à jour visible

HappyHorse n’expose pas encore assez de surface opérationnelle publique pour obtenir une bonne note sur ces critères.

Ce que les créateurs devraient faire maintenant

Si HappyHorse vous intrigue, le meilleur réflexe n’est pas de débattre pour savoir s’il est surestimé ou sous-estimé. Le meilleur réflexe est de dérisquer votre workflow dès maintenant.

Appuyez-vous sur ce tableau :

| Votre situation | Meilleure décision maintenant |

|---|---|

| Vous avez surtout besoin d’exploration conceptuelle à partir de prompts | Construisez autour d’un workflow text to video fiable et gardez HappyHorse en watchlist |

| Vous avez déjà des concept frames, des visuels produit ou des portraits | Construisez autour de image to video et ne testez de nouveaux modèles que s’ils apportent une meilleure cohérence |

| L’infrastructure ouverte compte plus pour vous que la publication à court terme | Suivez HappyHorse de près et attendez des poids, du code et une documentation reproductible accessibles |

| Vous avez besoin d’assets publiables cette semaine | Ne centrez pas votre calendrier de contenu sur un modèle dont la vérification publique reste incomplète |

C’est cette grille pratique qui manque à beaucoup de couvertures de lancement. Vous n’avez pas besoin de décider si HappyHorse est l’avenir. Vous devez seulement décider ce qui vous aide à publier aujourd’hui sans fermer la porte à de meilleurs outils demain.

Où suivre la couverture publique de HappyHorse

Si vous souhaitez suivre la manière dont le projet apparaît dans les annuaires publics et les pages de lancement, HappyHorse AI et le modèle vidéo HappyHorse sont deux points de repère utiles. Considérez-les comme des points de découverte, pas comme des substituts à un code inspectable, à des poids stables et à des artefacts de déploiement reproductibles.

Comment mieux évaluer HappyHorse quand davantage d’artefacts publics seront disponibles

Quand HappyHorse exposera plus d’infrastructure publique, voici les tests les plus importants :

- Un utilisateur non connecté peut-il atteindre le vrai dépôt, la documentation et la page du modèle sans impasse ?

- Les poids, scripts d’inférence et instructions de déploiement sont-ils cohérents sur toutes les surfaces publiques ?

- La voie text-to-video obéit-elle réellement à des prompts cinématographiques avec un niveau de cohérence utile ?

- La voie image-to-video préserve-t-elle le sujet et la composition lorsqu’on ajoute du mouvement ?

- L’audio synchronisé est-il réellement exploitable ou exige-t-il encore beaucoup de nettoyage ?

- Les claims de lip-sync multilingue sont-ils visibles dans des démos publiques au-delà de quelques extraits soigneusement sélectionnés ?

- Un créateur ou un ingénieur peut-il reproduire les performances publiées sur le matériel communiqué ?

Tant que ces questions restent ouvertes, la bonne posture est l’intérêt informé, pas l’adoption aveugle.

FAQ

HappyHorse est-il open source dès maintenant ?

HappyHorse est publiquement présenté comme open source avec autorisation d’usage commercial, mais le chemin actuel vers le dépôt n’est pas accessible lors d’un contrôle direct. Le claim open source est visible. La chaîne publique d’artefacts reste incomplète.

HappyHorse est-il text-to-video ou image-to-video ?

Le site public actuel le présente comme les deux. C’est d’ailleurs une partie de la raison de l’attention qu’il reçoit. La question la plus utile est de savoir quel workflow correspond à vos inputs d’aujourd’hui : text to video pour l’idéation pilotée par prompt, ou image to video pour l’animation pilotée par référence.

HappyHorse est-il prêt pour la production ?

Il pourrait devenir pertinent pour la production, mais le niveau actuel de vérification publique n’est pas assez solide pour le recommander comme centre d’une pipeline sensible aux deadlines.

Pourquoi autant de gens s’intéressent-ils à HappyHorse ?

Parce qu’il combine un positionnement de modèle ouvert avec audio synchronisé, lip-sync multilingue et double entrée texte/image. C’est une histoire de workflow bien plus attractive qu’un autre modèle vidéo muet avec une simple capture de benchmark.

Que devrais-je utiliser en attendant que HappyHorse mûrisse ?

Adoptez une approche centrée sur le workflow. Commencez avec text to video lorsque la scène reste pilotée par prompt, et utilisez image to video lorsque vous avez déjà l’image à animer.

Verdict final

HappyHorse mérite de l’attention, mais pas une confiance aveugle. Le récit public du projet est suffisamment fort pour justifier un suivi sérieux, et suffisamment fragile pour exiger une vérification rigoureuse.

Si le modèle finit par livrer ses promesses publiques avec des artefacts stables, il pourrait devenir l’un des projets vidéo open les plus intéressants du marché. En attendant, les créateurs ont tout intérêt à ne pas transformer l’enthousiasme d’une launch page en dépendance de production. Appuyez-vous sur des workflows qui vous aident déjà à publier aujourd’hui, gardez des standards d’évaluation élevés et considérez HappyHorse comme un projet prometteur qui doit encore combler son déficit de preuve.