Si está buscando una guía completa sobre HappyHorse, el problema real no es entender el discurso de marketing. El problema real es separar lo que hoy se ve públicamente de lo que puede verificarse de manera independiente, y después decidir si HappyHorse es algo para vigilar, algo para probar o algo en lo que realmente puede apoyarse ahora mismo.

A fecha del 8 de abril de 2026, los materiales públicos de HappyHorse cuentan una historia muy ambiciosa. Presentan HappyHorse 1.0 como un modelo de vídeo multimodal open source con audio sincronizado, lip-sync en siete idiomas, salida en 1080p, permiso de uso comercial, soporte de self-hosting y buenos resultados en benchmarks. Es una propuesta potente. También crea un problema inmediato de verificación, porque la ruta pública hacia el código no puede comprobarse directamente y la ruta de hosting del modelo mostrada en los ejemplos de despliegue tampoco es accesible abiertamente sin iniciar sesión.

Eso no significa automáticamente que HappyHorse sea falso. Sí significa que conviene leer cada afirmación con el marco correcto: proyecto interesante, verificación pública incompleta y preparación para producción todavía poco clara. Esta guía explica qué parece real, qué sigue necesitando pruebas, dónde puede resultar más relevante HappyHorse y por qué, si necesita resultados ya, un flujo de text to video o un flujo de image to video suele ser una decisión más práctica que esperar.

Respuesta corta

HappyHorse parece un concepto prometedor de modelo de vídeo con una propuesta pública fuerte alrededor de pesos abiertos, generación de audio, lip-sync y self-hosting. Aun así, la evidencia pública disponible hoy no es lo bastante sólida como para tratar cada gran titular como infraestructura plenamente confirmada y lista para adoptarse sin riesgo.

Este es el resumen práctico:

| Pregunta | Respuesta práctica |

|---|---|

| ¿HappyHorse es interesante? | Sí. El conjunto de funciones públicas es inusualmente ambicioso para un modelo de vídeo presentado como abierto y autoalojable. |

| ¿Está totalmente verificado como modelo abierto público hoy? | Todavía no. La ruta del repositorio público no está disponible y la ruta del modelo mostrada en el sitio no es accesible en una comprobación sin sesión. |

| ¿Conviene ignorarlo? | No. Merece seguimiento si le interesa la generación de vídeo multimodal abierta. |

| ¿Conviene construir hoy su pipeline de contenido alrededor de él? | Solo si acepta el riesgo de verificación y puede tolerar artefactos públicos incompletos. |

| ¿Qué deberían hacer ahora los creadores? | Usar un flujo de text to video ya probado para ideación basada en prompts o un flujo de image to video para animación guiada por referencias mientras HappyHorse madura. |

La idea central es esta: ahora mismo HappyHorse resulta más creíble como proyecto de alto potencial al que seguir que como base inmediata para una producción seria.

Qué afirma públicamente HappyHorse ahora mismo

Los materiales visibles de HappyHorse cuentan una historia de producto bastante concreta, no una simple página teaser. Entre las afirmaciones visibles aparecen:

- un modelo de 15B parámetros

- una arquitectura Transformer de 40 capas

- generación conjunta de vídeo y audio

- soporte para prompts de texto e imagen

- lip-sync en siete idiomas

- salida a 1080p

- clips de 5 a 8 segundos

- self-hosting en GPU de clase H100 o A100

- lanzamiento open source con permiso de uso comercial

- un precio inicial de

$11.90

No son frases genéricas de landing page. Suenan más bien a una página de lanzamiento técnico pensada para que creadores e investigadores la tomen en serio.

El sitio también muestra afirmaciones de rendimiento relativamente concretas, entre ellas:

- unos 38 segundos para generar un clip de 5 segundos a 1080p en H100

- lip-sync para inglés, mandarín, cantonés, japonés, coreano, alemán y francés

- ventajas en benchmark frente a OVI 1.1 y LTX 2.3

- una supuesta posición destacada en un leaderboard público de modelos de vídeo

Sobre el papel, ese paquete colocaría a HappyHorse en una posición muy atractiva. Un modelo que combine text-to-video, image-to-video, audio sincronizado, lip-sync multilingüe y una postura abierta apta para uso comercial destacaría de inmediato. El problema no es la calidad del relato. El problema es la distancia entre ese relato y los artefactos públicos realmente accesibles hoy.

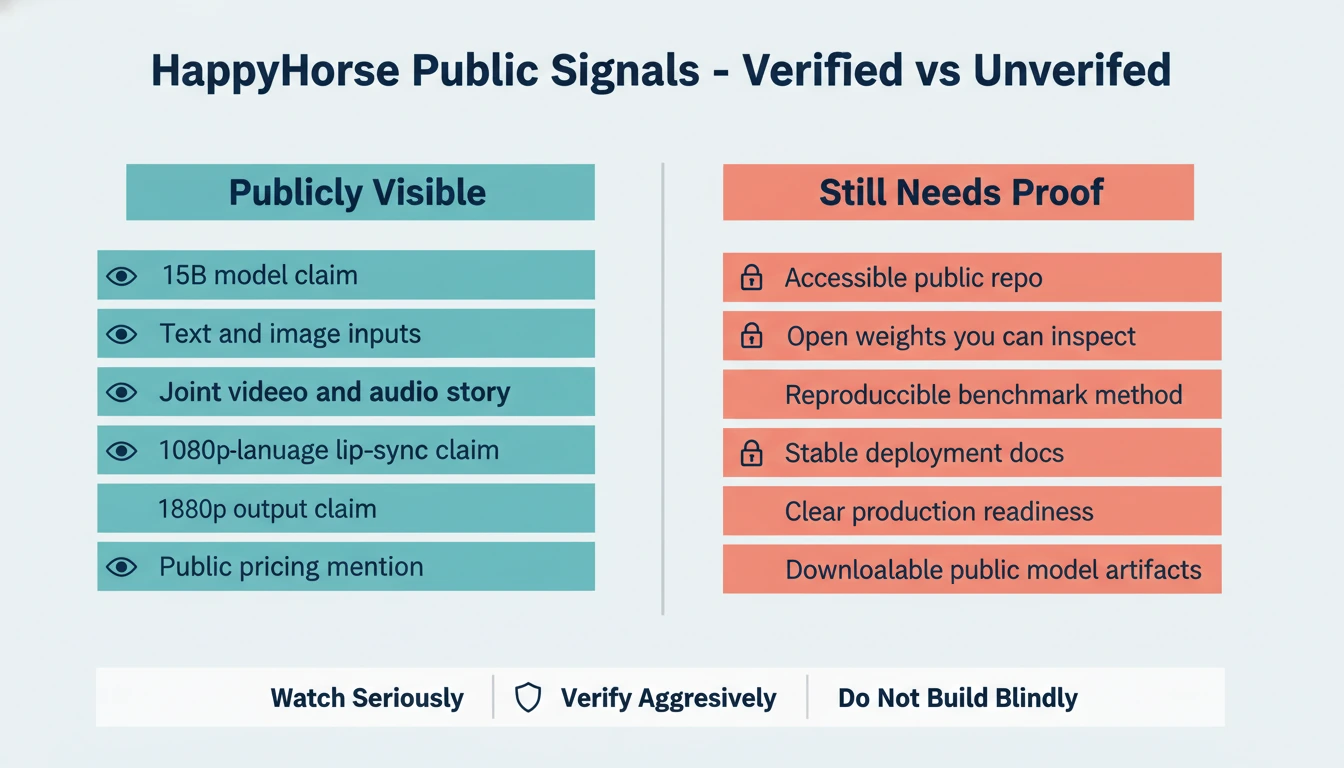

Qué está realmente verificado y qué sigue necesitando pruebas

La forma más útil de leer HappyHorse hoy es dividir la información pública en dos grupos: lo que puede observarse directamente y lo que sigue necesitando confirmación independiente.

| Estado | Qué entra aquí | Por qué pertenece aquí |

|---|---|---|

| Visible públicamente | Afirmaciones de funciones en el sitio, mención de precios, ejemplos de despliegue, tablas de benchmark, vídeos de muestra | Todo esto está visible en el sitio actual y puede inspeccionarse como afirmación publicada. |

| Todavía no confirmado de forma independiente | Disponibilidad open source, pesos públicos, código self-hostable, metodología reproducible de benchmark, preparación para producción | La ruta del repositorio enlazado no está disponible y la ruta del modelo referenciada no es accesible públicamente sin autenticación. |

Esta distinción importa porque muchos creadores mezclan dos preguntas distintas.

La primera pregunta es:

- ¿El proyecto presenta una historia coherente y técnicamente plausible?

La segunda pregunta es:

- ¿Puedo validarlo, descargarlo, reproducirlo y operarlo yo mismo hoy?

En este momento, HappyHorse puntúa mejor en la primera que en la segunda.

Eso no invalida el proyecto. Solo cambia cuál es la acción correcta. Si usted investiga o sigue de cerca nuevas infraestructuras, merece la pena observarlo. Si crea contenido con plazos reales, lo sensato es seguir publicando con herramientas que ya le dejan generar de forma fiable.

Por qué HappyHorse está llamando la atención

HappyHorse está llamando la atención porque junta varias cosas que los creadores quieren al mismo tiempo:

- una postura abierta o al menos cercana a lo abierto

- generación multimodal en lugar de vídeo mudo

- soporte de lip-sync en varios idiomas

- discurso de self-hosting en vez de dependencia total del SaaS

- framing de benchmark que sugiere competir con otros esfuerzos abiertos de vídeo

Esa mezcla encaja de lleno con la tensión actual del mercado. Muchos creadores quieren las mejoras de calidad de los sistemas de vídeo más nuevos, pero no quieren quedar atrapados en herramientas cerradas, despliegues regionales inestables o modelos de precio limitados a una sola superficie. HappyHorse habla directamente a ese deseo.

También se está difundiendo por una segunda razón: describe un flujo de trabajo que suena operativamente completo. Muchas páginas de modelos de vídeo todavía obligan a montar la pila por partes. Genera vídeo en un sitio. Añade voz en otro. Corrige el lip-sync en otro lugar. Escala después. Ajusta tiempos a mano. HappyHorse promete una vía más integrada.

Por eso el proyecto parece importante incluso antes de que la verificación pública lo alcance del todo. Está apuntando al flujo de trabajo que los creadores realmente quieren.

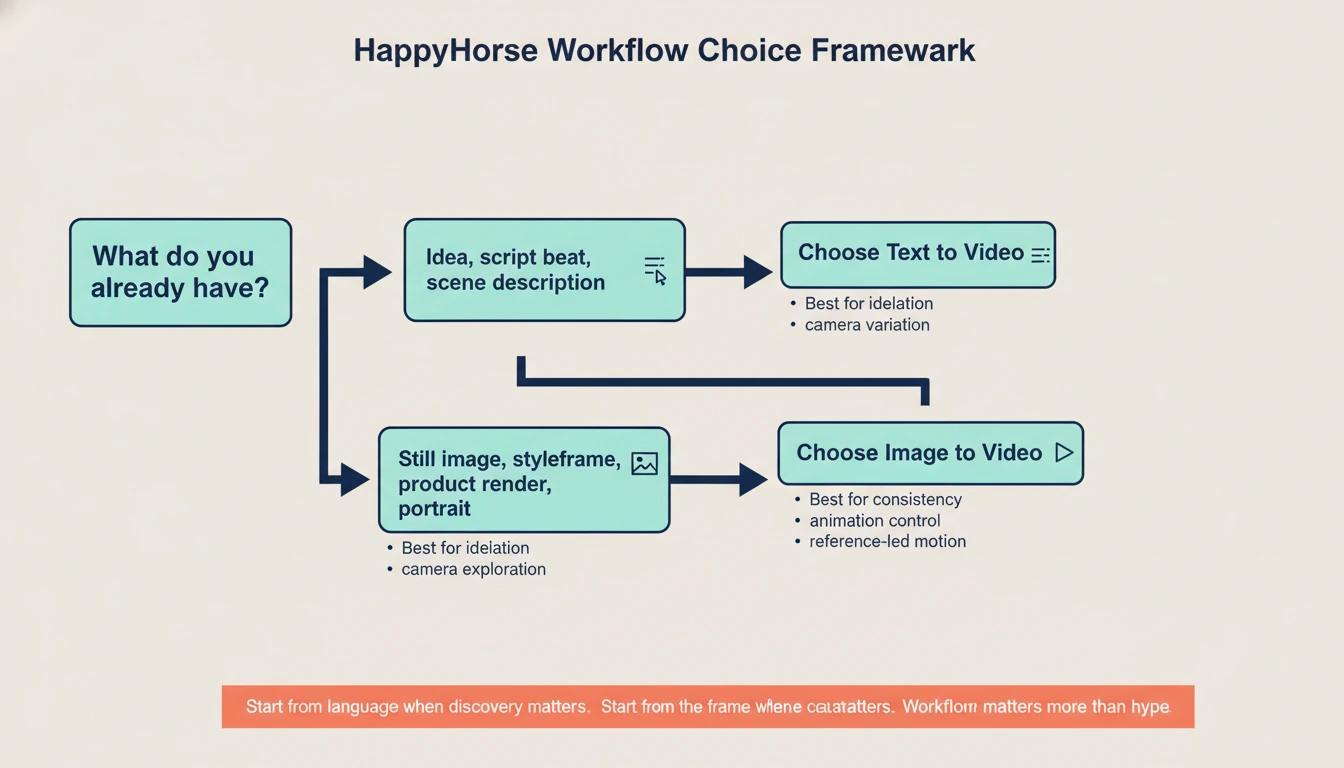

La pregunta de flujo real: ¿Text to Video o Image to Video?

Aunque HappyHorse terminara cumpliendo todas sus promesas públicas, la mayoría de los creadores seguirían necesitando tomar la misma decisión central que ya afrontan hoy: ¿empiezan desde el lenguaje o desde un fotograma?

Esa elección importa más que el nombre del modelo.

| Flujo | Mejor punto de partida | Qué aporta | Debilidad principal |

|---|---|---|---|

| Text to video | Tiene una idea, una escena, un beat de guion o una dirección de cámara, pero todavía no un fotograma fijo definitivo | Ideación más rápida, exploración de conceptos, más variaciones guiadas por prompt | La composición puede desviarse cuando la imagen mental es muy concreta |

| Image to video | Ya tiene una imagen fija, un personaje, un render de producto, un frame de storyboard o una hero shot | Mejor consistencia del sujeto, dirección artística más firme, animación más controlada sobre visuales aprobados | Menos libertad para grandes cambios de escena si el frame inicial no es fuerte |

Aquí es exactamente donde mucha gente se atasca al perseguir un nuevo lanzamiento. Empiezan a pensar que el modelo nuevo es, por sí mismo, el flujo de trabajo. No lo es. El flujo sigue empezando por el activo creativo que usted ya tiene.

Use text to video cuando:

- esté explorando varias ideas de escena con rapidez

- necesite alternativas de cámara a partir de un solo concepto escrito

- todavía esté definiendo la dirección visual

- quiera iterar sobre atmósfera, acción o ritmo narrativo antes de fijar un frame

Use image to video cuando:

- ya disponga de una imagen fija potente

- necesite que personaje, producto o composición se mantengan cerca de una referencia

- esté animando una pieza visual aprobada, un anuncio, un retrato o un panel de storyboard

- la consistencia visual importe más que la exploración abierta

Puede que HappyHorse acabe soportando ambas rutas dentro del mismo ecosistema. Para la mayoría de los creadores, eso no cambia el árbol de decisión. Solo cambia qué modelo lo ejecuta.

Dónde pinta mejor HappyHorse sobre el papel

Si la posición pública va en la dirección correcta, HappyHorse sería especialmente interesante en algunos escenarios concretos.

1. Vídeo corto guiado por diálogo

La combinación de vídeo y audio generados conjuntamente, sumada al lip-sync multilingüe, es el aspecto más llamativo de todo el paquete. Si esas funciones rinden al nivel que sugiere el sitio, HappyHorse sería mucho más interesante que otro generador de clips mudos con gráficos de benchmark elegantes.

Eso importaría para:

- contenidos con avatar parlante

- explainers cortos

- vídeos de creadores en varios idiomas

- intros de producto con voz en pantalla

- piezas sociales centradas en diálogo

2. Experimentación abierta o autoalojada

Muchos equipos no quieren solo buen output. Quieren infraestructura que puedan inspeccionar, ajustar, medir y quizá desplegar en sus propias GPU. Por eso el ángulo open source pesa tanto.

Si HappyHorse acaba entregando pesos utilizables, código de inferencia y opciones de distilación, se volvería relevante no solo para creadores, sino también para:

- equipos de IA aplicada

- grupos de investigación

- estudios con restricciones de privacidad

- empresas que prueban pipelines internos de medios

3. Mayor control estilístico en image-to-video

El proyecto afirma soportar entradas de texto e imagen. En la práctica, los modelos que permiten generación guiada por imagen suelen ser mucho más útiles para trabajo comercial que los sistemas solo de texto, porque los flujos image-first son más fáciles de controlar.

Por eso, incluso antes de que HappyHorse sea plenamente verificable, tiene sentido poner a prueba su propio proceso con un flujo de image to video. Si su lógica de producción depende de arrancar desde stills aprobados, styleframes, renders de producto o referencias de personaje, la animación guiada por imagen es el flujo más transferible.

Dónde sigue siendo frágil la historia pública actual

Esta es la parte que muchos artículos de lanzamiento prefieren saltarse. Las debilidades no son necesariamente del modelo. Son debilidades de confianza y de operabilidad.

Desajuste entre discurso y artefactos públicos

Los materiales públicos actuales hablan con la seguridad de un producto técnico ya lanzado por completo. La ruta pública del repositorio no respalda esa seguridad. Si un proyecto quiere liderar con credibilidad open source, los artefactos accesibles no son opcionales.

Brecha de confianza en benchmarks

Las tablas de benchmark son fáciles de publicar. Los detalles reproducibles de evaluación son mucho más difíciles. Hasta que no exista un informe claramente inspeccionable, acceso estable al código o una vía de reproducción de terceros, esas cifras deben tratarse como afirmaciones orientativas, no como hechos cerrados.

Preparación ambigua para producción

Un modelo puede ser real, impresionante y aun así no estar listo para un uso fiable en producción. Los equipos con deadlines se fijan en cosas como:

- acceso estable

- modos de fallo documentados

- previsibilidad de ritmo

- entornos reproducibles

- cadencia visible de actualizaciones

HappyHorse todavía no expone suficiente superficie operativa pública como para puntuar alto en esos criterios.

Qué deberían hacer ahora los creadores

Si siente curiosidad por HappyHorse, el mejor movimiento no es discutir si está sobrevalorado o infravalorado. El mejor movimiento es reducir riesgo en su flujo desde ya.

Use esta tabla como guía:

| Su situación | Mejor movimiento ahora |

|---|---|

| Necesita sobre todo explorar conceptos desde prompts | Construya alrededor de un flujo de text to video fiable y mantenga HappyHorse en vigilancia |

| Ya tiene frames conceptuales, stills de producto o retratos | Construya alrededor de image to video y pruebe modelos nuevos solo cuando ofrezcan mejor consistencia |

| Le importa más la infraestructura abierta que publicar a corto plazo | Siga de cerca HappyHorse y espere pesos, código y documentación reproducible accesibles |

| Necesita activos publicables esta misma semana | No centre su calendario en un modelo con verificación pública aún incompleta |

Esa es la lente práctica que falta en mucha cobertura de lanzamientos. No tiene que decidir si HappyHorse es el futuro. Solo tiene que decidir qué le ayuda a publicar hoy sin cerrarse a mejores herramientas mañana.

Dónde seguir la cobertura pública de HappyHorse

Si quiere seguir cómo se presenta el proyecto en directorios públicos y páginas de tipo lanzamiento, HappyHorse AI y el modelo de vídeo HappyHorse son dos referencias útiles. Tómelos como puntos de descubrimiento, no como sustitutos de código inspeccionable, pesos estables y artefactos de despliegue reproducibles.

Cómo evaluar mejor HappyHorse cuando lleguen más artefactos públicos

Cuando HappyHorse exponga más infraestructura pública, estas serán las pruebas que realmente importen:

- ¿Puede un usuario sin iniciar sesión llegar al repositorio real, a la documentación y a la página del modelo sin callejones sin salida?

- ¿Son coherentes los pesos, los scripts de inferencia y las instrucciones de despliegue en todas las superficies públicas?

- ¿La ruta text-to-video obedece realmente prompts cinematográficos con un nivel útil de consistencia?

- ¿La ruta image-to-video conserva sujeto y composición cuando introduce movimiento?

- ¿El audio sincronizado es verdaderamente utilizable o sigue requiriendo demasiada limpieza?

- ¿Las afirmaciones de lip-sync multilingüe se ven en demos públicas más allá de unos pocos fragmentos curados?

- ¿Puede un creador o un ingeniero reproducir el rendimiento publicado sobre el hardware divulgado?

Hasta que esas preguntas tengan respuesta, la postura correcta es interés informado, no adopción ciega.

FAQ

¿HappyHorse es open source ahora mismo?

HappyHorse se presenta públicamente como open source con permiso de uso comercial, pero la ruta pública del repositorio no es accesible en una comprobación directa. La afirmación open source está visible. La cadena pública de artefactos todavía no está completa.

¿HappyHorse es text-to-video o image-to-video?

El sitio público actual lo presenta como ambas cosas. Esa es parte de la razón por la que atrae atención. La pregunta más útil es qué flujo encaja con sus inputs de hoy: text to video para ideación guiada por prompts o image to video para animación guiada por referencias.

¿Está listo HappyHorse para uso en producción?

Puede llegar a ser relevante para producción, pero el nivel actual de verificación pública no es lo bastante sólido como para recomendarlo como centro de un pipeline sensible a plazos.

¿Cuál es la mayor razón por la que la gente se fija en HappyHorse?

Combina una postura de modelo abierto con audio sincronizado, lip-sync multilingüe y entrada tanto por texto como por imagen. Es una historia de flujo mucho más atractiva que otro modelo de vídeo mudo con una sola captura de benchmark.

¿Qué debería usar mientras HappyHorse madura?

Use un enfoque orientado a flujo. Empiece con text to video cuando la escena todavía dependa del prompt, y use image to video cuando ya tenga el frame que quiere animar.

Veredicto final

HappyHorse merece atención, pero no confianza ciega. La historia pública del proyecto es lo bastante fuerte como para seguirla en serio y lo bastante débil como para exigir verificación agresiva.

Si el modelo termina cumpliendo sus afirmaciones públicas con artefactos estables, podría convertirse en uno de los proyectos abiertos de vídeo más interesantes del mercado. Hasta entonces, los creadores deberían evitar convertir la emoción de una launch page en dependencia de producción. Construya sobre flujos que ya le ayuden a publicar hoy, mantenga altos sus estándares de evaluación y trate HappyHorse como un proyecto prometedor que todavía necesita cerrar su brecha de prueba.