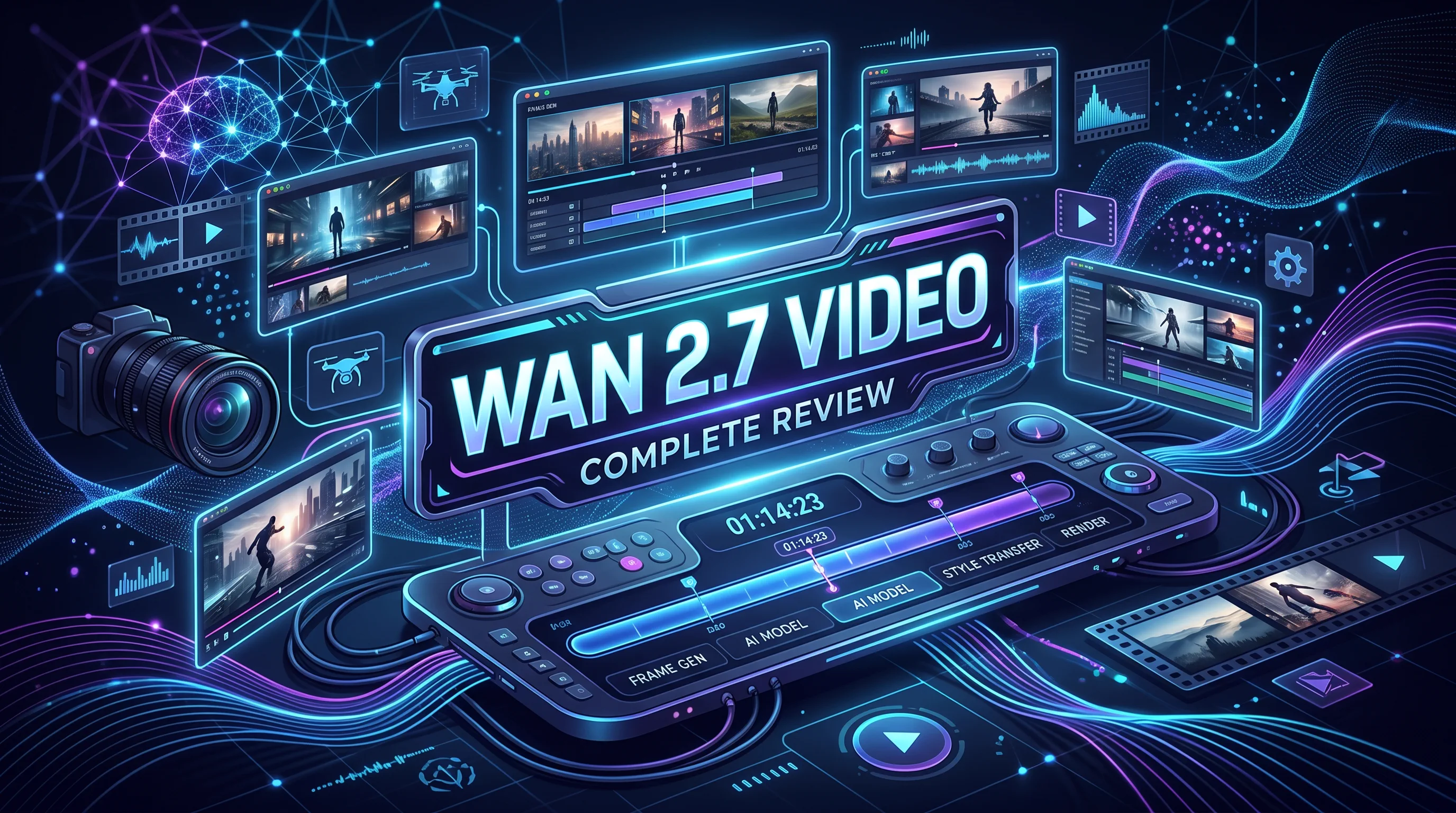

In diesem Quartal landet fast jedes Gespräch unter Kreativen irgendwann bei einem Modell: Wan 2.7. Entwickelt von Alibabas Tongyi Lab, ist diese neueste Version zum meistangefragten Test im Bereich der KI-Videogenerierung geworden, nicht wegen Marketing-Hype, sondern weil sie die hartnäckigsten Probleme adressiert, mit denen Kreative konfrontiert sind: konsistente Charaktere, präzise Szenensteuerung und Ausgabequalität auf Produktionsniveau über mehrere Shots hinweg. Nach umfangreichen Tests in realen Workflows zerlegt dieser umfassende Test, was Wan 2.7 Video tatsächlich liefert, wo es seine Stärken hat und wie es sich 2026 gegen konkurrierende Modelle schlägt.

Was ist Wan 2.7 und warum ist es wichtig?

Wan 2.7 ist ein hochmodernes KI-Videogenerierungsmodell, das auf einer 27-Milliarden-Parameter-Mixture-of-Experts-(MoE)-Architektur basiert. Anders als seine Vorgänger markiert Wan 2.7 einen grundlegenden Wandel von reiner Text-zu-Video-Generierung hin zu einem umfassenden Gesamtpaket für die Videoproduktion mit strukturierten Steuerungsmechanismen. Das Modell erzeugt filmische 1080P-HD-Videos aus Textbeschreibungen, Bildern und sogar Audioeingaben und verbindet visuelle Qualität, Audio-Synchronisation und Bewegungsstabilität in einem einheitlichen System.

Was Wan 2.7 von früheren Versionen und konkurrierenden Modellen abhebt, ist nicht nur die Parameterzahl oder die Auflösung. Der eigentliche Durchbruch liegt in den multimodalen Eingabefunktionen und dem produktionsorientierten Funktionsumfang. Während Wan 2.6 Kreative noch dazu zwang, einen Text-Prompt einzugeben und darauf zu hoffen, dass die KI die Absicht versteht, was oft in visueller Verzerrung und unvorhersehbaren Ergebnissen endete, erlaubt Wan 2.7 das direkte Einfügen von Bildern, Videos und Audio, um Bewegung und Licht mit 1:1-Genauigkeit zu dekodieren. Dadurch wird die exakte Absicht der Kreativen mit beispielloser Präzision in hyperrealistische, filmische Bilder übersetzt.

Auch die wirtschaftliche Tragfähigkeit des Modells ist bemerkenswert. Wan 2.7 arbeitet mit einem creditsbasierten Preismodell ohne monatliche Abogebühren, ohne Plattform-Lock-in und ohne verfallende Credits. Für Agenturen, die jede Woche 50 Anzeigenvarianten produzieren, bedeutet das: rohe Generierung für weniger als 50 Dollar in Credits zu automatisieren und gleichzeitig menschliche Zeit auf Strategie und Final Review zu verlagern. Das ist ein spürbarer Wandel in der Produktionsökonomie.

Kernfunktionen, die KI-Videogenerierung neu definieren

Anfangs- und Endbild-Steuerung: Präzises Storytelling

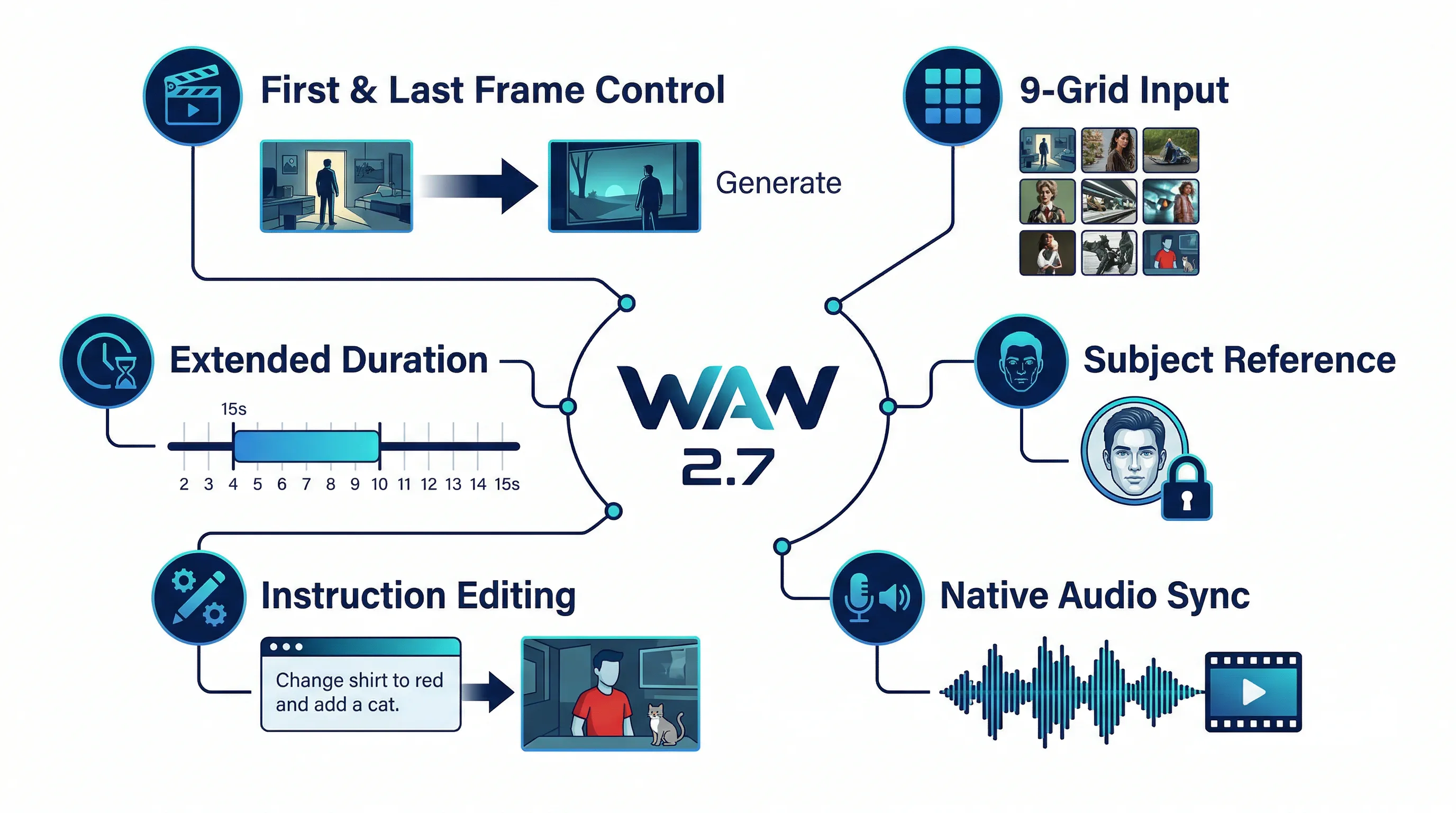

Die meistdiskutierte Funktion in Wan 2.7 ist die Generierung über Anfangs- und Endbild, eine Fähigkeit, die grundlegend verändert, wie Kreative an KI-Videoproduktion herangehen. Statt einen Clip zu generieren und zu hoffen, dass er am richtigen Punkt landet, liefern Sie zwei Referenzbilder: wie das Video am Anfang aussehen soll und wie es am Ende aussehen soll. Das Modell erzeugt dann die Bewegung und den Übergang zwischen diesen beiden Ankern und gibt Ihnen eine vorhersehbare, steuerbare erzählerische Entwicklung.

Das löst eines der hartnäckigsten Probleme bei KI-Videos: unvorhersehbare Szenenentwicklung. In Wan 2.1 existierte diese Fähigkeit als separater Modell-Checkpoint (Wan2.1-FLF2V-14B), was den Wechsel zwischen verschiedenen Versionen erforderte. In Wan 2.7 ist die First-and-Last-Frame-Steuerung direkt in das Hauptmodell integriert, was Reibung im Workflow beseitigt und eine nahtlose Multi-Shot-Produktion ermöglicht. Wenn Ihr Workflow eher mit freigegebenen Standbildern als mit reinen Prompts startet, macht das Wan 2.7 auch zu einer natürlicheren Wahl für Image-to-Video-Pipelines.

Die praktischen Anwendungen liegen auf der Hand. Filmemacher, die ein Storyboard für eine Sequenz erstellen, können die exakte Komposition an Anfangs- und Endpunkten der Szene definieren. Marketing-Teams, die Produktdemos bauen, kontrollieren die genaue Positionierung des Produkts an Schlüsselmomenten. Lehrende, die Tutorial-Inhalte produzieren, sichern die visuelle Kontinuität zwischen den Lernabschnitten. Diese Form der Kontrolle hebt KI-Videogenerierung von einem experimentellen Werkzeug zu einem produktionsreifen Asset an.

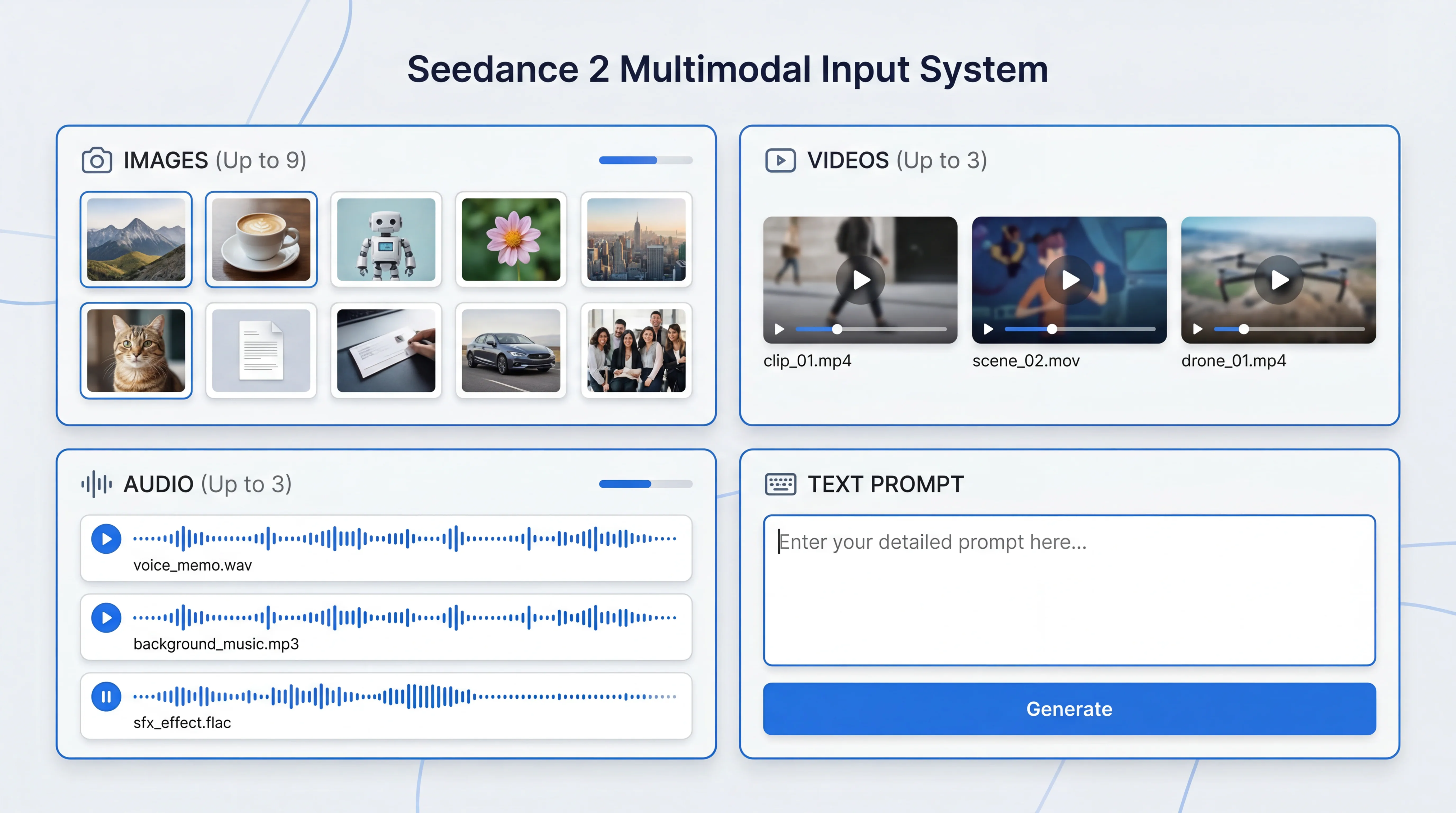

9-Grid-Bild-zu-Video: Strukturiertes visuelles Storytelling

Wan 2.7 führt ein revolutionäres 9-Grid-(3x3)-Bildeingabesystem für die Videogenerierung ein. Statt ein einziges Referenzbild zu verwenden, liefern Kreative ein Raster aus neun Bildern, das Szenenkomposition, Charakterwinkel, Lichtbedingungen und visuellen Kontext über verschiedene Momente oder Perspektiven hinweg definiert. Das Modell synthetisiert diese Eingaben anschließend zu einer kohärenten animierten Sequenz, die die strukturelle Konsistenz durchgängig bewahrt.

Diese Funktion schlägt die Brücke zwischen statischer Storyboard-Planung und animierter Ausgabe auf eine Weise, die kein früheres Wan-Modell erreicht hat. Im Vergleich zu traditionellen autoregressiven KI-Videomethoden liefert der 9-Grid-Ansatz bessere Konsistenz, schnellere Inferenz und stärkere strukturelle Kohärenz. Für Produktionsteams, die mit detaillierten Storyboards arbeiten, werden Planungsassets damit direkt in Bewegung übersetzt, ohne den üblichen Trial-and-Error-Zyklus.

Das 9-Grid-System glänzt besonders in Szenarien mit komplexen Kamerabewegungen oder Charakterinteraktionen. Durch mehrere Referenzwinkel können Kreative das Verständnis des Modells für räumliche Beziehungen, Tiefe und Bewegungsverläufe lenken, was in Ergebnissen endet, die bewusst choreografiert wirken statt zufällig erzeugt.

Motiv- und Stimmenreferenz: Identitätskonsistenz über mehrere Shots

Charakterkonsistenz war in der KI-Videogenerierung notorisch schwer, weil Identitäten zwischen Frames leicht kollabieren oder driften. Wan 2.7 führt das ein, was die Dokumentation „Absolute Identity Lock“ nennt, ein Referenzsystem für Subjekte, das Gesichtszüge (Augenhöhe, Kieferlinie), Kleidungsdetails und Umgebungselemente auch über komplexe Kamerabewegungen hinweg präzise fixiert.

Sie liefern ein Referenzbild einer Person, eines Objekts oder eines Charakters, und das Modell erhält diese visuelle Identität über das gesamte generierte Video hinweg. Damit wird die größte Kritik an Wan 2.5 und 2.6 adressiert: Charaktere, die nicht von Frame zu Frame gleich aussahen. Der Fortschritt ist im Test sofort sichtbar, mit deutlich weniger Kleidungswechseln mitten im Clip, Gesichtsverformungen oder Identitätsdrift.

Die Stimmenreferenz erweitert diese Konsistenz auf Audio. Kreative können eine Stimmprobe bereitstellen, und Wan 2.7 behält diese stimmliche Identität über generierte Audiospuren hinweg bei, was für Markeninhalte, charaktergetriebene Narrative oder jedes Projekt wichtig ist, das wiedererkennbare Stimmen erfordert. Damit konkurriert Wan 2.7 direkt mit Tools wie Kling und Hailuo, die Identitätskonsistenz bereits seit einiger Zeit anbieten, jedoch mit einer breiteren Funktionsintegration von Wan 2.7.

Native Audio-Synchronisierung: Klang, der zur Bewegung passt

Anders als die meisten KI-Videomodelle, die stille Clips erzeugen und manuelles Audio-Layering erfordern, enthält Wan 2.7 native Audiogenerierung, die direkt mit dem visuellen Inhalt synchronisiert ist. Hintergrundmusik, Umgebungsgeräusche und Charakterstimmen werden von Anfang an synchron zur Bewegung erzeugt, nicht erst im Nachhinein hinzugefügt. Für alle, die Audio bisher manuell Bild für Bild an KI-Videos angepasst haben, ist das der unmittelbar praktischste Fortschritt im gesamten Funktionsumfang.

Das Modell unterstützt optional Audioeingaben, sodass Kreative Referenzaudio bereitstellen können, das sowohl die visuelle Generierung als auch die synchronisierte Ausgabe beeinflusst. Dieser multimodale Ansatz bedeutet, dass Sie einen Musiktitel einspeisen können und das Tempo, die Schnitte und die Bewegungsdynamik des Videos auf Rhythmus und emotionale Tonalität des Audios reagieren. So entsteht eine Form audiovisueller Kohärenz, die bisher nur durch aufwendige Postproduktion erreichbar war.

Video-Bearbeitung per Anweisung: Textgesteuerte Änderungen

Eine der innovativsten Funktionen von Wan 2.7 ist das instruktionsbasierte Video-Editing, also die Möglichkeit, bestehende Videos mit einfachen Textbefehlen zu verändern, ohne von vorn neu zu generieren. Statt bei Anpassungen komplett neu zu starten, können Sie Befehle wie „replace the background“, „shift the lighting to golden hour“ oder „recolor the outfit to blue“ eingeben und das Modell wendet diese Änderungen an, während alle anderen Elemente erhalten bleiben.

Diese Video-zu-Video-Bearbeitung reduziert die Komplexität der Eingabedaten und die Rechenlast und liefert schneller Ergebnisse als eine vollständige Neugenerierung. Für iterative Kreativ-Workflows ist das transformativ. Sie können Ausgaben über gezielte Anpassungen verfeinern, statt immer wieder auf völlig neue Generationen zu setzen. Besonders wertvoll ist die Funktion für Agenturen, die bestehendes Footage saisonal anpassen, oder Brand-Teams, die Produktvisuals über mehrere Szenen hinweg konsistent halten wollen, ohne neu zu drehen.

Verlängerte Dauer und Aufnahmen fortsetzen: Die Fragmentgrenze sprengen

Eine der größten Einschränkungen früher Videomodelle war die Länge der Narration, typischerweise auf Einzelschnitte von 3 bis 4 Sekunden begrenzt. Wan 2.7 adressiert das mit der Funktion „Aufnahmen fortsetzen“, einem intelligenten Erweiterungssystem, das eine unbegrenzte Fortsetzung vorhandener Videomaterialien ermöglicht. Das Modell unterstützt Längen von 2 bis 15 Sekunden pro Generierung und ist damit unter den großen Wettbewerbern die einzige Option für Clips von mehr als 10 Sekunden.

Diese längere Dauer, kombiniert mit der First-and-Last-Frame-Steuerung, ermöglicht echte Multi-Shot-Erzählstrukturen. Kreative können Sequenzen mit vorhersehbaren Übergängen aneinanderreihen und längere Formate aufbauen, die visuelle und stilistische Konsistenz durchgängig bewahren, eine zentrale Voraussetzung für professionelle Content-Workflows.

Technische Spezifikationen und Ausgabequalität

Wan 2.7 generiert Videos nativ in 1080P-HD, wobei 720P für schnellere Verarbeitung ebenfalls verfügbar ist. Das Modell gibt mit 24 fps aus und entspricht damit dem Kino-Standard für professionelle Bewegungsqualität. Die Generierungszeiten variieren je nach Dauer und Auflösung, doch die Architektur des Modells priorisiert Qualität vor Geschwindigkeit, ein bewusster Trade-off, der es als Produktionstool statt als Rapid-Prototyping-System positioniert.

Die visuelle Qualität des Modells stellt gegenüber Wan 2.6 in mehreren Dimensionen einen deutlichen Fortschritt dar. Die Stilkonsistenz ist spürbar stärker. Das Modell hält filmischen Realismus, Anime-Ästhetik und illustrativen Stil über Frames hinweg zuverlässiger durch, was für Inhalte wichtig ist, die durchgängig eine erkennbare visuelle Identität brauchen. Die zeitliche Konsistenz hat sich drastisch verbessert, mit weniger flackernden Gesichtern, weniger Kleidungswechseln mitten im Clip und weniger Fällen, in denen Subjekte zwischen den Schnitten leicht morphen.

Auch die Bewegungsdynamik ist verfeinert. Die Flügelbewegung in einem Adler-Test zeigte saubere Tiefenschärfe und natürliche Bewegung ohne das jitternde Artefaktmuster, das bei früheren Modellen üblich war. Landschafts-Pans zeigen ruhige Wolkenbewegungen und atmosphärische Tiefe, während das Modell Negativ-Prompts effektiv nutzt, um Artefakte wie Unschärfe, Verzerrung und Wasserzeichen zu unterdrücken.

Wie Wan 2.7 sich mit konkurrierenden Modellen vergleicht

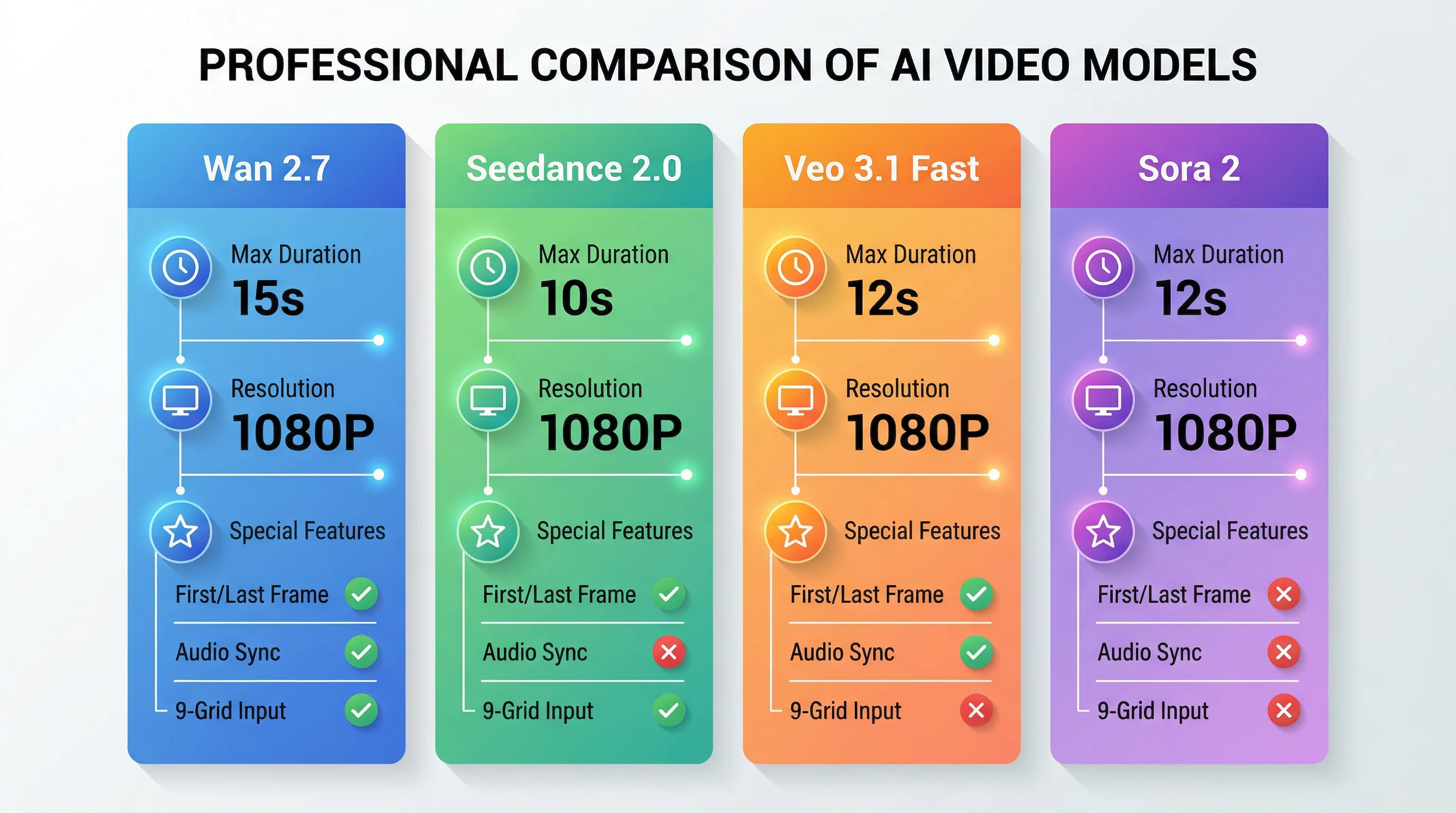

Wan 2.7 vs. Seedance 2.0: Funktionen gegen Preis-Leistung

Seedance 2.0 von ByteDance liefert derzeit den besten Gegenwert für hochwertige Bewegung zum niedrigsten Preis pro Sekunde. Wan 2.7 ist jedoch das Schweizer Taschenmesser im Vergleich: Es bietet die meisten Funktionen, die größte Flexibilität und passt am besten zu Workflows, die Audioeingabe-Synchronisation oder Frame-zu-Frame-Kontrolle benötigen.

Seedance 2.0 ist bei 10-Sekunden-Clips am Limit und bietet weder Anfangs- und Endbild-Steuerung noch Audioeingabe. Es interpretiert Prompts mit etwas mehr kreativer Freiheit, was je nach Projektvorgabe hilfreich oder störend sein kann. Seedance ist in der API-basierten Generierung in der Regel schneller und daher ideal für schnelle Iterationen und Tests. Der kluge Ansatz vieler Produktionsteams ist, Seedance 2.0 für Iteration und Tests zu nutzen und das finale Ergebnis mit Wan 2.7 zu erzeugen, wenn besondere Steuerbarkeit gefragt ist. Wenn Sie die Produktionsabwägungen genauer sehen möchten, lesen Sie den dedizierten Seedance 2 Test und den älteren Vergleich Seedance 2 vs. Wan 2.6.

Wan 2.7 vs. Veo 3.1: Kontrolle gegen Physik

Google Veo 3.1 Fast führt bei physikalischem Realismus und ist im Vergleich das einzige Modell, das sowohl automatisch generiertes Audio als auch 12-Sekunden-Clips zu 0,10 Dollar pro Sekunde bietet. Veo 3.1 liefert 24 fps in Kinoqualität mit nativer Audiogenerierung, einschließlich Umgebungsgeräuschen, Dialog und Musik, alles synchron zu den visuellen Inhalten. Allerdings erreicht Veo 3.1 Lite maximal 8 Sekunden und bietet nicht die feingranularen Steuerungsfunktionen, die Wan 2.7 definieren.

Wan 2.7 glänzt dort, wo Kreative präzise Kontrolle über den Szenenaufbau brauchen, über Anfangs- und Endbild-Anker, 9-Grid-Komposition und Video-Bearbeitung per Anweisung. Veo 3.1 priorisiert realistische Physiksimulation und natürliche Bewegung und ist damit ideal, wenn Realismus wichtiger ist als Kontrolle. Die Wahl zwischen beiden hängt davon ab, ob Ihr Workflow die Steuerbarkeit von Wan 2.7 oder die natürliche Physik von Veo 3.1 höher bewertet. Die ausführliche Einordnung liefert der eigenständige Veo 3.1 Test, der Physik und Audio noch detaillierter aufschlüsselt.

Wan 2.7 vs. Sora 2: Produktionstool gegen experimentelle Plattform

OpenAIs Sora 2 führt bei physikalischem Realismus und bietet 12-Sekunden-Clips mit automatisch generiertem Audio. Allerdings bleibt Sora in seiner Positionierung experimenteller und betont die Produktionsintegration weniger stark. Das Funktionsset von Wan 2.7, insbesondere Anfangs- und Endbild-Steuerung, 9-Grid-Eingabe und Video-Bearbeitung per Anweisung, ist explizit dafür gebaut, wie professionelle Content-Arbeitsabläufe tatsächlich funktionieren: Sie haben ein Storyboard, Sie haben einen Charakter, und Sie haben definierte Anfangs- und Endpunkte für jede Szene. Wan 2.7 arbeitet mit dieser Struktur statt gegen sie. Wenn Sie Spitzenmodelle kategorieweise vergleichen, ist der breitere Vergleich der KI-Videomodelle eine sinnvolle Ergänzung.

Vergleichstabelle der Modelle

| Funktion | Wan 2.7 | Seedance 2.0 | Veo 3.1 Fast | Sora 2 |

|---|---|---|---|---|

| Maximale Dauer | 15 Sekunden | 10 Sekunden | 12 Sekunden | 12 Sekunden |

| Maximale Auflösung | 1080P | 1080P | 1080P | 1080P |

| Anfangs-/Endbild-Steuerung | ✓ | ✗ | ✗ | ✗ |

| Audioeingabe-Synchronisierung | ✓ | ✗ | ✗ | ✗ |

| Native Audiogenerierung | ✓ | ✗ | ✓ | ✓ |

| 9-Grid-Bildeingabe | ✓ | ✗ | ✗ | ✗ |

| Video-Bearbeitung per Anweisung | ✓ | ✗ | ✗ | ✗ |

| Motivreferenz | ✓ | ✓ | ✓ | ✓ |

| Negativ-Prompts | ✓ | Begrenzt | ✗ | ✗ |

| Preismodell | Credits (ohne Ablauf) | Pro Generierung | Pro Generierung | Abo |

| Kommerzielle Nutzung | Alle Stufen | Alle Stufen | Alle Stufen | Variiert |

Anwendungsfälle in der Praxis und Workflow-Integration

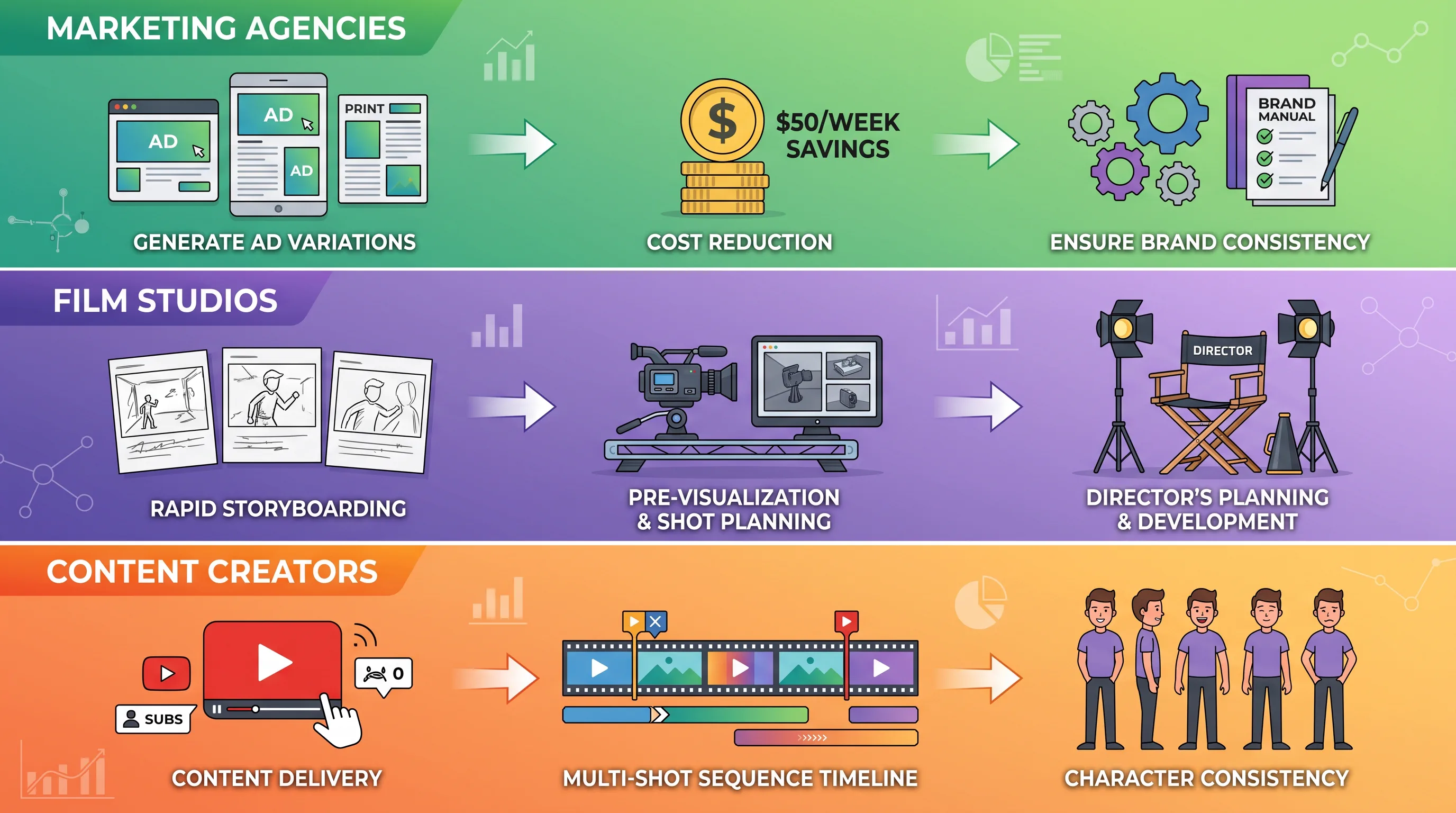

Marketingagenturen: Programmatische Generierung von Anzeigenvarianten

Eine Agentur, die pro Woche 50 Anzeigenvarianten produziert, kann den Roh-Generierungsschritt für unter 50 Dollar in Credits automatisieren und so menschliche Zeit für Strategie und Final Review freisetzen. Das ist eine spürbare Verschiebung vom manuellen Produzieren hin zur kreativen Strategie. Das Abo-freie Modell bedeutet keine monatliche Seat-Gebühr, keinen Plattform-Lock-in und kein Mindestvolumen. Sie zahlen pro Generierung, was perfekt zu Performance-Marketing-Workflows passt. Teams, die wiederholbare Ad-Systeme aufbauen, kombinieren das meist mit einer klaren Seedance 2 Preisreferenz oder einem Benchmark-Artikel für schnellere Iteration.

Brand-Teams können Subject Referencing nutzen, um Produktvisuals über mehrere generierte Szenen konsistent zu halten. Die Video-zu-Video-Bearbeitung erlaubt es, vorhandenes Footage mit neuen Stilen oder saisonalen Anpassungen zu versehen, ohne neu zu drehen, was für Marken-Konsistenz bei gleichzeitig wechselnden Kampagnenzyklen entscheidend ist.

Filmstudios: Vorvisualisierung und schnelles Prototyping

KI-Vorvisualisierung ist im Filmumfeld ein wachsendes Suchthema, und Wan 2.7 adressiert diesen Arbeitsablauf direkt. Regisseure können 9-Grid-Storyboards nutzen, um komplexe Sequenzen zu visualisieren, bevor teure Drehs festgelegt werden. Die Anfangs- und Endbild-Steuerung ermöglicht präzise Szenenplanung, während Motivreferenz die Charakterkonsistenz über Vorviz-Sequenzen hinweg erhält.

Die Möglichkeit des Modells, Clips von bis zu 15 Sekunden mit nativem Audio zu generieren, macht es nicht nur für einzelne Shots, sondern auch für die Vorvisualisierung kompletter Szenen brauchbar. Produktionsteams können Blocking, Kamerabewegung und Tempo mit echter Bewegung und Ton iterieren, bevor sie ans Set gehen, und damit kostspieliges Experimentieren am Drehort reduzieren.

Content-Creator: Multi-Shot-Narrative aufbauen

Für YouTuber, Lehrende und narrative Content-Creator ermöglichen die Funktion zum Fortsetzen von Aufnahmen und die verlängerte Dauer von Wan 2.7 echtes Multi-Shot-Storytelling. Die Kombination aus Anfangs- und Endbild-Steuerung und Motivreferenz bedeutet, dass Sie die Charakterkonsistenz über eine ganze Videosequenz hinweg halten können und damit das Problem lösen, das KI-Videos seit ihren Anfängen begleitet.

Die Anweisungsbearbeitung ist besonders wertvoll für iterative Verfeinerungen. Statt ganze Clips neu zu generieren, wenn Sie Anpassungen brauchen, können Sie gezielte Änderungen per Textbefehl vornehmen und so Iterationszeit und Rechenaufwand drastisch senken.

Technische Integration: API-Zugang und Plattform-Support

Wan 2.7 ist über mehrere API-Anbieter verfügbar, darunter Together AI, Segmind und der direkte Zugang über Alibaba Model Studio. Die Together-AI-Implementierung nutzt den Endpunkt Wan-AI/Wan2.7-T2V und unterstützt standardmäßige REST-API-Aufrufe mit JSON-Payloads. Die Authentifizierung erfolgt über API-Key-Header, und das Modell läuft auf der serverlosen Infrastruktur von Together AI für skalierbare Bereitstellung.

Die Plattformintegrationen wachsen schnell. Wan 2.7 ist unter anderem auf Picsart, SeaArt AI, EaseMate AI, WaveSpeedAI und MindStudio verfügbar. Die Modellbibliothek von SeaArt AI erlaubt es Kreativen, auf mehrere KI-Videomodelle zuzugreifen, ohne zwischen Plattformen zu wechseln, und ermöglicht direkte Direktvergleiche zwischen Wan 2.7, Seedance, Veo und anderen Modellen in einem einzigen Arbeitsablauf.

Besonders interessant ist die Integration von MindStudio für die Automatisierung von Arbeitsabläufen. Die Plattform unterstützt den Aufbau von KI-Agenten, die neue Produktbilder in einem Google-Drive-Ordner überwachen, Videos mit Wan 2.7 generieren, Nachbearbeitung wie Hochskalierung, Gesichtertausch, Clip-Zusammenführung und Untertitelgenerierung anwenden und fertige Clips an Slack liefern, alles ohne manuelle Eingriffe. Diese Form der Workflow-Integration macht Wan 2.7 von einem Generierungstool zu einer Komponente der Produktionspipeline.

Preise und kommerzielle Lizenzierung

Wan 2.7 arbeitet mit einem creditsbasierten Preismodell ohne monatliche Abogebühren. Credits verfallen nicht, ein wesentlicher Vorteil gegenüber den meisten KI-Videotools, bei denen ungenutzte Kapazitäten am Ende des Abrechnungszeitraums zurückgesetzt werden. Die kommerzielle Nutzung ist in allen kostenpflichtigen Stufen enthalten, mit relativ großzügigen Lizenzbedingungen, die zur bisherigen Ausrichtung der Wan-Serie passen.

Die konkreten Preise variieren je nach Anbieter, aber die Grundstruktur bevorzugt Produktions-Workflows mit variabler Nutzung. Für technische Käufer, die offizielle Dokumentation, aufrufbare APIs und dokumentierte Preislisten prüfen, liefern Alibabas öffentlich dokumentierte Video-Angebote eine klarere Runtime-Contract-Aussage als viele Wettbewerber.

Parameterkonfiguration und Prompt-Struktur

| Parameter | Bereich | Empfohlen | Zweck |

|---|---|---|---|

| Dauer | 2-15 Sekunden | 5-8 Sekunden | Balance zwischen Qualität und Generierungszeit |

| Auflösung | 720P, 1080P | 1080P für final, 720P für Tests | Ausgabequalität vs. Geschwindigkeit |

| Seitenverhältnis | 16:9, 4:3, 9:16 | 16:9 für Web, 9:16 für Mobile | Plattformoptimierung |

| Negativ-Prompt | Textzeichenfolge | blurry, distorted, watermark | Unterdrückung von Artefakten |

| Prompt Expansion | Boolean | Aktiviert | Verbesserte Detailinterpretation |

| Audio Input | Optionale Datei | Für Rhythmus-Sync nutzen | Audiovisuelle Kohärenz |

| Frame Anchors | 0-2 Bilder | Für Szenensteuerung nutzen | Vorhersehbare Übergänge |

Wan 2.7 reagiert gut auf ausführliche, beschreibende Prompts mit Details zu Setting, Licht, Kamerabewegung und Handlung. Das Modell profitiert von einer klaren Prompt-Struktur, die Szenenbeschreibung, Charakterdetails, Bewegungsrichtung und Stilpräferenzen in getrennte Klauseln aufteilt. Negativ-Prompts unterdrücken verlässlich gängige Artefakte, retten aber keine grundsätzlich schlechten Eingabebilder. Wenn Sie eine stärkere Struktur für Produktionsarbeit möchten, lohnt sich der Seedance 2 Prompt Guide weiterhin als Vorlage, weil sich Kamerasprache und Szenen-Blocking gut übertragen lassen.

Einschränkungen und Überlegungen

Trotz des umfassenden Funktionsumfangs hat Wan 2.7 einige Einschränkungen. Das Modell priorisiert Qualität vor Geschwindigkeit, was im Vergleich zu Wettbewerbern wie Seedance 2.0 oder Veo 3.1 Lite zu längeren Generierungszeiten führt. Für Rapid-Prototyping-Workflows, die Dutzende schneller Iterationen brauchen, kann das zum Flaschenhals werden. Der empfohlene Ansatz ist, schnellere Modelle für erste Tests zu verwenden und Wan 2.7 für finale Produktionen zu reservieren, wo seine besonderen Funktionen echten Mehrwert liefern.

Auch wenn sich die zeitliche Konsistenz gegenüber Wan 2.6 deutlich verbessert hat, ist sie nicht perfekt. Komplexe Szenen mit vielen bewegten Elementen oder schnellen Kamerabewegungen können weiterhin leichte Flackereffekte oder Konsistenzprobleme zeigen, wenn auch deutlich seltener als bei früheren Versionen. Das Modell funktioniert am besten mit klaren, gut strukturierten Prompts und hochwertigen Eingabebildern. Garbage in, garbage out gilt weiterhin.

Die 9-Grid-Funktion ist zwar innovativ, erfordert aber eine sorgfältige Vorbereitung der Eingabebilder, um optimale Ergebnisse zu erzielen. Schlecht komponierte oder inkonsistente Grid-Eingaben können das räumliche Verständnis des Modells verwirren und zu suboptimalen Ausgaben führen. Diese Funktion entfaltet ihr Potenzial am besten in strukturierten Storyboard-Arbeitsabläufen statt in Ad-hoc-Experimenten.

Warum Seedance AI den besten Zugang zu Wan 2.7 bietet

Für Kreative und Produktionsteams, die die Fähigkeiten von Wan 2.7 nutzen wollen, bietet Seedance AI den umfassendsten Zugangspunkt. Die Plattform integriert mehrere hochmoderne Video- und Bildgenerierungsmodelle in einer einzigen Oberfläche und erspart es, separate Konten und Workflows bei verschiedenen Anbietern zu pflegen. Dieser einheitliche Ansatz reduziert Reibung in Multi-Model-Workflows drastisch, ein entscheidender Vorteil, wenn Sie Ergebnisse vergleichen oder verschiedene Modelle in unterschiedlichen Produktionsphasen einsetzen müssen. Wenn Sie zuerst die direkte Produktübersicht sehen möchten, können Sie auch direkt zur Wan 2.7 Video Modellseite springen.

Seedance AI bietet eine außergewöhnlich bequeme All-in-One-KI-Erfahrung. Die Plattform unterstützt nicht nur Wan 2.7, sondern auch andere Frontier-Modelle wie die eigenen Video-Generatoren von Seedance, Kling, Veo und führende Bildgenerierungssysteme. Diese Breite bedeutet, dass Sie Wan 2.7s Steuerung von Anfangs- und Endbild gegen die Geschwindigkeit von Seedance 2.0 testen oder die Konsistenz von Subjektreferenzen über mehrere Modelle hinweg vergleichen können, alles in demselben Projektarbeitsbereich. Für Agenturen und Studios mit vielfältigen Content-Anforderungen ist diese Flexibilität von großem Wert.

Die Oberfläche der Plattform ist für Produktions-Workflows ausgelegt, mit Funktionen wie Batch-Processing, Projektorganisation und integrierten Post-Processing-Tools. Sie können mit Wan 2.7 generieren, Upscaling oder Editing anwenden und finale Assets exportieren, ohne die Plattform zu verlassen. Für Teams, die prüfen, ob Wan 2.7s einzigartige Fähigkeiten die Integration in ihre Pipeline rechtfertigen, bietet Seedance AI die derzeit reibungsärmste Testumgebung.

Fazit: Produktionsreife KI-Videos sind da

Wan 2.7 liefert das, was die Text-zu-Video-Kategorie seit zwei Jahren verspricht: Qualität nahe am Produktionsniveau durch zugängliche APIs zu Preisen, die programmgesteuerte Videogenerierung für kommerzielle Arbeitsabläufe tatsächlich praktikabel machen. Der umfassende Funktionsumfang des Modells, Anfangs- und Endbild-Steuerung, 9-Grid-Komposition, Motiv- und Stimmenreferenz, native Audio-Synchronisierung und Video-Bearbeitung per Anweisung, steht für einen grundlegenden Wandel von experimentellen Generierungswerkzeugen hin zu Komponenten der Produktionspipeline.

Für Filmemacher, YouTuber, Marketing-Teams und Agentur-Kreative, die Multi-Shot-Videos mit Audio und präziser Kontrolle benötigen, passt Wan 2.7s Funktionsumfang zu der Art, wie professionelle Content-Workflows tatsächlich funktionieren. Sie haben ein Storyboard, Sie haben einen Charakter, und Sie haben definierte Start- und Endpunkte für jede Szene. Wan 2.7 arbeitet mit dieser Struktur statt gegen sie. Das Modell ist nicht perfekt und auch nicht die schnellste Option auf dem Markt, aber es ist das funktionsreichste und am besten steuerbare KI-Videomodell im Jahr 2026.

Die eigentliche Frage ist nicht, ob Wan 2.7 überhyped ist. Die Frage ist, ob Ihr konkreter Arbeitsablauf von seinen einzigartigen Steuerungsfunktionen profitiert. Wenn Sie Inhalte produzieren, die Charakterkonsistenz über mehrere Shots, präzise Szenenübergänge, audiovisuelle Synchronisierung oder iterative Bearbeitung ohne komplette Neugenerierung erfordern, ist Wan 2.7 aktuell die stärkste Option. Für schnelles Prototyping oder Szenarien, in denen Geschwindigkeit wichtiger ist als Kontrolle, können Alternativen wie Seedance 2.0 oder Veo 3.1 Lite passender sein. Der clevere Ansatz ist, Wan 2.7 für Fälle hinzuzunehmen, in denen seine Fähigkeiten echten Mehrwert schaffen, und gleichzeitig schnellere Modelle für Iterationen verfügbar zu halten.

KI-Videogenerierung ist von einer experimentellen Neuheit zu einem Produktionstool geworden. Wan 2.7 repräsentiert den aktuellen Stand der Technik in kontrollierbarer, funktionsreicher Videogenerierung, und Plattformen wie Seedance AI machen den Zugang zu diesen Fähigkeiten und ihre Integration in reale Workflows praktischer denn je.