Wenn Sie nach einem vollständigen HappyHorse-Guide suchen, besteht das eigentliche Problem nicht darin, das Marketingversprechen zu verstehen. Das eigentliche Problem ist, sichtbar Öffentlichtes von unabhängig Verifizierbarem zu trennen und dann zu entscheiden, ob HappyHorse derzeit etwas zum Beobachten, etwas zum Testen oder etwas ist, auf das man sich schon verlassen sollte.

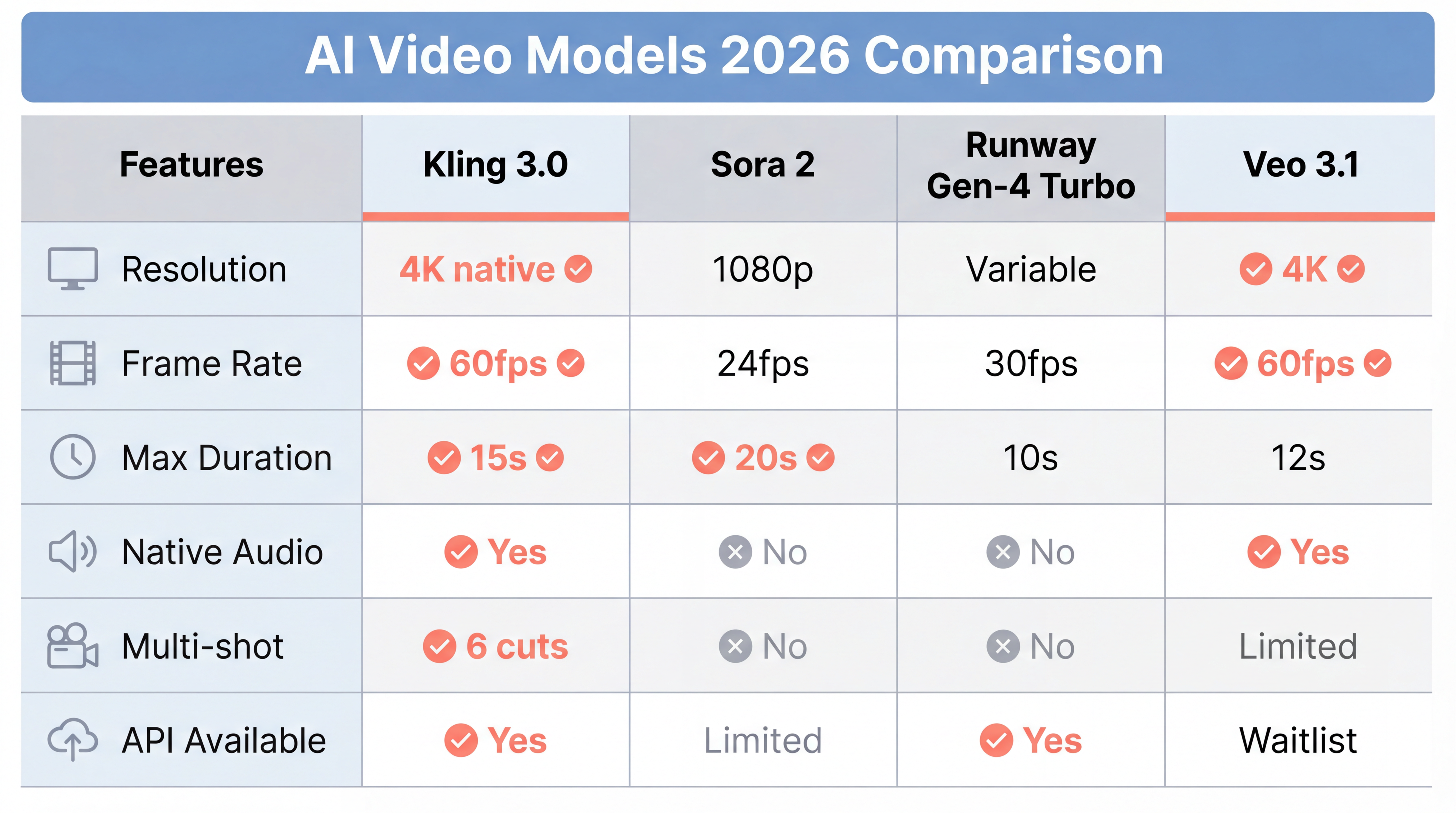

Stand 8. April 2026 erzählen die öffentlichen HappyHorse-Materialien eine sehr ambitionierte Geschichte. HappyHorse 1.0 wird als Open-Source-Multimodal-Video-Modell mit synchronisiertem Audio, Lip-Sync in sieben Sprachen, 1080p-Ausgabe, kommerzieller Nutzungserlaubnis, Self-Hosting-Support und starken Benchmark-Ergebnissen beschrieben. Das ist ein attraktives Paket. Gleichzeitig entsteht sofort ein Verifizierungsproblem, weil der öffentliche Code-Pfad aktuell nicht direkt erreichbar ist und der in Deployment-Beispielen gezeigte Modellpfad in einem ausgeloggten Check ebenfalls nicht offen zugänglich ist.

Das bedeutet nicht automatisch, dass HappyHorse fake ist. Es bedeutet aber, dass Sie jede Aussage mit dem richtigen Rahmen lesen sollten: spannendes Projekt, unvollständige öffentliche Verifikation und unklare Produktionsreife. Dieser Guide zeigt, was real wirkt, was noch Belege braucht, wo HappyHorse am relevantesten scheint und warum ein praktischer Text-to-Video-Workflow oder Image-to-Video-Workflow oft die bessere Entscheidung ist, wenn Sie jetzt Output brauchen statt Spekulation.

Die Kurzantwort

HappyHorse wirkt wie ein vielversprechendes KI-Video-Modellkonzept mit starker öffentlicher Positionierung rund um offene Gewichte, Audio-Generierung, Lip-Sync und Self-Hosting. Die aktuell verfügbaren öffentlichen Belege reichen aber nicht aus, um jede Headline-Behauptung als vollständig bestätigte Infrastruktur ohne Risiko zu behandeln.

Die praktische Entscheidung sieht so aus:

| Frage | Praktische Antwort |

|---|---|

| Ist HappyHorse interessant? | Ja. Das öffentliche Funktionspaket ist für ein offen und selbst hostbar positioniertes Video-Modell ungewöhnlich ambitioniert. |

| Ist HappyHorse heute als öffentliches Open Model vollständig verifiziert? | Noch nicht. Der öffentliche Repository-Pfad ist nicht verfügbar, und der auf der Website gezeigte Modellpfad ist ausgeloggt nicht zugänglich. |

| Sollte man es ignorieren? | Nein. Wer sich für offene multimodale Videogenerierung interessiert, sollte es beobachten. |

| Sollte man heute schon die Content-Pipeline darum bauen? | Nur, wenn man das Verifizierungsrisiko akzeptiert und mit unvollständigen öffentlichen Artefakten leben kann. |

| Was sollten Creator jetzt tun? | Einen bewährten Text-to-Video-Workflow für promptgetriebene Generierung oder einen Image-to-Video-Workflow für referenzgeführte Animation nutzen, während HappyHorse reift. |

Die zentrale Aussage lautet: HappyHorse ist derzeit glaubwürdiger als Projekt mit hohem Upside und Beobachtungswert denn als sofort einsetzbare Grundlage für ernsthafte Produktionsplanung.

Was HappyHorse derzeit öffentlich behauptet

Die öffentlich sichtbaren HappyHorse-Materialien erzählen eine recht konkrete Produktgeschichte statt nur eine vage Teaser-Story. Sichtbar behauptet werden unter anderem:

- ein 15B-Parameter-Modell

- eine 40-Layer-Transformer-Architektur

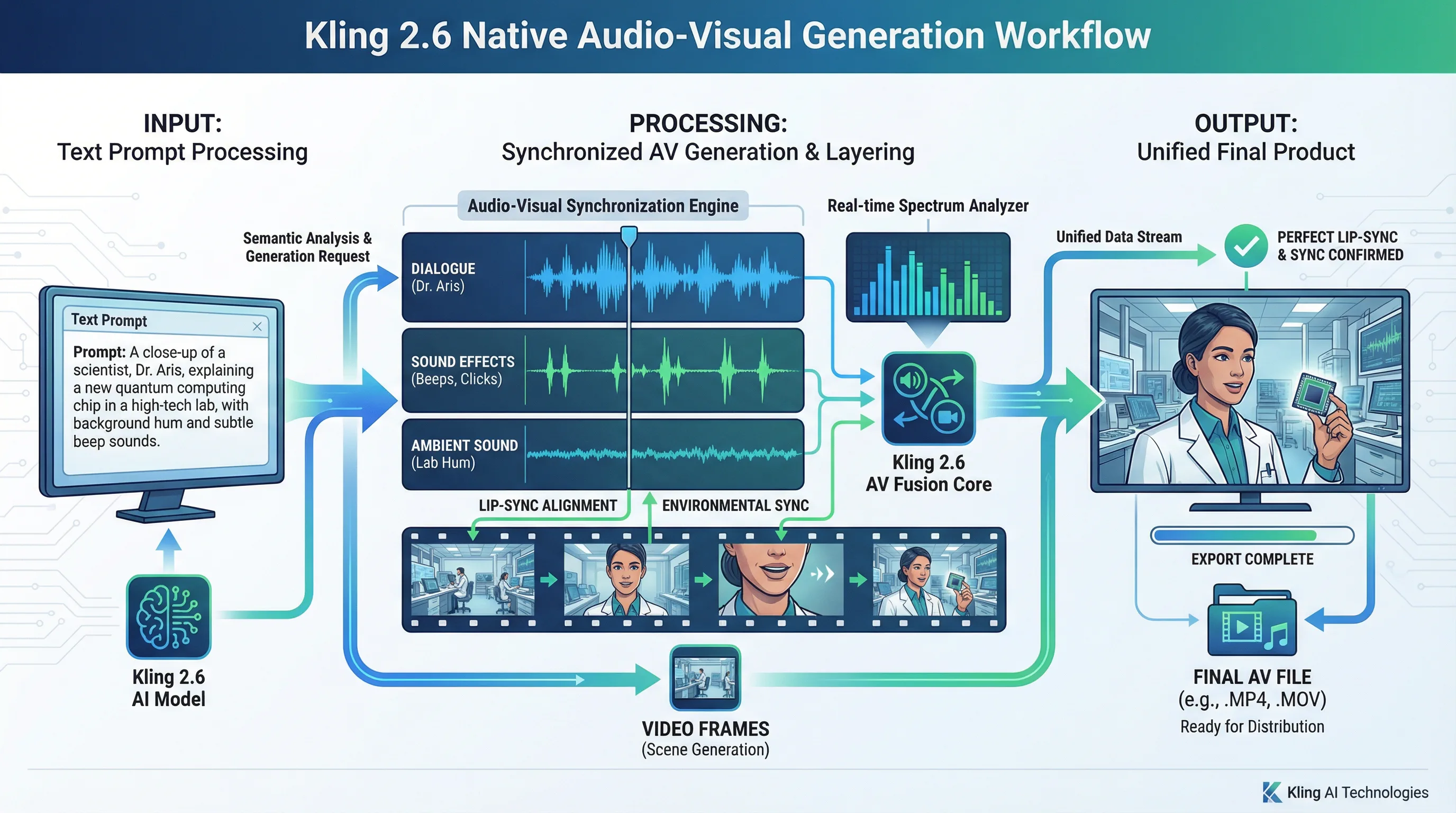

- gemeinsame Video- und Audio-Generierung

- Unterstützung für Text- und Bild-Prompts

- Lip-Sync in sieben Sprachen

- 1080p-Ausgabe

- Clips von 5 bis 8 Sekunden

- Self-Hosting auf GPUs der Klasse H100 oder A100

- Open-Source-Release mit kommerzieller Nutzungserlaubnis

- ein Einstiegspreis von

$11.90

Das sind keine generischen Landing-Page-Phrasen. Es liest sich wie eine technische Launch-Seite für ein Modell, das sowohl bei Creatorn als auch bei Forschenden ernst genommen werden möchte.

Die Seite liefert außerdem konkrete Performance-artige Aussagen, darunter:

- rund 38 Sekunden für einen 5-Sekunden-Clip in 1080p auf H100

- Lip-Sync für Englisch, Mandarin, Kantonesisch, Japanisch, Koreanisch, Deutsch und Französisch

- Benchmark-Siege gegen OVI 1.1 und LTX 2.3

- die Behauptung eines Top-Rankings auf einem öffentlichen Video-Model-Leaderboard

Auf dem Papier wäre das ein sehr attraktives Paket. Ein Modell, das Text-to-Video, Image-to-Video, synchronisiertes Audio, mehrsprachigen Lip-Sync und kommerziell brauchbare Offenheit kombiniert, würde sofort herausstechen. Das Problem ist nicht die Qualität der Story. Das Problem ist die Lücke zwischen Story und den aktuell zugänglichen öffentlichen Artefakten.

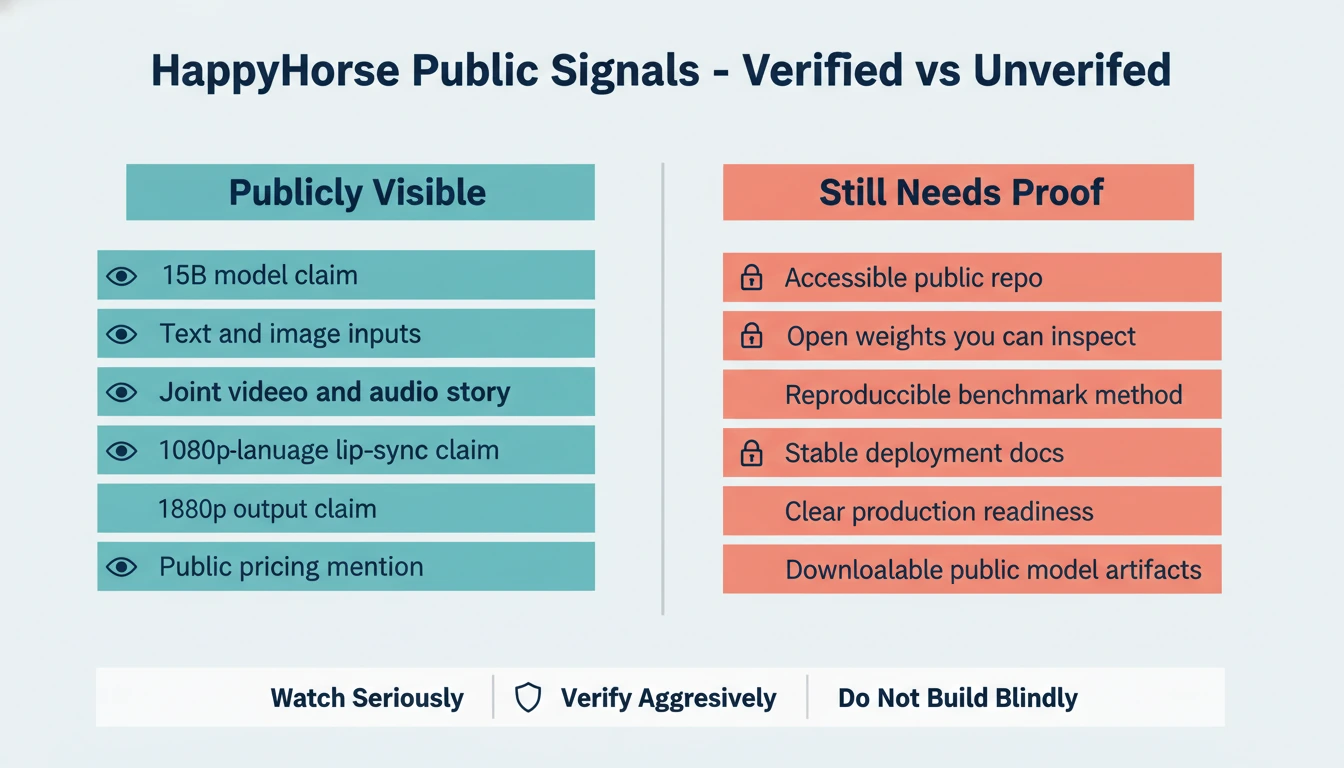

Was wirklich verifiziert ist und was noch Beweise braucht

Am sinnvollsten liest sich HappyHorse derzeit, wenn man die öffentlichen Informationen in zwei Gruppen trennt: direkt beobachtbare Aussagen und Aussagen, die noch unabhängige Bestätigung brauchen.

| Status | Was hier hineinpasst | Warum es hier hingehört |

|---|---|---|

| Öffentlich sichtbar | Feature-Claims auf der Website, Preisangabe, Deployment-Beispiele, Benchmark-Tabellen, Sample-Videos | Diese Punkte sind auf der aktuellen Website direkt sichtbar und als veröffentlichte Aussagen prüfbar. |

| Noch nicht ausreichend unabhängig bestätigt | Open-Source-Verfügbarkeit, öffentliche Gewichte, self-hostbare Codebasis, reproduzierbare Benchmark-Methodik, Produktionsreife | Der verlinkte Repository-Pfad ist nicht erreichbar, und der referenzierte Modellpfad ist ohne Authentifizierung nicht offen zugänglich. |

Diese Unterscheidung ist wichtig, weil Creator oft zwei verschiedene Fragen in eine einzige zusammenziehen.

Die erste Frage lautet:

- Präsentiert das Projekt eine schlüssige und technisch plausible Produktgeschichte?

Die zweite Frage lautet:

- Kann ich es heute unabhängig validieren, herunterladen, reproduzieren und betreiben?

HappyHorse schneidet aktuell bei der ersten Frage besser ab als bei der zweiten.

Das macht das Projekt nicht kaputt. Es verändert nur die richtige Handlung. Wenn Sie forschungsnah arbeiten oder Aufmerksamkeit früh investieren wollen, lohnt sich Beobachtung. Wenn Sie als Creator Deadlines haben, sollten Sie weiter mit Tools liefern, die bereits zuverlässig Output erzeugen.

Warum HappyHorse Aufmerksamkeit bekommt

HappyHorse bekommt Aufmerksamkeit, weil es mehrere Dinge bündelt, die Creator gleichzeitig wollen:

- offene oder zumindest open-leaning Positionierung

- multimodale Generierung statt stummem Video-Output

- Lip-Sync in mehreren Sprachen

- Self-Hosting-Sprache statt reiner SaaS-Abhängigkeit

- Benchmark-Framing, das Konkurrenzfähigkeit zu bekannten offenen Video-Projekten andeutet

Diese Mischung trifft genau die aktuelle Marktreibung. Viele Creator wollen die Qualitätsgewinne neuer Videosysteme, aber nicht in geschlossenen Tools, instabilen regionalen Rollouts oder einer einzigen Preisoberfläche gefangen sein. HappyHorse spricht dieses Bedürfnis direkt an.

Es verbreitet sich aus einem zweiten Grund: Das Projekt beschreibt einen Workflow, der operativ vollständig klingt. Viele Video-Model-Seiten zwingen Sie immer noch, den Stack selbst zusammenzubauen. Video hier generieren. Stimme woanders hinzufügen. Lip-Sync an dritter Stelle reparieren. Später hochskalieren. Timing von Hand säubern. HappyHorse verspricht einen integrierteren Weg.

Genau deshalb wirkt das Projekt relevant, noch bevor die vollständige öffentliche Verifikation aufgeholt hat. Es zeigt auf den Workflow, den Creator tatsächlich wollen.

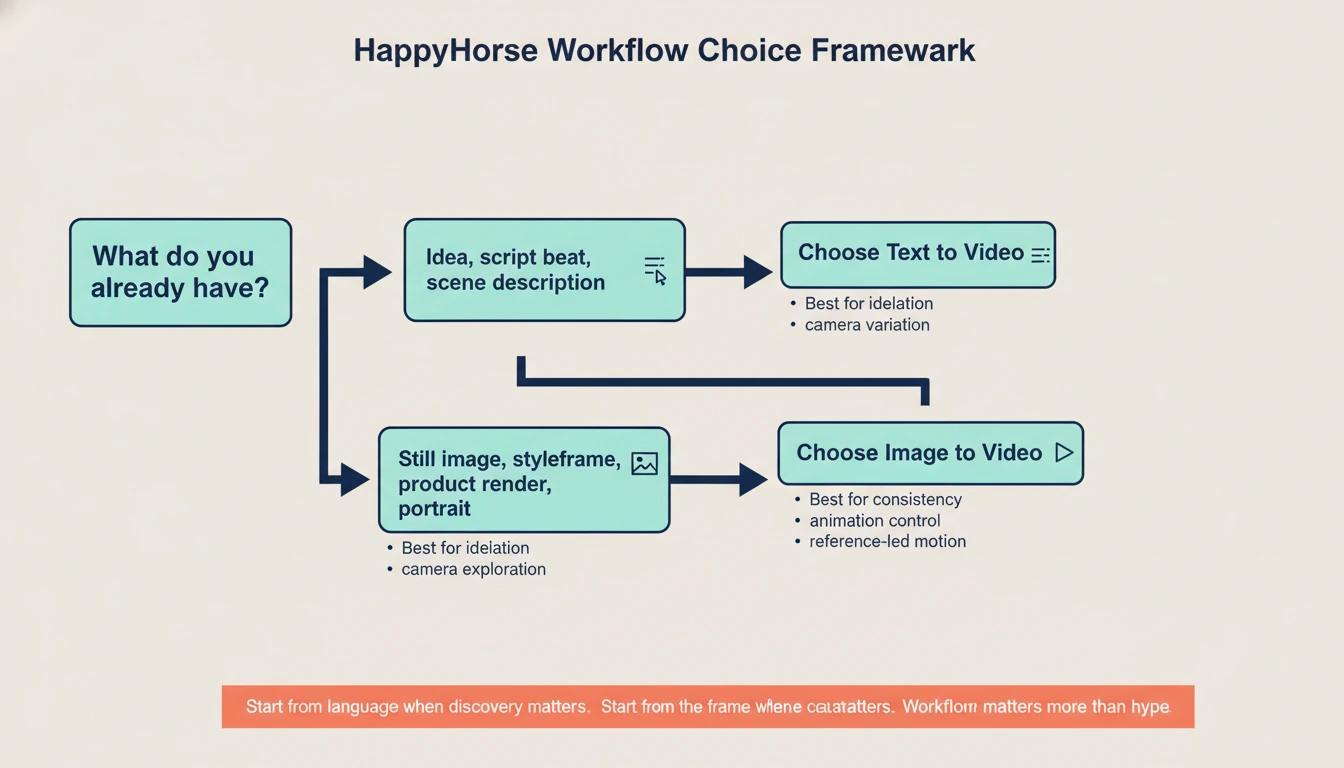

Die eigentliche Workflow-Frage: Text to Video oder Image to Video?

Selbst wenn HappyHorse jede öffentliche Behauptung einlösen sollte, müssten die meisten Creator weiterhin dieselbe Kernentscheidung treffen wie heute: Starten Sie mit Sprache oder mit einem Frame?

Diese Entscheidung ist wichtiger als der Modellname.

| Workflow | Bester Startpunkt | Was er liefert | Hauptschwäche |

|---|---|---|---|

| Text to video | Sie haben eine Idee, einen Szenenbeschrieb, einen Script-Beat oder eine Kamerarichtung, aber noch kein festes Keyframe | Schnellere Ideation, leichtere Konzeptsuche, stärkere promptgesteuerte Variation | Die Komposition driftet leichter, wenn Ihr inneres Bild sehr konkret ist |

| Image to video | Sie haben bereits ein Standbild, einen Charakterframe, einen Produktrender, ein Storyboard-Frame oder einen Hero Shot | Bessere Subjektkonsistenz, engere Art Direction, einfachere Animation freigegebener Visuals | Weniger Freiheit für große Szenenwechsel, wenn das Ausgangsbild nicht stark genug ist |

Genau hier bleiben viele bei neuen Modell-Launches hängen. Sie beginnen zu denken, das neue Modell selbst sei der Workflow. Das ist es nicht. Der Workflow beginnt weiterhin mit dem kreativen Asset, das Sie bereits haben.

Nutzen Sie Text to video, wenn:

- Sie mehrere Szenenideen schnell erkunden wollen

- Sie alternative Kamera-Setups aus einem geschriebenen Konzept brauchen

- Sie die visuelle Richtung noch finden

- Sie Stimmung, Action oder Narrative Beats iterieren möchten, bevor Sie einen Frame festschreiben

Nutzen Sie Image to video, wenn:

- Sie bereits ein starkes Standbild haben

- Charakter, Produkt oder Komposition eng an einer Referenz bleiben sollen

- Sie ein Key-Art-Frame, ein Werbevisual, ein Porträt oder ein Storyboard-Panel animieren

- visuelle Konsistenz wichtiger ist als offene Entdeckung

HappyHorse unterstützt vielleicht irgendwann beide Wege in einem einzigen Ökosystem. Für die meisten Creator ändert das aber nicht den Entscheidungsbaum, sondern nur das Modell, das ihn ausführt.

Wo HappyHorse auf dem Papier am stärksten wirkt

Wenn die öffentliche Positionierung in die richtige Richtung zeigt, wäre HappyHorse in einigen konkreten Szenarien besonders überzeugend.

1. Dialoggetriebenes Kurzvideo

Gemeinsame Video- und Audio-Generierung plus mehrsprachiger Lip-Sync ist die auffälligste Kombination des Pakets. Wenn diese Features auf dem vom Standort implizierten Niveau funktionieren, wäre HappyHorse deutlich interessanter als ein weiterer stiller Clip-Generator mit schicken Benchmark-Charts.

Das wäre relevant für:

- Talking-Avatar-Inhalte

- kurze Erklärvideos

- mehrsprachige Creator-Videos

- Produkt-Intros mit gesprochenem On-Screen-Text

- dialogfokussierten Social Content

2. Offene oder self-hosted Experimente

Viele Teams wollen nicht nur guten Output. Sie wollen Infrastruktur, die sie inspizieren, feinjustieren, benchmarken und vielleicht auf eigenen GPUs betreiben können. Genau deshalb zählt der Open-Source-Aspekt so stark.

Wenn HappyHorse tatsächlich nutzbare Gewichte, Inferenzcode und Distillation-Optionen liefert, wird es nicht nur für Creator relevant, sondern auch für:

- angewandte KI-Teams

- Forschungsgruppen

- Studios mit Privacy-Anforderungen

- Unternehmen mit internen Media-Pipelines

3. Stärkere Stilkontrolle bei Image-to-Video

Das Projekt behauptet Unterstützung für Text- und Bild-Input. In der Praxis werden Modelle mit bildgetriebener Generierung für kommerzielle Arbeit oft deutlich nützlicher als reine Textsysteme, weil image-first Workflows besser kontrollierbar sind.

Darum ist es schon vor voller Verifizierbarkeit sinnvoll, Ihren Prozess mit einem Image-to-Video-Workflow gegenzuprüfen. Wenn Ihre Produktionslogik auf freigegebenen Stills, Styleframes, Produktgrafiken oder Charakterreferenzen aufbaut, ist bildgeführte Animation der besser übertragbare Workflow.

Wo die aktuelle öffentliche Story noch fragil wirkt

Das ist der Teil, den viele Launch-Artikel überspringen. Die Schwächen sind nicht zwingend Modellschwächen. Es sind Schwächen in Vertrauen und Operabilität.

Öffentliche Artefakte passen nicht zur Story

Die aktuellen öffentlichen Materialien sprechen mit dem Selbstvertrauen eines vollständig gestarteten technischen Produkts. Der öffentliche Repository-Pfad stützt dieses Selbstvertrauen derzeit nicht. Wenn ein Projekt mit Open-Source-Glaubwürdigkeit führen will, sind zugängliche Artefakte keine Kür.

Benchmark-Vertrauenslücke

Benchmark-Tabellen lassen sich leicht veröffentlichen. Reproduzierbare Evaluationsdetails sind viel schwerer. Solange kein klar einsehbarer Report, stabiler Codezugang oder Third-Party-Reproduktionspfad existiert, sollten Benchmark-Zahlen als Richtungsaussagen und nicht als abgeschlossene Fakten gelesen werden.

Produktionsreife bleibt unklar

Ein Modell kann real, beeindruckend und trotzdem noch nicht für verlässliche Produktion bereit sein. Teams mit Deadlines achten auf:

- stabilen Zugang

- dokumentierte Fehlermodi

- vorhersagbare Rate

- reproduzierbare Umgebungen

- sichtbare Update-Kadenz

HappyHorse legt aktuell nicht genug öffentliche operative Oberfläche offen, um in diesen Punkten hoch zu punkten.

Was Creator jetzt tun sollten

Wenn Sie neugierig auf HappyHorse sind, ist der beste Schritt nicht, über Übertreibung oder Unterbewertung zu streiten. Der beste Schritt ist, Ihren Workflow schon jetzt risikoärmer zu machen.

Nutzen Sie diese Entscheidungstabelle:

| Ihre Situation | Bester Schritt jetzt |

|---|---|

| Sie brauchen vor allem Konzeptsuche aus Prompts | Bauen Sie auf einem verlässlichen Text-to-Video-Workflow auf und setzen Sie HappyHorse auf die Watchlist |

| Sie haben bereits Konzeptframes, Produktstills oder Porträts | Bauen Sie auf Image to video auf und testen Sie neue Modelle nur, wenn sie bessere Konsistenz liefern |

| Ihnen ist offene Infrastruktur wichtiger als kurzfristiges Publishing | Beobachten Sie HappyHorse eng und warten Sie auf zugängliche Gewichte, Code und reproduzierbare Doku |

| Sie brauchen diese Woche veröffentlichbare Assets | Machen Sie Ihr Content-Scheduling nicht von einem Modell mit unvollständiger öffentlicher Verifikation abhängig |

Genau dieser praktische Blick fehlt in vielen Launch-Analysen. Sie müssen nicht entscheiden, ob HappyHorse die Zukunft ist. Sie müssen nur entscheiden, was Ihnen heute hilft zu liefern, ohne bessere Tools von morgen auszuschließen.

Wo Sie öffentliche HappyHorse-Berichterstattung verfolgen können

Wenn Sie beobachten möchten, wie das Projekt in öffentlichen Verzeichnissen und auf launchartigen Seiten auftaucht, sind HappyHorse AI und das HappyHorse-Videomodell zwei nützliche Anhaltspunkte. Verstehen Sie beides als Entdeckungsquellen, nicht als Ersatz für prüfbaren Code, stabile Gewichte und reproduzierbare Deployment-Artefakte.

Wie man HappyHorse besser bewertet, sobald mehr öffentliche Artefakte da sind

Wenn HappyHorse mehr öffentliche Infrastruktur offenlegt, werden vor allem diese Tests zählen:

- Kommt ein ausgeloggter Nutzer ohne Sackgassen zum echten Repository, zur Dokumentation und zur Modellseite?

- Sind Gewichte, Inferenzskripte und Deployment-Anweisungen auf allen öffentlichen Oberflächen konsistent?

- Gehorcht der Text-to-Video-Pfad filmischen Prompts auf sinnvoll konsistentem Niveau?

- Bewahrt der Image-to-Video-Pfad Subjekt und Komposition unter Bewegung?

- Ist das synchronisierte Audio wirklich brauchbar oder braucht es weiterhin viel Cleanup?

- Sind die mehrsprachigen Lip-Sync-Claims in öffentlichen Demos jenseits kuratierter Snippets sichtbar?

- Können Creator oder Engineers die veröffentlichten Performance-Angaben auf offengelegter Hardware reproduzieren?

Bis diese Fragen beantwortet sind, ist informierte Aufmerksamkeit die richtige Haltung, nicht blinde Adoption.

FAQ

Ist HappyHorse gerade jetzt Open Source?

HappyHorse wird öffentlich als Open Source mit kommerzieller Nutzungserlaubnis präsentiert, aber der aktuelle öffentliche Repository-Pfad ist in einem Direktcheck nicht zugänglich. Der Open-Source-Claim ist sichtbar. Die offene Artefaktkette ist noch unvollständig.

Ist HappyHorse Text-to-Video oder Image-to-Video?

Die aktuelle öffentliche Website präsentiert es als beides. Das ist ein Teil des Aufmerksamkeitsfaktors. Die nützlichere Frage ist, welcher Workflow zu Ihren Inputs passt: Text to video für promptgeführte Ideation oder Image to video für referenzgeführte Animation.

Ist HappyHorse bereit für Produktion?

Es könnte produktionsrelevant werden, aber das aktuelle Niveau öffentlicher Verifikation reicht nicht aus, um es als Zentrum einer deadline-sensitiven Pipeline zu empfehlen.

Warum interessiert sich so viele Leute für HappyHorse?

Weil es offene Modellpositionierung mit synchronisiertem Audio, mehrsprachigem Lip-Sync sowie Text- und Bild-Input kombiniert. Das ist eine deutlich attraktivere Workflow-Story als ein weiteres stummes Video-Modell mit nur einem Benchmark-Screenshot.

Was sollte ich nutzen, während HappyHorse reift?

Gehen Sie workflow-first vor. Starten Sie mit Text to video, wenn die Szene noch promptgetrieben ist, und nutzen Sie Image to video, wenn Sie bereits das Bild haben, das Sie animieren wollen.

Schlussurteil

HappyHorse verdient Aufmerksamkeit, aber kein blindes Vertrauen. Die öffentliche Projektstory ist stark genug, um ernsthaft beobachtet zu werden, und schwach genug, um aggressiv gegengeprüft zu werden.

Wenn das Modell seine öffentlichen Claims mit stabilen Artefakten tatsächlich einlöst, könnte es zu einem der interessanteren offenen Video-Projekte am Markt werden. Bis dahin sollten Creator vermeiden, Launch-Page-Euphorie in Produktionsabhängigkeit zu verwandeln. Bauen Sie auf Workflows, die Ihnen heute schon beim Liefern helfen, halten Sie Ihre Bewertungsstandards hoch und behandeln Sie HappyHorse als vielversprechendes Projekt, das seine Beweislücke noch schließen muss.