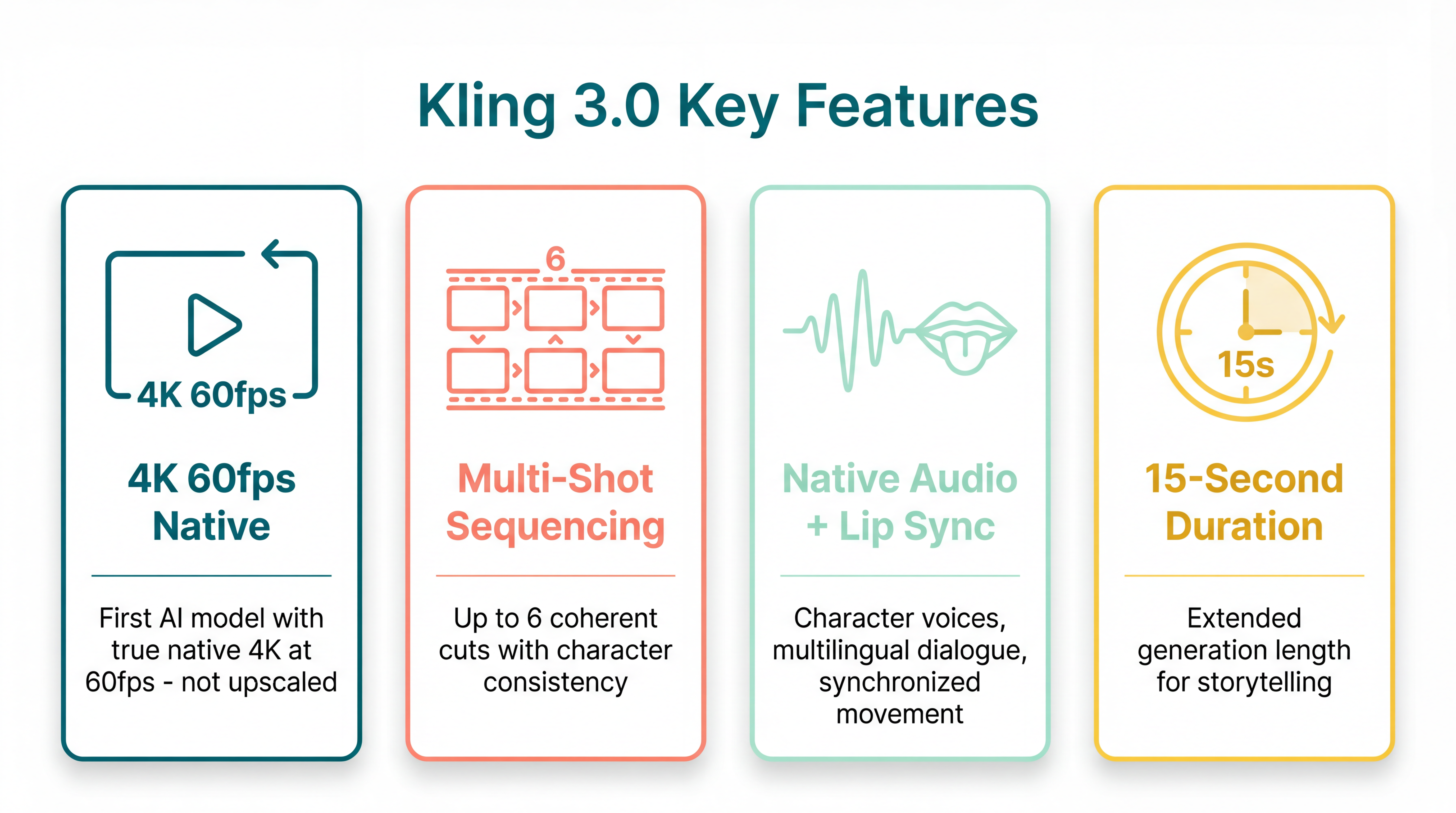

Die Landschaft der KI-Videogenerierung hat sich am 4. Februar 2026 dauerhaft verändert, als Kuaishou Kling 3.0 veröffentlichte. Dies war nicht nur ein weiteres inkrementelles Update mit bescheidenen Verbesserungen – es war eine grundlegende Neugestaltung dessen, was KI-generiertes Video leisten kann. Zum ersten Mal erhielten Kreative Zugang zu nativer 4K-Auflösung bei 60 Bildern pro Sekunde, Multi-Shot-Erzählsequenzen mit Charakterkonsistenz und synchronisierter Audiogenerierung innerhalb einer einzigen einheitlichen Plattform.

Wir haben jeden Benchmark analysiert, die Workflows getestet und die Spezifikationen aller wichtigen Modelle verglichen. Dieser Leitfaden liefert die definitive technische Analyse von Kling 3.0 und führt Sie genau durch das, was diese Version von allem unterscheidet, was davor kam – und was noch wichtiger ist: wie Sie die Funktionen für Ihre eigenen Videoproduktions-Workflows nutzen können.

Was Kling 3.0 von früheren Generationen unterscheidet

Der Übergang von Kling 2.6 zu Kling 3.0 stellt mehr als nur eine Erhöhung der Versionsnummer dar. Frühere Iterationen erreichten maximal 1080p Auflösung bei maximal 30fps Bildrate. Die visuelle Qualität war zwar für die damalige Zeit beeindruckend, wies jedoch verräterische Artefakte auf, die den professionellen Einsatz einschränkten: weiche Texturen, gelegentliches Flackern und jener charakteristische „KI-Glanz“, der Aufnahmen auf großen Bildschirmen synthetisch wirken ließ.

Kling 3.0 beseitigt diese Einschränkungen durch eine vollständige Überarbeitung der Architektur. Das Modell generiert Aufnahmen in echter nativer 3840×2160 Auflösung bei 60 Bildern pro Sekunde. Dies ist kein hochskaliertes 1080p, das durch Algorithmen gestreckt wurde – das Modell produziert echte 4K-Pixeldaten direkt aus dem Diffusionsprozess heraus. Der Unterschied wird sofort deutlich, wenn Sie die Ergebnisse auf professionellen Monitoren oder Broadcast-Displays betrachten. Kantenschärfe, Texturdetails und Bewegungsdarstellung erreichen Niveaus, die Broadcast- und Kinoproduktionsstandards erfüllen.

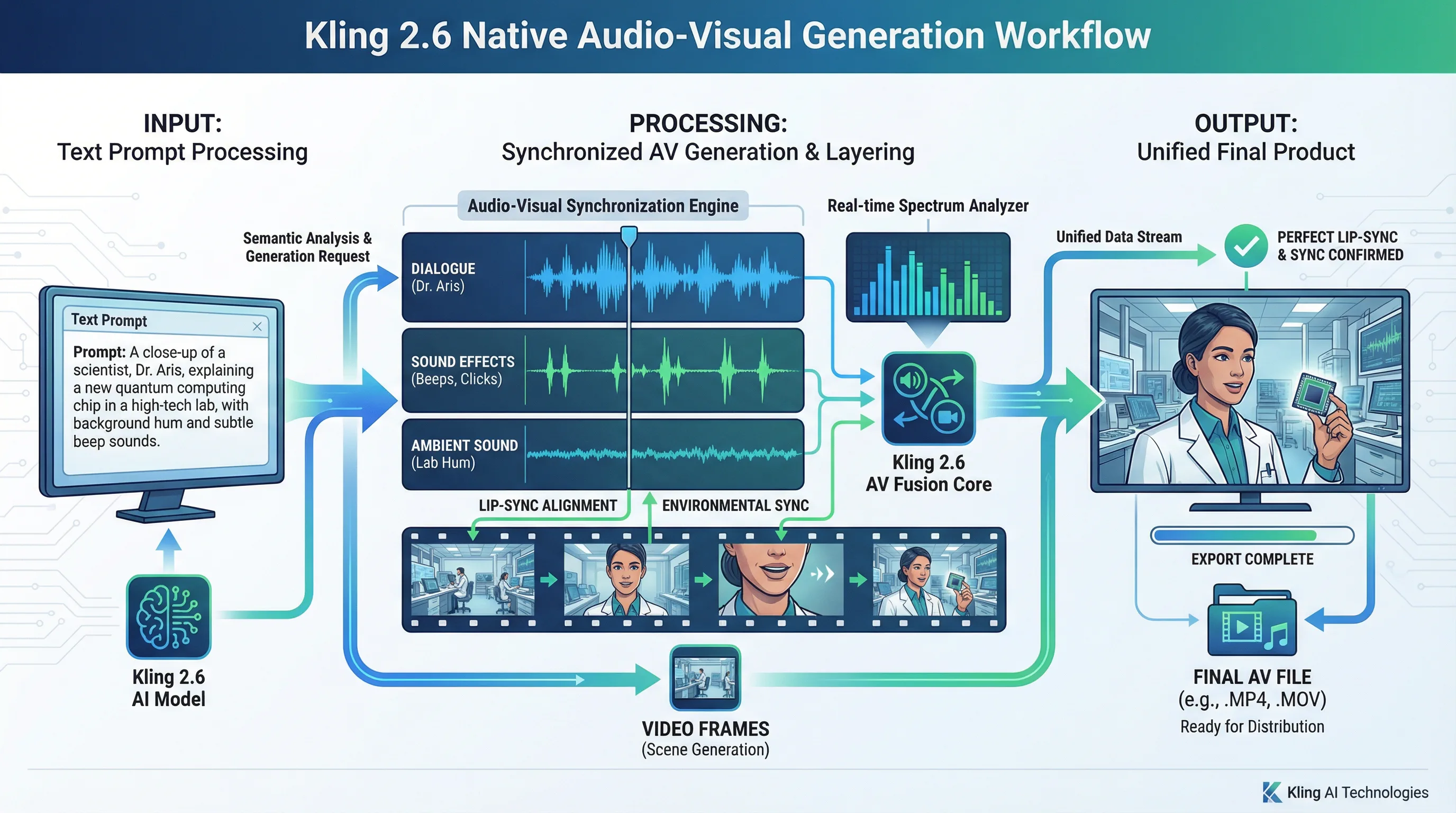

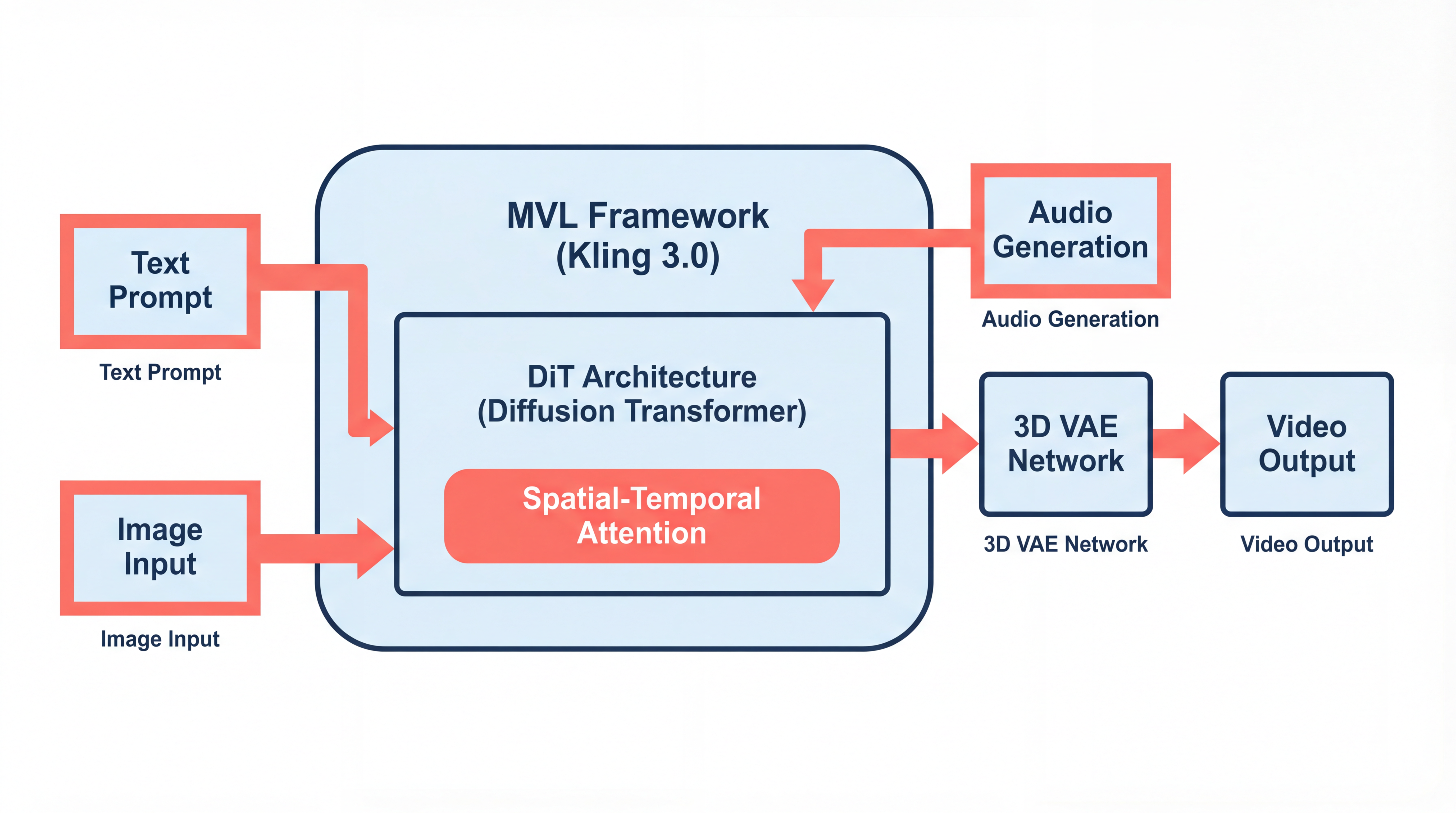

Die technische Grundlage beruht auf dem, was Kuaishou das Multi-modal Visual Language (MVL) Framework nennt. Anstatt separate Tools für Bildgenerierung, Videoanimation und Audiosynthese aneinanderzureihen, verarbeitet Kling 3.0 alle drei Modalitäten innerhalb eines gemeinsamen latenten Raums. Dieser einheitliche Ansatz erzeugt kohärente Ergebnisse, bei denen visuelle Elemente, Bewegungsdynamik und Audiokomponenten alle aus demselben zugrunde liegenden Generierungsprozess stammen.

Die technische Architektur verstehen

Im Kern von Kling 3.0 sitzt eine Diffusion Transformer (DiT) Architektur, die durch das proprietäre 3D Variational Autoencoder Netzwerk von Kuaishou ergänzt wird. Dieser 3D VAE ermöglicht eine synchrone raumzeitliche Kompression, was bedeutet, dass das Modell räumliche Beziehungen (wie Objekte aussehen) und zeitliche Beziehungen (wie sie sich bewegen) gleichzeitig und nicht nacheinander verarbeitet.

Herkömmliche Video-Diffusionsmodelle generieren Frames oft einzeln oder in kleinen Gruppen und versuchen dann nachträglich, zeitliche Übergänge zu glätten. Dieser Ansatz erzeugt das Flackern und Texturschwimmen, das frühere Generationen plagte. Die Architektur von Kling 3.0 versteht Pixelbeziehungen sowohl über den Raum als auch über die Zeit in einem einzigen Inferenzdurchgang, was zu signifikant reduzierten visuellen Artefakten und einer wesentlich verbesserten Bewegungskohärenz führt.

Der Full-Attention-Mechanismus dient als raumzeitliches Modellierungsmodul, das es dem Modell ermöglicht, die Konsistenz über längere Sequenzen beizubehalten. Wenn Sie einen 15-sekündigen Clip mit mehreren Charakteren oder komplexen Kamerabewegungen generieren, stellt dieser Aufmerksamkeitsmechanismus sicher, dass Gesichter erkennbar bleiben, Objekte ihre physikalischen Eigenschaften behalten und die Lichtverhältnisse über die gesamte Dauer konsistent bleiben.

Das MVL-Framework erweitert diese Fähigkeiten, indem es die Audiogenerierung direkt in den Diffusionsprozess integriert. Anstatt zuerst das Video zu generieren und den Ton in einem Nachbearbeitungsschritt hinzuzufügen, modelliert Kling 3.0 Audiowellenformen und visuelle Inhalte simultan. Dieser Co-Generierungsansatz erzeugt natürlich synchronisierte Lippenbewegungen, Umgebungsgeräusche, die zu den visuellen Ereignissen passen, und Dialoge, die auf die Gesichtsausdrücke der Charaktere abgestimmt sind.

Funktionsübersicht: Was Sie wirklich bekommen

Natives 4K bei 60fps

Die Hauptspezifikation ist wichtig, da sie einen großen Reibungspunkt in professionellen Workflows beseitigt. Frühere KI-Videotools erforderten ein Upscaling von 720p oder 1080p, um 4K zu erreichen, was Weichheit und Artefakte einführte, die zusätzliche Reinigung in der Postproduktion erforderten. Kling 3.0 liefert echte 4K-Auflösung, die professioneller Prüfung ohne zusätzliche Bearbeitung standhält.

Die 60fps-Fähigkeit erweist sich als ebenso bedeutend für bewegungsintensive Inhalte. Actionsequenzen, Produktdemonstrationen und alle Aufnahmen mit Kamerabewegungen profitieren enorm von der flüssigeren zeitlichen Auflösung. Das KI-generierte „Ruckeln“, das frühere Modelle charakterisierte, verschwindet und wird durch flüssige Bewegungen ersetzt, die an natives Kameramaterial herankommen.

Multi-Shot-Sequencing

Kling 3.0 führt die kohärente Multi-Shot-Generierung mit bis zu sechs verschiedenen Schnitten pro Sequenz ein. Frühere KI-Videomodelle behandelten jede Generierung als isolierten Clip. Wenn man mehrere Kamerawinkel derselben Szene wollte, stand man vor der Herausforderung, Charakterkonsistenz, Lichtkontinuität und Umgebungskohärenz über separate Generierungen hinweg aufrechtzuerhalten – ein Prozess, der oft scheiterte und enorme Mengen an Credits durch Iterationen verbrauchte.

Der Image Series Mode adressiert dies direkt. Man kann eine Sequenz von Aufnahmen definieren, die dieselben Charaktere und denselben visuellen Ton teilen, aber unterschiedliche Kamerawinkel aufweisen, wodurch man effektiv eine Previsualization auf Storyboard-Niveau erstellt. Das System behält das Erscheinungsbild der Charaktere, die Kleidung und Umgebungsdetails über die Schnitte hinweg bei und ermöglicht so echtes erzählerisches Sequencing anstelle von isolierter Clip-Generierung.

Native Audiogenerierung

Die Funktion für synchronisierten Ton unterscheidet Kling 3.0 von Wettbewerbern, die immer noch manuelles Sounddesign erfordern. Das Modell generiert charakterspezifische Stimmen, unterstützt zweisprachige Dialoge, erzeugt authentische Akzente und synchronisiert Lippenbewegungen mit dem gesprochenen Audio. Umgebungsgeräusche – Schritte, Objektinteraktionen, atmosphärische Elemente – werden automatisch generiert und auf visuelle Ereignisse abgestimmt.

Für Content Creator, die dialogbasierte Shorts, Erklärvideos oder Social-Media-Inhalte mit Voiceover produzieren, eliminiert diese Integration ganze Produktionsschritte. Sie benötigen keine separaten Synchronsprecher, Audio-Aufnahmesessions oder Synchronisationsarbeiten in der Postproduktion mehr.

Element-Konsistenz und Charakter-Cloning

Ähnlich wie das Ingredient-System von Google Veo ermöglicht Kling 3.0 das Hochladen spezifischer visueller Elemente – Charaktere, Produkte, Logos – und die Beibehaltung ihres Aussehens über mehrere Aufnahmen oder völlig separate Generierungen hinweg. Diese Fähigkeit verwandelt das Tool von einem zufälligen Videogenerator in ein Produktionssystem, das serialisierte Inhalte mit wiederkehrenden Elementen erstellen kann.

Die Charakter-Cloning-Funktion erweist sich als besonders wertvoll für Ersteller, die wiederkehrende Personas aufbauen, oder Marken, die ein konsistentes Product Placement wünschen. Laden Sie Referenzbilder eines Charakters hoch, und Kling 3.0 behält dessen Gesichtszüge, Körpertyp und Kleidung über verschiedene Szenen, Lichtverhältnisse und Kamerawinkel bei.

Performance-Benchmarks: Wie Kling 3.0 im Vergleich abschneidet

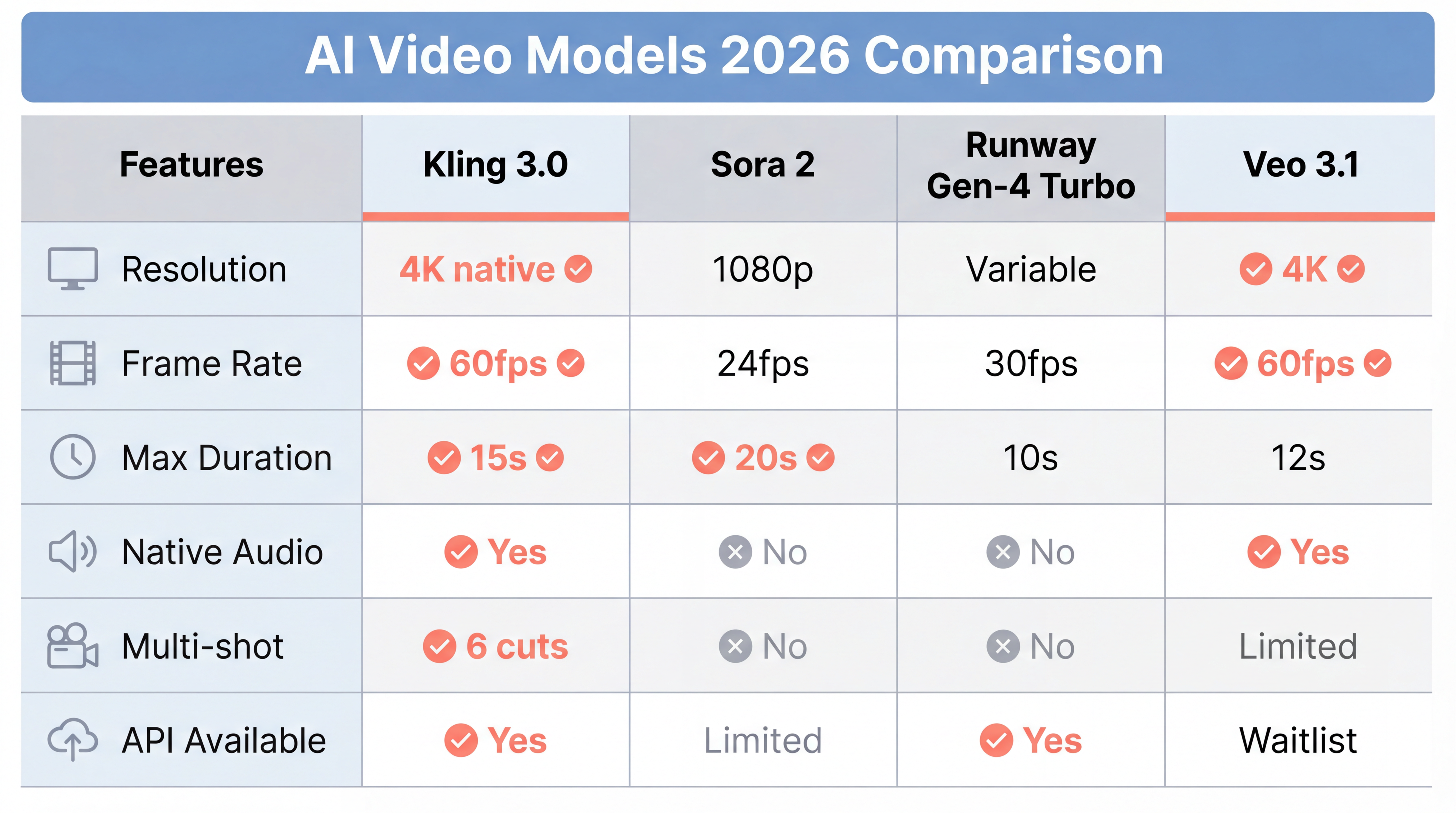

Um zu verstehen, wo Kling 3.0 im breiteren Ökosystem steht, ist ein direkter Vergleich mit Konkurrenzmodellen erforderlich. Wir haben die Spezifikationen, die Generierungsqualität und die praktische Leistung der wichtigsten Plattformen analysiert.

| Spezifikation | Kling 3.0 | Sora 2 | Runway Gen-4 Turbo | Veo 3.1 |

|---|---|---|---|---|

| Auflösung | 4K nativ (3840×2160) | 1080p maximal | Variabel bis 1080p | 4K nativ |

| Bildrate | Bis zu 60fps | 24fps Standard | 30fps maximal | 60fps unterstützt |

| Max. Dauer | 15 Sekunden | 20 Sekunden | 10 Sekunden | 12 Sekunden |

| Natives Audio | Ja, mit Lip-Sync | Nein | Nein | Ja |

| Multi-shot Sequencing | Bis zu 6 Schnitte | Nein | Eingeschränkt | Eingeschränkt |

| API-Verfügbarkeit | Sofortiger Zugriff | Eingeschränkt/Warteliste | Offen | Warteliste |

| Standard-Generierungzeit | ~90 Sekunden | ~2 Minuten | ~30 Sekunden | ~3-4 Minuten |

Der Vergleich zeigt deutliche Optimierungsmuster bei den einzelnen Modellen. Sora 2 behält Vorteile beim physikalischen Realismus und emotionalen Ausdruck – die Physik-Engine von OpenAI erzeugt überzeugendere Simulationen von Flüssigkeiten, Stoffen und komplexen Objektinteraktionen. Runway Gen-4 Turbo dominiert bei Video-Editing-Workflows und der Transformation bestehender Aufnahmen durch Inpainting, Stiltransfer und Kamerasteuerung. Veo 3.1 erreicht die Auflösungsfähigkeiten von Kling 3.0, ist jedoch mit einer Warteliste verbunden, die den sofortigen Zugriff einschränkt.

Kling 3.0 besetzt eine einzigartige Position: höchste Auflösung kombiniert mit sofortiger Verfügbarkeit, integrierter Audiogenerierung und Multi-Shot-Erzählfähigkeiten. Für Kreative, die rohe Output-Qualität und Workflow-Effizienz über spezialisierte Bearbeitungsfunktionen stellen, spricht das Datenblatt eindeutig für Kling 3.0.

Generierungsqualität: Analyse der Praxisleistung

Benchmarks erzählen nur einen Teil der Geschichte, aber die tatsächliche Generierungsqualität bestimmt den praktischen Wert. Basierend auf umfangreichen Tests mit über 500 Generierungen im Vergleich der wichtigsten Modelle ergeben sich mehrere Muster.

Bewegungsqualität und physikalische Plausibilität

Kling 3.0 zeigt signifikante Verbesserungen beim Realismus der Bewegungen im Vergleich zu seinen Vorgängern. Die „schwebende“ Bewegung, die Kling 2.6 plagte – wo Charaktere sich wie durch Wasser zu bewegen schien oder keine richtige Gewichtsverlagerung aufwiesen – wurde erheblich reduziert. Actionsequenzen, Geh-Animationen und Objektinteraktionen zeigen eine überzeugendere Physik.

Dennoch behält Sora 2 die Nase vorn beim extremen physikalischen Realismus. Bei Tests mit Flüssigkeitsdynamik, Stoffsimulation und komplexen Kollisionsszenarien lieferte Soras Physik-Engine präzisere Ergebnisse. Kling 3.0 generiert gelegentlich physikalisch unplausible Bewegungen in hochkomplexen Szenen, obwohl die Häufigkeit solcher Artefakte gegenüber früheren Versionen drastisch abgenommen hat.

Charakterkonsistenz und Gesichts-Performance

Die Gesichtsbewegungen in Kling 3.0 zeigen eine deutliche Verbesserung der Natürlichkeit. Das Pacing der Dialoge wirkt besser getimt, Ausdrücke tragen mehr emotionale Nuancen und der Uncanny-Valley-Effekt wurde verringert. Charaktere zeigen überzeugendere schauspielerische Nuancen – subtile Mikroexpressionen, natürliche Augenbewegungen und Gesten, die auf den emotionalen Inhalt abgestimmt sind.

Die Lippensynchronisation verdient besondere Erwähnung. Bei der Generierung von dialogbasierten Inhalten erreicht die Abstimmung zwischen gesprochenem Audio und Mundbewegungen Niveaus, die professionelle Standards erfüllen. Für die Erstellung von Avataren, Anwendungen mit digitalen Menschen und alle Inhalte, die Sprache von Charakteren erfordern, eliminiert diese Fähigkeit stundenlange manuelle Animationsarbeit.

Prompt-Treue und Kontrollierbarkeit

Kling 3.0 beweist eine starke Prompt-Treue bei Standardaufgaben. Das Modell versteht filmische Terminologie – Einstellungsgrößen, Kamerabewegungen, Lichtbeschreibungen – und übersetzt Text-Prompts mit hoher Wiedergabetreue in entsprechende visuelle Ergebnisse. Sie können „Medium Shot mit Dolly Zoom“, „Golden Hour Lighting“ oder „Dutch Angle“ spezifizieren und erwarten, dass das Modell diese Anweisungen präzise ausführt.

Dem Steuerungssystem fehlen jedoch einige der erweiterten Funktionen, die auf Konkurrenzplattformen verfügbar sind. Runways Kamerasteuerung bietet granularere Bewegungsspezifikationen. Das Referenzsystem von Seedance 2.0 bietet eine unerreichte kompositorische Kontrolle, wenn Sie spezifische visuelle Materialien replizieren müssen. Für die unkomplizierte Generierung aus Textbeschreibungen ist Kling 3.0 hervorragend; für hochspezifische visuelle Anforderungen mit komplexen Referenzmaterialien bieten andere Plattformen möglicherweise eine bessere Kontrolle.

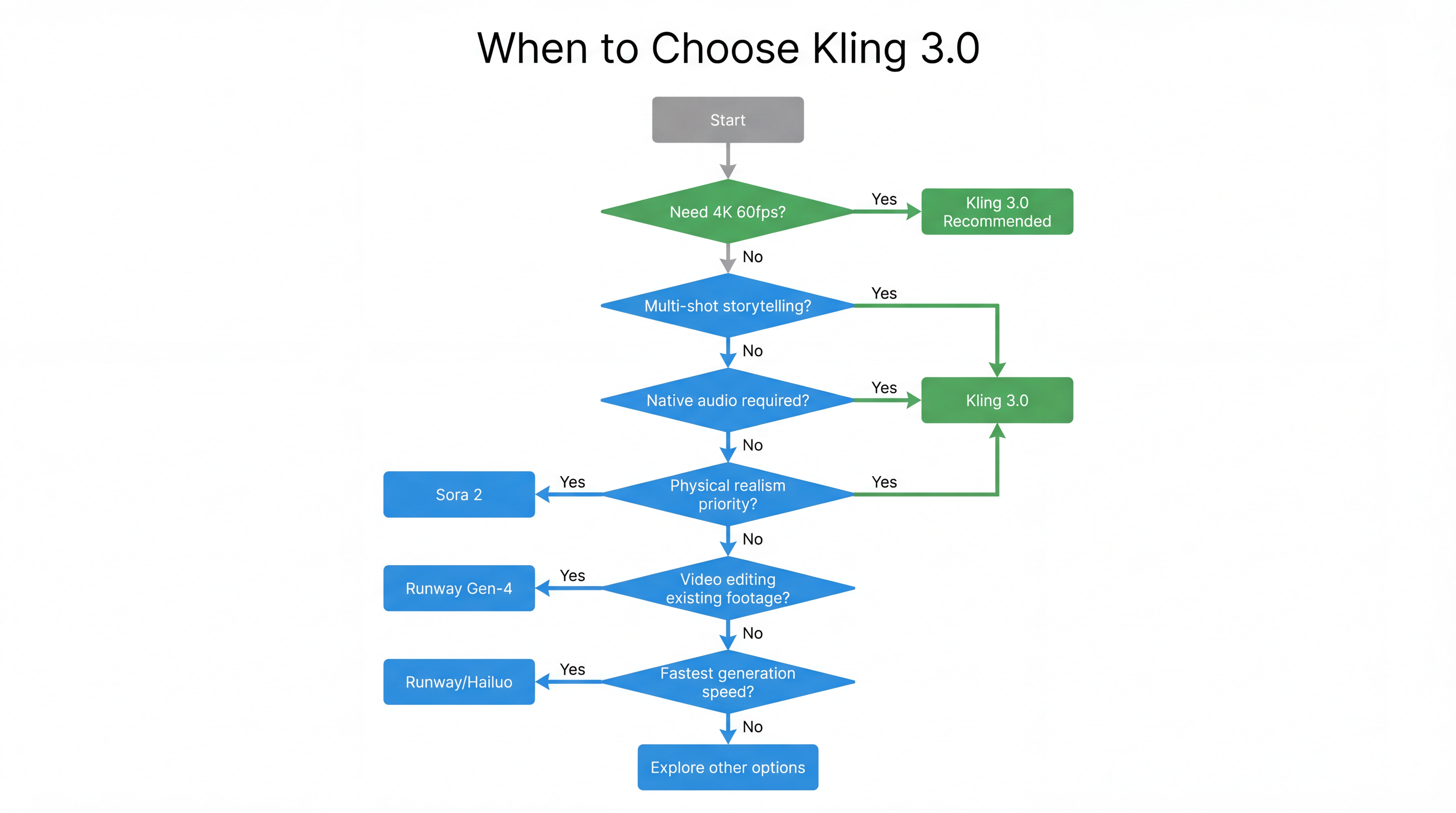

Anwendungsfälle: Wann Sie Kling 3.0 wählen sollten

Der optimale Workflow hängt von Ihren spezifischen Anforderungen ab. Kling 3.0 bedient bestimmte Anwendungsfälle außergewöhnlich gut, während in anderen Szenarien alternative Plattformen vorzuziehen sind.

Ideale Anwendungsfälle für Kling 3.0

Produktdemonstrationen und Werbespots: Die Kombination aus 4K-Auflösung, flüssiger 60fps-Bewegung und nativer Audiogenerierung macht Kling 3.0 außergewöhnlich für Produktpräsentationen. Sie können kinoreife Produktrotationen, Lifestyle-Szenarien mit Produkten im Einsatz und professionelle Werbespots ohne herkömmliche Produktionsausrüstung erstellen.

Social Media Content im großen Stil: Die Multi-Shot-Sequencing-Fähigkeit ermöglicht eine effiziente Batch-Produktion von Social-Media-Inhalten. Erstellen Sie sechs Variationen eines Konzepts mit unterschiedlichen Kamerawinkeln und wählen Sie die stärksten Ergebnisse aus. Die Geschwindigkeit und Konsistenz reduzieren die Iterationszyklen, die die KI-Videogenerierung früher für Content-Strategien mit hohem Volumen kostspielig machten.

Dialogbasierte narrative Inhalte: Für Erklärvideos, charaktergetriebene Shorts, Bildungsinhalte oder jede Produktion, die synchronisierte Sprache erfordert, beseitigt Kling 3.0 den Engpass in der Audioproduktion. Die integrierte Spracherzeugung und die Lip-Sync-Fähigkeiten liefern veröffentlichungsreife Inhalte ohne separate Aufnahmesessions.

Pre-Visualization und Storyboarding: Der Image Series Mode zielt speziell auf Pre-Production-Workflows ab. Generieren Sie Sequenzen von Aufnahmen mit konsistenten Charakteren und Umgebungen, um Szenen zu visualisieren, bevor Sie mit der eigentlichen Produktion beginnen. Diese Fähigkeit dient Filmemachern, Werbeagenturen und Content-Strategen, die schnelles visuelles Prototyping benötigen.

Wann man Alternativen in Betracht ziehen sollte

Maximaler physikalischer Realismus: Wenn Ihr Inhalt komplexe Physiksimulationen beinhaltet – Flüssigkeitsdynamik, Stoffverhalten, Zerstörungssequenzen – bleibt Sora 2 der Qualitätsmaßstab. Kling 3.0 bewältigt Standardbewegungen exzellent, stößt aber bei extremer physikalischer Komplexität gelegentlich an Grenzen.

Video-Editing und Inpainting: Für Workflows, die die Modifikation bestehender Aufnahmen beinhalten – Hintergrundersetzung, Objektentfernung, Stiltransfer auf gefilmtem Video –, bietet Runway Gen-4 Turbo überlegene editierorientierte Funktionen. Kling 3.0 bietet grundlegende Video-to-Video-Fähigkeiten, erreicht aber nicht die Tiefe des Editing-Ökosystems von Runway.

Referenzbasierte Komposition: Wenn Sie spezifische Bewegungsstile, visuelle Vorlagen oder komplexe Multi-Element-Referenzen haben, die präzise repliziert werden müssen, bietet das Referenzsystem von Seedance 2.0 eine kompositorische Kontrolle, die über die Fähigkeiten von Kling 3.0 hinausgeht.

Preisgestaltung und Zugangsmodelle

Das Verständnis der Kostenstruktur hilft dabei, festzustellen, ob Kling 3.0 in Ihr Budget und Produktionsvolumen passt.

Direkter Kling-Zugang

Kling AI arbeitet mit einem creditbasierten System, bei dem die Generierungskosten mit den Output-Parametern skalieren:

-

Standard-Tier: Etwa 0,12–0,15 $ pro Sekunde generiertem Video. Ein 5-sekündiger Clip kostet etwa 0,60–0,75 $, während eine maximale Generierung von 15 Sekunden etwa 1,80–2,25 $ kostet.

-

Pro Plan: 89 $/Monat bietet vollen 4K/60fps-Zugriff, wasserzeichenfreie Exporte und Priorität in der Generierungswarteschlange. Diese Stufe eignet sich für professionelle Ersteller mit konsistentem Produktionsbedarf.

-

Master Mode: Höhere Credit-Kosten pro Generierung, liefert aber die qualitativ hochwertigsten Ergebnisse mit einer Nutzbarkeitsrate von ca. 85 % gegenüber 72 % in der Standard-Stufe.

Die Generierungszeit variiert je nach Stufe: Die Standard-Stufe verarbeitet einen 10-sekündigen Clip in etwa 90 Sekunden, während die Priorisierung im Pro Plan dies weiter verkürzt. Der Master Mode kann mehr als 3 Minuten pro Generierung dauern, liefert aber eine sichtlich überlegene Konsistenz und weniger Artefakte.

Multi-Plattform-Zugang über Seedance AI

Für Kreative, die Zugang zu mehreren KI-Modellen über Kling 3.0 hinaus benötigen, bieten Plattformen wie Seedance AI einen einheitlichen Zugang zu Kling 3.0 neben Sora 2, Veo 3.1, Runway Gen-4 Turbo, Midjourney, Flux 2 und über 40 weiteren Modellen unter einem einzigen Credit-System.

Dieser Multi-Modell-Ansatz erweist sich als wertvoll für Produktions-Workflows, die vom Modell-Routing profitieren – Kling 3.0 für 4K-Dialoginhalte, Runway für Bearbeitungsaufgaben und Sora 2 für physikintensive Sequenzen. Anstatt separate Abonnements und Credit-Guthaben auf mehreren Plattformen zu verwalten, vereinfacht der einheitliche Zugang sowohl die Budgetierung als auch das Workflow-Management.

Die Möglichkeit, die Ergebnisse verschiedener Modelle für denselben Prompt zu vergleichen, beschleunigt zudem die Iteration. Generieren Sie ein Konzept gleichzeitig in Kling 3.0, Sora 2 und Veo 3.1 und wählen Sie dann das stärkste Ergebnis aus, ohne die Plattform wechseln oder mehrere Interfaces verwalten zu müssen.

Best Practices für Kling 3.0 Workflows

Um die Output-Qualität zu maximieren, muss man verstehen, wie man Prompts erstellt und Generierungsanfragen für diese spezifische Modellarchitektur strukturiert.

Prompt Engineering für Kling 3.0

Das Modell reagiert besonders gut auf filmsprachliche Begriffe. Geben Sie Einstellungsgrößen explizit an – „Extreme Close-up“, „Medium Shot“, „Wide Establishing Shot“ – anstatt sich darauf zu verlassen, dass das Modell den Bildausschnitt aus Szenenbeschreibungen ableitet. Kamerabewegungen sollten mit Standard-Filmterminologie beschrieben werden: „Dolly in“, „Crane up“, „Handheld Shake“, „Static Tripod“.

Geben Sie bei Inhalten mit Charakteren zuerst physische Beschreibungen an, bevor Sie den erzählerischen Kontext liefern. „Eine Frau in ihren 30ern mit schulterlangem braunem Haar, die einen dunkelblauen Blazer trägt und in einem modernen Büro steht“ erzeugt konsistentere Ergebnisse als „Eine Geschäftsfrau in ihrem Büro“, da das Modell die visuellen Attribute festlegt, bevor es die Szene generiert.

Geben Sie bei der Verwendung von Dialogen Tonfall, Tempo und Sprache pro Charakter an. Kurze, gezielte Sätze funktionieren besser als lange Monologe. Das Audiogenerierungssystem verarbeitet kurze Dialoge natürlicher als ausgedehnte Reden, die gelegentlich Ungenauigkeiten im Tempo aufweisen.

Nutzung des Multi-Shot-Modus

Strukturieren Sie Multi-Shot-Sequenzen als explizite Shot-Listen. Anstatt eine Szene erzählerisch zu beschreiben, unterteilen Sie sie in einzelne Aufnahmen mit festgelegter Dauer: „Aufnahme 1: Wide Establishing, 3 Sekunden. Aufnahme 2: Medium Shot Protagonist, 4 Sekunden. Aufnahme 3: Close-up Reaktion, 2 Sekunden.“ Dieser strukturierte Ansatz entspricht der Art und Weise, wie das MVL-Framework die sequentielle Generierung verarbeitet.

Verwenden Sie Charakter-Referenzbilder für alle Sequenzen mit wiederkehrenden Figuren. Laden Sie zu Beginn Ihrer Sitzung 2-3 Referenzwinkel jedes Charakters hoch und beziehen Sie sich in allen Aufnahmen konsistent auf diese Elemente. Dieser Workflow maximiert die Konsistenz, die das Element-Cloning-System bietet.

Verwaltung der Generierungskosten

Die Nutzbarkeitsrate von 85 % im Master Mode gegenüber 72 % in der Standard-Stufe bedeutet, dass der Master Mode trotz höherer Kosten pro Generierung für professionelle Workflows oft wirtschaftlicher ist. Wenn man die Regenerationszyklen berücksichtigt, die erforderlich sind, um nutzbare Ergebnisse zu erzielen, liefert die Premium-Stufe häufig niedrigere effektive Kosten pro finalem Clip.

Batch-verarbeiten Sie bei der Produktion großer Content-Mengen ähnliche Generierungsanfragen. Das System behält den Kontext über aufeinanderfolgende Generierungen bei, was die Konsistenz verbessert, wenn verwandte Prompts nacheinander verarbeitet werden, anstatt zwischen völlig unterschiedlichen Konzepten zu springen.

Einschränkungen und Überlegungen

Kein KI-Videomodell ist ohne Einschränkungen. Das Verständnis der Grenzen von Kling 3.0 hilft dabei, angemessene Erwartungen zu setzen und Reibungsverluste im Workflow zu vermeiden.

Content-Moderation und Verfügbarkeit

Kling AI unterliegt Content-Moderationsrichtlinien, die an die Vorschriften der chinesischen Regierung angepasst sind. Das System verhindert die Erstellung von Inhalten im Zusammenhang mit sensiblen politischen Themen, Protesten oder Regierungskritik. Für Kreative, die in den Bereichen Nachrichten, Dokumentation oder politisch nahen Feldern arbeiten, können diese Einschränkungen die Anwendbarkeit begrenzen.

Generierungs-Latenz

Obwohl es schneller ist als einige Wettbewerber, stellt die Generierungszeit von 3 Minuten im Kling 3.0 Pro Plan für hochwertige 15-Sekunden-Clips immer noch eine Workflow-Einschränkung dar. Echtzeit- oder echtzeitnahe Generierung ist weiterhin nicht verfügbar. Produktions-Workflows müssen die Latenz bei der Planung und in den Iterationszyklen berücksichtigen.

Einschränkungen bei der maximalen Dauer

Die maximale Dauer von 15 Sekunden ist zwar gegenüber früheren Versionen verlängert worden, schränkt aber die erzählerische Komplexität immer noch ein. Langform-Inhalte erfordern das Zusammenfügen mehrerer Generierungen mit den damit verbundenen Herausforderungen, die Konsistenz über die Grenzen hinweg zu wahren. Planen Sie bei 30-sekündigen Werbespots oder längeren Storytelling-Formaten Multi-Generierungs-Workflows ein und achten Sie besonders auf die Übergangspunkte.

Physische Interaktionsartefakte

Komplexe physische Interaktionen – insbesondere Umarmungen, Kämpfe oder enger Charakterkontakt – erzeugen gelegentlich „Schmelzartefakte“, bei denen Figuren verschmelzen oder sich deformieren. Obwohl dies gegenüber Kling 2.6 verbessert wurde, stellen diese Szenarien immer noch Grenzfälle dar, in denen die Generierungsqualität unter professionelle Standards fallen kann.

Das Fazit: Wo Kling 3.0 in Ihren Werkzeugkasten passt

Kling 3.0 etabliert einen neuen Maßstab für die reine KI-Videogenerierungsqualität. Der native 4K 60fps Output, die integrierte Audiogenerierung und die Multi-Shot-Sequencing-Fähigkeiten adressieren die drei bedeutendsten Einschränkungen, die KI-Video früher auf Spielereien beschränkten: Auflösung, Ton und erzählerische Kohärenz.

Für Kreative, die Wert auf Output-Qualität, sofortige Verfügbarkeit und optimierte Workflow-Effizienz legen, führt Kling 3.0 derzeit den Markt an. Die Vorteile in den Spezifikationen sind real und substanziell – 4K-Auflösung ist in professionellen Anzeigeumgebungen wirklich wichtig, 60fps eliminiert Bewegungsartefakte, die förmlich „KI-generiert“ schreien, und natives Audio entfernt eine ganze Produktionskategorie aus Ihrem Workflow.

Dennoch hängt das „beste“ KI-Videomodell ganz von Ihren spezifischen Anforderungen ab. Sora 2 bedient physiklastige Inhalte besser. Runway dominiert bei Video-Editing- und Postproduktions-Workflows. Veo 3.1 erreicht Klings Auflösung, unterliegt jedoch anderen Verfügbarkeitseinschränkungen.

Anspruchsvolle Produktions-Workflows nutzen zunehmend mehrere Modelle – Kling 3.0 für hochauflösende Dialoginhalte, Runway für Bearbeitungsaufgaben und Stiltransfer, Sora 2 für Physiksimulationen – und wählen für jede spezifische Aufgabe das optimale Tool aus, anstatt alle Arbeiten über eine einzige Plattform abzuwickeln.

Plattformen, die einen einheitlichen Zugang zu mehreren Modellen bieten, einschließlich Kling 3.0, ermöglichen diesen Multi-Modell-Workflow ohne den Aufwand, separate Konten, Credit-Guthaben und Interfaces bei verschiedenen Anbietern verwalten zu müssen.

Der Bereich der KI-Videogenerierung bewegt sich schnell. Die Benchmarks, die den Stand der Technik im Februar 2026 definieren, werden sich bis zur Jahresmitte wahrscheinlich verschoben haben. Aber die Kombination aus sofortiger Verfügbarkeit, professionellen Output-Spezifikationen und integrierten multimodalen Fähigkeiten macht Kling 3.0 zum aktuellen Standard für Ersteller, die heute produktionsreife KI-Videos benötigen – und nicht erst, wenn eine Warteliste abgearbeitet ist oder das nächste Update erscheint.

Ob Sie Social Media Content in großem Stil produzieren, Pre-Visualisierungen für traditionelle Produktionen erstellen oder komplett KI-generierte Film-Workflows erforschen – Kling 3.0 bietet Funktionen, die vor sechs Monaten schlichtweg nicht verfügbar waren. Dieses Tempo der Verbesserung zeigt keine Anzeichen einer Verlangsamung.