Если вы ищете полный гид по HappyHorse, реальная задача не в том, чтобы разобраться в маркетинговом обещании. Настоящая задача в том, чтобы отделить то, что публично видно, от того, что можно независимо подтвердить, а затем решить, является ли HappyHorse сейчас проектом, за которым стоит наблюдать, инструментом для тестов или основой, на которую уже можно опираться.

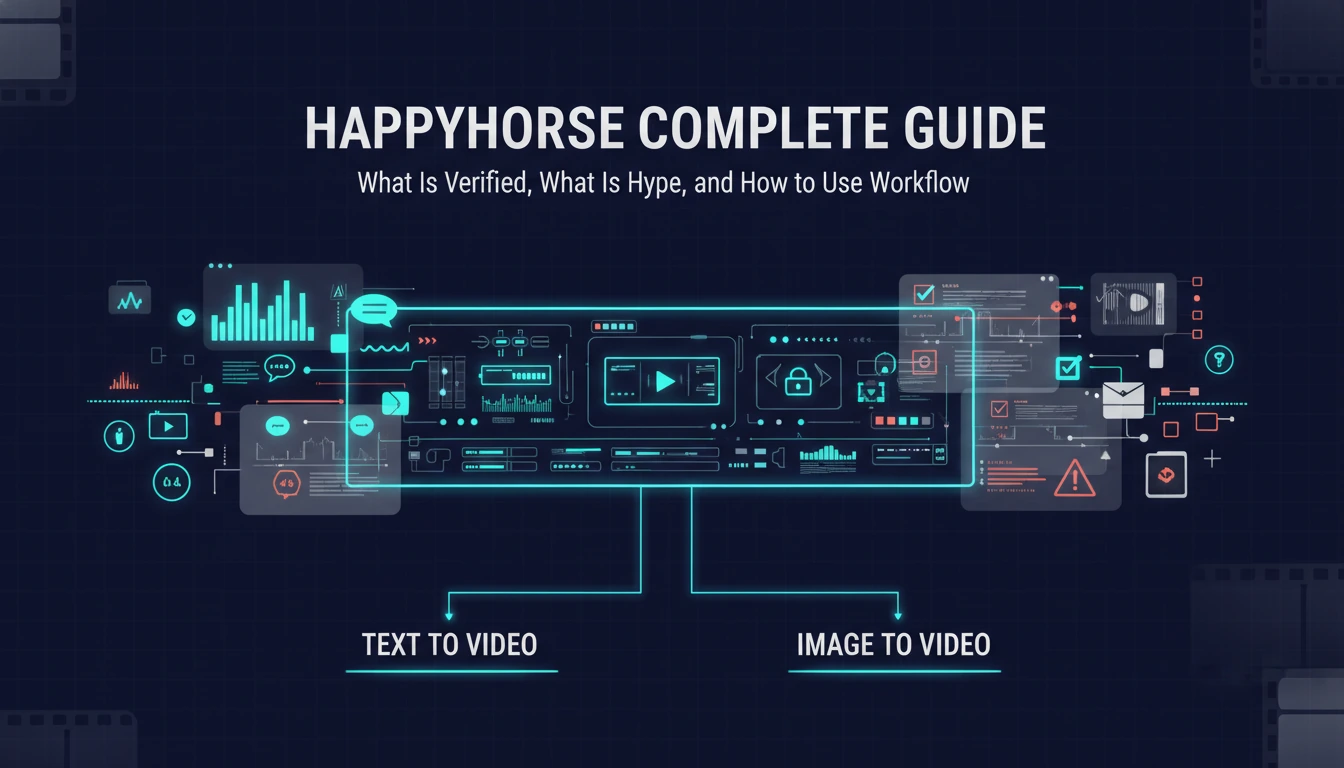

По состоянию на 8 апреля 2026 года публичные материалы HappyHorse рассказывают очень амбициозную историю. HappyHorse 1.0 описывается как open-source мультимодальная видеомодель с синхронизированным аудио, lip-sync на семи языках, выводом в 1080p, разрешением на коммерческое использование, поддержкой self-hosting и сильными benchmark-результатами. Это впечатляет. Но одновременно возникает и проблема верификации: публичный путь к коду сейчас нельзя проверить напрямую, а путь к хостингу модели, который показан в примерах deployment, также недоступен для проверки в состоянии без логина.

Это не означает автоматически, что HappyHorse фейк. Но это означает, что любые заявления нужно читать в правильной рамке: интересный проект, неполная публичная верификация и неясная готовность к продакшену. В этом гиде мы разберем, что выглядит реальным, что все еще требует доказательств, где HappyHorse потенциально наиболее уместен и почему, если вам нужен результат уже сейчас, практичный workflow text to video или workflow image to video чаще оказывается лучше ожидания.

Короткий ответ

HappyHorse выглядит как многообещающая концепция AI-видеомодели с сильным публичным позиционированием вокруг open weights, генерации аудио, lip-sync и self-hosting. Но текущих публичных доказательств все еще недостаточно, чтобы воспринимать каждый headline claim как полностью подтвержденную инфраструктуру, которую можно внедрять без риска.

Практически это можно свести к следующему:

| Вопрос | Практический ответ |

|---|---|

| HappyHorse интересен? | Да. Публичный набор функций необычно амбициозен для видеомодели, которая подается как открытая и self-hostable. |

| Это уже полностью проверенная публичная open model? | Пока нет. Путь к публичному репозиторию недоступен, а путь к модели на сайте нельзя открыть без авторизации. |

| Стоит ли ее игнорировать? | Нет. За проектом стоит следить, если вам интересна открытая мультимодальная генерация видео. |

| Стоит ли уже сейчас строить вокруг него контентный pipeline? | Только если вы готовы принять риск верификации и мириться с неполными публичными артефактами. |

| Что делать креаторам прямо сейчас? | Использовать надежный workflow text to video для prompt-driven генерации или workflow image to video для анимации от референса, пока HappyHorse не станет более зрелым. |

Главный вывод таков: сейчас HappyHorse выглядит скорее как проект с высоким потенциалом, который стоит отслеживать, а не как готовый фундамент для серьезного продакшена.

Что HappyHorse публично заявляет прямо сейчас

Текущие публичные материалы HappyHorse выглядят как довольно конкретная продуктовая история, а не как расплывчатый тизер. Среди видимых claims есть:

- модель на 15B параметров

- 40-слойная Transformer-архитектура

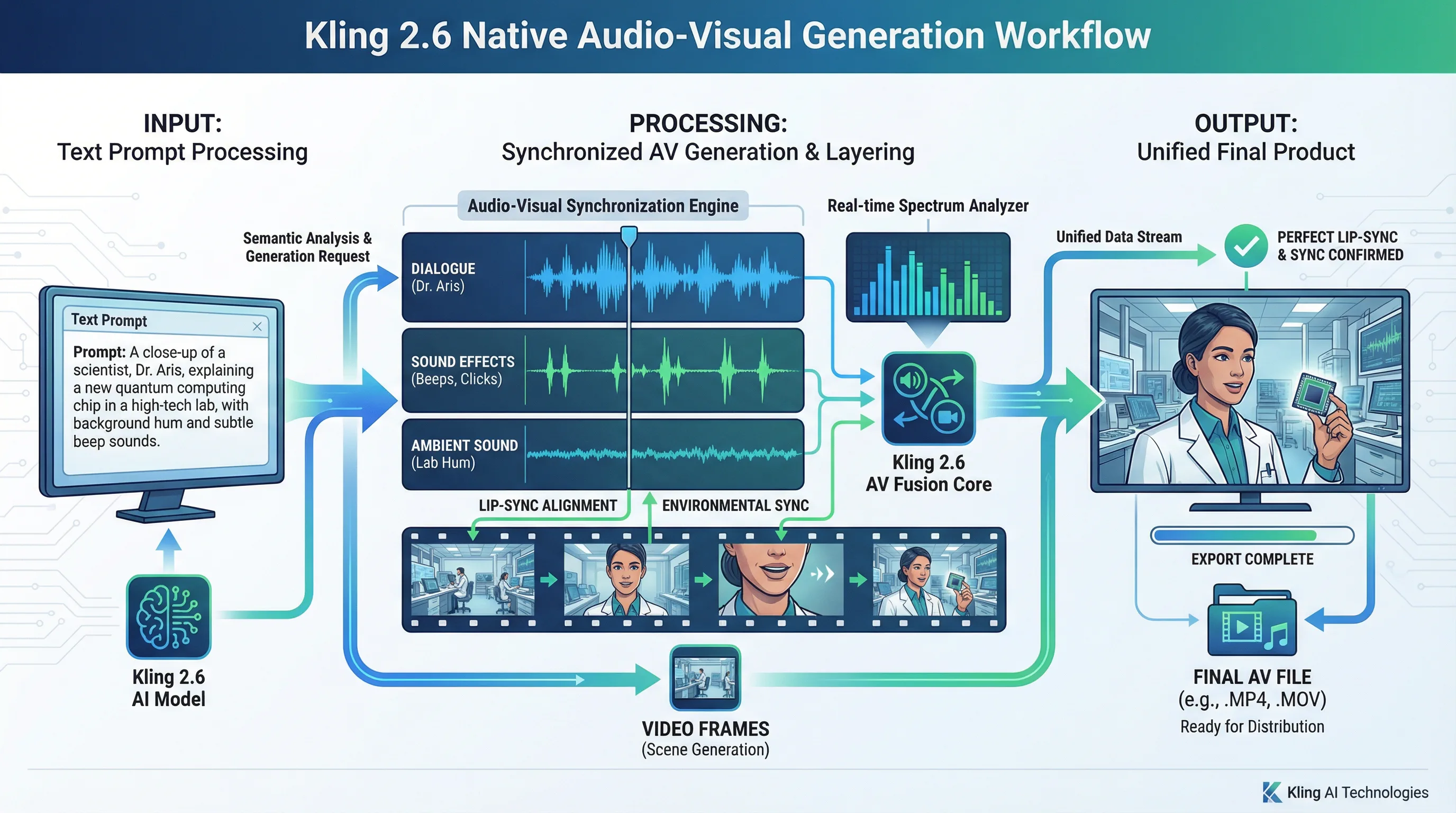

- совместная генерация видео и аудио

- поддержка текстовых и графических prompt

- lip-sync на семи языках

- вывод 1080p

- клипы по 5–8 секунд

- self-hosting на GPU класса H100 или A100

- open-source релиз с разрешением на коммерческое использование

- стартовая цена

$11.90

Это не стандартные формулировки landing page. Скорее это язык технического запуска модели, которую хотят показать серьезной и для креаторов, и для исследователей.

На сайте есть и более конкретные утверждения про производительность:

- около 38 секунд на 5-секундный клип 1080p на H100

- поддержка lip-sync для английского, мандаринского, кантонского, японского, корейского, немецкого и французского

- benchmark-преимущество над OVI 1.1 и LTX 2.3

- заявление о высоком месте в публичном leaderboard видеомоделей

На бумаге это очень привлекательный набор. Модель, которая совмещает text-to-video, image-to-video, синхронное аудио, многоязычный lip-sync и коммерчески пригодную openness, сразу выделяется. Проблема не в качестве истории. Проблема в разрыве между этой историей и теми публичными артефактами, к которым реально можно получить доступ сегодня.

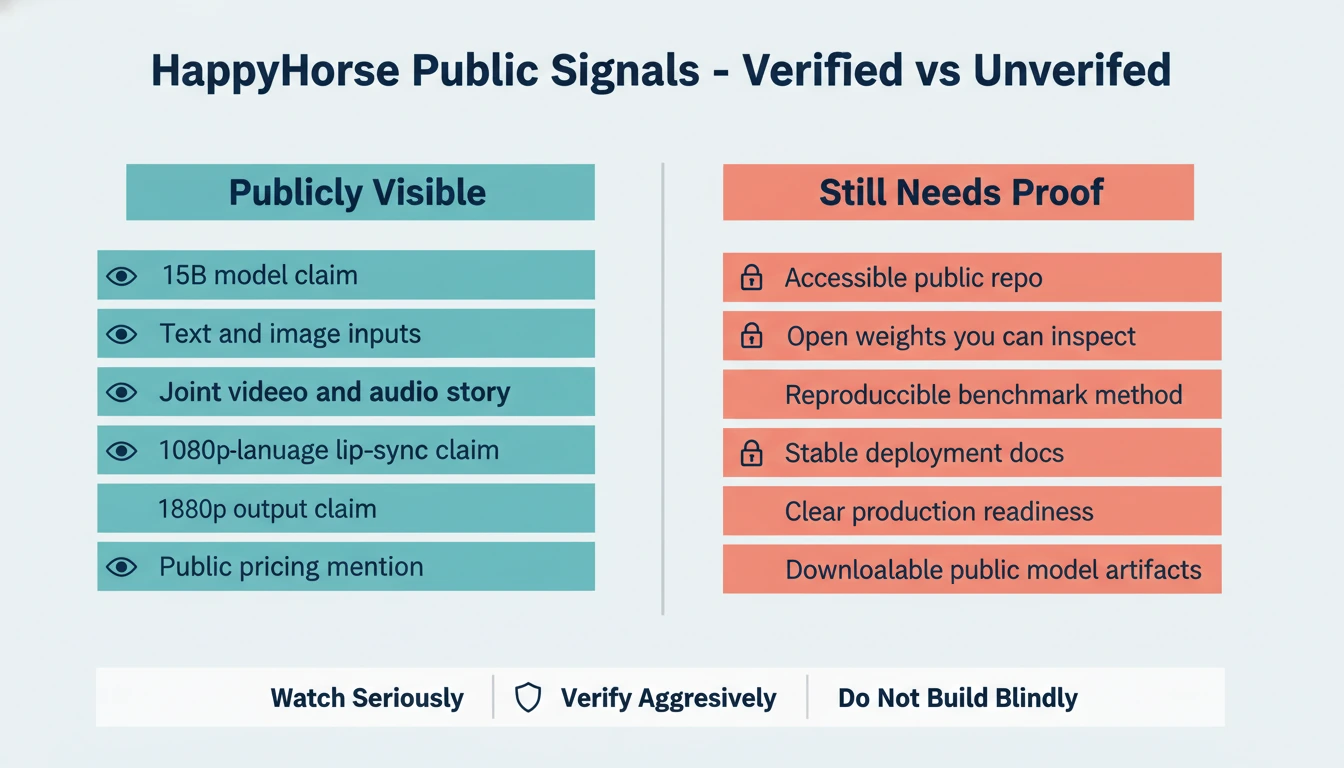

Что действительно подтверждено, а что все еще требует доказательств

Самый полезный способ смотреть на HappyHorse сейчас — делить публичную информацию на две группы: то, что можно наблюдать напрямую, и то, что пока требует независимого подтверждения.

| Статус | Что сюда относится | Почему |

|---|---|---|

| Публично видно | Feature-claims на сайте, упоминание цены, примеры deployment, benchmark-таблицы, sample-видео | Все это напрямую видно на текущем сайте и может быть проверено как опубликованные заявления. |

| Недостаточно независимо подтверждено | Доступность open source, публичные weights, self-hostable codebase, воспроизводимая benchmark-методика, production-readiness | Указанный путь к репозиторию недоступен, а путь к модели не открыт без аутентификации. |

Это разделение важно, потому что креаторы часто смешивают два разных вопроса.

Первый вопрос:

- Насколько проект подает цельную и технически правдоподобную продуктовую историю?

Второй вопрос:

- Могу ли я уже сегодня независимо проверить, скачать, воспроизвести и использовать это сам?

Сейчас HappyHorse сильнее отвечает на первый вопрос, чем на второй.

Это не делает проект бессмысленным. Это просто меняет правильное действие. Если вы исследователь или внимательно следите за новой инфраструктурой, его имеет смысл отслеживать. Если вы креатор с дедлайнами, логичнее продолжать выпускаться с инструментами, которые уже надежно работают.

Почему HappyHorse привлекает внимание

HappyHorse привлекает внимание, потому что собирает в одном пакете сразу несколько вещей, которые нужны креаторам:

- открытое или хотя бы open-leaning позиционирование

- мультимодальную генерацию вместо немого видео

- lip-sync на нескольких языках

- нарратив про self-hosting вместо чистой SaaS-зависимости

- benchmark-подачу, которая намекает на конкуренцию с известными open video проектами

Эта смесь попадает прямо в текущее напряжение рынка. Многим креаторам нужны качественные улучшения новых видеосистем, но они не хотят застревать внутри закрытых инструментов, нестабильных региональных rollout или ценовых моделей, завязанных на одну поверхность. HappyHorse говорит именно об этом желании.

Есть и вторая причина, почему о нем заговорили: проект описывает workflow, который звучит почти как законченный операционный стек. Многие страницы видеомоделей все еще заставляют собирать цепочку вручную. Видео генерируете в одном месте. Голос добавляете в другом. Lip-sync чините где-то еще. Upscale делаете позже. Тайминг правите руками. HappyHorse обещает более интегрированный путь.

Именно поэтому проект кажется важным еще до того, как его публичная верификация догонит собственный нарратив. Он указывает на тот workflow, который креаторы действительно хотят получить.

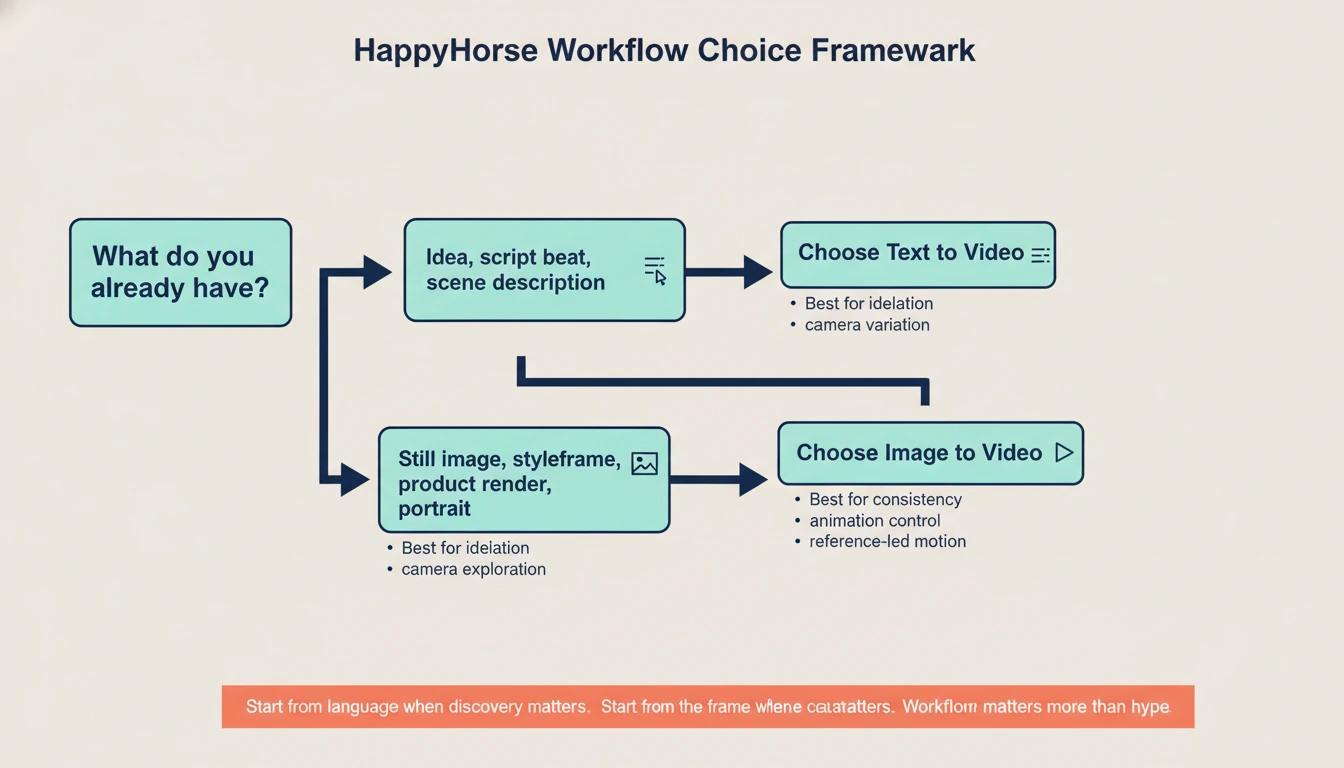

Главный вопрос workflow: Text to Video или Image to Video?

Даже если однажды HappyHorse выполнит все свои публичные обещания, большинству креаторов все равно придется отвечать на тот же базовый вопрос: вы начинаете с языка или с кадра?

Этот выбор важнее, чем название модели.

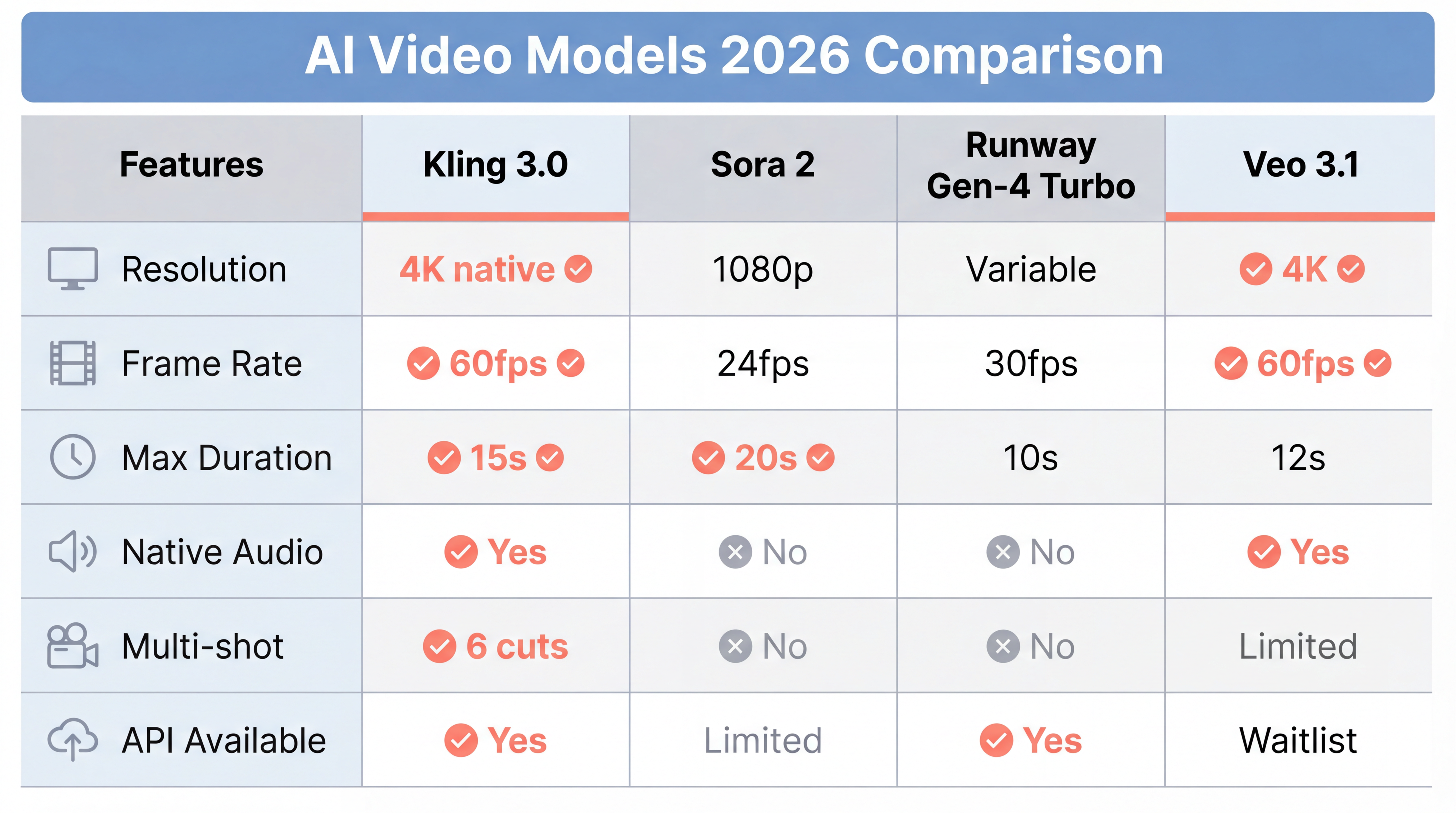

| Workflow | Лучший старт | Что дает | Основая слабость |

|---|---|---|---|

| Text to video | У вас есть идея, описание сцены, beat сценария или указание камеры, но еще нет фиксированного keyframe | Быстрее ideation, проще концептуальный поиск, больше вариативности от prompt | Композиция легче расползается, если у вас очень конкретная картинка в голове |

| Image to video | У вас уже есть still image, кадр персонажа, product render, storyboard frame или hero shot | Лучшая консистентность объекта, более точный art direction, проще анимировать уже утвержденный визуал | Меньше свободы для крупных смен сцены, если исходный кадр слабый |

Именно здесь многие начинают путаться, когда гонятся за запуском новой модели. Им начинает казаться, что новая модель и есть workflow. Это не так. Workflow по-прежнему начинается с того creative asset, который у вас уже есть.

Используйте text to video, когда:

- вы быстро перебираете несколько идей сцен

- вам нужны разные варианты камеры от одной письменной концепции

- вы еще ищете визуальное направление

- вы хотите сначала покрутить mood, action или narrative beat, прежде чем фиксировать кадр

Используйте image to video, когда:

- у вас уже есть сильная статичная картинка

- нужно удерживать персонажа, продукт или композицию близко к референсу

- вы анимируете key visual, рекламный визуал, портрет или storyboard panel

- визуальная консистентность важнее, чем открытая исследовательская свобода

Возможно, со временем HappyHorse поддержит оба пути в рамках одной экосистемы. Для большинства креаторов это не изменит дерево решений — изменится только модель, которая его исполняет.

Где HappyHorse выглядит сильнее всего на бумаге

Если публичное позиционирование хотя бы в целом соответствует реальности, то HappyHorse особенно интересен в нескольких сценариях.

1. Короткое видео, построенное на диалоге

Совместная генерация видео и аудио плюс многоязычный lip-sync — это самый заметный элемент всего набора. Если эти функции работают на уровне, который подразумевает сайт, HappyHorse будет куда интереснее, чем очередной генератор немых клипов с красивыми benchmark-графиками.

Это важно для:

- talking avatar контента

- коротких explainers

- многоязычных creator-видео

- product intro с речью в кадре

- social-контента, где ключевую роль играет диалог

2. Открытые или self-hosted эксперименты

Многим командам нужен не просто хороший output. Им нужна инфраструктура, которую можно inspect, tune, benchmark и, возможно, развернуть на собственных GPU. Именно поэтому open-source угол так важен.

Если HappyHorse действительно выпустит usable weights, inference code и distillation options, он станет важен не только для креаторов, но и для:

- applied AI-команд

- исследовательских групп

- студий с privacy-ограничениями

- компаний, которые тестируют внутренние media-pipeline

3. Более сильный стиль-контроль в image-to-video

Проект заявляет поддержку text и image input. На практике модели, которые умеют image-driven генерацию, часто гораздо полезнее в коммерческой работе, чем чисто текстовые системы, потому что image-first workflow проще контролировать.

Поэтому еще до полной верификации HappyHorse имеет смысл проверить собственный процесс через workflow image to video. Если ваша production logic строится вокруг утвержденных still, styleframe, product art или character reference, анимация от изображения — более переносимый workflow.

Где текущая публичная история выглядит хрупко

Это часть, которую многие launch-статьи предпочитают пропускать. Слабости здесь не обязательно модельные. Это слабости доверия и операбельности.

Несоответствие между нарративом и публичными артефактами

Текущие публичные материалы говорят с уверенностью полностью запущенного технического продукта. Публичный путь к репозиторию эту уверенность не поддерживает. Если проект хочет продавать себя через open-source credibility, доступные артефакты не могут быть необязательными.

Разрыв доверия к benchmark

Benchmark-таблицы легко опубликовать. Воспроизводимые детали оценки — гораздо сложнее. Пока нет clearly inspectable report, стабильного доступа к коду или маршрута стороннего воспроизведения, benchmark-числа стоит считать направляющими claims, а не окончательно установленными фактами.

Неясная готовность к продакшену

Модель может быть реальной, впечатляющей и при этом не готовой к надежной продакшен-эксплуатации. Команды с дедлайнами смотрят на:

- стабильный доступ

- задокументированные failure mode

- предсказуемый rate

- воспроизводимые окружения

- видимый cadence обновлений

Сейчас HappyHorse не раскрывает достаточно публичной операционной поверхности, чтобы уверенно получать высокую оценку по этим пунктам.

Что креаторам делать прямо сейчас

Если вам любопытен HappyHorse, лучший шаг — не спорить о том, переоценен он или недооценен. Лучший шаг — уже сейчас снизить риск своего workflow.

Используйте такую таблицу решений:

| Ваша ситуация | Лучшее действие сейчас |

|---|---|

| Вам прежде всего нужна концептуальная разведка от prompt | Стройте процесс вокруг надежного workflow text to video, а HappyHorse держите в watchlist |

| У вас уже есть concept frame, product still или portrait | Стройте процесс вокруг image to video и тестируйте новые модели только если они дают лучшую консистентность |

| Открытая инфраструктура важнее, чем публикация в краткосроке | Внимательно следите за HappyHorse и ждите доступных весов, кода и воспроизводимой документации |

| Вам нужны publishable assets уже на этой неделе | Не завязывайте контентный календарь на модель с неполной публичной верификацией |

Именно такого практического взгляда часто не хватает в launch-обзорах. Вам не нужно решать, будущее ли это. Вам нужно понять, что поможет вам выпускаться сегодня, не закрывая дверь для лучших инструментов завтра.

Где следить за публичным покрытием HappyHorse

Если вы хотите видеть, как проект появляется в публичных каталогах и на страницах в духе запусков, полезно следить за двумя ориентирами: HappyHorse AI и видеомоделью HappyHorse. Воспринимайте их как точки обнаружения, а не как замену проверяемому коду, стабильным весам и воспроизводимым артефактам развертывания.

Как лучше оценивать HappyHorse, когда появится больше публичных артефактов

Когда HappyHorse раскроет больше публичной инфраструктуры, важнее всего будут такие тесты:

- Может ли пользователь без логина без тупиков дойти до настоящего репозитория, документации и страницы модели?

- Согласованы ли веса, скрипты инференса и инструкции по развертыванию на всех публичных поверхностях?

- Насколько text-to-video путь действительно следует кинематографичным промптам на полезном уровне консистентности?

- Сохраняет ли image-to-video путь subject и composition при добавлении движения?

- Действительно ли synchronized audio usable, или все еще требует серьезного cleanup?

- Видны ли claims про многоязычный lip-sync в публичных demo, а не только в отобранных сниппетах?

- Может ли creator или engineer воспроизвести заявленную performance на раскрытом hardware?

Пока на эти вопросы нет ответов, правильная позиция — informed interest, а не blind adoption.

FAQ

HappyHorse уже open source?

Публично HappyHorse подается как open source с разрешением на коммерческое использование, но текущий путь к публичному репозиторию недоступен при прямой проверке. Сам claim виден. Публичная цепочка артефактов пока не замкнута.

HappyHorse — это text-to-video или image-to-video?

Текущий публичный сайт подает его как и то и другое. Это одна из причин внимания к проекту. Но полезнее спрашивать, какой workflow соответствует вашим входным данным сейчас: text to video для prompt-led ideation или image to video для reference-led animation.

HappyHorse готов к продакшену?

В будущем он может стать релевантным для продакшена, но нынешний уровень публичной верификации слишком слаб, чтобы рекомендовать его как центр deadline-sensitive pipeline.

Почему так много людей следят за HappyHorse?

Потому что он объединяет open-model позиционирование с synchronized audio, многоязычным lip-sync и входом как через text, так и через image. Это куда более привлекательная workflow-история, чем еще одна немая видеомодель с одним benchmark-скриншотом.

Что использовать, пока HappyHorse развивается?

Держитесь workflow-first подхода. Начинайте с text to video, когда сцена все еще живет от prompt, и используйте image to video, когда у вас уже есть кадр, который нужно оживить.

Финальный вердикт

HappyHorse заслуживает внимания, но не слепого доверия. Публичная история проекта достаточно сильна, чтобы за ней серьезно следить, и достаточно слаба, чтобы агрессивно требовать проверки.

Если модель действительно подтвердит свои публичные claims стабильными артефактами, она может стать одним из самых интересных open video проектов на рынке. До тех пор креаторам не стоит превращать восторг от launch page в продакшен-зависимость. Стройте работу на workflow, которые уже помогают вам выпускаться сейчас, держите высокую планку оценки и относитесь к HappyHorse как к многообещающему проекту, которому еще предстоит закрыть свой proof gap.