O vídeo com IA está avançando muito rápido, e o Veo 3.1 já dá sinais concretos do próximo passo do Google. Com avanços em image-to-video, áudio nativo e controle de câmera, o Veo 4 virou um dos lançamentos mais observados do setor.

No momento em que este artigo foi escrito, o Google ainda não havia anunciado o Veo 4 oficialmente. Mesmo assim, a direção do produto já está relativamente clara. A partir das capacidades atuais do Veo, do movimento do mercado e dos gargalos que criadores ainda enfrentam em fluxos reais de produção, este guia explora o que o Veo 4 pode trazer e por que isso importa para criadores, equipes de marketing e desenvolvedores.

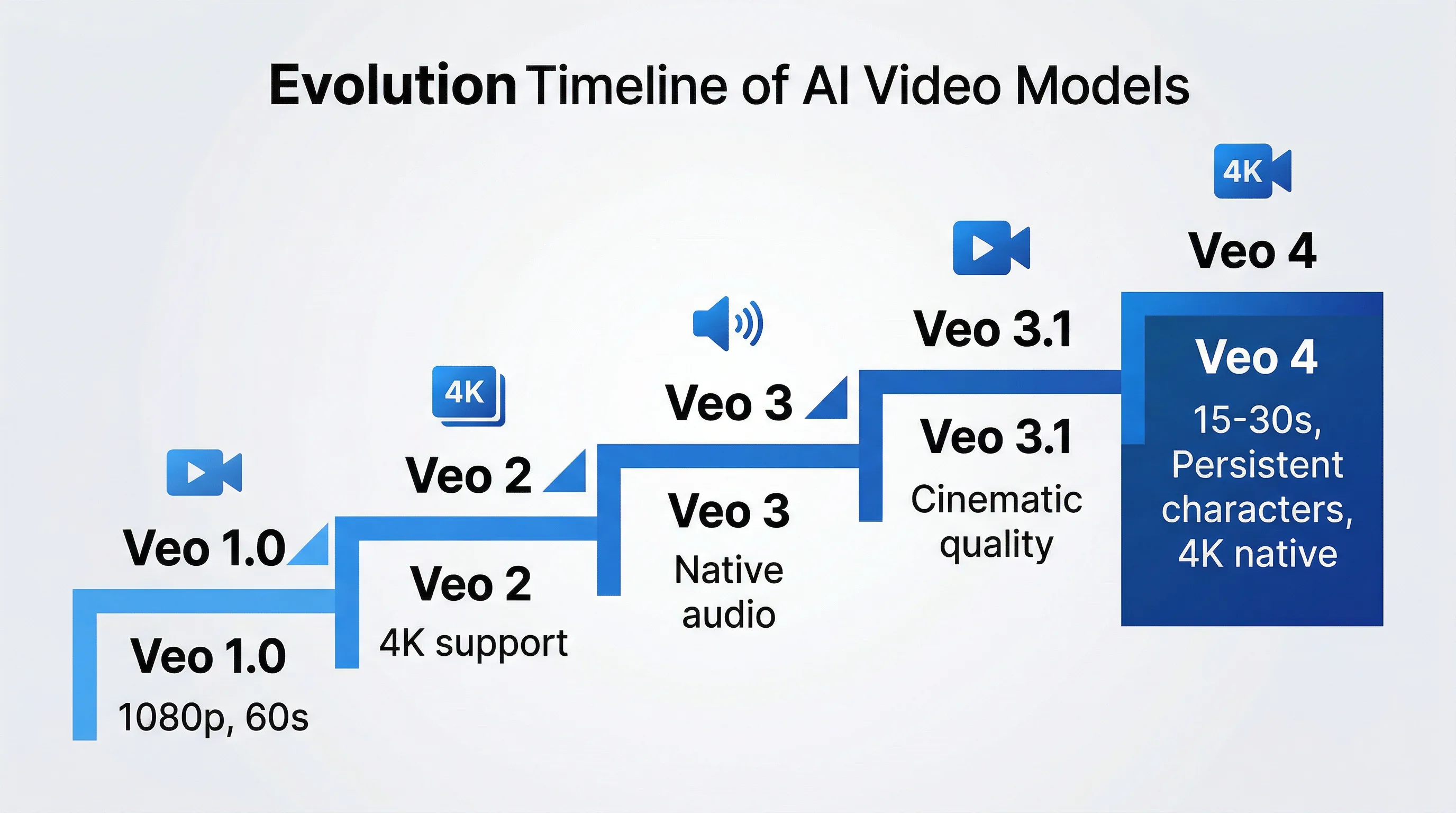

Entendendo a linhagem do Veo: de Veo 1.0 a Veo 3.1

Para entender o que o Veo 4 pode representar, vale observar o padrão que o Google já estabeleceu. O Veo 1.0, anunciado no Google I/O 2024, marcou a primeira investida realmente séria da empresa em geração de vídeo a partir de texto, com foco em movimento cinematográfico e em saídas mais longas do que a maioria dos primeiros concorrentes conseguia entregar.

Depois disso, a velocidade de iteração aumentou. O Veo 2, lançado no fim de 2024, avançou em fidelidade visual e em física mais convincente. O Veo 3 adicionou geração de áudio nativo, reunindo diálogos sincronizados, efeitos sonoros e som ambiente dentro do mesmo workflow. Em seguida, o Veo 3.1 refinou a qualidade de imagem para vídeo, melhorou a estabilidade temporal e aproximou o modelo de uma saída realmente pronta para produção.

O Veo 3.1, atual carro-chefe da linha, entrega saída consistente em 1080p, suporta workflows nativos em 4K e produz movimentos de câmera com sensação mais cinematográfica do que a maioria dos geradores de vídeo com IA. Ele usa uma abordagem de Diffusion Transformer sobre patches espaço-temporais, o que significa que o vídeo é modelado como uma sequência contínua, e não como um conjunto de quadros desconectados. Essa decisão arquitetural ajuda a explicar por que a fidelidade de movimento e a consistência física costumam parecer superiores às de muitos sistemas rivais.

Os testes em uso real reforçam essa leitura. O Veo 3.1 frequentemente produz alguns dos melhores resultados de plano único da categoria, com menos artefatos de compressão, melhor aderência a prompts de câmera e mais estabilidade ao longo de toda a janela de geração. Hoje já é possível experimentar esse comportamento na experiência Veo 3.1 da Seedance AI, que dá aos criadores uma forma prática de avaliar como o modelo atual do Google se comporta antes de uma próxima geração.

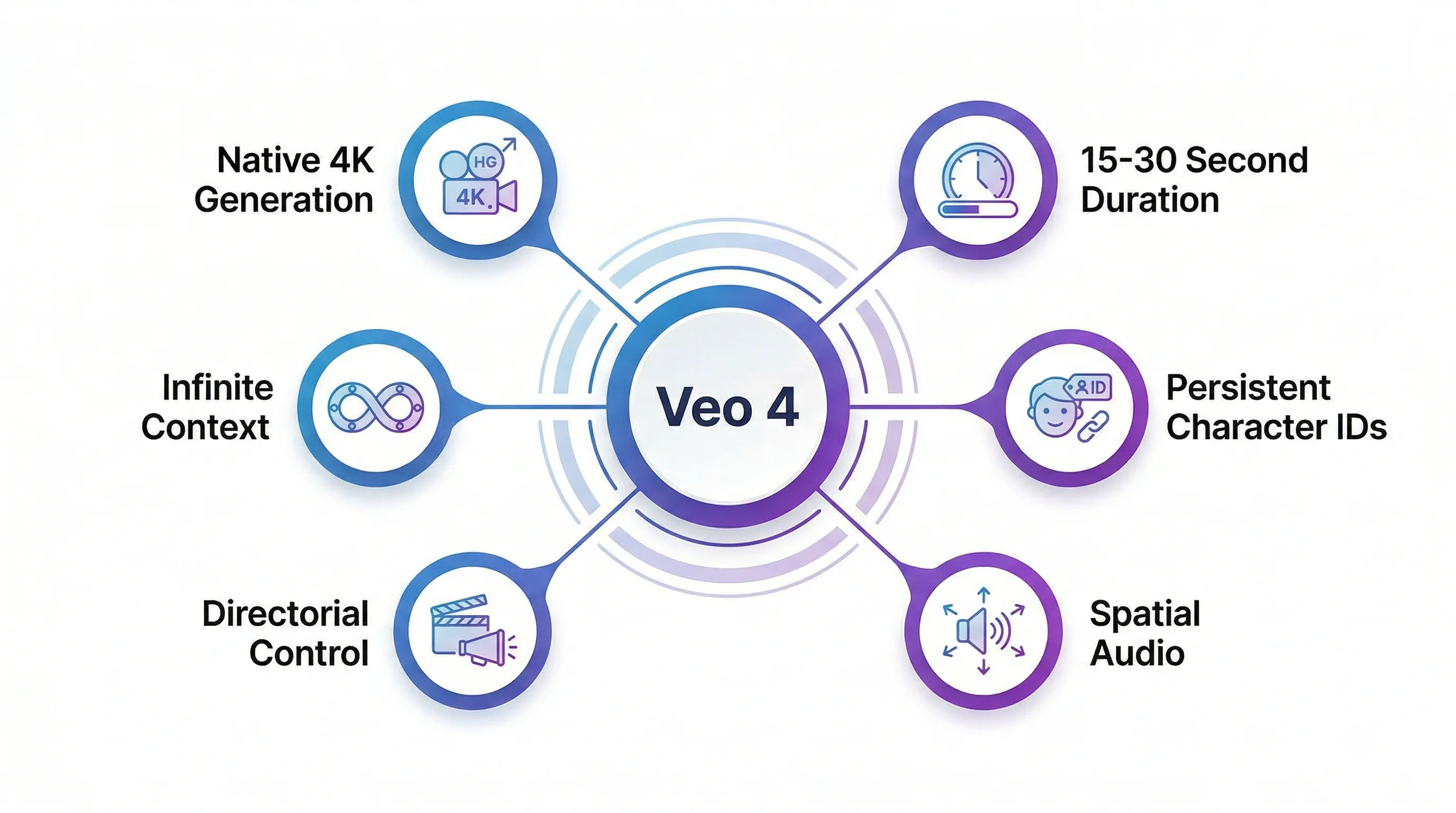

O que o Veo 4 deve entregar

Se observarmos as limitações atuais, a pressão competitiva do mercado e a própria trajetória do Google, tudo indica que o Veo 4 deve atacar os gargalos que ainda impedem o vídeo com IA de parecer totalmente nativo em produção profissional.

Duração maior com consistência temporal

O Veo 3.1 ainda está limitado a clipes curtos. Isso o torna útil para inserts cinematográficos, anúncios, conteúdo social e prototipagem rápida, mas obriga criadores narrativos a recorrer a edição pesada quando precisam de cenas mais longas. A expectativa mais razoável é que o Veo 4 leve a geração em uma única passada para algo entre 15 e 30 segundos sem sacrificar a continuidade do começo ao fim.

A consistência temporal continua sendo um dos problemas mais difíceis do vídeo com IA. Em modelos anteriores, era comum perder objetos no meio da tomada, ver detalhes de figurino variarem ou notar mudanças de iluminação que quebravam a imersão. Um Veo de nova geração deve preservar melhor a memória da cena para manter identidade de objetos, lógica espacial e aparência dos personagens ao longo de sequências maiores.

Geração nativa em 4K e fidelidade de microdetalhe

Embora o Veo 3.1 já seja competitivo em workflows de alta resolução, boa parte do mercado ainda depende de upscale. O 4K nativo importa porque determina se o material aguenta inspeção em telas grandes, placements premium e pipelines de entrega mais exigentes.

Se o Veo 4 avançar de verdade em geração nativa em 4K, o ganho principal não será apenas a contagem de pixels. O salto mais importante estará no microdetalhe: textura de pele, gotas d'água, reflexos, partículas ambientais e nuances de luz que pareçam intencionais, e não reconstruídas a partir de uma base mais suave.

Identidade persistente de personagens e sistemas de avatar

A consistência de personagem ainda é um dos maiores gargalos do vídeo com IA. A maioria dos modelos atuais consegue manter um sujeito estável dentro de um clipe curto, mas falha quando esse mesmo personagem precisa aparecer em várias cenas com o mesmo rosto, cabelo, voz e linguagem corporal.

O Veo 4 pode endereçar isso com algum tipo de memória persistente, tokens de identidade ou slots de avatar reutilizáveis. Se criadores puderem definir um personagem uma única vez e reaproveitá-lo em diferentes prompts e cenas, o vídeo com IA ficará muito mais próximo de storytelling seriado, porta-vozes de marca e campanhas reutilizáveis.

Controle de câmera mais avançado e precisão de direção

O Veo 3.1 já responde bem a prompts como "tracking shot", "dolly in" ou "golden hour backlight". A expectativa para o Veo 4 é que esse controle fique mais granular e caminhe de orientações via prompt para algo mais próximo de direção de plano.

Isso pode significar mudanças focais mais confiáveis, progressão de plano mais controlada, interpretação mais limpa de linguagem de lente e, futuramente, edição seletiva em trechos específicos sem regenerar o clipe inteiro. Para quem trabalha com produção audiovisual tradicional, essa mudança faria o vídeo com IA parecer menos uma aposta e mais uma ferramenta de direção.

Áudio espacial com inteligência de ambiente

O áudio nativo sincronizado foi uma das grandes evoluções do Veo 3. O Veo 4 pode ir além se melhorar a acústica espacial para que os ambientes não apenas combinem com a cena, mas também soem fisicamente plausíveis.

Isso significa diálogos que se comportam de modo diferente em um corredor e em um galpão, passos que mudam conforme o material do chão e som ambiente que evolui de forma natural conforme a câmera se desloca. Se o Google acertar esse ponto, um dos sinais mais evidentes de conteúdo gerado por IA começa a desaparecer.

Como o Veo 4 se compara à concorrência

O Veo 4 não vai surgir no vácuo. Qualquer lançamento futuro do Google terá de competir com modelos que já definem o topo do mercado de vídeo com IA.

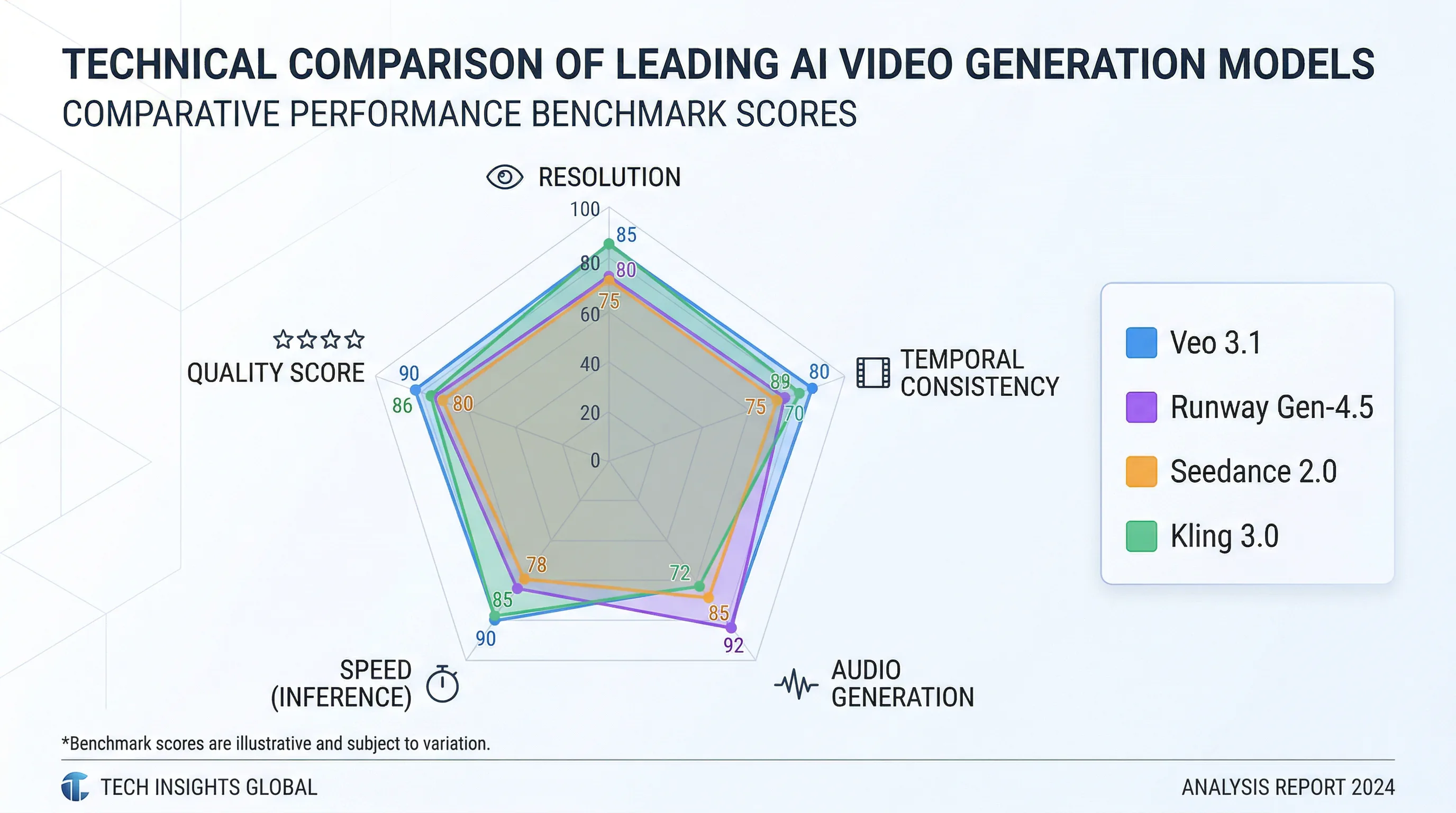

Desempenho em benchmarks e métricas de qualidade

Resumos recentes de benchmarks colocam o Runway Gen-4.5 entre os líderes da conversa sobre qualidade, com o Veo 3.1 logo atrás e o Seedance 2.0 também bem posicionado em rankings compostos. Esses rankings normalmente agregam fidelidade visual, suavidade de movimento, alinhamento ao prompt e consistência temporal em uma pontuação única.

Mas os números isolados contam apenas parte da história. Na prática, o Veo 3.1 se destaca em alguns pontos específicos:

- Cor e iluminação cinematográficas com boa consistência

- Realismo limpo em planos únicos

- Geração de áudio nativo dentro do mesmo workflow

- Melhor aparência em alta resolução do que muitos modelos que dependem fortemente de upscale

O Seedance 2.0, por sua vez, continua se destacando para muitos criadores na naturalidade do movimento. Personagens se movem com mais peso, timing mais convincente e mecânica corporal mais humana do que em boa parte dos rivais. O Runway segue forte em controle criativo e image-to-video. Já o Kling continua evoluindo em movimento de alta resolução e em saídas mais estilizadas.

| Modelo | Resolução | Duração | Áudio | Consistência temporal | Melhor caso de uso |

|---|---|---|---|---|---|

| Veo 3.1 | 4K nativo | 4-8 s | Nativo e sincronizado | Excelente | Conteúdo cinematográfico e profissional |

| Runway Gen-4.5 | 1080p (4K com upscale) | Variável | Externo | Muito boa | Image-to-video e controle criativo |

| Seedance 2.0 | Até 4K | 5-10 s | Externo | Excelente | Qualidade de movimento e fotorrealismo |

| Kling 3.0 | Ultra-HD | Variável | Externo | Boa | Animação de personagens e visual estilizado |

A vantagem do ecossistema

A vantagem estrutural do Google não está apenas na qualidade do modelo. Ela também está na integração de ecossistema. O Veo está posicionado para viver dentro de YouTube, Gemini, Workspace, Google Ads e APIs voltadas para desenvolvedores. Isso significa que o Google não precisa vencer transformando o Veo em um destino de consumo isolado. Ele pode vencer tornando o Veo útil exatamente onde criadores e equipes de marketing já trabalham.

O Google já integrou o Veo a workflows de publicidade. Equipes de marketing conseguem transformar ativos estáticos em criativos curtos de vídeo sem montar um processo de produção separado. Para desenvolvedores, o Veo 3.1 Lite já está disponível via Gemini API e Google AI Studio, o que mostra que a camada de infraestrutura necessária para expansão mais ampla já existe.

Essa vantagem de distribuição pesa bastante. As empresas de vídeo com IA que devem sobreviver no longo prazo não são necessariamente as que entregam a demo mais chamativa, mas sim as que combinam infraestrutura estável, integração prática em produto e uma economia de entrega sustentável.

Testes no mundo real: o que os criadores estão dizendo

O feedback vindo de ambientes de produção já deixa bem claras tanto as forças do Veo quanto as lacunas que um futuro Veo 4 precisará fechar.

Pontos fortes confirmados na prática

Criadores elogiam com frequência o realismo de plano único e a consistência quadro a quadro do Veo 3.1. Em testes com sujeitos dinâmicos, câmera em movimento e iluminação complexa, o Veo geralmente entrega planos mais íntegros do que vários concorrentes. Um padrão recorrente no feedback é que ele talvez não seja sempre o modelo mais expressivo, mas costuma ser um dos que saem mais prontos logo após a geração.

O workflow de áudio embutido também recebe avaliações muito positivas. Mesmo quando o som ainda não tem qualidade de mix final, ter um rascunho sincronizado acelera ideação, revisão e montagem preliminar de forma considerável. Isso é especialmente útil para desenvolvimento de conceito, testes criativos em anúncios e prototipagem narrativa.

Limitações que o Veo 4 precisa resolver

A janela curta de geração segue sendo a reclamação mais frequente. Quando a história precisa de mais respiro, os criadores ainda têm de contornar o teto de 8 segundos com stitching, mais edição e maior risco de quebra de continuidade.

A identidade de personagem entre múltiplos clipes também continua longe do ideal. O Veo 3.1 consegue manter a aparência com relativa consistência quando recebe boas referências, mas ainda não se comporta como um sistema de personagem persistente de verdade. Para storytelling de formato longo, essa diferença ainda pesa bastante.

Como se preparar para o Veo 4

Ainda não existe uma data oficial de lançamento do Veo 4, mas criadores e desenvolvedores já podem se preparar construindo habilidades e workflows que devem continuar válidos quando a próxima geração chegar.

Domine a engenharia de prompts da arquitetura atual do Veo

Os melhores trabalhos em vídeo com IA raramente nascem de um prompt milagroso. Na maior parte das vezes, eles são fruto de prompts estruturados, direção cuidadosa e uma compreensão clara de como o modelo interpreta linguagem de câmera, iluminação, ritmo e lógica de cena.

Usar os workflows atuais do Veo 3.1 na Seedance AI é uma das maneiras mais rápidas de desenvolver essa intuição. Vale testar como o modelo responde a pistas de movimento, mudanças focais, adjetivos de iluminação e imagens de referência. O que você aprender agora provavelmente será transferido quase diretamente para qualquer versão futura do Veo.

Pense em cenas, não em clipes isolados

Os melhores criadores de vídeo com IA já não pensam em saídas isoladas. Eles pensam em sequência, cobertura, continuidade e fluxo editorial. Mesmo antes da chegada do Veo 4, essa mudança de mentalidade já faz diferença.

Planeje listas de planos. Crie sistemas visuais. Reaproveite linguagem de câmera. Trate cada geração como parte de uma cena maior, e não como um clipe social independente. Quem internalizar essa lógica cedo tende a se beneficiar mais quando memória de modelo e duração avançarem.

Diversifique seu conjunto de ferramentas

A lição mais clara do mercado atual é que nenhum modelo vence em todas as categorias. Um workflow prático para 2026 pode combinar:

- Veo para qualidade cinematográfica e áudio nativo

- Seedance para naturalidade de movimento e experimentação multi-modelo

- Runway para tarefas de image-to-video com exigência de controle fino

- Kling para saídas estilizadas ou mais orientadas à animação

Plataformas como Seedance AI tornam essa estratégia viável ao permitir comparar modelos em um único lugar, sem assumir cedo demais uma dependência de fornecedor único.

Acompanhe canais oficiais para acesso antecipado

Se o Veo 4 seguir o padrão atual do Google, o acesso provavelmente vai se expandir por meio de uma combinação de programas preview, integrações em produto e rollouts por API, e não por um único momento dramático de lançamento.

Os melhores lugares para acompanhar esse movimento são:

- Anúncios do Google DeepMind

- Atualizações do Google AI Studio e da Gemini API

- Lançamentos de produto no YouTube e no Google Ads

- Flow e outras ferramentas criativas relacionadas do Google

O contexto mais amplo do mercado: por que o Veo 4 importa

O Veo 4 importa não apenas porque pode ser mais um lançamento forte, mas porque também pode sinalizar como será o estágio estável do vídeo com IA.

A economia do vídeo com IA

Vídeo com IA é caro do ponto de vista computacional. Os modelos que permanecem relevantes são os que combinam boa qualidade de saída com vantagens reais de infraestrutura e canais de distribuição compatíveis com esse custo. O Google está em posição privilegiada porque controla a nuvem, a estratégia de hardware e várias superfícies de alto volume onde geração de vídeo pode virar funcionalidade, e não aposta isolada.

Essa vantagem de infraestrutura é difícil de igualar para concorrentes menores. Se o Veo 4 melhorar de forma relevante e permanecer profundamente integrado ao ecossistema do Google, deslocá-lo ficará bem mais difícil.

O paradoxo da democratização

Se vídeo 4K de alta qualidade, áudio sincronizado e controle de direção consistente se tornarem acessíveis por texto e edição leve, a execução técnica deixa de ser o recurso mais escasso. Isso não reduz o valor do trabalho criativo. O valor migra para visão, repertório e capacidade de construir narrativa.

É o mesmo padrão que já apareceu em fotografia, design e publicação digital. Quando a execução se democratiza, o prêmio vai para quem sabe o que dizer, o que mostrar e por que aquilo importa.

A corrida pela integração

Os grandes vencedores da próxima fase da IA provavelmente não serão apps isolados de efeito wow. Serão empresas capazes de embutir modelos poderosos dentro de produtos que as pessoas já usam todos os dias.

É por isso que o Google importa tanto aqui. Um futuro Veo 4 integrado a ferramentas de criação do YouTube, workflows de anúncios, produtividade corporativa e APIs para desenvolvedores é estrategicamente muito mais forte do que um modelo que existe apenas como uma demo independente.

O que o Veo 4 significa para diferentes perfis de usuário

Criadores de conteúdo e YouTubers

Para criadores, maior duração por clipe e áudio mais robusto reduziriam o número de etapas de produção em explainers, shorts, B-roll e inserts narrativos. Se o Veo se tornar nativo nos workflows do YouTube, sequências geradas por IA podem deixar de ser curiosidade para virar infraestrutura criativa padrão.

Profissionais de marketing e publicidade

Equipes de marketing ganham principalmente com velocidade e variação. Já hoje é valioso transformar ativos estáticos em vários conceitos de vídeo testáveis. Com planos mais longos, melhor continuidade e áudio mais consistente, vídeo gerado por IA se torna muito mais viável para produção real de campanha, e não apenas para mockups rápidos.

Desenvolvedores e equipes de produto

O acesso por API é um ponto em que um futuro Veo 4 pode se tornar especialmente importante. Equipes de produto poderiam gerar demos, explainers educacionais, variantes localizadas de vídeo ou ativos personalizados diretamente dentro de aplicativos. A base já existe na Gemini API. Um modelo mais forte apenas amplia o que se torna prático construir.

Cineastas e estúdios

A produção tradicional não vai desaparecer, mas previsualização, storyboard, testes e certos tipos de footage gerado já caminham rapidamente para workflows assistidos por IA. Melhor persistência de personagem e maior controle de direção tornariam o Veo muito mais relevante para esse ambiente.

Tabela comparativa: recursos esperados do Veo 4 versus os líderes atuais

| Recurso | Veo 4 (esperado) | Veo 3.1 (atual) | Runway Gen-4.5 | Seedance 2.0 | Kling 3.0 |

|---|---|---|---|---|---|

| Duração máxima | 15-30 s | 4-8 s | Variável | 5-10 s | Variável |

| Resolução | 4K nativo | 4K nativo | 1080p (4K com upscale) | Até 4K | Ultra-HD |

| Áudio nativo | Inteligência espacial | Sincronizado | Externo | Externo | Externo |

| Consistência de personagem | IDs persistentes | Baseada em referência | Boa | Baseada em referência | Boa |

| Controle de câmera | Precisão de direção | Diretivas técnicas | Alto | Médio | Médio |

| Consistência temporal | Memória de cena expandida | Excelente (8 s) | Muito boa | Excelente | Boa |

| Velocidade de geração | Rápida (estimada) | Rápida | Moderada | Moderada | Rápida |

| Acesso por API | Gemini API | Gemini API | API disponível | Limitado | API disponível |

| Integração de ecossistema | YouTube, Ads, Workspace | Ads, Workspace | Independente | Independente | Independente |

| Melhor para | Uso profissional geral | Conteúdo cinematográfico | Controle criativo | Qualidade de movimento | Animação |

Como preparar seu workflow: passos práticos

1. Experimente as capacidades atuais do Veo

Teste workflows atuais do Veo 3.1 e documente o que acontece ao alterar prompts, referências, proporção ou linguagem de movimento. Esse entendimento prático vale mais do que muita especulação abstrata.

2. Monte uma biblioteca de prompts

Mantenha estruturas reutilizáveis de prompt para:

- Movimento de câmera

- Estilos de iluminação

- Enquadramento de personagens

- Planos de demonstração de produto

- Transições narrativas

- Atmosfera e pistas de som

Quando o Veo 4 chegar, essa biblioteca vira uma vantagem operacional concreta.

3. Desenvolva workflows multi-modelo

Não parta do pressuposto de que um único modelo deve fazer tudo. Entenda onde o Veo performa melhor em relação a Seedance, Kling e Runway, e distribua o trabalho de acordo. É assim que os criadores mais fortes já estão operando.

4. Invista em habilidades de pós-produção

A qualidade de geração está subindo, mas edição, ritmo, polimento de som e construção narrativa ainda separam trabalho bom de trabalho esquecível. Em vídeo com IA, não vence apenas quem escreve os prompts mais espertos, mas quem consegue transformar material bruto em comunicação acabada.

5. Acompanhe licenciamento e direitos com atenção

À medida que o vídeo gerado por IA ganha uso comercial, direitos, licenciamento e rastreabilidade se tornam ainda mais importantes. O SynthID do Google e abordagens semelhantes de marcação provavelmente terão cada vez mais peso.

O caminho adiante: previsões para 2026 e além

Algumas tendências já parecem bastante prováveis:

O Google deve continuar levando o Veo para dentro dos produtos, e não apenas para previews. O caminho mais estratégico parece ser aprofundar a integração com YouTube, Ads e Workspace, em vez de apostar somente em um destino isolado para consumidores.

Plataformas multi-modelo devem continuar ganhando espaço. Criadores não querem ficar presos a um único fornecedor quando as forças de cada modelo mudam tão rápido.

A qualidade bruta dos modelos tende a convergir. A diferença entre os sistemas de topo deve diminuir. Workflow, integração, eficiência de custo e ecossistema passarão a importar mais.

Consistência narrativa será a próxima fronteira real. Quando clipes curtos já parecem bons, o desafio passa a ser coerência em formato mais longo: personagens recorrentes, mundos estáveis e continuidade emocional.

Realismo de áudio se tornará um diferencial ainda mais importante. Um som espacial limpo e plausível pode fazer um vídeo deixar de parecer "bom conteúdo gerado por IA" e começar a soar pronto para produção.

Conclusão: por que o Veo 4 pode marcar um ponto de virada

O Veo 4 importa porque aponta para a próxima fase do vídeo com IA: clipes mais longos, mais limpos, mais controláveis e muito mais integrados às ferramentas que as pessoas já usam. Se o Google conseguir combinar os pontos fortes atuais do Veo em qualidade cinematográfica e áudio nativo com maior duração, memória persistente de personagem e controle de direção mais forte, o vídeo com IA ficará muito mais próximo de uma infraestrutura cotidiana de produção.

Para criadores, profissionais de marketing e desenvolvedores, a jogada estratégica não é esperar passivamente pelo próximo anúncio. É começar agora a construir workflows: testar modelos atuais, comparar saídas, organizar sistemas de prompt e desenvolver um processo de produção capaz de absorver ferramentas melhores assim que elas aparecerem.

O futuro da criação de vídeo não pertencerá simplesmente a quem tiver acesso ao melhor modelo. Ele pertencerá a quem souber transformar esse acesso em decisões criativas claras, iteração rápida e trabalho finalizado que realmente comunica alguma coisa.

Se você quiser se preparar desde já para o Veo 4, a Seedance AI oferece uma forma prática de comparar o Veo com outros modelos líderes, refinar prompts e montar um workflow pronto para a próxima geração.