Se você está procurando um guia completo sobre HappyHorse, o problema real não é entender o discurso de marketing. O problema real é separar o que está visível publicamente do que pode ser verificado de forma independente e, depois disso, decidir se o HappyHorse é algo para acompanhar, algo para testar ou algo em que dá para confiar hoje.

Em 8 de abril de 2026, os materiais públicos do HappyHorse contam uma história bastante ambiciosa. Eles apresentam o HappyHorse 1.0 como um modelo de vídeo multimodal open source com áudio sincronizado, lip-sync em sete idiomas, saída em 1080p, permissão para uso comercial, suporte a self-hosting e bons resultados de benchmark. É um pacote atraente. Mas isso também cria um problema imediato de verificação, porque o caminho público até o código não está acessível em uma checagem direta, e o caminho de hospedagem do modelo mostrado nos exemplos de deploy também não fica aberto em uma verificação deslogada.

Isso não significa automaticamente que o HappyHorse seja falso. Significa, sim, que você precisa ler cada promessa com a lente certa: projeto empolgante, verificação pública incompleta e prontidão para produção ainda pouco clara. Este guia mostra o que parece real, o que ainda precisa de prova, onde o HappyHorse parece mais relevante e por que, se você precisa de resultado agora, um workflow de text to video ou um workflow de image to video costuma ser uma escolha mais prática do que ficar esperando.

Resposta curta

O HappyHorse parece um conceito promissor de modelo de vídeo com uma narrativa pública forte em torno de pesos abertos, geração de áudio, lip-sync e self-hosting. Ainda assim, as evidências públicas disponíveis hoje não são fortes o bastante para tratar todos os headline claims como infraestrutura plenamente confirmada e pronta para adoção sem risco.

Aqui vai o resumo prático:

| Pergunta | Resposta prática |

|---|---|

| O HappyHorse é interessante? | Sim. O conjunto público de recursos é incomumente ambicioso para um modelo de vídeo posicionado como aberto e auto-hospedável. |

| Ele já está totalmente verificado como modelo aberto público? | Ainda não. O caminho do repositório público está indisponível, e o caminho do modelo mostrado no site não pode ser acessado sem login. |

| Devo ignorá-lo? | Não. Vale acompanhar se você se importa com geração de vídeo multimodal aberta. |

| Faz sentido montar hoje a pipeline de conteúdo em cima dele? | Só se você aceitar o risco de verificação e conseguir tolerar artefatos públicos incompletos. |

| O que os creators devem fazer agora? | Usar um workflow de text to video já confiável para geração guiada por prompt ou um workflow de image to video para animação guiada por referência enquanto o HappyHorse amadurece. |

Esse é o ponto central: hoje o HappyHorse parece mais um projeto de alto potencial para acompanhar do que uma base pronta para produção séria.

O que o HappyHorse afirma publicamente neste momento

Os materiais públicos atuais do HappyHorse contam uma história de produto relativamente específica, e não apenas uma teaser page vaga. Entre os claims visíveis estão:

- um modelo de 15B parâmetros

- uma arquitetura Transformer com 40 camadas

- geração conjunta de vídeo e áudio

- suporte a prompts de texto e imagem

- lip-sync em sete idiomas

- saída em 1080p

- clipes de 5 a 8 segundos

- self-hosting em GPUs da classe H100 ou A100

- release open source com permissão de uso comercial

- preço inicial de

$11.90

Essas não são frases genéricas de landing page. Elas soam como uma página de lançamento técnico para um modelo que quer ser levado a sério tanto por creators quanto por pesquisadores.

O site também apresenta claims mais concretos de desempenho, incluindo:

- cerca de 38 segundos para um clipe de 5 segundos em 1080p em H100

- suporte a lip-sync em inglês, mandarim, cantonês, japonês, coreano, alemão e francês

- vantagem em benchmark sobre OVI 1.1 e LTX 2.3

- uma alegação de topo em um leaderboard público de modelos de vídeo

No papel, esse pacote seria extremamente atraente. Um modelo que combine text-to-video, image-to-video, áudio sincronizado, lip-sync multilíngue e abertura amigável a uso comercial chamaria atenção imediatamente. O problema não é a história em si. O problema é a distância entre a história e os artefatos públicos realmente acessíveis hoje.

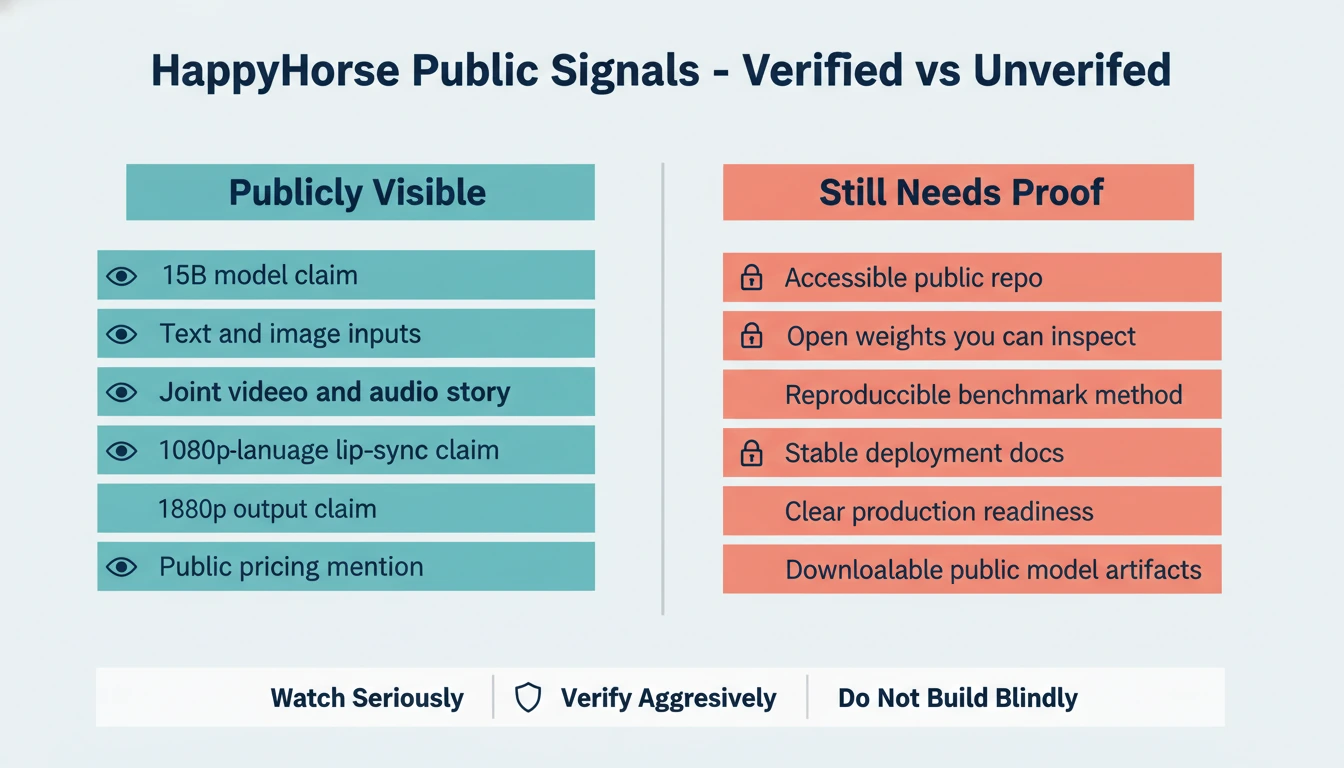

O que está realmente verificado e o que ainda precisa de prova

A maneira mais útil de analisar o HappyHorse hoje é dividir a informação pública em dois grupos: claims diretamente observáveis e claims que ainda precisam de confirmação independente.

| Status | O que entra aqui | Por que entra aqui |

|---|---|---|

| Publicamente visível | Claims de recursos no site, menção a preço, exemplos de deploy, tabelas de benchmark, vídeos de demonstração | Esses itens estão visíveis no site atual e podem ser inspecionados como claims publicados. |

| Ainda não confirmado de forma suficiente | Disponibilidade open source, pesos públicos, codebase auto-hospedável, metodologia reproduzível de benchmark, prontidão para produção | O caminho do repositório vinculado não está disponível, e o caminho de modelo referenciado não é acessível sem autenticação. |

Essa distinção importa porque muitos creators acabam comprimindo duas perguntas diferentes em uma só.

A primeira pergunta é:

- O projeto apresenta uma história coerente e tecnicamente plausível?

A segunda pergunta é:

- Eu consigo validar, baixar, reproduzir e operar isso sozinho hoje?

No momento, o HappyHorse responde melhor à primeira do que à segunda.

Isso não invalida o projeto. Só muda qual é a ação correta. Se você é pesquisador ou gosta de monitorar infraestrutura aberta de perto, faz sentido acompanhar. Se você é creator com deadline, o melhor é continuar produzindo com ferramentas que já entregam resultado de forma confiável.

Por que o HappyHorse está chamando atenção

O HappyHorse está chamando atenção porque junta várias coisas que os creators querem ao mesmo tempo:

- posicionamento aberto ou pelo menos próximo disso

- geração multimodal em vez de apenas vídeo mudo

- suporte a lip-sync em vários idiomas

- narrativa de self-hosting em vez de dependência total de SaaS

- framing de benchmark que sugere competitividade com esforços open conhecidos em vídeo

Essa combinação cai exatamente sobre a tensão atual do mercado. Muitos creators querem os ganhos de qualidade dos sistemas de vídeo mais novos, mas não querem ficar presos a ferramentas fechadas, rollouts regionais instáveis ou modelos de preço presos a uma única superfície. O HappyHorse fala diretamente com esse desejo.

Há também um segundo motivo para a repercussão: o projeto descreve um workflow que soa operacionalmente completo. Muitas páginas de modelo de vídeo ainda obrigam você a montar a stack por conta própria. Gera o vídeo em um lugar. Adiciona voz em outro. Corrige o lip-sync em outro. Faz upscale depois. Acerta o timing na mão. O HappyHorse promete um caminho mais integrado.

É por isso que o projeto parece importante mesmo antes de a verificação pública alcançar a narrativa. Ele está apontando para o workflow que os creators realmente querem.

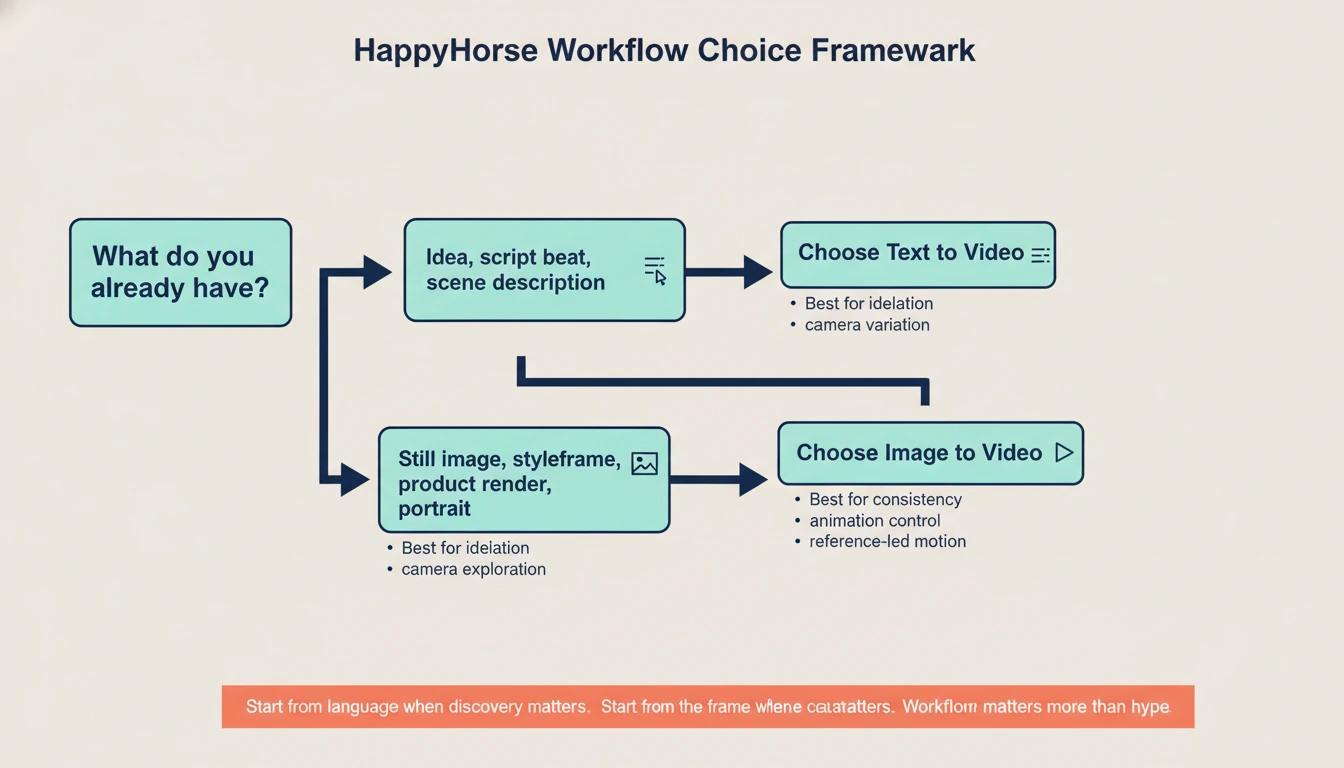

A pergunta real de workflow: Text to Video ou Image to Video?

Mesmo que o HappyHorse um dia entregue tudo o que promete publicamente, a maioria dos creators ainda precisará tomar a mesma decisão central de hoje: começar pela linguagem ou por um frame?

Essa escolha importa mais do que o nome do modelo.

| Workflow | Melhor ponto de partida | O que entrega | Principal fraqueza |

|---|---|---|---|

| Text to video | Você tem uma ideia, um beat de roteiro, uma descrição de cena ou direção de câmera, mas ainda não tem um keyframe fixo | Ideação mais rápida, exploração de conceito mais fácil, mais variações guiadas por prompt | A composição pode derivar quando a imagem mental é muito específica |

| Image to video | Você já tem uma still, um frame de personagem, um render de produto, um frame de storyboard ou uma hero shot | Melhor consistência do sujeito, direção de arte mais controlada, animação mais fácil de visuais aprovados | Menos liberdade para grandes mudanças de cena se o frame inicial não for forte |

É exatamente aqui que muita gente trava ao correr atrás de um novo lançamento de modelo. Começa a pensar que o novo modelo é o workflow em si. Não é. O workflow continua começando pelo ativo criativo que você já tem.

Use text to video quando:

- estiver explorando várias ideias de cena rapidamente

- precisar de alternativas de câmera a partir de um mesmo conceito escrito

- ainda estiver descobrindo a direção visual

- quiser iterar sobre clima, ação ou beats narrativos antes de travar um frame

Use image to video quando:

- você já tiver uma imagem fixa forte

- precisar que personagem, produto ou composição fiquem próximos de uma referência

- estiver animando um key visual, um anúncio, um retrato ou um painel de storyboard

- a consistência visual importar mais do que a exploração aberta

O HappyHorse talvez venha a suportar os dois caminhos dentro do mesmo ecossistema. Para a maioria dos creators, isso não muda a árvore de decisão. Só muda qual modelo vai executá-la.

Onde o HappyHorse parece mais forte no papel

Se o posicionamento público estiver apontando na direção certa, o HappyHorse seria especialmente atraente em alguns cenários específicos.

1. Vídeo curto guiado por diálogo

A combinação de geração conjunta de vídeo e áudio com lip-sync multilíngue é o grande destaque do pacote. Se esses recursos funcionarem no nível sugerido pelo site, o HappyHorse seria muito mais interessante do que outro gerador de clipes mudos com gráficos de benchmark bonitos.

Isso importa para:

- conteúdo com avatar falante

- vídeos curtos explicativos

- vídeos de creators multilíngues

- intros de produto com fala em cena

- conteúdo social centrado em diálogo

2. Experimentação aberta ou auto-hospedada

Muitas equipes não querem apenas um bom output. Elas querem infraestrutura que possam inspecionar, ajustar, benchmarkar e possivelmente rodar nas próprias GPUs. É por isso que o ângulo open source importa tanto.

Se o HappyHorse realmente entregar pesos utilizáveis, código de inferência e opções de destilação, ele passa a ser relevante não só para creators, mas também para:

- equipes de IA aplicada

- grupos de pesquisa

- estúdios com restrições de privacidade

- empresas testando pipelines internos de mídia

3. Controle estilístico mais forte em image-to-video

O projeto afirma suportar entrada de texto e imagem. Na prática, modelos com geração guiada por imagem costumam ser muito mais úteis em trabalho comercial do que sistemas puramente textuais, porque workflows image-first são mais controláveis.

Por isso, mesmo antes de o HappyHorse estar totalmente verificável, faz sentido testar seu próprio processo com um workflow de image to video. Se sua lógica de produção depende de stills aprovadas, styleframes, arte de produto ou referências de personagem, animação guiada por imagem é o workflow mais transferível.

Onde a história pública ainda parece frágil

Essa é a parte que muitos artigos de lançamento pulam. As fraquezas não são necessariamente fraquezas do modelo. São fraquezas de confiança e operabilidade.

Desalinhamento entre narrativa e artefatos públicos

Os materiais públicos atuais falam com a confiança de um produto técnico já totalmente lançado. O caminho público do repositório não sustenta essa confiança. Se um projeto quer liderar com credibilidade open source, artefatos acessíveis não são opcionais.

Lacuna de confiança em benchmark

Tabelas de benchmark são fáceis de publicar. Detalhes reprodutíveis de avaliação são muito mais difíceis. Até que exista um relatório claramente inspecionável, acesso estável ao código ou um caminho de reprodução por terceiros, esses números devem ser tratados como claims direcionais, não como fatos fechados.

Prontidão para produção ainda ambígua

Um modelo pode ser real, impressionante e ainda assim não estar pronto para uso confiável em produção. Equipes com deadline se preocupam com coisas como:

- acesso estável

- modos de falha documentados

- previsibilidade de taxa

- ambientes reproduzíveis

- cadência visível de atualização

Hoje o HappyHorse ainda não expõe superfície operacional pública suficiente para pontuar bem nesses critérios.

O que os creators devem fazer agora

Se você está curioso com o HappyHorse, o melhor movimento não é discutir se ele está superestimado ou subestimado. O melhor movimento é reduzir risco no seu workflow agora.

Use esta tabela de decisão:

| Sua situação | Melhor movimento agora |

|---|---|

| Você precisa principalmente explorar conceitos a partir de prompts | Construa em cima de um workflow de text to video confiável e mantenha o HappyHorse na watchlist |

| Você já tem concept frames, stills de produto ou retratos | Construa em cima de image to video e teste novos modelos só quando eles oferecerem melhor consistência |

| Você se importa mais com infraestrutura aberta do que com publicação no curto prazo | Acompanhe o HappyHorse de perto e espere pesos acessíveis, código e documentação reproduzível |

| Você precisa de assets publicáveis ainda esta semana | Não centralize seu calendário em um modelo com verificação pública ainda incompleta |

Essa é a lente prática que falta em grande parte da cobertura de lançamentos. Você não precisa decidir se o HappyHorse é o futuro. Precisa apenas decidir o que ajuda você a publicar hoje sem fechar a porta para ferramentas melhores amanhã.

Onde acompanhar a cobertura pública do HappyHorse

Se você quer acompanhar como o projeto está sendo apresentado em diretórios públicos e páginas de lançamento, HappyHorse AI e o modelo de vídeo HappyHorse são duas referências úteis. Trate ambos como pontos de descoberta, não como substitutos para código inspecionável, pesos estáveis e artefatos de deploy reproduzíveis.

Como avaliar melhor o HappyHorse quando surgirem mais artefatos públicos

Quando o HappyHorse expuser mais infraestrutura pública, estes serão os testes mais importantes:

- Um usuário deslogado consegue chegar ao repositório real, à documentação e à página do modelo sem becos sem saída?

- Pesos, scripts de inferência e instruções de deploy são consistentes em todas as superfícies públicas?

- O caminho de text-to-video realmente obedece prompts cinematográficos com um nível útil de consistência?

- O caminho de image-to-video preserva sujeito e composição sob movimento?

- O áudio sincronizado é realmente utilizável ou ainda exige muito cleanup?

- Os claims de lip-sync multilíngue aparecem em demos públicas para além de alguns trechos curados?

- Um creator ou engenheiro consegue reproduzir o desempenho publicado no hardware divulgado?

Até que essas perguntas estejam respondidas, a postura correta é interesse informado, não adoção cega.

FAQ

O HappyHorse é open source agora?

O HappyHorse é apresentado publicamente como open source com permissão de uso comercial, mas o caminho atual do repositório público não está acessível em uma checagem direta. O claim open source está visível. A cadeia pública de artefatos ainda está incompleta.

O HappyHorse é text-to-video ou image-to-video?

O site público atual o apresenta como ambos. Isso faz parte do motivo de ele estar atraindo atenção. A pergunta mais útil é qual workflow combina com seus inputs de hoje: text to video para ideação guiada por prompt ou image to video para animação guiada por referência.

O HappyHorse está pronto para produção?

Ele pode vir a se tornar relevante para produção, mas o nível atual de verificação pública não é forte o bastante para recomendá-lo como centro de uma pipeline sensível a prazos.

Qual é o principal motivo pelo qual tanta gente se importa com o HappyHorse?

Porque ele combina posicionamento de modelo aberto com áudio sincronizado, lip-sync multilíngue e entrada por texto e imagem. É uma história de workflow muito mais atraente do que outro modelo de vídeo mudo com um único screenshot de benchmark.

O que devo usar enquanto o HappyHorse amadurece?

Use uma abordagem orientada a workflow. Comece com text to video quando a cena ainda for guiada por prompt e use image to video quando você já tiver o frame que quer animar.

Veredito final

O HappyHorse merece atenção, mas não confiança cega. A história pública do projeto é forte o bastante para ser levada a sério e frágil o bastante para exigir verificação rigorosa.

Se o modelo acabar entregando seus claims públicos com artefatos estáveis, ele pode se tornar um dos projetos open de vídeo mais interessantes do mercado. Até lá, creators devem evitar transformar empolgação de launch page em dependência de produção. Construa sobre workflows que já ajudam você a publicar hoje, mantenha um padrão alto de avaliação e trate o HappyHorse como um projeto promissor que ainda precisa fechar sua lacuna de prova.