Als je zoekt naar een volledige gids over HappyHorse, dan is het echte probleem niet het begrijpen van de marketingboodschap. Het echte probleem is om te scheiden wat publiek zichtbaar is van wat onafhankelijk verifieerbaar is, en daarna te bepalen of HappyHorse nu vooral iets is om te volgen, iets om te testen of iets om daadwerkelijk op te vertrouwen.

Op 8 april 2026 vertellen de publieke HappyHorse-materialen een zeer ambitieus verhaal. HappyHorse 1.0 wordt daar neergezet als een open-source multimodaal videomodel met gesynchroniseerde audio, lip-sync in zeven talen, 1080p-output, toestemming voor commercieel gebruik, ondersteuning voor self-hosting en sterke benchmarkresultaten. Dat klinkt aantrekkelijk. Tegelijk ontstaat er meteen een verificatieprobleem, omdat het publieke codepad niet direct bereikbaar is en ook het modelpad dat in deploymentvoorbeelden wordt getoond, zonder inloggen niet open toegankelijk is.

Dat betekent niet automatisch dat HappyHorse nep is. Het betekent wel dat je elke claim in het juiste kader moet lezen: een interessant project, onvolledige publieke verificatie en een nog onduidelijke productierijpheid. In deze gids lopen we door wat echt oogt, wat nog bewijs nodig heeft, waar HappyHorse waarschijnlijk het meest relevant is en waarom een praktische text to video-workflow of image to video-workflow vaak een betere keuze is als je nu output nodig hebt in plaats van speculatie.

Het korte antwoord

HappyHorse oogt als een veelbelovend AI-videomodelconcept met een sterke publieke positionering rond open weights, audiogeneratie, lip-sync en self-hosting. De huidige publieke bewijslast is echter nog niet sterk genoeg om elke grote claim te behandelen als volledig bevestigde infrastructuur die je zonder risico kunt adopteren.

Hier is de praktische samenvatting:

| Vraag | Praktisch antwoord |

|---|---|

| Is HappyHorse interessant? | Ja. De publieke feature-set is uitzonderlijk ambitieus voor een videomodel dat als open en self-hostable wordt gepositioneerd. |

| Is het vandaag volledig geverifieerd als openbaar open model? | Nog niet. Het publieke repositorypad is niet beschikbaar en het modelpad op de site is zonder login niet toegankelijk. |

| Moet je het negeren? | Nee. Het is de moeite waard om te volgen als je geeft om open multimodale videogeneratie. |

| Moet je er vandaag je contentpipeline omheen bouwen? | Alleen als je verificatierisico accepteert en kunt leven met onvolledige publieke artefacten. |

| Wat moeten creators nu doen? | Gebruik een bewezen text to video-workflow voor promptgedreven generatie of een image to video-workflow voor referentiegedreven animatie terwijl HappyHorse verder rijpt. |

Dat is de kern. HappyHorse is op dit moment geloofwaardiger als een project met hoog potentieel om te volgen dan als een plug-and-play fundament voor serieuze productieplanning.

Wat HappyHorse op dit moment publiek claimt

De huidige publieke HappyHorse-materialen vertellen een vrij specifiek productverhaal in plaats van een vage teaser. De zichtbare claims omvatten:

- een model van 15B parameters

- een Transformer-architectuur met 40 lagen

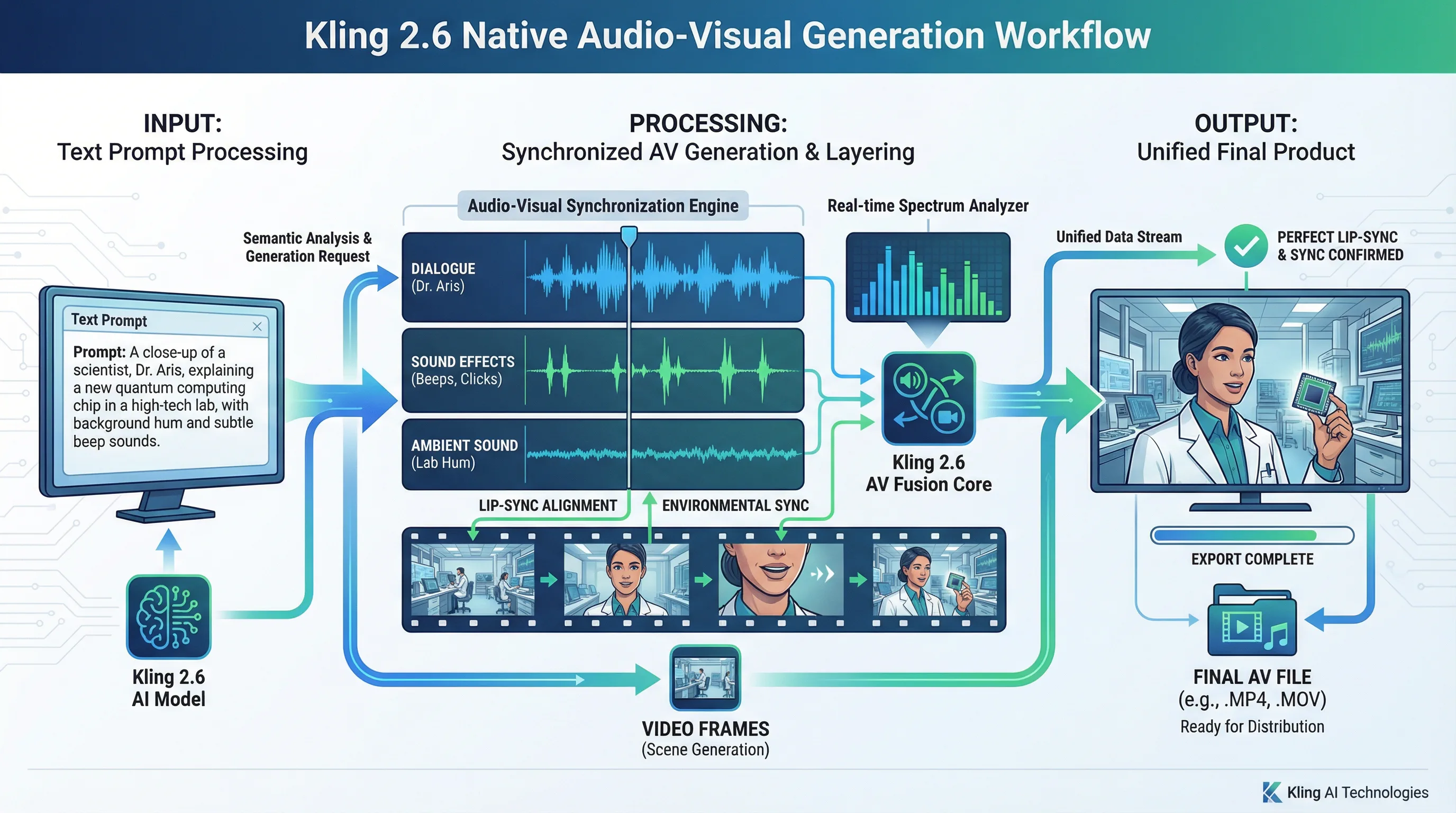

- gezamenlijke video- en audiogeneratie

- ondersteuning voor tekst- en image-prompts

- lip-sync in zeven talen

- 1080p-output

- clips van 5 tot 8 seconden

- self-hosting op GPU’s van de H100- of A100-klasse

- een open-source release met toestemming voor commercieel gebruik

- een instapprijs van

$11.90

Dat zijn geen generieke landingpagezinnen. Het leest meer als een technische launchpagina voor een model dat serieus genomen wil worden door zowel creators als onderzoekers.

De site noemt ook concretere performance-achtige claims, waaronder:

- ongeveer 38 seconden voor een 5-secondenclip in 1080p op H100

- ondersteuning voor lip-sync in Engels, Mandarijn, Kantonees, Japans, Koreaans, Duits en Frans

- benchmarkwinst ten opzichte van OVI 1.1 en LTX 2.3

- een claim op een toppositie in een publieke videomodellenleaderboard

Op papier is dat een aantrekkelijk pakket. Een model dat text-to-video, image-to-video, gesynchroniseerde audio, meertalige lip-sync en commercieel bruikbare openheid combineert, valt direct op. Het probleem is niet de kwaliteit van het verhaal. Het probleem is de kloof tussen het verhaal en de publiek toegankelijke artefacten van vandaag.

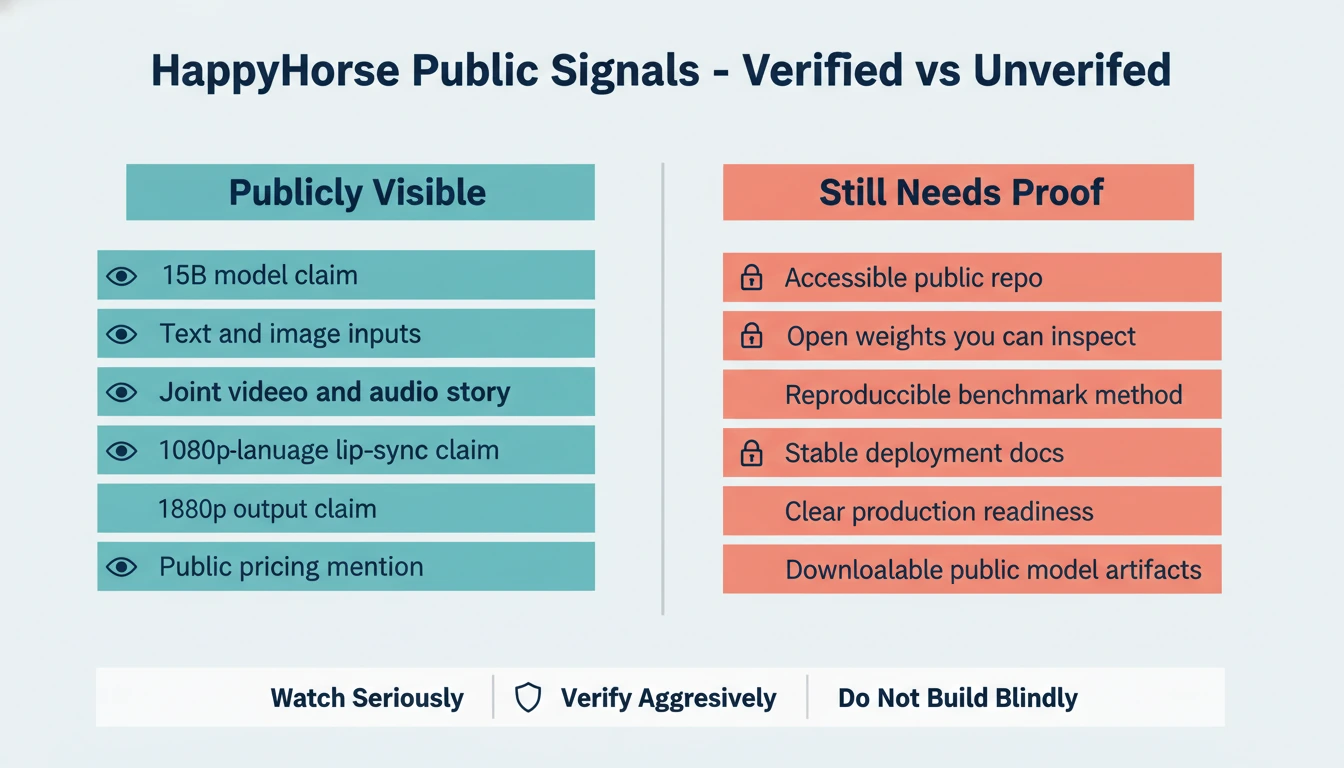

Wat echt geverifieerd is en wat nog bewijs nodig heeft

De nuttigste manier om HappyHorse nu te lezen, is om de publieke informatie op te delen in twee categorieën: direct observeerbare claims en claims die nog onafhankelijke bevestiging nodig hebben.

| Status | Wat hoort hierbij | Waarom hoort het hierbij |

|---|---|---|

| Publiek zichtbaar | Feature-claims op de website, prijsvermelding, deploymentvoorbeelden, benchmarktabellen, voorbeeldvideo’s | Deze onderdelen zijn direct zichtbaar op de huidige site en kunnen worden geïnspecteerd als gepubliceerde claims. |

| Nog niet voldoende onafhankelijk bevestigd | Open-source beschikbaarheid, publieke weights, self-hostable codebase, reproduceerbare benchmarkmethodiek, productierijpheid | Het gelinkte repositorypad is niet beschikbaar en het genoemde modelpad is zonder authenticatie niet publiek toegankelijk. |

Dit onderscheid is belangrijk, omdat creators vaak twee verschillende vragen tot één samenpersen.

De eerste vraag is:

- Presenteert het project een coherent en technisch plausibel productverhaal?

De tweede vraag is:

- Kan ik het vandaag onafhankelijk valideren, downloaden, reproduceren en draaien?

HappyHorse scoort op dit moment duidelijk beter op de eerste vraag dan op de tweede.

Dat maakt het project niet waardeloos. Het verandert alleen de juiste actie. Als je onderzoek doet of vroeg aandacht wilt investeren, dan is het logisch om het te volgen. Als je een creator bent met deadlines, dan is het verstandiger om te blijven publiceren met tools die nu al betrouwbaar genereren.

Waarom HappyHorse aandacht krijgt

HappyHorse krijgt aandacht omdat het meerdere dingen bundelt die creators tegelijk willen:

- een open of in elk geval open-leaning positionering

- multimodale generatie in plaats van stille video-output

- lip-sync in meerdere talen

- self-hosting-taal in plaats van pure SaaS-afhankelijkheid

- benchmarkframing die suggereert dat het kan concurreren met bekende open videoprojecten

Die mix raakt precies de huidige marktspanning. Veel creators willen de kwaliteitsverbeteringen van de nieuwste videosystemen, maar niet vastzitten in gesloten tools, instabiele regionale uitrol of prijsmodellen op één enkel oppervlak. HappyHorse spreekt die wens direct aan.

Er is nog een tweede reden waarom het zich verspreidt: het project beschrijft een workflow die operationeel compleet klinkt. Veel videomodelpagina’s dwingen je nog steeds om de stack zelf samen te bouwen. Video hier genereren. Stem elders toevoegen. Lip-sync op een andere plek repareren. Later upscalen. Timing met de hand opschonen. HappyHorse belooft een meer geïntegreerd pad.

Daarom voelt het project relevant, zelfs voordat volledige publieke verificatie is bijgewerkt. Het wijst naar de workflow die creators echt willen.

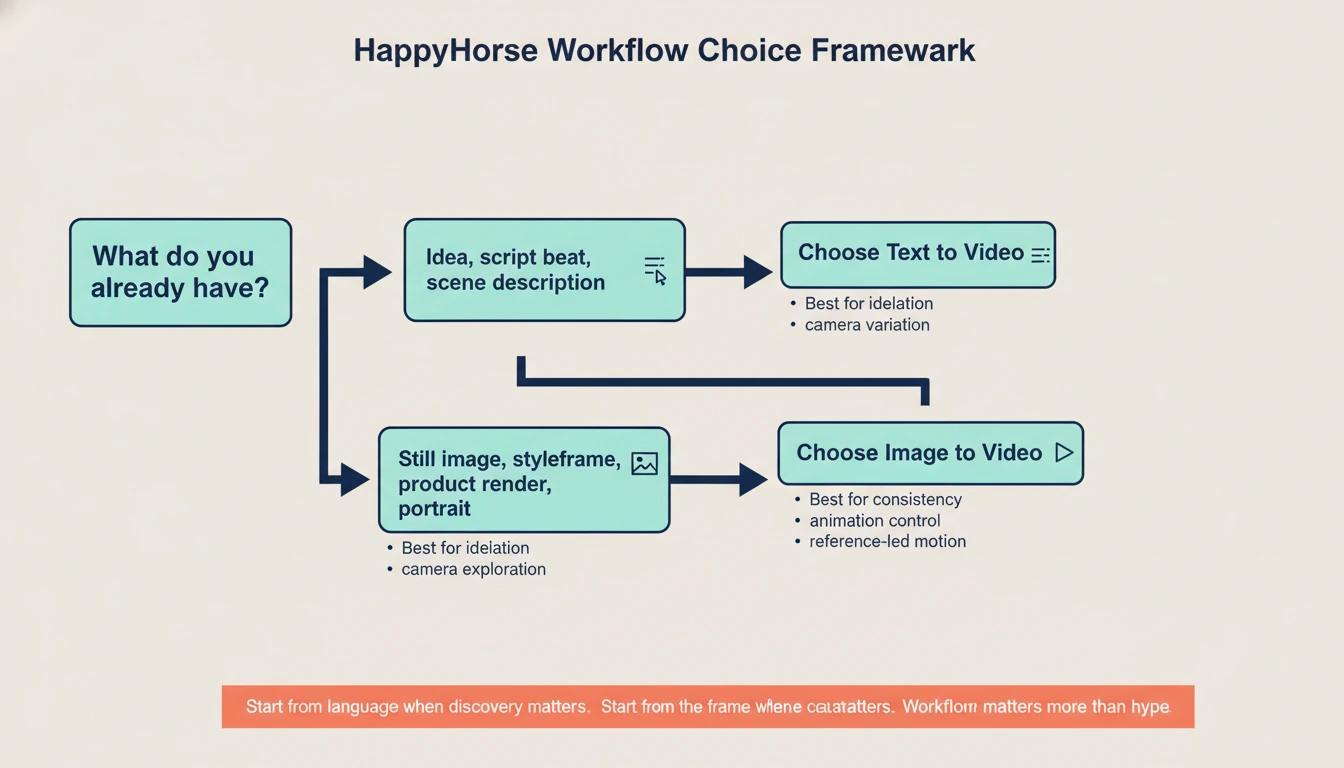

De echte workflowvraag: Text to Video of Image to Video?

Zelfs als HappyHorse uiteindelijk al zijn publieke claims waarmaakt, moeten de meeste creators nog steeds dezelfde kernkeuze maken als vandaag: begin je vanuit taal of vanuit een frame?

Die keuze is belangrijker dan de modelnaam.

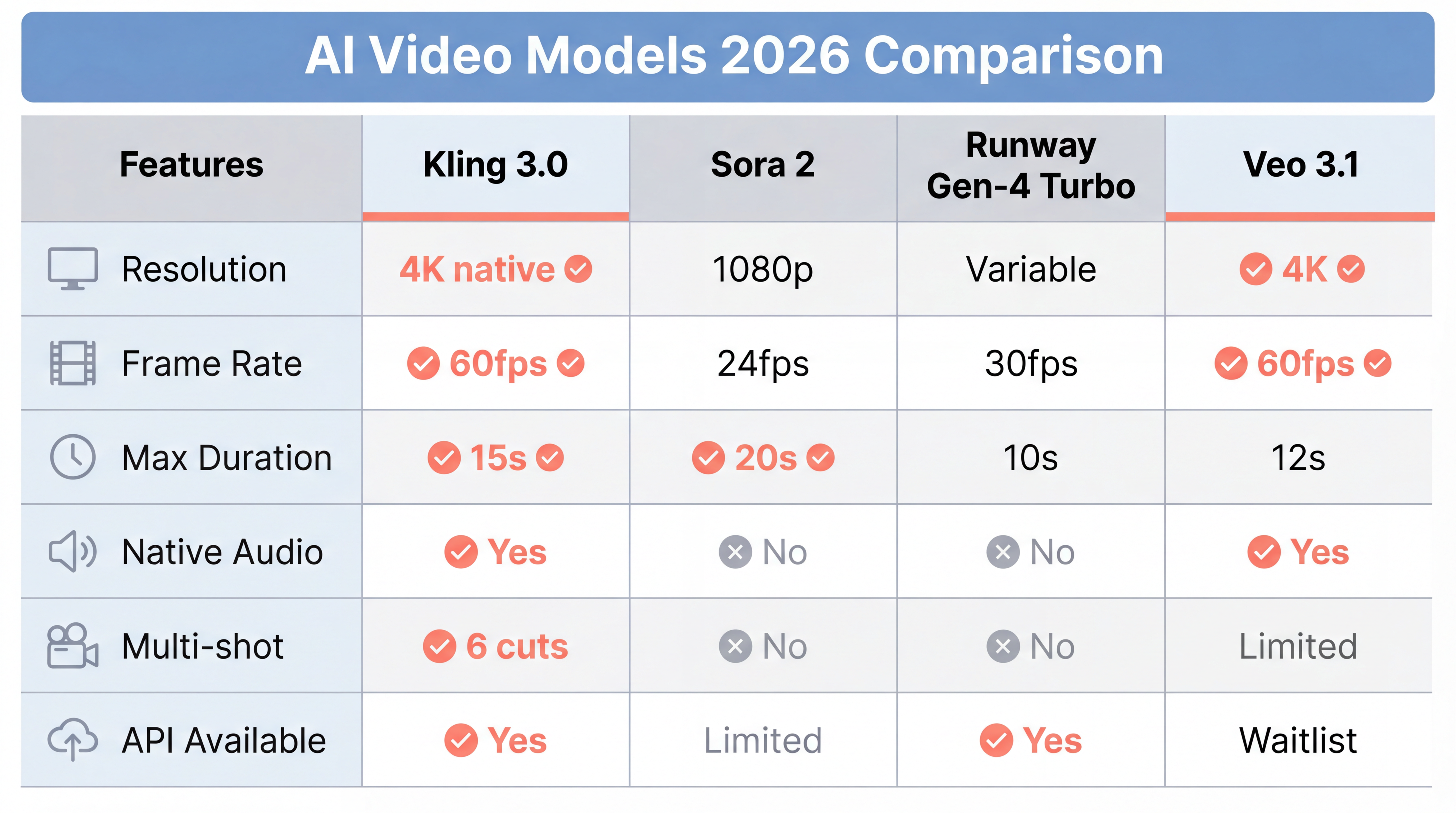

| Workflow | Beste startpunt | Wat het oplevert | Grootste zwakte |

|---|---|---|---|

| Text to video | Je hebt een idee, scenebeschrijving, scriptbeat of camerasturing, maar nog geen vast keyframe | Snellere ideation, makkelijkere conceptverkenning, sterkere promptgestuurde variatie | Compositie kan gaan schuiven wanneer je mentale beeld erg precies is |

| Image to video | Je hebt al een still, karakterframe, productrender, storyboardframe of hero shot | Betere subjectconsistentie, strakkere art direction, eenvoudiger animeren van goedgekeurde visuals | Minder vrijheid voor grote scèneveranderingen als het bronframe niet sterk genoeg is |

Precies hier lopen veel mensen vast wanneer ze achter een nieuw model aan rennen. Ze gaan denken dat het nieuwe model zelf de workflow is. Dat is het niet. De workflow begint nog steeds bij het creatieve asset dat je al hebt.

Gebruik text to video wanneer:

- je snel meerdere scène-ideeën wilt verkennen

- je alternatieve cameraopzetten nodig hebt vanuit één geschreven concept

- je nog bezig bent de visuele richting te vinden

- je sfeer, actie of narratieve beats wilt itereren voordat je een frame vastzet

Gebruik image to video wanneer:

- je al een sterke still hebt

- je wilt dat karakter, product of compositie dicht bij een referentie blijven

- je een key visual, advertentiebeeld, portret of storyboardpaneel animeert

- visuele consistentie belangrijker is dan open verkenning

HappyHorse kan uiteindelijk beide routes in één ecosysteem ondersteunen. Voor de meeste creators verandert dat de beslisboom niet, alleen het model dat hem uitvoert.

Waar HappyHorse op papier het sterkst oogt

Als de publieke positionering grofweg klopt, dan is HappyHorse vooral aantrekkelijk in een paar specifieke scenario’s.

1. Dialooggedreven korte video

Gezamenlijke video- en audiogeneratie plus meertalige lip-sync is de opvallendste combinatie in het hele pakket. Als die functies presteren op het niveau dat de site suggereert, dan is HappyHorse veel interessanter dan weer een stille clipgenerator met mooie benchmarkgrafieken.

Dat doet ertoe voor:

- pratende avatarcontent

- korte explainers

- meertalige creatorvideo’s

- productintro’s met gesproken tekst in beeld

- dialooggerichte social content

2. Open of self-hosted experimenten

Veel teams willen niet alleen goede output. Ze willen infrastructuur die ze kunnen inspecteren, tunen, benchmarken en mogelijk op hun eigen GPU’s kunnen draaien. Daarom is de open-sourcehoek zo belangrijk.

Als HappyHorse echt bruikbare weights, inferentiecode en distillatie-opties levert, wordt het relevant voor niet alleen creators maar ook voor:

- applied AI-teams

- onderzoeksgroepen

- studio’s met privacy-eisen

- bedrijven die interne mediapipelines testen

3. Sterkere stijlcontrole in image-to-video

Het project claimt ondersteuning voor tekst- en image-input. In de praktijk worden modellen met image-gedreven generatie vaak veel bruikbaarder voor commercieel werk dan pure tekstsystemen, omdat image-first workflows beter controleerbaar zijn.

Daarom is het, zelfs voordat HappyHorse volledig verifieerbaar is, nuttig om je eigen proces te toetsen via een image to video-workflow. Als je productielogica leunt op goedgekeurde stills, styleframes, productart of karakterreferenties, is beeldgestuurde animatie de meest overdraagbare workflow.

Waar het publieke verhaal nog fragiel aanvoelt

Dit is het deel dat veel launchartikelen overslaan. De zwaktes zijn niet per se modelzwaktes. Het zijn zwaktes in vertrouwen en inzetbaarheid.

Mismatch tussen verhaal en publieke artefacten

De huidige publieke materialen spreken met het zelfvertrouwen van een volledig gelanceerd technisch product. Het publieke repositorypad ondersteunt dat zelfvertrouwen niet. Als een project wil leiden op open-source geloofwaardigheid, zijn toegankelijke artefacten geen nice-to-have.

Vertrouwenskloof rond benchmarks

Benchmarktabellen zijn makkelijk te publiceren. Reproduceerbare evaluatiedetails zijn veel moeilijker. Totdat er een duidelijk inspecteerbaar rapport, stabiele code-toegang of een third-party reproductiepad is, moeten benchmarkcijfers worden gelezen als richtinggevende claims en niet als vaststaande feiten.

Onduidelijke productierijpheid

Een model kan echt en indrukwekkend zijn en toch nog niet klaar voor betrouwbare productie. Teams met deadlines letten op zaken als:

- stabiele toegang

- gedocumenteerde failure modes

- voorspelbare throughput

- reproduceerbare omgevingen

- zichtbare updatecadans

HappyHorse toont momenteel nog te weinig publieke operationele oppervlakte om op die punten hoog te scoren.

Wat creators nu moeten doen

Als je nieuwsgierig bent naar HappyHorse, is de beste stap niet om te discussiëren of het overdreven of onderschat wordt. De beste stap is om je workflow nu al minder risicovol te maken.

Gebruik deze beslissingstabel:

| Jouw situatie | Beste zet nu |

|---|---|

| Je hebt vooral conceptverkenning vanuit prompts nodig | Bouw rond een betrouwbare text to video-workflow en houd HappyHorse op je watchlist |

| Je hebt al conceptframes, productstills of portretten | Bouw rond image to video en test nieuwe modellen alleen wanneer ze betere consistentie bieden |

| Open infrastructuur is belangrijker voor je dan publiceren op korte termijn | Volg HappyHorse nauw en wacht op toegankelijke gewichten, code en reproduceerbare documentatie |

| Je hebt deze week publiceerbare assets nodig | Richt je contentkalender niet op een model met nog onvolledige publieke verificatie |

Dat is precies de praktische blik die in veel launchcoverage ontbreekt. Je hoeft niet te bepalen of HappyHorse de toekomst is. Je hoeft alleen te bepalen wat je vandaag helpt publiceren zonder de deur naar betere tools morgen dicht te gooien.

Waar je publieke HappyHorse-verwijzingen kunt volgen

Als je wilt volgen hoe het project verschijnt in publieke directory’s en launchachtige pagina’s, zijn HappyHorse AI en het HappyHorse-videomodel twee nuttige referentiepunten. Zie beide als ontdekkingspunten, niet als vervanging voor inspecteerbare code, stabiele gewichten en reproduceerbare deploymentartefacten.

Hoe je HappyHorse beter beoordeelt zodra er meer publieke artefacten zijn

Wanneer HappyHorse meer publieke infrastructuur vrijgeeft, zijn dit de tests die het meest tellen:

- Kan een uitgelogde gebruiker zonder doodlopende paden bij de echte repository, de documentatie en de modelpagina komen?

- Zijn weights, inferentiescripts en deploymentinstructies consistent over alle publieke oppervlakken?

- Volgt de text-to-video-route filmische prompts daadwerkelijk op een bruikbaar consistentieniveau?

- Behoudt de image-to-video-route subject en compositie wanneer er beweging wordt toegevoegd?

- Is de gesynchroniseerde audio echt bruikbaar of vraagt die nog steeds veel opschoonwerk?

- Zijn meertalige lip-sync-claims zichtbaar in publieke demo’s buiten enkele gecureerde snippets?

- Kan een creator of engineer de gepubliceerde prestaties reproduceren op de vermelde hardware?

Totdat die vragen zijn beantwoord, is geïnformeerde interesse de juiste houding en niet blinde adoptie.

FAQ

Is HappyHorse nu open source?

HappyHorse wordt publiek gepresenteerd als open source met toestemming voor commercieel gebruik, maar het huidige publieke repositorypad is in een directe check niet bereikbaar. De open-sourceclaim is zichtbaar. De publieke artefactketen is nog niet compleet.

Is HappyHorse text-to-video of image-to-video?

De huidige publieke site presenteert het als allebei. Dat is ook een deel van de reden waarom het aandacht krijgt. De nuttigere vraag is welke workflow past bij jouw input van vandaag: text to video voor promptgedreven ideation of image to video voor referentiegedreven animatie.

Is HappyHorse klaar voor productiegebruik?

Het kan productierelevant worden, maar het huidige niveau van publieke verificatie is nog niet sterk genoeg om het aan te raden als kern van een deadlinegevoelige pipeline.

Waarom geven mensen zoveel om HappyHorse?

Omdat het open-modelpositionering combineert met gesynchroniseerde audio, meertalige lip-sync en zowel tekst- als image-input. Dat is een veel aantrekkelijker workflowverhaal dan opnieuw een stil videomodel met één benchmark-screenshot.

Wat moet ik gebruiken terwijl HappyHorse verder rijpt?

Kies workflow-first. Begin met text to video wanneer de scène nog promptgedreven is, en gebruik image to video wanneer je al het frame hebt dat je wilt animeren.

Eindoordeel

HappyHorse verdient aandacht, maar geen blind vertrouwen. Het publieke projectverhaal is sterk genoeg om serieus te volgen en zwak genoeg om streng te verifiëren.

Als het model uiteindelijk zijn huidige publieke claims met stabiele artefacten waarmaakt, kan het een van de interessantere open videoprojecten op de markt worden. Tot die tijd moeten creators voorkomen dat launchpage-enthousiasme verandert in productieafhankelijkheid. Bouw op workflows die je vandaag al helpen publiceren, houd je evaluatiestandaarden hoog en behandel HappyHorse als een veelbelovend project dat zijn bewijskloof nog moet dichten.