KI-Video entwickelt sich rasant, und Veo 3.1 zeigt bereits, in welche Richtung Google als Nächstes gehen könnte. Verbesserungen bei Bild-zu-Video, nativem Audio und Kamerasteuerung haben Veo 4 zu einem der spannendsten kommenden Modell-Updates gemacht.

Google hat Veo 4 zum Zeitpunkt des Verfassens dieses Artikels noch nicht offiziell angekündigt, aber die breitere Richtung ist bereits erkennbar. Basierend auf den aktuellen Veo-Funktionen, der Wettbewerbsbewegung auf dem Markt und den realen Problemen, mit denen YouTuber immer noch konfrontiert sind, untersucht dieser Leitfaden, was Veo 4 bieten könnte und warum es für YouTuber, Vermarkter und Entwickler wichtig ist, die die nächste Generation von Videoinhalten entwickeln.

Die Veo-Linie verstehen: Von Veo 1.0 bis Veo 3.1

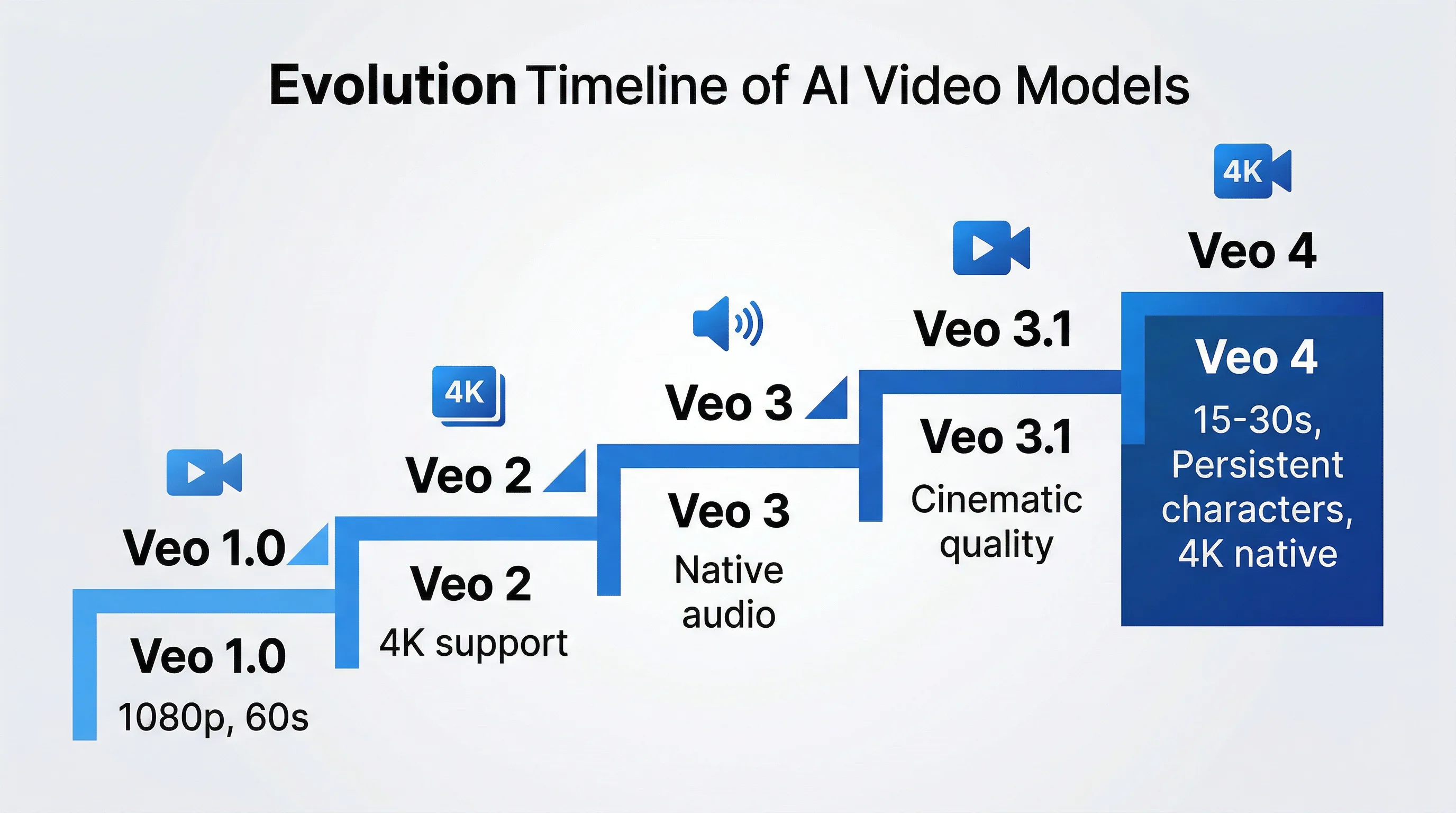

Um zu verstehen, was Veo 4 darstellen könnte, ist es hilfreich, einen Blick auf das Muster zu werfen, das Google bereits erstellt hat. Veo 1.0, angekündigt auf der Google I/O 2024, markierte Googles ersten ernsthaften Vorstoß in die Text-zu-Video-Generierung, mit einem Schwerpunkt auf filmischer Bewegung und längerer Ausgabe, als es die meisten frühen Konkurrenten schaffen konnten.

Von da an beschleunigte sich die Iterationsgeschwindigkeit. Veo 2, das Ende 2024 veröffentlicht wurde, strebte eine höhere Wiedergabetreue und eine stärkere reale Physik an. Veo 3 hat die native Audiogenerierung hinzugefügt und synchronisierte Dialoge, Soundeffekte und Umgebungsgeräusche in den gleichen Generierungsworkflow integriert. Veo 3.1 verbesserte dann die Bild-zu-Video-Qualität, verbesserte die zeitliche Stabilität und brachte das Modell näher an die produktionsreife Ausgabe heran.

Veo 3.1, das aktuelle Flaggschiff, liefert eine konsistente 1080p-Ausgabe, unterstützt native 4K-Workflows und erzeugt Kamerabewegungen, die filmischer wirken als der durchschnittliche KI-Videogenerator. Es verwendet einen Diffusion Transformer-Ansatz über räumlich-zeitliche Patches hinweg, was bedeutet, dass das Video als kontinuierliche Sequenz und nicht als Stapel getrennter Standbilder modelliert wird. Diese architektonische Wahl ist ein wesentlicher Grund dafür, dass sich Bewegungstreue und physische Konsistenz besser anfühlen als bei vielen Konkurrenzsystemen.

Praxisnahe Tests unterstützen diese Ansicht. Veo 3.1 erzeugt routinemäßig einige der saubersten Einzelbildausgaben in dieser Kategorie, mit weniger Komprimierungsartefakten, stärkerer sofortiger Einhaltung von Kamerabewegungen und stabilerer Bewegung über das gesamte Erzeugungsfenster. Sie können mit diesem Workflow bereits über Seedance AIs Veo 3.1-Erfahrung experimentieren, was Entwicklern eine praktische Möglichkeit bietet, zu bewerten, wie sich das aktuelle Modell von Google verhält, bevor eine zukünftige Version erscheint.

Was Veo 4 voraussichtlich liefern wird

Aufgrund der aktuellen Modellbeschränkungen, des Wettbewerbsdrucks und der eigenen Produktentwicklung von Google wird sich Veo 4 wahrscheinlich auf die verbleibenden Hindernisse konzentrieren, die immer noch verhindern, dass sich KI-Videos in der professionellen Produktion völlig heimisch anfühlen.

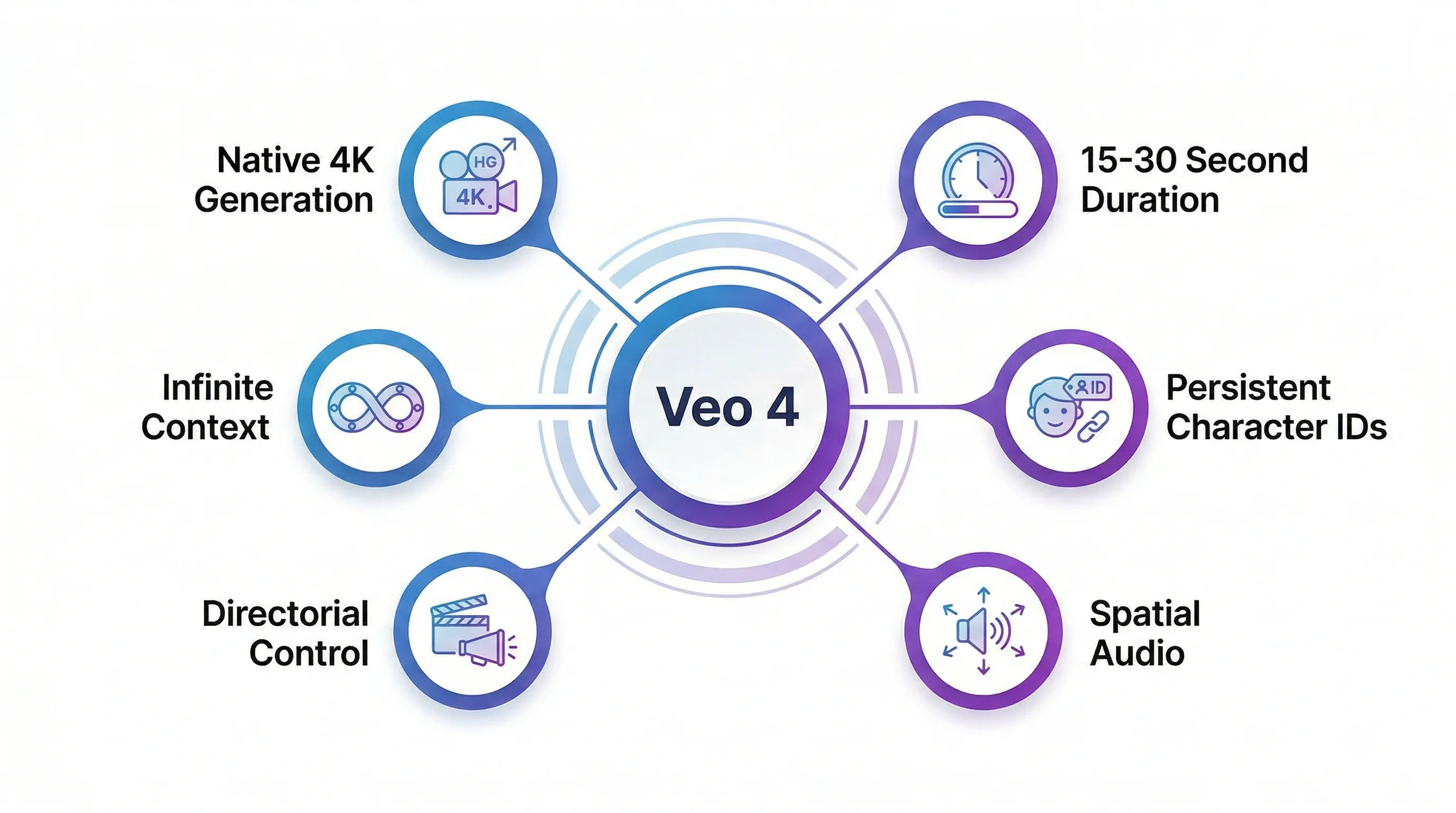

Erweiterte Dauer mit zeitlicher Konsistenz

Bei kurzen Clips liegt Veo 3.1 immer noch an der Spitze. Das macht es für filmische Einfügungen, Werbung, soziale Inhalte und schnelle Experimente nützlich, zwingt Erzähler jedoch zu bearbeitungsintensiven Arbeitsabläufen, wenn sie längere Szenen benötigen. Es wird erwartet, dass Veo 4 die Single-Pass-Generierung in den Bereich von 15 bis 30 Sekunden bringt und gleichzeitig die Kontinuität über die gesamte Sequenz hinweg gewährleistet.

Die zeitliche Konsistenz bleibt eines der größten Probleme bei KI-Videos. Frühere Models vergaßen häufig Requisiten mitten in der Aufnahme, gingen in Kostümdetails verloren oder veränderten die Beleuchtung auf eine Art und Weise, die das Eintauchen unterbrach. Ein Veo-Modell der nächsten Generation wird wahrscheinlich darauf abzielen, das Szenengedächtnis weitaus zuverlässiger zu bewahren, wodurch es möglich wird, die Objektidentität, die Umgebungslogik und das Erscheinungsbild der Charaktere über längere Zeiträume beizubehalten.

Native 4K-Generierung und Mikrodetailtreue

Während Veo 3.1 bei hochauflösenden Workflows bereits gut konkurriert, hängt ein Großteil des Marktes immer noch von der Hochskalierung ab. Echtes natives 4K ist wichtig, weil es bestimmt, ob das Filmmaterial eine genaue Betrachtung auf großen Displays, Premium-Werbeplatzierungen oder filmischen Lieferpipelines übersteht.

Wenn Veo 4 tiefer in die native 4K-Generierung vordringt, wird der eigentliche Gewinn nicht nur in der Pixelzahl liegen. Es wird sich um Mikrodetailtreue handeln: Hautstruktur, Wassertropfen, Reflexionen, Umgebungspartikel und subtile Lichteffekte, die so aussehen, als wären sie absichtlich erzeugt und nicht aus einer weicheren Quelle interpoliert.

Persistente Charakteridentitäts- und Avatarsysteme

Die Zeichenkonsistenz bleibt einer der größten Workflow-Engpässe bei KI-Videos. Die meisten aktuellen Modelle können ein Motiv innerhalb eines kurzen Clips stabil halten, haben jedoch Schwierigkeiten, wenn dieselbe Figur in mehreren Szenen mit demselben Gesicht, denselben Haaren, derselben Stimme und derselben Körpersprache auftreten muss.

Veo 4 könnte dieses Problem mit einer Form von dauerhaftem Zeichenspeicher, Identitäts-Tokens oder Avatar-Slots lösen. Wenn Ersteller einen wiederverwendbaren Bildschirmcharakter einmal definieren und diese Identität über mehrere Eingabeaufforderungen und Szenen hinweg einsetzen können, rückt KI-Video viel näher an serialisiertes Storytelling, gebrandete Sprecher und wiederverwendbare Kampagnenressourcen heran.

Erweiterte Kamerasteuerung und Regiepräzision

Veo 3.1 reagiert bereits gut auf Aufforderungen wie „Kamerafahrt“, „Dolly rein“ oder „Goldene Stunde Hintergrundbeleuchtung“. Es wird erwartet, dass Veo 4 diese Steuerung detaillierter macht und möglicherweise von einer aufforderungsgesteuerten Kameraführung hin zu einer Steuerung auf Aufnahmeebene übergeht.

Das könnte zuverlässigere Fokusänderungen, eine stärkere Kontrolle über den Aufnahmeverlauf, eine klarere Interpretation der Objektivsprache und schließlich eine selektive Bearbeitung bedeuten, bei der nur ein Segment einer Aufnahme anstelle des gesamten Clips regeneriert wird. Für YouTuber, die an traditionelle Produktionstools gewöhnt sind, würde dieser Wandel dazu führen, dass sich KI-Videos weniger wie schnelles Glücksspiel, sondern eher wie Regie anfühlen.

Raumintelligenz-Audio

Natives synchronisiertes Audio war einer der größten Durchbrüche von Veo 3. Veo 4 könnte noch einen Schritt weiter gehen, indem es die Raumakustik verbessert, sodass Umgebungen physikalisch korrekt klingen und nicht nur dem Kontext entsprechen.

Das bedeutet Dialoge, die sich in einem Flur anders verhalten als in einem Lagerhaus, Schritte, die sich je nach Bodenmaterial ändern, und Umgebungsgeräusche, die sich auf natürliche Weise entwickeln, wenn sich die Kamera durch den Raum bewegt. Wenn Google dies richtig macht, verschwindet einer der klarsten verbliebenen Hinweise auf KI-generierte Inhalte.

Wie Veo 4 im Vergleich zur Konkurrenz abschneidet

Veo 4 existiert nicht im luftleeren Raum. Jede zukünftige Google-Version muss mit den Modellen konkurrieren, die bereits heute die Spitzenklasse von KI-Videos definieren.

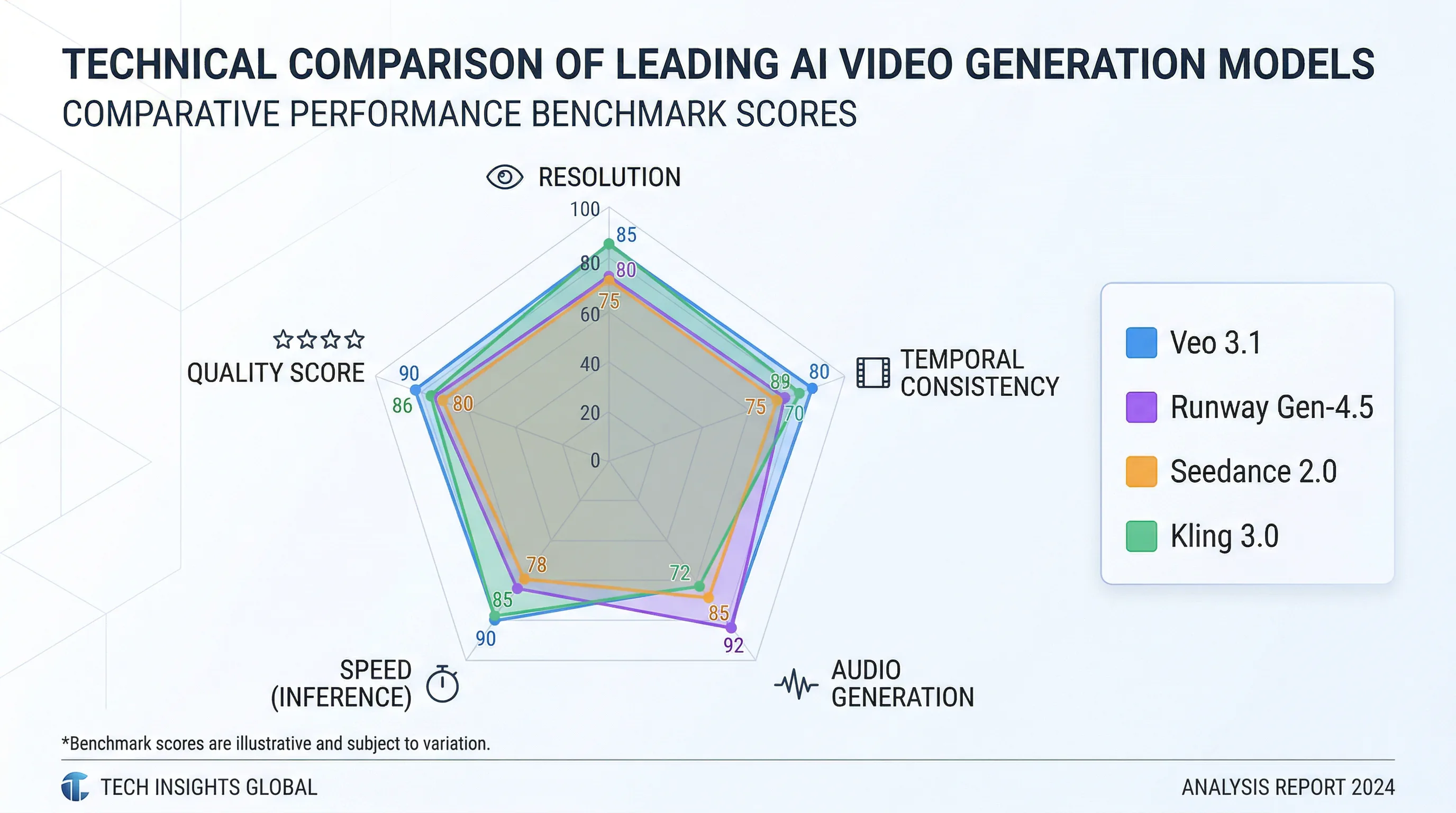

Benchmark-Leistungs- und Qualitätsmetriken

Jüngste Benchmark-Zusammenfassungen platzieren Runway Gen-4.5 in der Qualitätsdiskussion ganz oben, dicht gefolgt von Veo 3.1 und Seedance 2.0, das auch in den zusammengesetzten Rankings stark abschneidet. Diese Bestenlisten fassen in der Regel visuelle Wiedergabetreue, Bewegungsglätte, schnelle Ausrichtung und zeitliche Konsistenz in einer einzigen Partitur zusammen.

Die rohen Zahlen der Bestenliste erzählen nur einen Teil der Geschichte. In der Praxis zeichnet sich Veo 3.1 in einigen spezifischen Bereichen aus:

- Starke filmische Farb- und Lichtkonsistenz

- Sauberer Single-Shot-Realismus

- Native Audiogenerierung im selben Workflow

- Besser aussehende hochauflösende Ausgabe als viele Modelle, die auf hochwertigen Pipelines basieren

Im Gegensatz dazu ist Seedance 2.0 derzeit für viele Entwickler führend in der Bewegungsnatürlichkeit. Die Charaktere bewegen sich mit mehr Gewicht, glaubwürdigerem Timing und mehr menschlicher Körpermechanik als die meisten Konkurrenten. Runway bleibt besonders stark für kreative Kontrolle und Bild-zu-Video-Workflows. Kling verbessert sich ständig in der hochauflösenden Bewegung und der stilisierten Ausgabe.

| Modell | Auflösung | Dauer | Audio | Zeitliche Konsistenz | Bester Anwendungsfall |

|---|---|---|---|---|---|

| Veo 3.1 | Native 4K | 4-8 Sek | Native Synchronisierung | Exzellent | Filmischer, professioneller Inhalt |

| Runway Gen-4.5 | 1080p (4K gehobene Klasse) | Variable | Extern | Sehr gut | Bild-zu-Video, kreative Kontrolle |

| Seedance 2.0 | Bis 4K | 5-10 Sek | Extern | Exzellent | Bewegungsqualität, Fotorealismus |

| Kling 3.0 | Ultra-HD | Variable | Extern | Gut | Charakteranimation, stilisierte Inhalte |

Der Ökosystemvorteil

Was Google einen strukturellen Vorsprung verschafft, ist nicht nur die Modellqualität. Es ist die Integration eines Ökosystems. Veo ist so positioniert, dass es in den APIs YouTube, Gemini, Workspace, Google Ads und Entwicklern eingesetzt werden kann. Das bedeutet, dass Google nicht gewinnen muss, indem es Veo zu einem eigenständigen Verbraucherziel macht. Es kann gewinnen, indem es Veo genau dort nützlich macht, wo Entwickler und Vermarkter bereits arbeiten.

Google hat Veo bereits in Werbeworkflows integriert. Vermarkter können statische Assets in kurze Video-Creatives umwandeln, ohne einen völlig separaten Produktionsprozess aufzubauen. Für Entwickler ist Veo 3.1 Lite über Gemini API und Google AI Studio verfügbar, was bedeutet, dass die Infrastrukturschicht für eine umfassendere Videogenerierung auf Anwendungsebene bereits vorhanden ist.

Dieser Vertriebsvorteil ist wichtig. Es ist unwahrscheinlich, dass die KI-Videounternehmen, die langfristig überleben, diejenigen mit der auffälligsten Einzeldemo sind. Sie werden diejenigen sein, die über eine stabile Infrastruktur, praktische Produkteinbettung und nachhaltige Lieferökonomie verfügen.

Tests unter realen Bedingungen: Was Entwickler sagen

Benutzerfeedback aus Produktionsumgebungen zeigt bereits sowohl die Stärken von Veo als auch die Lücken, die ein zukünftiger Veo 4 schließen müsste.

Stärken in der Praxis bestätigt

Die Entwickler loben den Veo 3.1 immer wieder für seinen Realismus bei Einzelaufnahmen und die Bildkonsistenz. Bei Tests mit dynamischen Motiven, sich bewegenden Kameras und komplexer Beleuchtung liefert Veo oft eine bessere Bildintegrität als Konkurrenzmodelle. Ein wiederkehrendes Muster im Feedback der Entwickler ist, dass Veo vielleicht nicht immer das ausdrucksstärkste Modell ist, aber oft das Modell, das direkt aus der Generation am fertigsten aussieht.

Auch der integrierte Audio-Workflow erhält gute Noten. Selbst wenn der Ton nicht die Qualität des endgültigen Mixes aufweist, beschleunigt die sofortige Verfügbarkeit synchronisierter Audioentwürfe die Ideenfindung, Überprüfungszyklen und die Rohschnittproduktion erheblich. Dies ist besonders nützlich für die Konzeptentwicklung, Anzeigentests und das narrative Prototyping.

Einschränkungen, die Veo 4 berücksichtigen muss

Das kurze Generationsfenster bleibt der größte Kritikpunkt. Wenn eine Geschichte Luft zum Atmen braucht, müssen sich die Ersteller immer noch an der 8-Sekunden-Grenze orientieren. Dadurch entstehen Reibungsverluste, Kontinuitätsrisiken und zusätzlicher redaktioneller Aufwand.

Auch die Charakteridentität über mehrere Clips hinweg bleibt unvollständig. Veo 3.1 kann bei guten Referenzen sein Erscheinungsbild einigermaßen beibehalten, verhält sich jedoch immer noch nicht wie ein echtes persistentes Zeichensystem. Für langes Geschichtenerzählen ist diese Einschränkung immer noch entscheidend.

So bereiten Sie sich auf Veo 4 vor

Es wurde kein offizielles Veröffentlichungsdatum für Veo 4 bekannt gegeben, aber Schöpfer und Entwickler können sich jetzt darauf vorbereiten, indem sie Fähigkeiten und Arbeitsabläufe aufbauen, die sauber übertragen werden, wenn das nächste Modell erscheint.

Beherrschen Sie Prompt Engineering für Veos aktuelle Architektur

Die beeindruckendste KI-Videoarbeit ist selten ein One-Shot-Wunder. Dies ist in der Regel das Ergebnis strukturierter Anweisungen, sorgfältiger Anweisungen und eines klaren Gespürs dafür, wie das Modell Kamerasprache, Beleuchtung, Tempo und Szenenlogik interpretiert.

Die Verwendung aktueller Veo 3.1-Workflows auf Seedance AI ist der schnellste Weg, diese Intuition aufzubauen. Testen Sie, wie das Modell mit Bewegungshinweisen, Fokusänderungen, Beleuchtungsadjektiven und Referenzbildern umgeht. Die Muster, die Sie jetzt lernen, werden wahrscheinlich direkt in jede zukünftige Veo-Version übernommen.

Denken Sie in Szenen, nicht in Clips

Die besten KI-Videoersteller denken nicht mehr in isolierten Ergebnissen. Sie denken in Reihenfolge, Berichterstattung, Kontinuität und redaktionellem Fluss. Noch bevor Veo 4 eintrifft, ist dieser mentale Wandel wichtig.

Shotlisten planen. Visuelle Systeme aufbauen. Kamerasprache wiederverwenden. Behandeln Sie jede Generation als Teil einer größeren Szene und nicht als eigenständigen sozialen Clip. Die Entwickler, die diese Denkweise frühzeitig anpassen, werden am meisten davon profitieren, wenn sich das Modellgedächtnis und die Generierungsdauer verbessern.

Diversifizieren Sie Ihr Toolset

Eine klare Lehre aus dem aktuellen Markt ist, dass kein einzelnes Modell jede Kategorie gewinnt. Ein praktischer Arbeitsablauf für 2026 könnte Folgendes umfassen:

- Veo für Kinoqualität und natives Audio

- Seedance für Bewegungsqualität und Experimente mit mehreren Modellen

- Runway für steuerungsintensive Bild-zu-Video-Aufgaben

- Kling für stilisierte oder animationsorientierte Ausgabe

Plattformen wie Seedance AI machen diese Strategie praktisch, indem sie Entwicklern einen Ort bieten, an dem sie Modelle vergleichen können, anstatt sich zu früh auf einen einzigen Anbieter-Workflow festzulegen.

Überwachen Sie offizielle Kanäle für den Zugriff

Wenn Veo 4 dem aktuellen Muster von Google folgt, wird der Zugriff wahrscheinlich durch eine Mischung aus Vorschauprogrammen, Produktintegrationen und API-Rollouts erweitert und nicht durch einen einzigen dramatischen Startmoment.

Die besten Orte zum Zuschauen sind:

- Google DeepMind-Ankündigungen

- Google AI Studio- und Gemini API-Updates

- Produktversionen YouTube und Google Ads

- Flow und zugehörige Google-Kreativwerkzeuge

Der breitere Marktkontext: Warum Veo 4 wichtig ist

Veo 4 ist nicht nur wichtig, weil es eine weitere starke Modellveröffentlichung sein könnte, sondern auch, weil es signalisieren könnte, wie das stabile Endspiel für KI-Video tatsächlich aussieht.

Die Ökonomie von KI-Videos

KI-Video ist rechenintensiv. Die überlebenden Modelle sind diejenigen, die eine starke Produktion mit Infrastrukturvorteilen und einer Verteilung kombinieren, die das Kostenprofil unterstützen kann. Google ist hier ungewöhnlich gut positioniert, da es den Cloud-Stack, die Hardware-Strategie und mehrere hochvolumige Oberflächen steuert, auf denen die Videogenerierung zu einem Feature und nicht zu einer eigenständigen Wette werden kann.

Dieser Infrastrukturvorsprung ist für kleinere Wettbewerber schwer zu erreichen. Wenn sich Veo 4 deutlich verbessert und gleichzeitig im Produktökosystem von Google verankert bleibt, wird es viel schwieriger, es zu verdrängen.

Das Demokratisierungsparadoxon

Wenn hochwertiges 4K-Video, synchronisiertes Audio und eine starke Regiesteuerung durch Textansagen und einfache Bearbeitung verfügbar werden, wird die technische Ausführung weniger knapp. Das macht kreative Arbeit nicht weniger wertvoll. Es macht Vision, Geschmack und Geschichtenerzählen wertvoller.

Dies ist das gleiche Muster, das sich auch in der Fotografie, im Design und im digitalen Publizieren abspielt. Wenn die Ausführung zugänglich wird, verlagert sich die Prämie auf die Menschen, die wissen, was sie sagen, was sie zeigen müssen und warum es wichtig sein sollte.

Der Integrationswettlauf

Es ist unwahrscheinlich, dass es sich bei den nächsten großen Gewinnern im Bereich KI um neuartige Apps für einen einzigen Zweck handelt. Es werden Unternehmen sein, die leistungsstarke Modelle in Produkten verstecken, die Menschen bereits täglich verwenden.

Deshalb ist Google hier wichtig. Ein zukünftiges Veo 4, das in YouTube-Erstellungstools, Anzeigenworkflows, Unternehmensproduktivität und Entwickler-APIs integriert ist, ist strategisch leistungsfähiger als ein Modell, das nur als eigenständige Demooberfläche existiert.

Was Veo 4 für verschiedene Benutzersegmente bedeutet

Content Creator und YouTuber

Für die Ersteller würden eine längere Clipdauer und ein stärkerer Ton die Anzahl der Produktionsschritte reduzieren, die für Erklärfilme, Kurzfilme, B-Rolls und narrative Einfügungen erforderlich sind. Wenn Veo in YouTube-Workflows integriert wird, könnten KI-generierte Sequenzen von der Neuheit zur normalen kreativen Infrastruktur übergehen.

Marketing- und Werbefachleute

Vermarkter profitieren am meisten von Geschwindigkeit und Variation. Die Möglichkeit, statische Produktressourcen schnell in mehrere testbare Videokonzepte umzuwandeln, ist bereits wertvoll. Längere Aufnahmen, bessere Kontinuität und stärkerer Ton würden KI-generierte Videos für die tatsächliche Kampagnenproduktion weitaus praktikabler machen als nur für grobe Modelle.

Entwickler und Produktteams

Der API-Zugriff ist der Punkt, an dem ein zukünftiger Veo 4 besonders bedeutsam werden könnte. Produktteams könnten Produktdemos, pädagogische Erklärungen, lokalisierte Videovarianten oder personalisierte Assets direkt in Apps erstellen. Die Stiftung Gemini API existiert bereits. Ein stärkeres Modell erweitert einfach das, was praktisch wird.

Filmemacher und Studios

Die traditionelle Produktion verschwindet nicht, aber Vorvisualisierung, Storyboarding, Tests und bestimmte Arten von generiertem Filmmaterial verlagern sich alle in Richtung KI-gestützter Arbeitsabläufe. Eine bessere Persistenz der Charaktere und eine bessere Regiekontrolle würden Veo für diese Produktionsumgebungen weitaus relevanter machen.

Vergleichstabelle: Veo 4 Erwartete Funktionen im Vergleich zu aktuellen Marktführern

| Besonderheit | Veo 4 (Erwartet) | Veo 3.1 (Aktuell) | Runway Gen-4.5 | Seedance 2.0 | Kling 3.0 |

|---|---|---|---|---|---|

| Maximale Dauer | 15-30 Sek | 4-8 Sek | Variable | 5-10 Sek | Variable |

| Auflösung | Native 4K | Native 4K | 1080p (4K gehobene Klasse) | Bis 4K | Ultra-HD |

| Natives Audio | Räumliche Intelligenz | Synchronisiert | Extern | Extern | Extern |

| Zeichenkonsistenz | Persistente IDs | Referenzbasiert | Gut | Referenzbasiert | Gut |

| Kamerasteuerung | Regiepräzision | Technische Richtlinien | Hoch | Mäßig | Mäßig |

| Zeitliche Konsistenz | Erweiterter Szenenspeicher | Ausgezeichnet (8 Sek.) | Sehr gut | Exzellent | Gut |

| Generationsgeschwindigkeit | Schnell (vorhergesagt) | Schnell | Mäßig | Mäßig | Schnell |

| API-Zugriff | Gemini API | Gemini API | API verfügbar | Beschränkt | API verfügbar |

| Ökosystemintegration | YouTube, Anzeigen, Workspace | Anzeigen, Workspace | Standalone | Standalone | Standalone |

| Am besten für | Rundum professionell | Filmischer Inhalt | Kreative Kontrolle | Bewegungsqualität | Animation |

Vorbereiten Ihres Arbeitsablaufs: Praktische Schritte

1. Experimentieren Sie mit den aktuellen Veo-Funktionen

Probieren Sie aktuelle Veo 3.1-Workflows aus und dokumentieren Sie, was passiert, wenn Sie Eingabeaufforderungen, Referenzen, Seitenverhältnisse oder Bewegungssprache ändern. Dieses praktische Verständnis ist wichtiger als abstrakte Spekulationen.

2. Erstellen Sie eine Prompt-Bibliothek

Pflegen Sie wiederverwendbare Eingabeaufforderungsstrukturen für:

- Kamerabewegung

- Beleuchtungsstile

- Charakterrahmen

- Produktpräsentationsaufnahmen

- Narrative Übergänge

- Atmosphäre und Klanghinweise

Wenn Veo 4 schließlich eintrifft, wird diese Bibliothek zu einem praktischen Betriebsvorteil.

3. Entwickeln Sie Multi-Modell-Workflows

Gehen Sie nicht davon aus, dass ein Modell alles kann. Erfahren Sie, wo Veo im Vergleich zu Seedance, Kling und Runway am besten abschneidet, und leiten Sie die Arbeit dann entsprechend weiter. So arbeiten die stärksten Schöpfer bereits.

4. Investieren Sie in Postproduktionsfähigkeiten

Die Qualität der Generation steigt, aber Schnitt, Tempo, Klangpolitur und narrativer Aufbau unterscheiden immer noch gute Arbeit von unvergesslicher Arbeit. Die Gewinner von KI-Videos sind nicht nur die Leute mit den cleversten Eingabeaufforderungen. Sie sind diejenigen, die rohe Generationen in fertige Kommunikation verwandeln können.

5. Achten Sie sorgfältig auf Lizenzen und Rechte

Je kommerziell rentabler KI-generierte Videos werden, desto wichtiger werden Rechte, Lizenzen und die Rückverfolgbarkeit von Inhalten. Der SynthID von Google und ähnliche Wasserzeichenansätze werden mit zunehmender Akzeptanz wahrscheinlich mehr und nicht weniger wichtig sein.

Der Weg in die Zukunft: Vorhersagen für 2026 und darüber hinaus

Mehrere Trends scheinen nun immer wahrscheinlicher zu werden:

Google wird Veo weiterhin in Produkte drängen, nicht nur in Vorschauen. Der strategischste Weg ist eine tiefere YouTube-, Anzeigen- und Workspace-Integration statt einer reinen eigenständigen Verbraucher-Destination.

Plattformen mit mehreren Modellen werden weiter an Bedeutung gewinnen. Entwickler wollen keine Anbieterbindung, wenn sich die Modellstärken ständig ändern. Einheitliche Zugriffsebenen bleiben wertvoll.

Die Qualität des Rohmodells wird sich annähern. Der Unterschied zwischen Top-Tier-Systemen wird kleiner. Workflow-Design, Integration, Kosteneffizienz und Ökosystemvorteile werden wichtiger.

Die Konsistenz der Erzählung wird zur nächsten wirklichen Grenze. Sobald kurze Clips durchweg gut aussehen, wird die entscheidende Herausforderung zur Kohärenz in längerer Form: wiederkehrende Charaktere, stabile Welten und emotionale Kontinuität.

Audio-Realismus wird zu einem größeren Unterscheidungsmerkmal. Ein sauberer, räumlich glaubhafter Ton kann ein Video von einer „guten KI-Ausgabe“ zu etwas machen, das sich produktionsbereit anfühlt.

Fazit: Warum Veo 4 einen Wendepunkt darstellt

Veo 4 ist wichtig, weil es auf die nächste Phase der KI-Videogenerierung hinweist: länger, sauberer, kontrollierbarer und tiefer in Tools integriert, die Menschen bereits verwenden. Wenn Google die aktuellen Stärken von Veo in Bezug auf Kinoqualität und natives Audio mit längerer Dauer, dauerhaftem Charakterspeicher und stärkerer Regiesteuerung kombinieren kann, wird es KI-Video näher an die alltägliche Produktionsinfrastruktur heranführen.

Für YouTuber, Vermarkter und Entwickler besteht der strategische Schritt nicht darin, passiv auf die nächste Ankündigung zu warten. Es geht darum, jetzt mit dem Aufbau der Arbeitsabläufe zu beginnen: aktuelle Modelle testen, Ergebnisse vergleichen, Prompt-Systeme organisieren und einen Produktionsprozess entwickeln, der bessere Werkzeuge aufnehmen kann, sobald sie eintreffen.

Die Zukunft der Videoerstellung wird nicht den Menschen gehören, die einfach Zugang zum besten Modell haben. Es wird den Leuten gehören, die wissen, wie man diesen Zugang in klare kreative Entscheidungen, schnelle Iteration und fertige Arbeit umwandelt, die tatsächlich etwas kommuniziert.

Wenn Sie sich schon jetzt auf Veo 4 vorbereiten möchten, bietet Seedance AI eine praktische Möglichkeit, Veo mit anderen führenden Videomodellen zu vergleichen, Prompts zu schärfen und einen Workflow aufzubauen, der für die nächste Modellgeneration bereit ist.