Die Landschaft der KI-Videogenerierung hat im Jahr 2026 einen entscheidenden Wendepunkt erreicht. Zwei Modelle dominieren nun das Gespräch unter Kreativen, Vermarktern und Entwicklern: Seedance 2.0 von ByteDance und Sora 2 von OpenAI. Beide stellen bedeutende Sprünge in der Videosynthesetechnologie dar, dienen jedoch grundlegend unterschiedlichen kreativen Philosophien und Produktionsworkflows.

Dieser umfassende Vergleich untersucht beide Modelle in kritischen Dimensionen – technische Fähigkeiten, reale Leistungsbenchmarks, Community-Feedback und praktische Anwendungsfälle –, um Ihnen zu helfen, eine fundierte Entscheidung zu treffen, welches Tool Ihren Videoproduktionsanforderungen am besten entspricht.

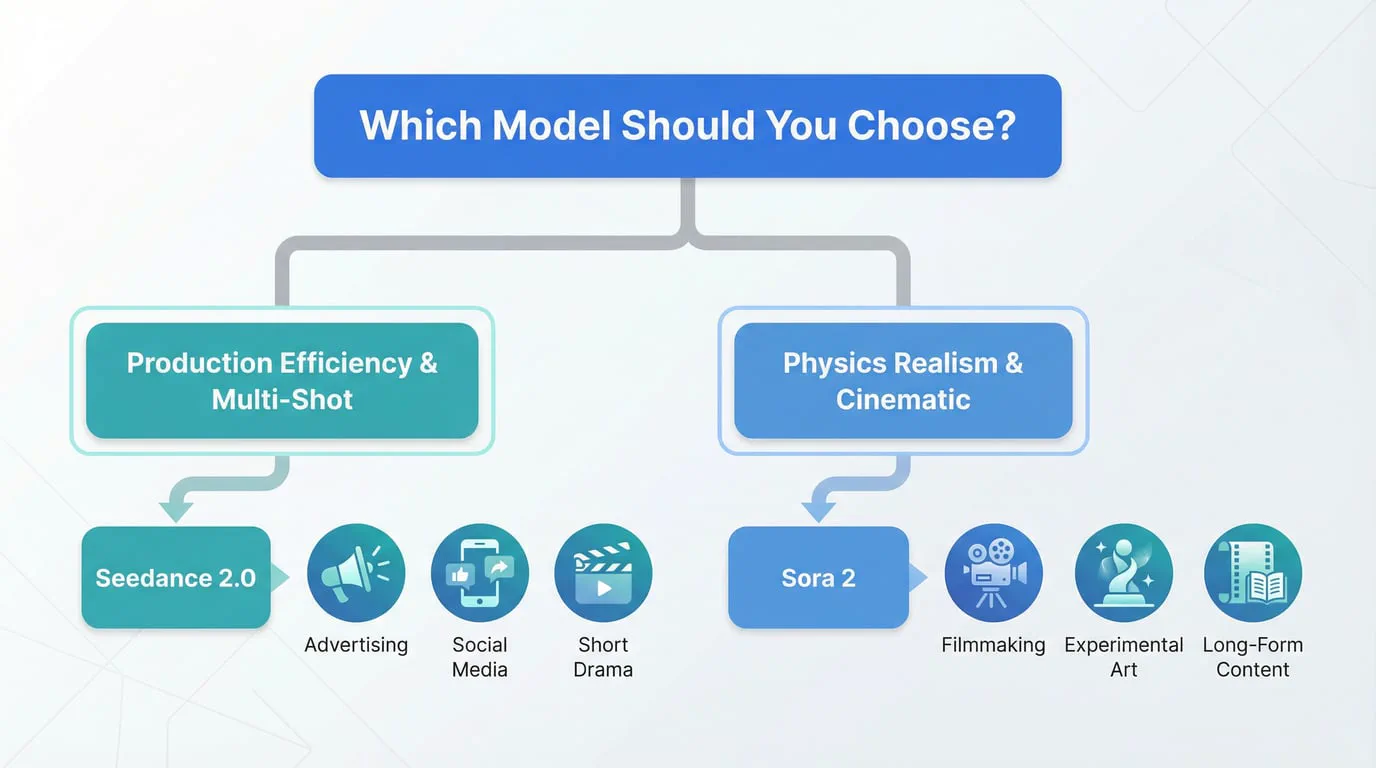

Die Kernphilosophie verstehen: Produktionseffizienz vs. Physiksimulation

Bevor wir in die technischen Spezifikationen eintauchen, ist es wichtig, die grundlegende Designphilosophie zu verstehen, die diese beiden Modelle unterscheidet.

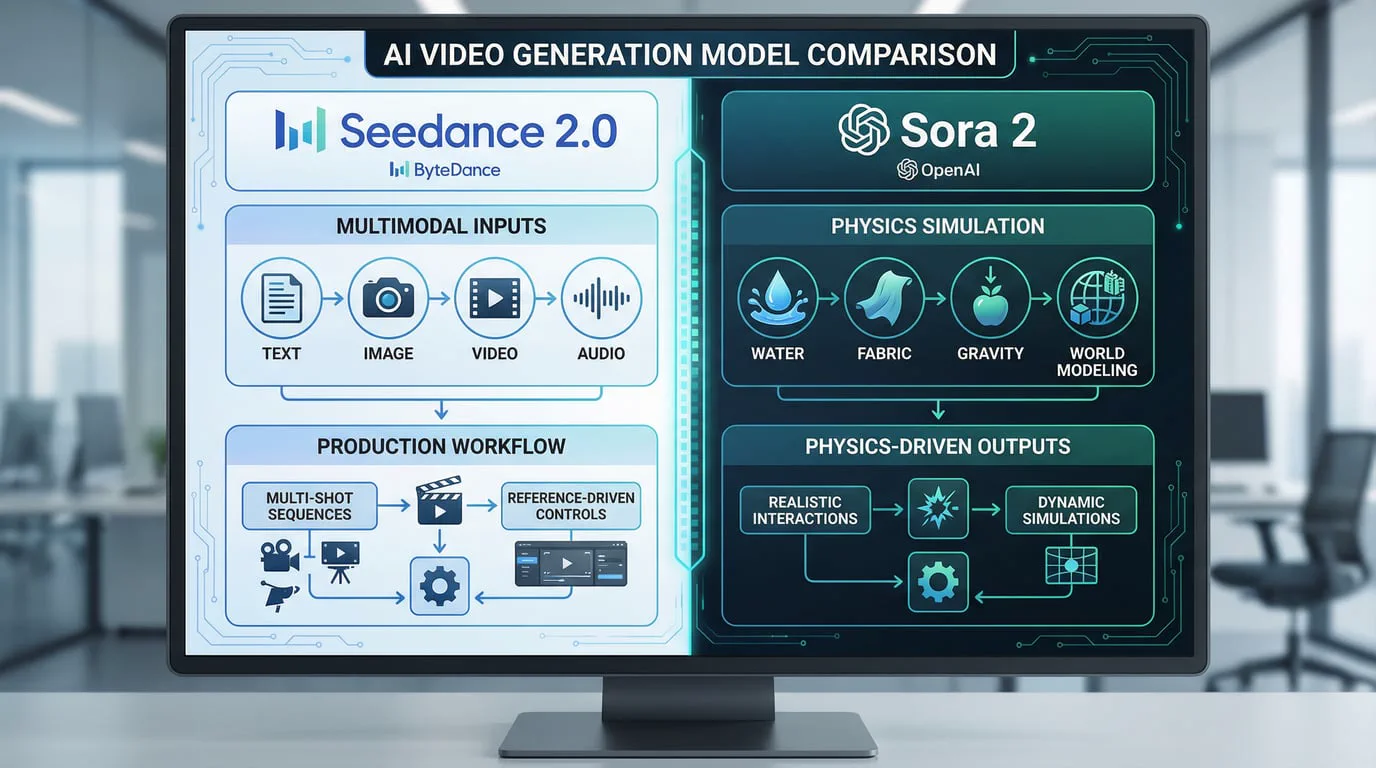

Seedance 2.0 positioniert sich als produktionsorientierte Engine für schnelle Iteration und kommerzielle Workflows. ByteDance hat dieses Modell mit Blick auf Content-Ersteller, Werbeagenturen und Social-Media-Produzenten entwickelt. Der Schwerpunkt liegt auf der Generierung von Multi-Shot-Narrativen, referenzgesteuerter Kontrolle und nahtloser Integration in bestehende kreative Pipelines. Wenn Sie schnell mehrere Varianten von Marketinginhalten produzieren, die Charakterkonsistenz über Szenen hinweg beibehalten oder Videos generieren müssen, die nur minimale Nachbearbeitung erfordern, liefert Seedance 2.0 genau diese Workflow-Optimierung.

Sora 2 hingegen repräsentiert OpenAIs Engagement für Weltsimulation und physikbasierten Realismus. Dieses Modell zeichnet sich durch das Verständnis und die Replikation der grundlegenden Gesetze der Physik aus – Schwerkraft, Impuls, Strömungsdynamik, Lichtbrechung und Materialeigenschaften. Wenn Ihre kreative Vision beispiellose visuelle Wiedergabetreue, komplexe physikalische Interaktionen oder experimentelle filmische Sequenzen erfordert, die die Grenzen des Möglichen verschieben, bietet Sora 2 die Rechenleistung und Simulationsgenauigkeit, um diese Ergebnisse zu erzielen.

Die Wahl zwischen diesen Modellen ist keine Frage davon, welches absolut gesehen "besser" ist. Es geht darum, das Tool an Ihre spezifischen Produktionsanforderungen und kreativen Ziele anzupassen.

Technische Fähigkeiten: Ein tiefer Einblick in Leistungsmetriken

Multimodale Eingabearchitektur

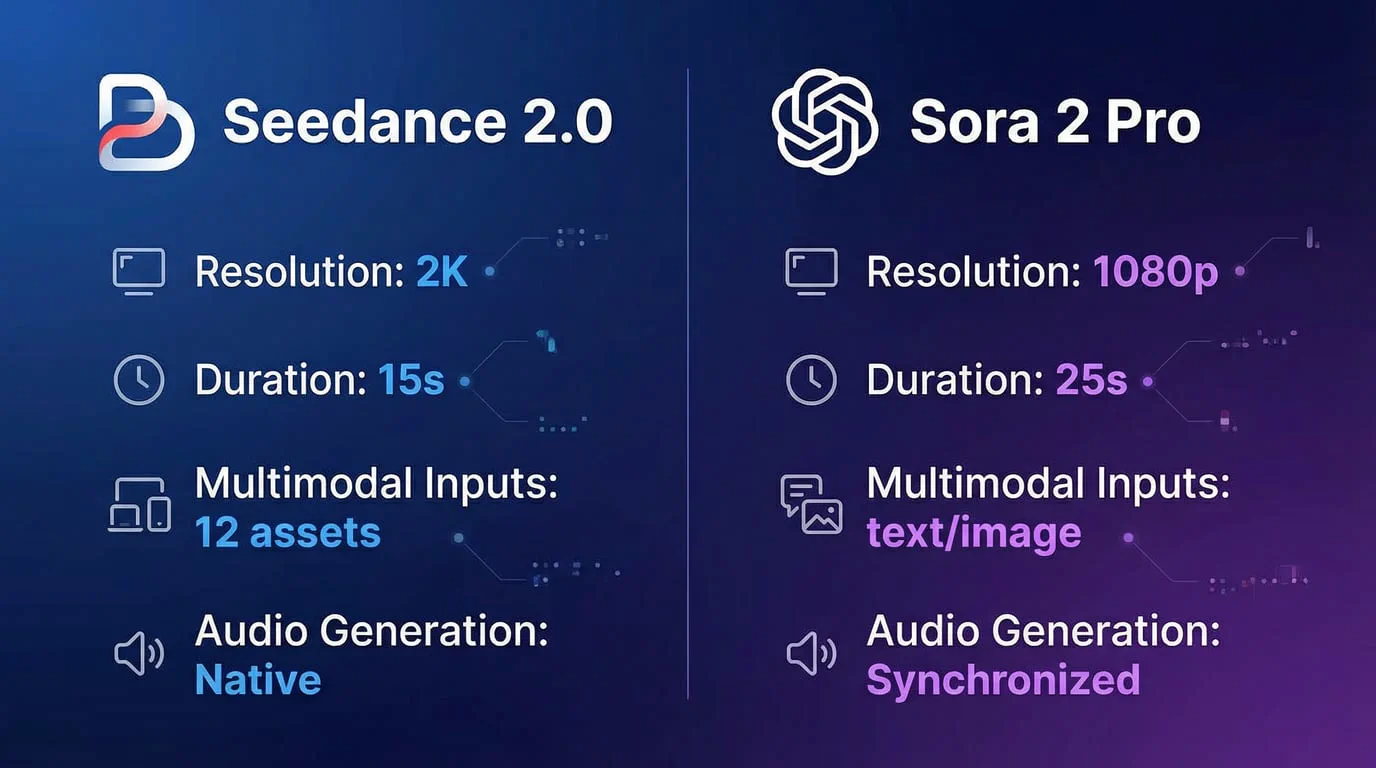

Seedance 2.0 führt das ein, was ByteDance "quad-modale Eingabe" nennt, einen revolutionären Ansatz, der Text-, Bild-, Video- und Audioreferenzen gleichzeitig innerhalb eines einzigen Generierungsworkflows akzeptiert. Diese Fähigkeit verändert die Herangehensweise von Kreativen an die Videoproduktion. Sie können ein Referenzvideo für Bewegungsdynamik, eine Audiospur für Rhythmus-Synchronisation, ein Charakterbild für Erscheinungskonsistenz und einen Text-Prompt für die Szenenbeschreibung bereitstellen – alles in einer einzigen, einheitlichen Anfrage. Das Modell synthetisiert diese unterschiedlichen Eingaben zu einer kohärenten Ausgabe, die jede Referenzdimension respektiert.

Diese multimodale Architektur erweist sich als besonders wertvoll für Produktionsszenarien, die präzise kreative Kontrolle erfordern. Tanzvideo-Ersteller können Choreografien aus bestehenden Clips referenzieren und gleichzeitig ihre eigenen Charaktere einsetzen. Werbeagenturen können die visuelle Identität der Marke wahren, indem sie Stilreferenzbilder bereitstellen und gleichzeitig völlig neue Szenarien generieren. Das System versteht nicht nur, was jede Eingabe darstellt, sondern auch, wie diese Elemente interagieren und sich im endgültigen Output ergänzen sollten.

Sora 2 verfolgt einen traditionelleren, aber hochgradig verfeinerten Ansatz bei der Eingabeverarbeitung. Das Modell akzeptiert Text-Prompts und einzelne Bildreferenzen, wobei die jüngsten Ergänzungen die "Cameo"-Funktion umfassen, die es Benutzern ermöglicht, persönliche Fotos für die Charakterintegration hochzuladen. Obwohl dies weniger Eingabemodalitäten als Seedance 2.0 darstellt, kompensiert Sora 2 dies durch außergewöhnliches Prompt-Verständnis und die Fähigkeit, komplexe physikalische Verhaltensweisen aus minimaler Textbeschreibung abzuleiten. Das Modell zeigt bemerkenswerte Fähigkeiten im Verständnis impliziter Anforderungen – wenn Sie "spritzendes Wasser" beschreiben, animiert es nicht nur die Flüssigkeitsbewegung, sondern simuliert auch Oberflächenspannung, Tropfenbildung und Lichtbrechung durch Wasser genau.

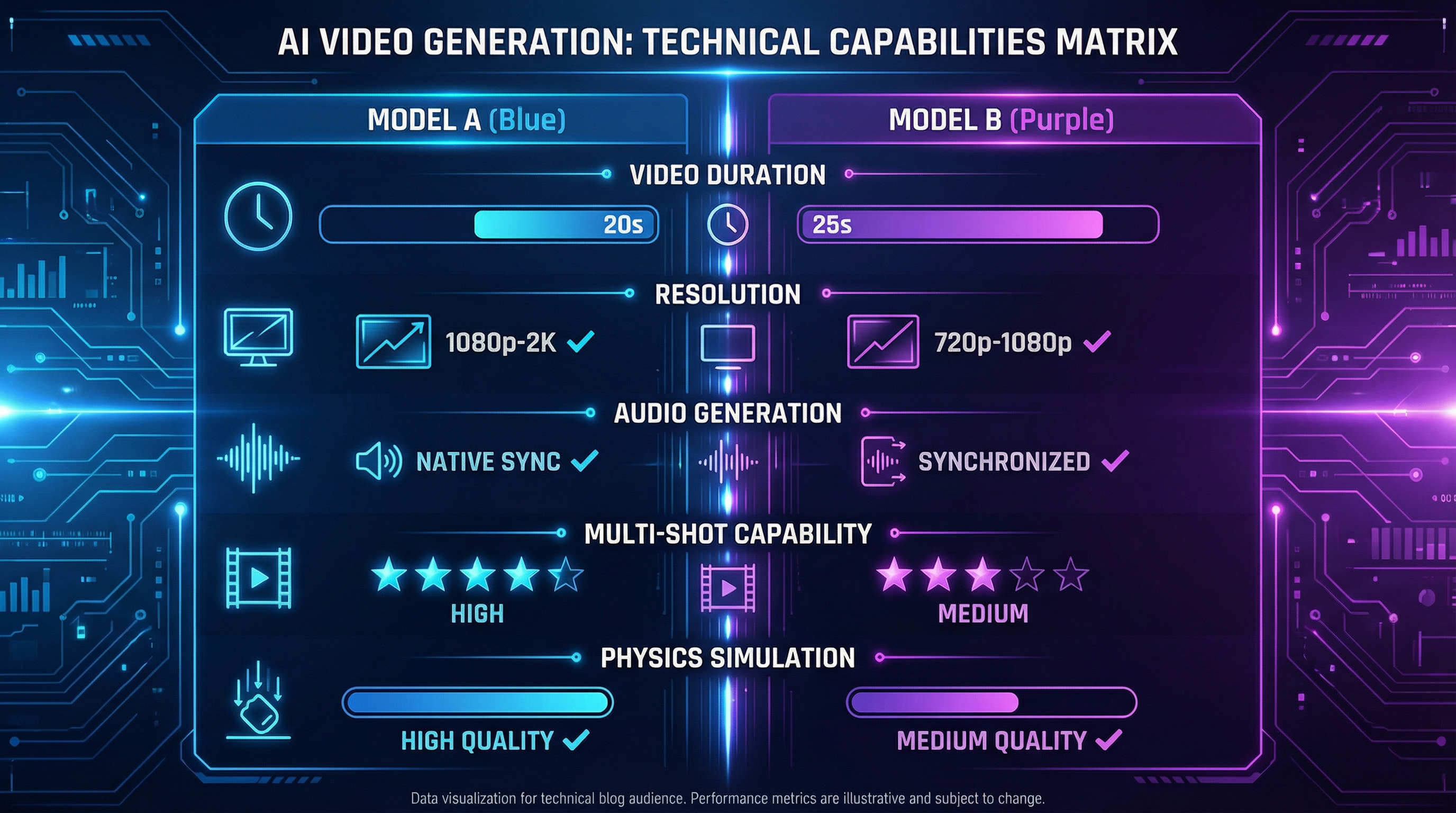

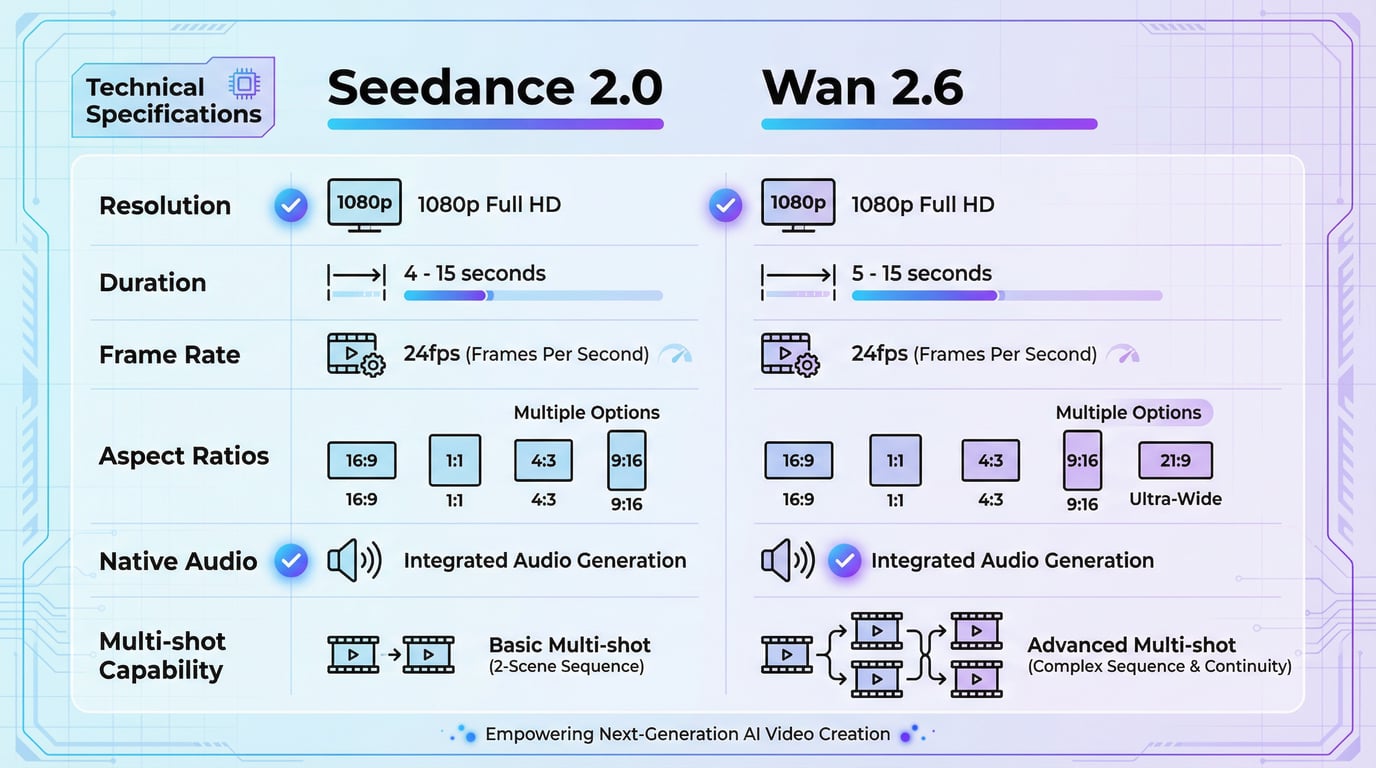

Videospezifikationen: Dauer und Auflösung

Seedance 2.0 generiert Videos mit einer Länge von bis zu 20 Sekunden in Auflösungen bis zu 2160p (4K) im höchsten Qualitätsmodus. Die Standardausgabe liefert eine Auflösung von 1080p, was die überwiegende Mehrheit der Anforderungen für soziale Medien, Werbung und kommerzielle Videos erfüllt. Die Dauer von 20 Sekunden erweist sich als ideal für Instagram Reels, TikTok-Inhalte, YouTube Shorts und Werbespots – die heute dominierenden Formate im digitalen Marketing.

Sora 2 erweitert die Videogenerierung auf maximal 25 Sekunden, mit Auflösungsfähigkeiten von 480p (ChatGPT Plus-Tier) bis 1080p (ChatGPT Pro-Tier) und bis zu 1792×1024 Pixel über API-Zugriff. Die zusätzlichen fünf Sekunden mögen marginal erscheinen, aber für narratives Geschichtenerzählen und filmische Sequenzen bietet diese zusätzliche Dauer entscheidenden Raum für Establishing Shots, Charakterentwicklung und emotionales Pacing. Die Stärke des Modells liegt nicht in den rohen Auflösungszahlen, sondern in der visuellen Kohärenz und physikalischen Genauigkeit, die über die gesamte Dauer beibehalten wird.

Native Audio-Visuelle Synchronisation

Eine der bedeutendsten Innovationen von Seedance 2.0 ist die native audio-visuelle Generierung. Im Gegensatz zu den meisten KI-Videomodellen, die stumme Clips generieren und eine separate Audioproduktion erfordern, synthetisiert Seedance 2.0 synchronisierten Ton zusammen mit Videoinhalten. Das System produziert Dialoge mit phonemgenauer Lippensynchronisation in mehreren Sprachen, Umgebungsklanglandschaften, die zur Szenenatmosphäre passen, und Echtzeit-Soundeffekte, die genau den Aktionen auf dem Bildschirm entsprechen. Wenn eine Tür im Video schließt, hören Sie das entsprechende Schließgeräusch genau im Moment des Kontakts. Wenn Charaktere sprechen, richten sich ihre Mundbewegungen auf Phonemebene nach dem generierten Dialog aus – nicht nur ungefähres Timing, sondern tatsächliche Artikulationsgenauigkeit.

Diese Fähigkeit eliminiert eine ganze Phase des Postproduktions-Workflows. Traditionelle Videoproduktion erfordert das separate Aufnehmen oder Beschaffen von Audio und dann das manuelle Synchronisieren von Soundeffekten, Dialogen und Umgebungsaudio mit visuellen Elementen. Seedance 2.0 handhabt diese Integration automatisch, was die Produktionszeit und technische Komplexität drastisch reduziert.

Sora 2 verfügt ebenfalls über synchronisierte Audiogenerierung und produziert Dialoge, Soundeffekte und Hintergrundklanglandschaften mit hohem Realismus. OpenAIs Implementierung konzentriert sich auf Audioqualität und Umweltgenauigkeit – die Akustik einer Kathedrale klingt angemessen hallend, Außenszenen enthalten angemessene Umgebungsgeräusche, und Soundeffekte zeigen eine korrekte räumliche Positionierung. Während beide Modelle Audiogenerierung bieten, gibt die phonemgenaue Lippensynchronisation von Seedance 2.0 ihm einen deutlichen Vorteil für dialoglastige Inhalte und charaktergetriebene Narrative.

Multi-Shot-Konsistenz und narrative Kontinuität

Seedance 2.0 wurde speziell für Multi-Shot-Storytelling entwickelt. Das Modell behält Charakteraussehen, visuellen Stil, Lichtkonsistenz und atmosphärische Kontinuität über Szenenübergänge hinweg innerhalb eines einzigen Generierungsworkflows bei. Dies adressiert eine der hartnäckigsten Herausforderungen in der KI-Videogenerierung: Die Aufrechterhaltung der visuellen Kohärenz beim Schnitt zwischen verschiedenen Aufnahmen oder Kamerawinkeln.

Für die kommerzielle Videoproduktion erweist sich diese Fähigkeit als transformativ. Sie können eine komplette 20-sekündige Anzeige mit mehreren Kamerawinkeln, Szenenwechseln und Charakterinteraktionen generieren und dabei perfekte visuelle Konsistenz wahren. Das Modell versteht filmische Konventionen wie Establishing Shots, Nahaufnahmen und Reaktionsaufnahmen und generiert angemessene Übergänge, die sich professionell geschnitten und nicht künstlich aneinandergereiht anfühlen.

Sora 2 handhabt Szenenkonsistenz anders. Während es hervorragend darin ist, Kohärenz innerhalb einer einzigen kontinuierlichen Aufnahme zu wahren, erfordert die Generierung mehrerer unterschiedlicher Szenen mit konsistenten Charakteren typischerweise separate Generierungsdurchläufe. Die Stärke des Modells liegt in erweiterten Single-Shot-Sequenzen mit komplexen Kamerabewegungen und sich entwickelnder Handlung. Für eine 25-sekündige Tracking-Aufnahme, die einem Charakter durch mehrere Umgebungen folgt, liefert Sora 2 unübertroffene Kontinuität und physikalische Plausibilität.

Physiksimulation und Weltmodellierung

Diese Dimension repräsentiert den bedeutendsten Wettbewerbsvorteil von Sora 2. OpenAI investierte massiv in physikbasierte Weltsimulation, was dem Modell ermöglicht, komplexe physikalische Phänomene mit außergewöhnlicher Genauigkeit zu verstehen und zu replizieren. Wenn Sie einen springenden Basketball prompten, berechnet Sora 2 die entsprechende Verformung beim Aufprall, die genaue Flugbahn basierend auf Schwerkraft und Impuls sowie die realistische Rotation während des Flugs. Wasser fließt mit korrekter Strömungsdynamik, Stoff fällt und bewegt sich gemäß Materialeigenschaften und Windkräften, und Licht interagiert mit Oberflächen durch genaue Reflexion, Brechung und Schattenwurf.

Unabhängige Bewertungen stufen Sora 2 konsequent als Branchenführer im physikalischen Realismus ein. Wenn Ihre kreative Vision glaubwürdige Physik erfordert – Athleten, die komplexe Bewegungen ausführen, Naturphänomene wie Wetter und Wasser oder mechanische Systeme mit interagierenden Teilen –, liefert Sora 2 eine Simulationsqualität, die sich der fotorealistischen Genauigkeit annähert.

Seedance 2.0 demonstriert starke physikalische Simulationsfähigkeiten, was eine signifikante Verbesserung gegenüber früheren Versionen darstellt. Das Modell handhabt Schwerkraft, Impuls und grundlegende Kausalität hervorragend. Objekte fallen realistisch, Charaktere bewegen sich mit angemessenem Gewicht und Trägheit, und einfache physikalische Interaktionen wirken überzeugend. In hochkomplexen Szenarien mit mehreren interagierenden physikalischen Systemen jedoch – wie ein Charakter, der ins Wasser taucht, während Stoff im Wind weht – behält Sora 2 eine überlegene Genauigkeit und visuelle Glaubwürdigkeit bei.

Für die Mehrheit der kommerziellen Videoanwendungen erweist sich die Physiksimulation von Seedance 2.0 als völlig ausreichend. Social-Media-Inhalte, Werbung, Produktdemonstrationen und narratives Geschichtenerzählen erfordern selten die extreme physikalische Genauigkeit, die Sora 2 auszeichnet. Der Unterschied wird hauptsächlich in Randfällen deutlich: experimentelle Kunstfilme, wissenschaftliche Visualisierung oder filmische Sequenzen, die speziell zur Darstellung physikalischer Phänomene entwickelt wurden.

Benchmark-Leistung: VBench und reale Tests

Die objektive Bewertung von KI-Videomodellen erfordert standardisierte Benchmark-Frameworks. VBench, die umfassendste Suite für Videogenerierungs-Benchmarks, bewertet Modelle in mehreren Dimensionen, einschließlich ästhetischer Qualität, Hintergrundkonsistenz, dynamischem Grad, Bildgebungsqualität, Bewegungsglätte und Subjektkonsistenz.

Laut aktuellen VBench-Bewertungen hat sich der Leistungsabstand zwischen führenden Modellen dramatisch verringert. Open-Sora 2.0 (eine Open-Source-Implementierung) reduzierte seinen Leistungsabstand zu OpenAIs Sora von 4,52 % auf nur 0,69 %, was zeigt, dass die Videogenerierungstechnologie eine Reifeschwelle erreicht hat, an der mehrere Modelle vergleichbare Qualitätsniveaus erreichen.

Unabhängige Tests unter neun führenden KI-Videomodellen Anfang 2026 offenbarten nuancierte Leistungsmerkmale. Sora 2 rangierte konsequent am höchsten für physikalischen Realismus und Langform-Kontinuität. Seedance 2.0 glänzte bei der Prompt-Einhaltung, Multi-Shot-Konsistenz und produktionsfertigem Output, der minimale Bearbeitung erfordert. Googles Veo 3.1 erzielte Spitzenwerte für die allgemeine visuelle Qualität und Beleuchtungsgenauigkeit, während andere Modelle wie Runway Gen-4 und Kling 2.6 in spezifischen Anwendungsfällen eine wettbewerbsfähige Leistung zeigten.

Reale Nutzertests bieten über Benchmark-Scores hinaus zusätzlichen Kontext. Content-Ersteller berichten, dass Seedance 2.0 dank seines referenzgesteuerten Kontrollsystems typischerweise weniger Generierungsversuche erfordert, um gewünschte Ergebnisse zu erzielen. Durch die Bereitstellung visueller Referenzen für Stil, Bewegung und Charakteraussehen erzielen Kreative im Vergleich zu rein textbasierten Prompts vorhersehbarere Ergebnisse. Dies führt direkt zu Kosteneinsparungen und schnelleren Produktionszeiten.

Sora 2-Benutzer betonen die Fähigkeit des Modells, komplexe, abstrakte Prompts zu verarbeiten, die andere Modelle nur schwer interpretieren können. Bei der Beschreibung surrealer Szenarien, experimenteller visueller Konzepte oder komplexer physikalischer Interaktionen zeigt Sora 2 überlegenes Prompt-Verständnis und kreative Interpretation. Diese Raffinesse geht jedoch mit erhöhter Generierungszeit einher – Sora 2 erfordert typischerweise eine längere Verarbeitung als Seedance 2.0 für eine gleichwertige Videodauer.

Community-Feedback und reale Produktionserfahrung

Jenseits von technischen Spezifikationen und Benchmark-Scores kommen die wertvollsten Erkenntnisse von Kreativen, die diese Modelle aktiv in Produktionsumgebungen nutzen. Community-Feedback von Reddit, YouTube, Twitter und professionellen Kreativforen offenbart deutliche Muster in der Benutzererfahrung und Zufriedenheit.

Seedance 2.0 Community-Rezeption

Die Creator-Community hat enthusiastisch auf den produktionsorientierten Ansatz von Seedance 2.0 reagiert. Mehrere YouTube-Ersteller haben Hands-on-Reviews veröffentlicht, in denen das Modell als "ALLES ZERSTÖREND" beschrieben wird und festgestellt wird, dass es "jedes andere KI-Videomodell vernichtet", was die praktische Nutzbarkeit für Content-Produktionsworkflows betrifft.

Lob für Produktionseffizienz: Content-Ersteller heben immer wieder die Fähigkeit von Seedance 2.0 hervor, produktionsfertigen Output mit minimaler Iteration zu generieren. Ein Reddit-Nutzer berichtete, einen 10-minütigen Minifilm in etwa 8 Stunden Arbeit erstellt zu haben, und bemerkte, dass die Multi-Shot-Konsistenz Stunden manueller Bearbeitung eliminierte, die normalerweise beim Zusammenfügen separat generierter Clips erforderlich wären. Der referenzgesteuerte Workflow erhält besonderes Lob – Kreative schätzen die Fähigkeit, dem Modell durch visuelle Beispiele genau zu zeigen, was sie wollen, anstatt mit Text-Prompt-Engineering zu kämpfen.

Auswirkung der Audio-Integration: Die native audio-visuelle Synchronisationsfähigkeit hat die Workflows für viele Kreative grundlegend verändert. Social-Media-Produzenten berichten, dass die Eliminierung der separaten Audioproduktions- und Synchronisationsphase ihre Gesamtproduktionszeit um 40-50 % reduziert. Tanz-Content-Ersteller loben speziell die Rhythmus-Synchronisationsfunktion, die es ihnen ermöglicht, eine Musikspur bereitzustellen und die generierten Videobewegungen automatisch an die Beatstruktur anzupassen.

Durchbruch im Multi-Shot-Storytelling: Werbeagenturen und kommerzielle Videoproduzenten identifizieren Multi-Shot-Konsistenz als das wertvollste Feature von Seedance 2.0. Die Fähigkeit, vollständige narrative Sequenzen mit mehreren Kamerawinkeln zu generieren und dabei Charakteraussehen und visuellen Stil beizubehalten, adressiert das, was zuvor die bedeutendste Einschränkung in der KI-Videogenerierung war. Ein Marketingprofi beschrieb es als "endlich eine KI zu haben, die versteht, wie ein Werbespot tatsächlich aussehen muss".

Feedback zur Lernkurve: Benutzer merken an, dass die multimodale Schnittstelle von Seedance 2.0 etwas anfängliches Lernen erfordert, um effektiv genutzt zu werden, aber die Investition zahlt sich aus. Kreative, die sich Zeit nehmen, um zu verstehen, wie man Referenzeingaben richtig strukturiert, berichten von dramatisch besseren Ergebnissen als diejenigen, die sich ausschließlich auf Text-Prompts verlassen.

Sora 2 Community-Rezeption

Sora 2 hat in der experimentellen und künstlerischen Creator-Community erhebliche Begeisterung ausgelöst, mit besonderem Enthusiasmus von Filmemachern und bildenden Künstlern, die kreative Grenzen verschieben.

Anerkennung für physikalischen Realismus: Das konsistente Feedback-Thema rund um Sora 2 konzentriert sich auf dessen außergewöhnliche Physiksimulation. Kreative, die komplexe physikalische Szenarien versuchen – Athleten, die Gymnastik ausführen, Strömungsdynamik, Stoffsimulation –, berichten, dass Sora 2 Ergebnisse liefert, die andere Modelle nicht erreichen können. Ein Filmemacher beschrieb das Generieren einer Sequenz eines olympischen Turners, der eine Bodenübung durchführt, und bemerkte, dass "Gewicht, Impuls und Körpermechanik so genau waren, dass es wie Motion-Capture-Daten aussah".

Tiefe des Prompt-Verständnisses: Benutzer betonen die Fähigkeit von Sora 2, komplexe, abstrakte Prompts zu verstehen und auszuführen, die andere Modelle verwirren. Bei der Beschreibung surrealer Szenarien, experimenteller visueller Konzepte oder komplexer Szenenkompositionen zeigt Sora 2 überlegene kreative Interpretation. Diese Raffinesse hat jedoch ihren Preis – die Generierungszeiten sind deutlich länger als bei Seedance 2.0, wobei komplexe Prompts manchmal 10-15 Minuten Verarbeitungszeit erfordern.

Kinematografische Qualität für Kunstprojekte: Experimentelle Filmemacher und bildende Künstler wählen konsequent Sora 2 für Projekte, bei denen visuelle Qualität und physikalische Genauigkeit oberste Priorität haben. Die Fähigkeit des Modells, Kohärenz über lange Single-Shot-Sequenzen mit komplexen Kamerabewegungen zu wahren, erhält besonderes Lob von auf Kinematografie fokussierten Kreativen.

**Herausforderungen bei der Iteration: **Einige Benutzer berichten, dass das Erreichen gewünschter Ergebnisse mit Sora 2 im Vergleich zum referenzgesteuerten Ansatz von Seedance 2.0 mehr Generierungsversuche erfordert. Ohne die Möglichkeit, visuelle Referenzen für spezifische Stilelemente bereitzustellen, verlassen sich Kreative vollständig auf die Verfeinerung von Text-Prompts, was weniger vorhersehbar sein kann.

Vergleichende Analyse der Nutzerstimmung

Die Analyse von Community-Diskussionen über Plattformen hinweg offenbart unterschiedliche Nutzerprofile, die zu jedem Modell tendieren:

Seedance 2.0 Hauptnutzer: Social-Media-Content-Ersteller, Werbeagenturen, E-Commerce-Unternehmen, Tanz- und Musikvideoproduzenten und alle, die Produktionseffizienz und Ausgabevolumen priorisieren. Diese Benutzer schätzen vorhersehbare Ergebnisse, schnelle Iteration und fertige Videos, die minimale Nachbearbeitung erfordern.

Sora 2 Hauptnutzer: Experimentelle Filmemacher, bildende Künstler, Ersteller von Inhalten für Premiummarken, Fachleute für wissenschaftliche Visualisierung und Kreative, deren Projekte längere Generierungszeiten im Austausch für maximale visuelle Wiedergabetreue und physikalische Genauigkeit rechtfertigen.

Gemeinsamkeiten: Beide Communities erkennen an, dass die KI-Videogenerierung eine kritische Schwelle von "beeindruckender Demo" zu "produktionsreifem Werkzeug" überschritten hat. Die Debatte dreht sich nicht mehr darum, ob KI-Video machbar ist, sondern welches Tool spezifische kreative Ziele am besten bedient.

Praktische Anwendungsfälle: Modelle an Produktionsanforderungen anpassen

Wann Seedance 2.0 glänzt

Social-Media-Content-Produktion: Die Kombination aus 20 Sekunden Dauer (perfekt für Reels, TikTok, Shorts), Multi-Shot-Fähigkeit, naiver Audiogenerierung und erschwinglicher Preisgestaltung macht Seedance 2.0 zur optimalen Wahl für Social-Media-Ersteller. Generieren Sie schnell mehrere Inhaltsvariationen, bewahren Sie Charakterkonsistenz in Ihrer Inhaltsbibliothek und produzieren Sie fertige Videos ohne zusätzliche Audiobearbeitung.

Werbe- und Marketingvideos: Kommerzielle Videoproduktion erfordert schnelle Iteration, Markenkonsistenz und Kosteneffizienz. Der referenzgesteuerte Workflow von Seedance 2.0 ermöglicht es Agenturen, die visuelle Identität der Marke zu wahren und gleichzeitig mehrere Kampagnenvariationen zu generieren. Die Multi-Shot-Fähigkeit ermöglicht komplette Werbenarrative innerhalb einzelner Generierungsdurchläufe, was die Produktionszeitpläne dramatisch verkürzt.

E-Commerce-Produktvideos: Produktdemonstrationen, Funktions-Highlights und Lifestyle-Inhalte für E-Commerce-Plattformen profitieren von der Produktionseffizienz von Seedance 2.0. Generieren Sie mehrere Produktvideos über verschiedene Szenarien hinweg, bewahren Sie ein konsistentes Produktaussehen und produzieren Sie professionelle Qualität im großen Maßstab.

Kurzform-Narrative Inhalte: Webserien, Episodeninhalte und kurze Dramaproduktionen nutzen die Multi-Shot-Konsistenz und Charakterkontinuität von Seedance 2.0. Bewahren Sie visuelle Kohärenz über Episoden hinweg, generieren Sie effizient mehrere Szenen und produzieren Sie dialoglastige Inhalte mit automatischer Lippensynchronisation.

Bildungs- und Tutorial-Videos: Lehrinhalte, die klare visuelle Kommunikation, mehrere Demonstrationswinkel und erklärende Narration erfordern, profitieren von den multimodalen Fähigkeiten und der nativen Audiogenerierung von Seedance 2.0.

Wann Sora 2 glänzt

Film und experimenteller Film: Projekte, die visuelle Kunstfertigkeit, physikalischen Realismus und kreatives Experimentieren priorisieren, profitieren von Sora 2s überlegener Physiksimulation und Weltmodellierung. Das Modell handhabt abstrakte Konzepte, surreale Szenarien und komplexe physikalische Interaktionen, die andere Modelle nur schwer interpretieren können.

Wissenschaftliche und technische Visualisierung: Wenn Genauigkeit bei physikalischen Phänomenen wichtig ist – Demonstration mechanischer Systeme, natürlicher Prozesse oder wissenschaftlicher Konzepte – bietet die physikbasierte Simulation von Sora 2 die notwendige Präzision und Glaubwürdigkeit.

Langform-Single-Shot-Sequenzen: Erweiterte Tracking-Shots, kontinuierliche Action-Sequenzen und filmische Kamerabewegungen zeigen die Stärke von Sora 2 bei der Aufrechterhaltung der Kohärenz über längere Zeiträume. Die maximale Dauer von 25 Sekunden bietet entscheidende zusätzliche Zeit für Establishing Shots und narratives Pacing.

High-Fidelity-Markeninhalt: Premiummarken, die maximale visuelle Qualität und physikalischen Realismus für Flaggschiffkampagnen benötigen, können die höheren Kosten von Sora 2 durch die überlegene Ausgabequalität und physikalische Genauigkeit rechtfertigen.

Experimentelle Werbung: Kreative Kampagnen, die darauf ausgelegt sind, Grenzen zu überschreiten, unmögliche Szenarien zu zeigen oder Produktfähigkeiten durch übertriebene Physik zu demonstrieren, profitieren von den Weltsimulationsfähigkeiten von Sora 2.

Zugang und Integration: Plattformverfügbarkeit

Seedance 2.0 Zugang

Social-Media-Content-Produktion: Die Kombination aus 20 Sekunden Dauer (perfekt für Reels, TikTok, Shorts), Multi-Shot-Fähigkeit und nativer Audiogenerierung macht Seedance 2.0 zur optimalen Wahl für Social-Media-Ersteller. Generieren Sie schnell mehrere Inhaltsvariationen, bewahren Sie Charakterkonsistenz in Ihrer Inhaltsbibliothek und produzieren Sie fertige Videos ohne zusätzliche Audiobearbeitung.

Werbe- und Marketingvideos: Kommerzielle Videoproduktion erfordert schnelle Iteration und Markenkonsistenz. Der referenzgesteuerte Workflow von Seedance 2.0 ermöglicht es Agenturen, die visuelle Identität der Marke zu wahren und gleichzeitig mehrere Kampagnenvariationen zu generieren. Die Multi-Shot-Fähigkeit ermöglicht komplette Werbenarrative innerhalb einzelner Generierungsdurchläufe, was die Produktionszeitpläne dramatisch verkürzt.

Seedance 2.0 ist derzeit über ByteDances Plattform Jimeng (Dreamina) verfügbar, die für internationale Nutzer unter Dreamina zugänglich ist. Die Plattform erfordert eine Kontoerstellung und arbeitet für Nutzer in China hauptsächlich mit chinesischen Zahlungsmethoden (Alipay, WeChat Pay), obwohl der internationale Zugang erweitert wird.

Drittanbieter-Plattformen wie Atlas Cloud, Kie AI und FLUX Context beginnen, Seedance 2.0 API-Zugriff mit zugänglicheren Zahlungsoptionen für internationale Entwickler anzubieten. Diese Plattformen bieten einheitliche Schnittstellen für den Zugriff auf mehrere KI-Videomodelle und vereinfachen die Integration für Unternehmen, die Videogenerierung in ihre Produkte einbauen.

Das Modell ist auch über verschiedene AI-Tool-Aggregationsplattformen zugänglich, die vereinfachte Schnittstellen für nicht-technische Benutzer bieten. Diese Plattformen berechnen in der Regel Aufschlaggebühren, eliminieren jedoch die Komplexität der direkten API-Integration.

Sora 2 Zugang

Sora 2 ist über drei primäre Kanäle verfügbar:

-

ChatGPT-Schnittstelle: Benutzer mit ChatGPT Pro-Abonnements ($200/Monat) greifen direkt über die ChatGPT-Weboberfläche und die mobile App auf Sora 2 Pro zu. Dies bietet die benutzerfreundlichste Erfahrung mit konversationellem Prompting und iterativer Verfeinerung.

-

OpenAI API: Entwickler können Sora 2 über die offizielle API von OpenAI in Anwendungen integrieren, wobei eine Pay-per-Use-Preisgestaltung verwendet wird. Dies erfordert API-Schlüssel-Authentifizierung und programmgesteuerte Integration, bietet jedoch maximale Flexibilität für benutzerdefinierte Workflows.

-

Drittanbieter-Plattformen: Dienste wie Artlist, Krea und Higgsfield bieten Zugang zu Sora 2 über ihre Plattformen, oft mit zusätzlichen Bearbeitungswerkzeugen und Workflow-Funktionen. Diese Plattformen können unterschiedliche Preisstrukturen oder gebündelte Dienste anbieten.

Für den Zugang zu Sora 2 gelten geografische Einschränkungen, wobei die anfängliche Verfügbarkeit auf bestimmte Länder beschränkt ist. Benutzer außerhalb unterstützter Regionen benötigen möglicherweise VPN-Zugang oder Alternativen von Drittanbieter-Plattformen.

Das breitere Ökosystem: Multi-Modell-Plattformen

Ein aufkommender Trend im Jahr 2026 ist der Aufstieg von Multi-Modell-Plattformen, die einen einheitlichen Zugang zu mehreren KI-Videogenerierungsmodellen über einzelne Schnittstellen bieten. Plattformen wie Seedance AI veranschaulichen diesen Ansatz und bieten Benutzern Zugang zu Seedance 2.0, Sora 2 und anderen führenden Videogenerierungsmodellen neben Bildgenerierungsfunktionen unter Verwendung von Flux, Stable Diffusion, DALL-E 3 und anderen hochmodernen Bildmodellen.

Dieser Multi-Modell-Ansatz bietet mehrere strategische Vorteile:

Flexibilität: Unterschiedliche Projekte haben unterschiedliche Anforderungen. Der Zugriff auf mehrere Modelle über eine einzige Plattform eliminiert die Notwendigkeit, separate Abonnements zu unterhalten und verschiedene Schnittstellen zu erlernen.

Kostenoptimierung: Nutzen Sie das kosteneffektivste Modell für jede spezifische Aufgabe, anstatt sich auf ein einziges teures Abonnement festzulegen. Generieren Sie Social-Media-Inhalte mit Seedance 2.0, produzieren Sie filmische Sequenzen mit Sora 2 und erstellen Sie Marketingbilder mit Flux – alles in einem einheitlichen Workflow.

Workflow-Integration: Multi-Modell-Plattformen bieten oft integrierte Bearbeitungswerkzeuge, Asset-Management und Workflow-Funktionen, die die Produktion über die einfache Generierung hinaus rationalisieren. Kombinieren Sie Bildgenerierung, Videosynthese und Bearbeitungsfähigkeiten in kohärenten Produktionspipelines.

Zukunftssicherheit: Da neue Modelle entstehen und sich bestehende Modelle weiterentwickeln, aktualisieren Multi-Modell-Plattformen ihre Angebote, ohne dass Benutzer zu neuen Diensten wechseln oder neue Schnittstellen erlernen müssen.

Für Unternehmen und professionelle Kreative bieten Plattformen wie Seedance 2 bequemen Zugang zum gesamten Spektrum der KI-Generierungsfähigkeiten und ermöglichen es Teams, das optimale Werkzeug für jede kreative Herausforderung zu wählen, ohne Infrastrukturkomplexität oder mehrere Abonnementverpflichtungen.

Leistungsoptimierung: Die besten Ergebnisse erzielen

Seedance 2.0 Best Practices

Nutzen Sie Referenzeingaben: Die multimodale Architektur von Seedance 2.0 funktioniert am besten, wenn klare Referenzmaterialien bereitgestellt werden. Liefern Sie Stilreferenzbilder für visuelle Konsistenz, Bewegungsreferenzvideos für Actionsequenzen und Audioreferenzen für Rhythmus-Synchronisation.

Strukturieren Sie Multi-Shot-Narrative: Planen Sie Ihr Video als eine Sequenz von unterschiedlichen Aufnahmen mit klaren Übergängen. Beschreiben Sie den Zweck jeder Aufnahme, den Kamerawinkel und die Beziehung zu benachbarten Aufnahmen. Das Modell versteht filmische Konventionen und generiert angemessene Übergänge.

Iterieren Sie an der Charakterkonsistenz: Wenn Sie Inhalte mit wiederkehrenden Charakteren generieren, etablieren Sie das Charakteraussehen durch anfängliche Referenzbilder und bewahren Sie dann die Konsistenz über nachfolgende Generierungen hinweg, indem Sie frühere Ausgaben referenzieren.

Optimieren Sie die Audio-Integration: Für dialoglastige Inhalte stellen Sie klare Skriptbeschreibungen mit Sprecheridentifikation bereit. Die phonemgenaue Lippensynchronisation des Modells funktioniert am besten mit expliziter Dialogzuordnung.

Sora 2 Best Practices

Detaillierte physikalische Beschreibungen: Die Physiksimulation von Sora 2 reagiert auf spezifische Materialbeschreibungen. Statt "eine Person springt", spezifizieren Sie "eine Person in loser Baumwollkleidung springt auf einem Trampolin, Stoff weht bei jedem Sprung". Der zusätzliche physikalische Kontext ermöglicht eine genauere Simulation.

Spezifikation der Kamerabewegung: Beschreiben Sie explizit Kamerabewegungen, Winkel und Brennweitenänderungen. Sora 2 versteht Kinematografie-Terminologie und generiert angemessenes Kameraverhalten, wenn es mit spezifischen Anweisungen gepromptet wird.

Iterative Verfeinerung: Nutzen Sie die konversationelle Schnittstelle von Sora 2 (beim Zugriff über ChatGPT), um Ausgaben iterativ zu verfeinern. Generieren Sie eine erste Version, identifizieren Sie spezifische Elemente, die Anpassung erfordern, und fordern Sie gezielte Änderungen an.

Nutzen Sie die verlängerte Dauer: Nutzen Sie die maximale Dauer von 25 Sekunden bei Sora 2 für Establishing Shots, Charakterentwicklung und emotionales Pacing, die kürzere Dauern nicht aufnehmen können.

Die Wettbewerbslandschaft: Andere bemerkenswerte Modelle

Während Seedance 2.0 und Sora 2 die aktuellen Diskussionen dominieren, verdienen mehrere andere Modelle für spezifische Anwendungsfälle Beachtung:

Google Veo 3.1: Erzielt Spitzenwerte in Benchmarks für visuelle Qualität und Beleuchtungsgenauigkeit. Besonders stark für Produktvisualisierung und Inhalte im Stil kommerzieller Fotografie. Die Preise beginnen bei etwa $19,99/Monat über Googles AI Ultra-Plan.

Runway Gen-4: Bietet robuste API-Integration und integrierte Bearbeitungswerkzeuge. Starke Wahl für Teams, die eine enge Integration mit bestehenden Videobearbeitungs-Workflows benötigen. Die Preise variieren je nach Nutzungstier.

Kling 2.6: Zeigt wettbewerbsfähige Leistung bei der Bewegungsqualität und Subjektkonsistenz. Bietet aggressive Preise für Szenarien mit hohem Generierungsvolumen.

HunyuanVideo: Open-Source-Alternative, die eine Leistung erreicht, die mit kommerziellen Modellen vergleichbar ist. Ideal für Entwickler, die volle Kontrolle über Bereitstellung und Anpassung benötigen.

Die Vielfalt der verfügbaren Modelle spiegelt die Reifung der KI-Videogenerierungstechnologie wider. Anstatt einer einzigen dominanten Lösung bietet der Markt nun spezialisierte Werkzeuge, die für unterschiedliche Produktionsanforderungen, Budgetbeschränkungen und kreative Ziele optimiert sind.

Zukunftsausblick: Was 2026 und darüber hinaus kommt

Der Markt für KI-Videogenerierung entwickelt sich weiterhin in außergewöhnlichem Tempo. Mehrere Trends werden die Landschaft im Jahr 2026 prägen:

Verlängerte Dauer: Aktuelle Modelle erreichen maximal 20-25 Sekunden. Erwarten Sie schnelle Fortschritte in Richtung 60-Sekunden- und schließlich mehrminütiger Generierungsfähigkeiten, da sich die Recheneffizienz verbessert.

Echtzeit-Generierung: Aktuelle Generierungszeiten reichen je nach Komplexität von Minuten bis Stunden. Aufkommende Optimierungstechniken versprechen nahezu Echtzeit-Generierung, was Live-Videosynthese und interaktive Anwendungen ermöglicht.

Fine-Tuning-Fähigkeiten: Benutzerdefiniertes Modelltraining auf markenspezifische visuelle Stile, Charakterbibliotheken und Bewegungsmuster wird beispiellose Konsistenz und Markenausrichtung ermöglichen.

Erweiterte Kontrollschnittstellen: Jenseits von Text-Prompts und Referenzbildern erwarten Sie ausgefeilte Kontrollmechanismen, einschließlich 3D-Szenenkomposition, zeitleistenbasierte Bearbeitung und parametrische Animationssteuerungen.

Hybride Workflows: Die Integration zwischen KI-Generierung und traditionellen Videoproduktionswerkzeugen wird die Grenze zwischen synthetischem und aufgenommenem Material verwischen und nahtlose Compositing- und Erweiterungs-Workflows ermöglichen.

Ihre Entscheidung treffen: Ein Rahmen für die Modellauswahl

Die Wahl zwischen Seedance 2.0 und Sora 2 erfordert eine ehrliche Bewertung Ihrer spezifischen Anforderungen in mehreren Dimensionen:

Budgetbeschränkungen: Wenn Kosteneffizienz oberste Priorität hat und Ihr Produktionsvolumen hoch ist, liefert Seedance 2.0 einen wesentlich besseren Wert. Für qualitativ hochwertige Produktionen mit geringem Volumen, bei denen die Kosten pro Video weniger wichtig sind als die Ausgabequalität, kann Sora 2 seine Premium-Preise rechtfertigen.

Produktionsvolumen: Ein hohes Content-Produktionsvolumen (50+ Videos monatlich) spricht stark für die Preisstruktur von Seedance 2.0. Geringes Produktionsvolumen (unter 20 Videos monatlich) kann die höheren Kosten pro Video bei Sora 2 leichter absorbieren.

Inhaltstyp: Social Media, Werbung und kommerzielle Inhalte entsprechen den Stärken von Seedance 2.0. Filmische, experimentelle und physikintensive Inhalte profitieren von den Fähigkeiten von Sora 2.

Technische Anforderungen: Wenn native Audiogenerierung, Multi-Shot-Konsistenz und referenzgesteuerte Kontrolle entscheidend sind, bietet Seedance 2.0 diese Funktionen sofort einsatzbereit. Wenn maximaler physikalischer Realismus und verlängerte Dauer nicht verhandelbar sind, liefert Sora 2 überlegene Leistung.

Workflow-Integration: Berücksichtigen Sie Ihre bestehende Produktionspipeline. Wenn Sie API-Integration für automatisierte Workflows benötigen, bewerten Sie die API-Reife und Dokumentation jedes Modells. Wenn Sie benutzerfreundliche Schnittstellen für manuelle Generierung bevorzugen, bieten beide Modelle zugängliche Plattformen.

Geografische Verfügbarkeit: Sora 2 unterliegt geografischen Einschränkungen, die den Zugang je nach Standort erschweren können. Die expandierende internationale Verfügbarkeit von Seedance 2.0 über Plattformen wie Seedance 2 bietet einen konsistenteren globalen Zugang.

Fazit: Das richtige Werkzeug für den richtigen Job

Der Wettbewerb zwischen Seedance 2.0 und Sora 2 stellt eine gesunde Reifung der KI-Videogenerierungstechnologie dar. Anstatt einer einzigen dominanten Lösung haben Kreative nun Zugang zu spezialisierten Werkzeugen, die für unterschiedliche Produktionsphilosophien und Anwendungsfälle optimiert sind.

Seedance 2.0 glänzt als produktionsorientierte Engine, die für kommerzielle Workflows, schnelle Iteration und kostengünstige Inhaltserstellung im großen Maßstab entwickelt wurde. Seine multimodale Eingabearchitektur, native Audiogenerierung, Multi-Shot-Konsistenz und zugängliche Preisgestaltung machen es zur optimalen Wahl für Social-Media-Ersteller, Werbeagenturen, E-Commerce-Unternehmen und Content-Produzenten, die Effizienz und Volumen priorisieren.

Sora 2 steht als Branchenführer in Physiksimulation, Weltmodellierung und filmischem Realismus. Seine überlegene Handhabung komplexer physikalischer Interaktionen, die Fähigkeit zur verlängerten Dauer und das außergewöhnliche Prompt-Verständnis machen es zur bevorzugten Wahl für experimentelle Filmemacher, Premium-Markeninhalte, wissenschaftliche Visualisierung und kreative Projekte, bei denen visuelle Wiedergabetreue Premium-Preise rechtfertigt.

Für viele professionelle Kreative und Unternehmen beinhaltet die optimale Strategie die Nutzung beider Modelle über Multi-Modell-Plattformen wie SeaDance 2. Dieser Ansatz bietet die Flexibilität, das richtige Werkzeug für jedes spezifische Projekt zu wählen und gleichzeitig eine einheitliche Workflow-Integration und Kostenoptimierung beizubehalten.

Die Revolution der KI-Videogenerierung hat sich über die experimentelle Phase hinaus in den praktischen Produktionseinsatz bewegt. Ob Sie sich für Seedance 2.0, Sora 2 oder einen Multi-Modell-Ansatz entscheiden, die Technologie existiert jetzt, um Videoproduktionsworkflows zu transformieren, Kosten und Zeitpläne dramatisch zu reduzieren und kreative Möglichkeiten freizuschalten, die noch vor wenigen Monaten einfach unmöglich waren.

Die Frage ist nicht mehr, ob die KI-Videogenerierung bereit für den professionellen Einsatz ist – sie ist es nachweislich. Die Frage ist, welches Tool am besten zu Ihrer spezifischen kreativen Vision, Ihren Produktionsanforderungen und Geschäftszielen passt. Mit dem detaillierten Vergleich in diesem Leitfaden haben Sie nun die notwendigen Informationen, um diese Entscheidung selbstbewusst und strategisch zu treffen.

Bereit, hochmoderne KI-Videogenerierung zu erleben? Entdecken Sie Seedance AI für einheitlichen Zugriff auf Seedance 2.0, Sora 2 und mehrere führende KI-Video- und Bildgenerierungsmodelle – alles auf einer praktischen Plattform, die für professionelle Kreative und Unternehmen entwickelt wurde.