إذا كنت تبحث عن HappyHorse complete guide، فالمشكلة الحقيقية ليست فهم الرسالة التسويقية نفسها. المشكلة الحقيقية هي الفصل بين ما هو مرئي علنًا وبين ما يمكن التحقق منه بشكل مستقل، ثم اتخاذ قرار: هل HappyHorse شيء يستحق المتابعة، أم شيء يستحق التجربة، أم شيء يمكن الاعتماد عليه اليوم فعلًا؟

حتى 8 أبريل 2026، تبدو المواد العامة الخاصة بـ HappyHorse طموحة جدًا. فهي تقدم HappyHorse 1.0 بوصفه نموذج فيديو متعدد الوسائط مفتوح المصدر مع صوت متزامن، و lip-sync بسبع لغات، ومخرج 1080p، وإذن استخدام تجاري، ودعم self-hosting، ونتائج benchmark قوية. هذه حزمة جذابة جدًا. لكنها تخلق أيضًا مشكلة تحقق مباشرة، لأن المسار العام إلى الشيفرة غير متاح للتحقق المباشر، كما أن مسار استضافة النموذج الظاهر في أمثلة النشر لا يمكن الوصول إليه في حالة عدم تسجيل الدخول.

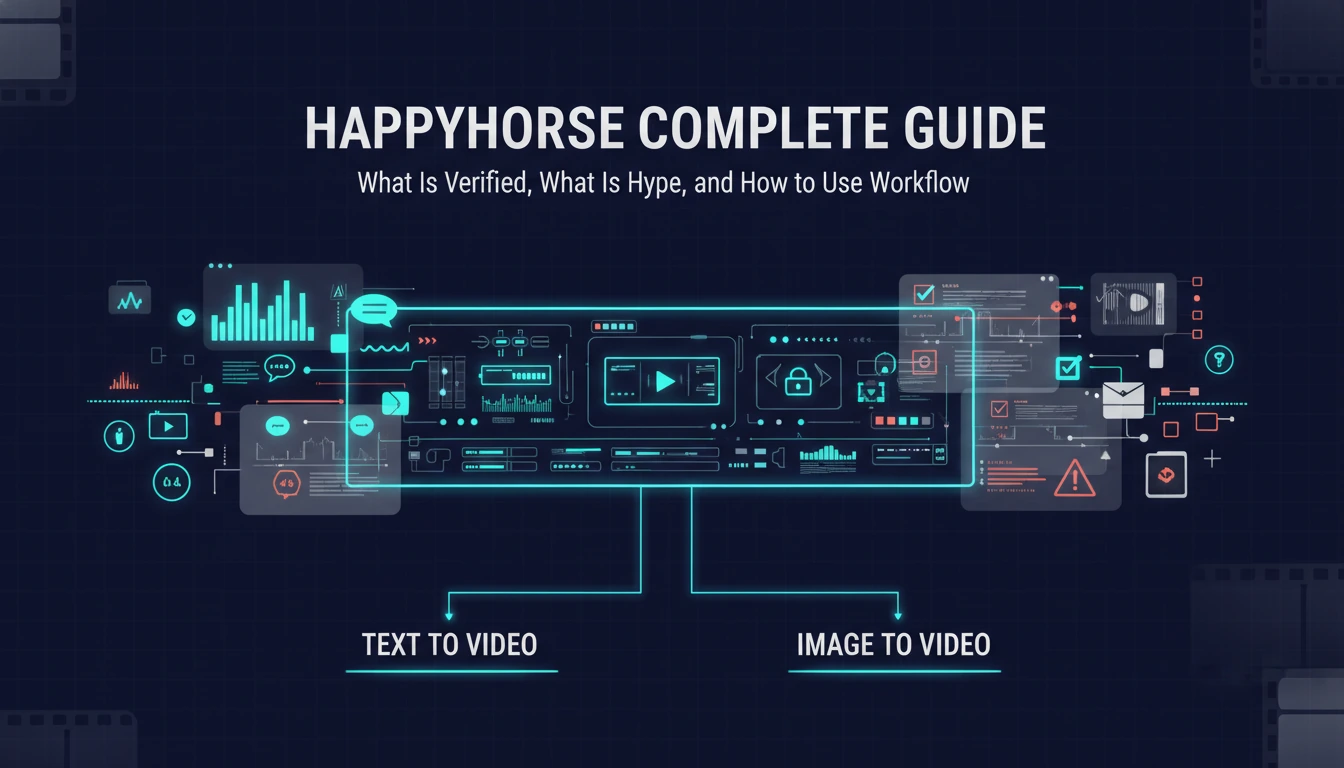

هذا لا يعني تلقائيًا أن HappyHorse مزيف. لكنه يعني أنك بحاجة إلى قراءة كل claim ضمن الإطار الصحيح: مشروع مثير للاهتمام، لكن التحقق العام منه غير مكتمل، وجاهزيته للاستخدام الإنتاجي ما زالت غير واضحة. هذا الدليل يوضح ما الذي يبدو حقيقيًا، وما الذي لا يزال يحتاج إلى إثبات، وأين قد يكون HappyHorse مهمًا فعلًا، ولماذا يكون workflow من نوع text to video أو workflow من نوع image to video خيارًا أكثر عملية إذا كنت تحتاج إلى نتائج الآن بدلًا من الانتظار.

الإجابة المختصرة

يبدو HappyHorse فكرة واعدة لنموذج فيديو بالذكاء الاصطناعي، مع تموضع عام قوي حول open weights وتوليد الصوت و lip-sync و self-hosting. لكن الأدلة العامة المتاحة حاليًا ليست قوية بما يكفي للتعامل مع كل headline claim على أنه بنية تحتية مؤكدة بالكامل وجاهزة للاعتماد دون مخاطر.

إليك الخلاصة العملية:

| السؤال | الإجابة العملية |

|---|---|

| هل HappyHorse مثير للاهتمام؟ | نعم. مجموعة الميزات المعلنة علنًا طموحة بشكل غير معتاد بالنسبة إلى نموذج فيديو يُقدَّم على أنه مفتوح وقابل للاستضافة الذاتية. |

| هل هو نموذج open عام تم التحقق منه بالكامل اليوم؟ | ليس بعد. مسار المستودع العام غير متاح، ومسار النموذج الظاهر على الموقع غير متاح أيضًا بدون تسجيل دخول. |

| هل يجب تجاهله؟ | لا. يستحق المتابعة إذا كنت مهتمًا بتوليد الفيديو متعدد الوسائط المفتوح. |

| هل يجب أن تبني pipeline المحتوى حوله اليوم؟ | فقط إذا كنت تقبل مخاطر التحقق ويمكنك التعايش مع artefacts عامة غير مكتملة. |

| ماذا ينبغي أن يفعل صناع المحتوى الآن؟ | استخدام workflow text to video موثوق للتوليد المعتمد على prompt أو workflow image to video للأنيميشن المعتمد على reference ريثما ينضج HappyHorse. |

الفكرة الأساسية هي أن HappyHorse يبدو حاليًا مشروعًا عالي الإمكانات يستحق المتابعة أكثر من كونه أساسًا جاهزًا لجدولة إنتاج جادة.

ماذا يدّعي HappyHorse علنًا الآن

المواد العامة الحالية لـ HappyHorse لا تقدم صفحة teaser غامضة، بل قصة منتج محددة نسبيًا. وتشمل الادعاءات المرئية:

- نموذج بحجم 15B parameter

- معمارية Transformer من 40 طبقة

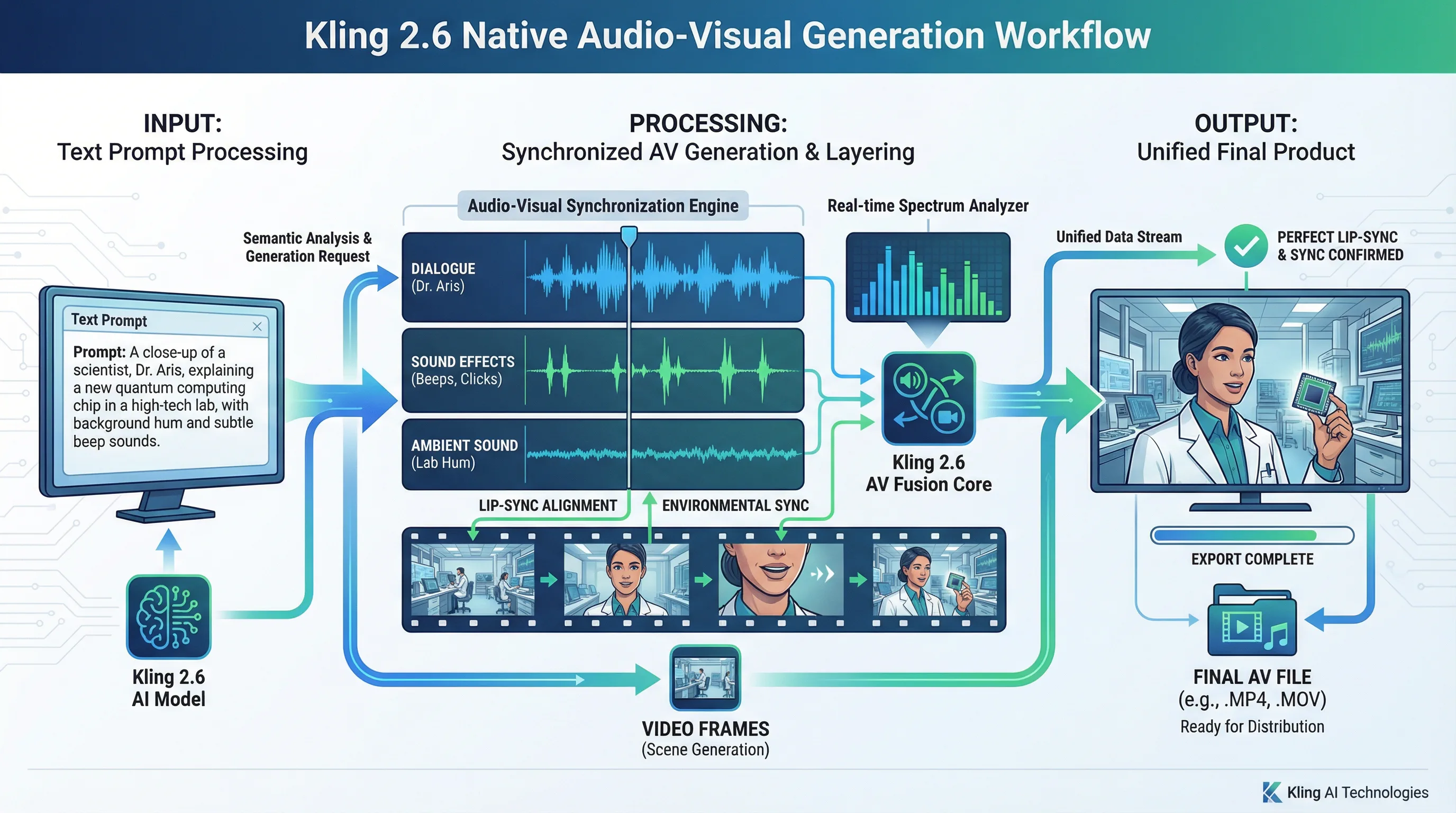

- توليد مشترك للفيديو والصوت

- دعم prompts النصية والصورية

- lip-sync بسبع لغات

- مخرج 1080p

- مقاطع من 5 إلى 8 ثوان

- self-hosting على بطاقات H100 أو A100

- إصدار open source مع إذن استخدام تجاري

- سعر يبدأ من

$11.90

هذه ليست عبارات عامة من نوع landing page. بل تبدو أقرب إلى صفحة إطلاق تقني تريد أن تؤخذ بجدية من قبل المبدعين والباحثين معًا.

كما يذكر الموقع claims أكثر تحديدًا ذات طابع أدائي، مثل:

- نحو 38 ثانية لإنتاج مقطع 5 ثوان بدقة 1080p على H100

- دعم lip-sync بالإنجليزية والماندرين والكانتونية واليابانية والكورية والألمانية والفرنسية

- تفوق في benchmark على OVI 1.1 و LTX 2.3

- claim بمرتبة متقدمة على leaderboard عام لنماذج الفيديو

على الورق، تبدو هذه الحزمة جذابة للغاية. نموذج يجمع بين text-to-video و image-to-video والصوت المتزامن و lip-sync متعدد اللغات وانفتاح ملائم للاستخدام التجاري سيبرز فورًا. المشكلة ليست في جودة القصة، بل في الفجوة بين القصة وبين artefacts العامة التي يمكن الوصول إليها فعليًا اليوم.

ما الذي تم التحقق منه فعلًا وما الذي لا يزال يحتاج إلى دليل

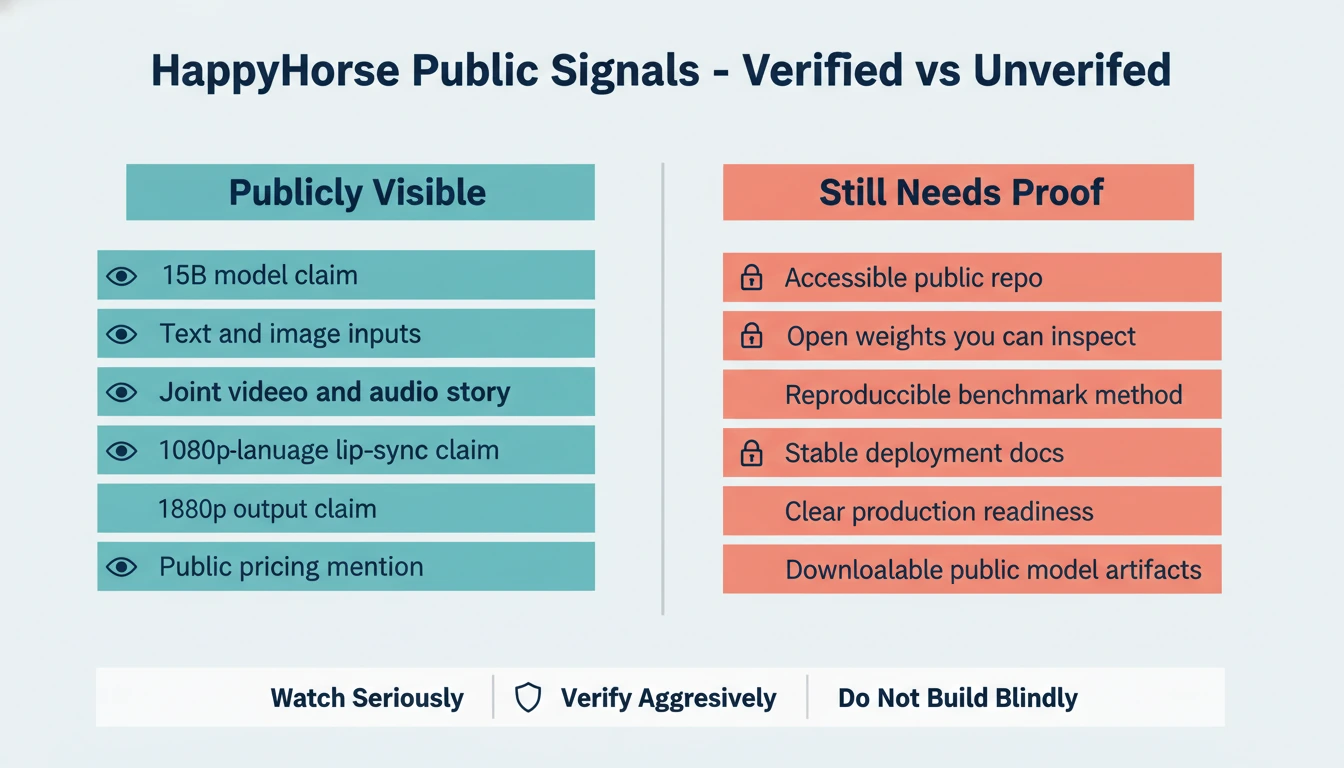

أفضل طريقة لقراءة HappyHorse الآن هي تقسيم المعلومات العامة إلى فئتين: claims يمكن ملاحظتها مباشرة، و claims ما زالت تحتاج إلى تأكيد مستقل.

| الحالة | ما الذي يندرج هنا | لماذا يندرج هنا |

|---|---|---|

| مرئي علنًا | claims الميزات على الموقع، الإشارة إلى السعر، أمثلة deployment، جداول benchmark، الفيديوهات النموذجية | هذه العناصر مرئية مباشرة على الموقع الحالي ويمكن فحصها باعتبارها claims منشورة. |

| غير مؤكد بشكل مستقل بما يكفي | توفر open source، public weights، codebase قابلة لـ self-hosting، منهجية benchmark قابلة لإعادة الإنتاج، الجاهزية للإنتاج | مسار المستودع المشار إليه غير متاح، ومسار النموذج غير مفتوح علنًا بدون مصادقة. |

هذا التمييز مهم لأن كثيرًا من صناع المحتوى يخلطون بين سؤالين مختلفين.

السؤال الأول هو:

- هل يقدم المشروع قصة منتج متماسكة ومعقولة تقنيًا؟

السؤال الثاني هو:

- هل أستطيع اليوم التحقق منه وتحميله وإعادة إنتاجه وتشغيله بنفسي؟

في الوقت الحالي، HappyHorse أقوى في الإجابة عن السؤال الأول منه في الإجابة عن الثاني.

هذا لا ينسف المشروع. لكنه يغير الإجراء الصحيح. إذا كنت باحثًا أو تتابع البنية المفتوحة مبكرًا، فمن المنطقي مراقبته. أما إذا كنت creator لديه مواعيد تسليم، فالأفضل أن تواصل العمل بأدوات تسمح لك بالفعل بالإنتاج بشكل موثوق.

لماذا يحصل HappyHorse على هذا القدر من الانتباه

يحصل HappyHorse على الانتباه لأنه يجمع عدة أشياء يريدها صناع المحتوى في الوقت نفسه:

- تموضع مفتوح أو على الأقل open-leaning

- توليد متعدد الوسائط بدل الفيديو الصامت فقط

- دعم lip-sync بعدة لغات

- خطاب self-hosting بدل الاعتماد الكامل على SaaS

- framing للـ benchmark يوحي بأنه قادر على منافسة المشاريع المفتوحة المعروفة في مجال الفيديو

هذا المزيج يصيب توتر السوق الحالي مباشرة. فالكثير من المبدعين يريدون تحسينات الجودة في أحدث أنظمة الفيديو، لكنهم لا يريدون أن يعلقوا داخل أدوات مغلقة أو rollouts إقليمية غير مستقرة أو نماذج تسعير محصورة في واجهة واحدة. HappyHorse يتحدث مباشرة إلى هذا الاحتياج.

وهناك سبب ثانٍ لانتشاره: المشروع يصف workflow تبدو مكتملة من ناحية التشغيل. كثير من صفحات نماذج الفيديو ما زالت تجبرك على تركيب الـ stack بنفسك. تنتج الفيديو في مكان. تضيف الصوت في مكان آخر. تصلح lip-sync في مكان ثالث. تعمل upscale لاحقًا. وتضبط التوقيت يدويًا. HappyHorse يعد بمسار أكثر تكاملًا.

لهذا يبدو المشروع مهمًا حتى قبل أن يلحق به التحقق العام الكامل. فهو يشير إلى workflow التي يريدها المبدعون فعلًا.

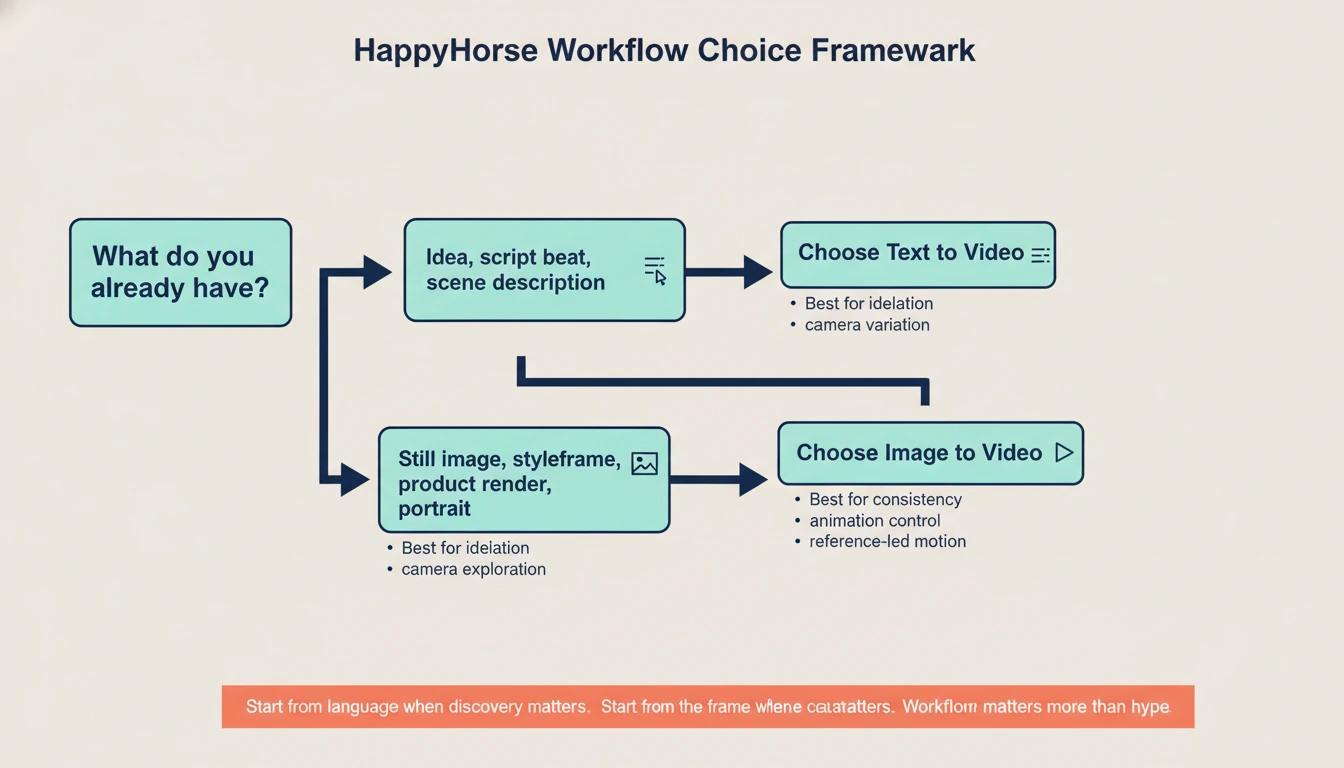

السؤال الحقيقي عن الـ workflow: Text to Video أم Image to Video؟

حتى لو أوفى HappyHorse لاحقًا بكل ما يعد به علنًا، فمعظم صناع المحتوى سيظلون بحاجة إلى اتخاذ القرار نفسه الذي يواجهونه اليوم: هل تبدأ من اللغة أم من frame؟

هذا الاختيار أهم من اسم النموذج نفسه.

| الـ workflow | أفضل نقطة بداية | ماذا يمنحك | نقطة الضعف الأساسية |

|---|---|---|---|

| Text to video | لديك فكرة أو beat في script أو وصف مشهد أو اتجاه camera لكن لا يوجد keyframe ثابت بعد | ideation أسرع، واستكشاف أسهل، وتنوع أكبر يقوده prompt | يمكن أن تنحرف composition عندما تكون الصورة الذهنية شديدة التحديد |

| Image to video | لديك بالفعل still image أو frame لشخصية أو render لمنتج أو frame من storyboard أو hero shot | اتساق أفضل للموضوع، وتحكم أقوى في art direction، وأسهل في تحريك visual معتمد مسبقًا | حرية أقل عند تغيير المشهد بشكل كبير إذا لم تكن الصورة المصدر قوية |

هنا بالضبط يعلق كثير من الناس عندما يطاردون إطلاق نموذج جديد. يبدأون في الاعتقاد أن النموذج الجديد هو الـ workflow نفسها. لكنه ليس كذلك. فالـ workflow ما زالت تبدأ من الأصل الإبداعي الذي تملكه بالفعل.

استخدم text to video عندما:

- تكون بصدد استكشاف عدة أفكار للمشاهد بسرعة

- تحتاج إلى بدائل camera متعددة انطلاقًا من فكرة مكتوبة واحدة

- لا تزال تكتشف الاتجاه البصري

- تريد تدوير mood أو action أو narrative beat قبل تثبيت frame

واستخدم image to video عندما:

- تكون لديك صورة ثابتة قوية بالفعل

- تحتاج إلى أن يظل character أو product أو composition قريبًا من reference

- تقوم بتحريك key visual أو visual إعلاني أو portrait أو panel من storyboard

- تكون visual consistency أهم من الاستكشاف المفتوح

قد يدعم HappyHorse يومًا ما المسارين داخل ecosystem واحدة. لكن بالنسبة لمعظم المبدعين، لن يغيّر ذلك شجرة القرار نفسها، بل فقط النموذج الذي ينفذها.

أين يبدو HappyHorse أقوى على الورق

إذا كان تموضعه العام صحيحًا في الاتجاه العام، فسيكون HappyHorse أكثر إقناعًا في بعض السيناريوهات المحددة.

1. الفيديو القصير المعتمد على الحوار

توليد الفيديو والصوت معًا مع lip-sync متعدد اللغات هو أبرز ما في الحزمة. إذا عملت هذه الميزات بالمستوى الذي يوحي به الموقع، فسيصبح HappyHorse أكثر إثارة بكثير من مجرد مولد مقاطع صامتة مع جداول benchmark أنيقة.

وذلك مهم في:

- محتوى avatar المتحدث

- الفيديوهات التوضيحية القصيرة

- فيديوهات creators متعددة اللغات

- مقدمات المنتجات التي تحتوي على حديث ظاهر على الشاشة

- محتوى اجتماعي قائم على الحوار

2. التجارب المفتوحة أو self-hosted

كثير من الفرق لا تريد مجرد output جيد. بل تريد بنية يمكنها inspect و tune و benchmark وربما deploy على GPU خاصة بها. ولهذا السبب فإن زاوية open-source مهمة جدًا.

إذا كان HappyHorse سيطلق فعلًا weights قابلة للاستخدام و inference code وخيارات distillation، فسيصبح مهمًا ليس للمبدعين فقط، بل أيضًا لـ:

- فرق الذكاء الاصطناعي التطبيقي

- مجموعات البحث

- الاستوديوهات ذات القيود المتعلقة بالخصوصية

- الشركات التي تختبر media pipelines داخلية

3. تحكم أسلوبي أقوى في image-to-video

المشروع يدّعي دعم مدخلات النص والصورة. وعمليًا، النماذج التي تدعم التوليد المعتمد على الصورة تصبح غالبًا أكثر فائدة في العمل التجاري من الأنظمة النصية البحتة، لأن workflow المعتمدة على الصورة أسهل في التحكم.

لهذا السبب، وحتى قبل أن يصبح HappyHorse قابلًا للتحقق الكامل، من المفيد اختبار عمليتك الخاصة عبر workflow image to video. فإذا كان منطق الإنتاج لديك يعتمد على stills معتمدة أو styleframes أو product art أو references للشخصيات، فإن الأنيميشن القائم على الصورة هو workflow الأكثر قابلية للنقل.

أين ما زالت القصة العامة هشة

هذا هو الجزء الذي تتجاوزه مقالات الإطلاق عادة. نقاط الضعف هنا ليست بالضرورة ضعفًا في النموذج نفسه. إنها نقاط ضعف في الثقة وقابلية التشغيل.

عدم تطابق artefacts العامة مع القصة

المواد العامة الحالية تتحدث بثقة منتج تقني أُطلق بالكامل. لكن مسار المستودع العام لا يدعم هذه الثقة. إذا كان المشروع يريد أن يقود بمصداقية open-source، فإن artefacts القابلة للوصول ليست أمرًا اختياريًا.

فجوة الثقة في benchmark

نشر جداول benchmark أمر سهل. أما تفاصيل التقييم القابلة لإعادة الإنتاج فهي أصعب بكثير. وحتى يوجد report واضح يمكن تفحصه أو access مستقر إلى code أو طريق لإعادة الإنتاج من طرف ثالث، ينبغي قراءة أرقام benchmark على أنها claims اتجاهية لا حقائق مستقرة.

غموض الجاهزية للإنتاج

يمكن أن يكون النموذج حقيقيًا ومبهرًا ومع ذلك غير جاهز للاستخدام الإنتاجي الموثوق. الفرق التي تعمل تحت deadlines تهتم بأشياء مثل:

- access مستقر

- failure modes موثقة

- قابلية التنبؤ في rate

- environments قابلة لإعادة الإنتاج

- cadence مرئية للتحديثات

HappyHorse لا يكشف حتى الآن عن سطح تشغيلي عام كافٍ ليحصل على تقييم مرتفع في هذه النقاط.

ماذا ينبغي أن يفعل صناع المحتوى الآن

إذا كنت مهتمًا بـ HappyHorse، فالحركة الأفضل ليست الجدال حول ما إذا كان مبالغًا في تقديره أو أقل تقديرًا مما يستحق. الحركة الأفضل هي تقليل المخاطر في مسار عملك من الآن.

استخدم هذا الجدول:

| وضعك الحالي | أفضل خطوة الآن |

|---|---|

| تحتاج أساسًا إلى استكشاف مفاهيمي انطلاقًا من prompts | ابنِ حول workflow text to video موثوق وضع HappyHorse في watchlist |

| لديك بالفعل concept frames أو stills لمنتجات أو portraits | ابنِ حول image to video واختبر النماذج الجديدة فقط عندما تقدم اتساقًا أفضل بوضوح |

| البنية المفتوحة أهم بالنسبة لك من النشر القريب | تابع HappyHorse عن قرب وانتظر أوزانًا وشيفرة ووثائق قابلة للوصول وإعادة الإنتاج |

| تحتاج إلى assets قابلة للنشر هذا الأسبوع | لا تجعل تقويم المحتوى يعتمد على نموذج لم يكتمل تحققه العام بعد |

هذه هي العدسة العملية التي تغيب عن كثير من تغطيات الإطلاق. لا تحتاج إلى أن تقرر الآن ما إذا كان HappyHorse هو المستقبل. تحتاج فقط إلى أن تحدد ما الذي يساعدك على الاستمرار في النشر اليوم من دون إغلاق الباب أمام أدوات أفضل غدًا.

أين يمكنك متابعة الظهور العام لـ HappyHorse

إذا كنت تريد متابعة كيفية ظهور المشروع في الأدلة العامة وصفحات الإطلاق، فهناك نقطتا متابعة مفيدتان هما HappyHorse AI ونموذج الفيديو HappyHorse. تعامل معهما كبوابتي اكتشاف، لا كبديل عن شيفرة قابلة للفحص، وأوزان مستقرة، ومواد نشر قابلة لإعادة الإنتاج.

كيف تقيّم HappyHorse بشكل أفضل عندما تتوفر مواد عامة أكثر

عندما يكشف HappyHorse عن بنية عامة أكثر، فهذه هي الاختبارات الأهم:

- هل يستطيع مستخدم غير مسجّل الدخول الوصول إلى المستودع الحقيقي والوثائق وصفحة النموذج من دون طريق مسدود؟

- هل الأوزان ونصوص الاستدلال وتعليمات النشر متسقة عبر كل الأسطح العامة؟

- هل يستجيب مسار text-to-video فعلًا للمحفزات السينمائية بمستوى اتساق مفيد؟

- هل يحافظ مسار image-to-video على subject و composition عند إضافة الحركة؟

- هل الصوت المتزامن usable فعلًا، أم ما زال يحتاج إلى cleanup كثيف؟

- هل تظهر claims الخاصة بـ lip-sync متعدد اللغات في demos عامة خارج المقاطع المنتقاة بعناية؟

- هل يستطيع creator أو engineer إعادة إنتاج الأداء المنشور على العتاد المعلن؟

إلى أن تُجاب هذه الأسئلة، فالموقف الصحيح هو اهتمام مبني على معرفة، لا تبنٍّ أعمى.

FAQ

هل HappyHorse مفتوح المصدر الآن؟

يُقدَّم HappyHorse علنًا على أنه open source مع إذن استخدام تجاري، لكن مسار المستودع العام الحالي غير متاح في فحص مباشر. claim الانفتاح ظاهر، لكن سلسلة artefacts العامة لا تزال غير مكتملة.

هل HappyHorse هو text-to-video أم image-to-video؟

الموقع العام الحالي يقدمه على أنه الاثنين معًا، وهذا جزء من سبب الاهتمام به. لكن السؤال الأكثر فائدة هو: أي workflow تناسب input لديك اليوم؟ إذا كنت تعمل من prompt فاختر text to video، وإذا كنت تعمل من reference فاختر image to video.

هل HappyHorse جاهز للاستخدام الإنتاجي؟

قد يصبح مهمًا للإنتاج لاحقًا، لكن مستوى التحقق العام الحالي ليس قويًا بما يكفي للتوصية به كمركز pipeline حساسة للمواعيد.

ما السبب الأكبر وراء اهتمام الناس بـ HappyHorse؟

لأنه يجمع بين تموضع open model والصوت المتزامن و lip-sync متعدد اللغات ومدخلات النص والصورة معًا. وهذه قصة workflow أكثر جاذبية بكثير من نموذج فيديو صامت آخر مع screenshot benchmark واحد.

ماذا يجب أن أستخدم بينما يواصل HappyHorse النضج؟

استخدم منظور workflow-first. ابدأ بـ text to video عندما يكون المشهد ما يزال prompt-driven، واستخدم image to video عندما تكون لديك الصورة التي تريد تحريكها بالفعل.

الحكم النهائي

HappyHorse يستحق الانتباه، لكنه لا يستحق الثقة العمياء. قصته العامة قوية بما يكفي ليؤخذ على محمل الجد، وهشة بما يكفي لتحتاج إلى تحقق صارم.

إذا نجح النموذج في المستقبل في الوفاء بوعوده العامة مع artefacts مستقرة، فقد يصبح واحدًا من أكثر مشاريع الفيديو المفتوحة إثارة في السوق. وحتى ذلك الوقت، ينبغي على صناع المحتوى ألا يحولوا حماس launch page إلى اعتماد إنتاجي. ابنِ على workflows تساعدك على النشر اليوم، وابقِ معايير التقييم مرتفعة، وتعامل مع HappyHorse بوصفه مشروعًا واعدًا ما زال عليه أن يغلق فجوة الإثبات.